Andersons Blickwinkel

Visuelle Analogien für KI

Aktuelle KI-Modelle erkennen keine „relationalen“ Ähnlichkeiten in Bildern, wie beispielsweise die Ähnlichkeit der Erdschichten mit einem Pfirsich, und vernachlässigen damit einen wichtigen Aspekt der menschlichen Bildwahrnehmung.

Obwohl es viele gibt Computer Vision Modelle, die in der Lage sind, Bilder zu vergleichen und Ähnlichkeiten zwischen ihnen zu finden, weisen bei der aktuellen Generation von Vergleichssystemen nur wenige oder gar keine auf. einfallsreich Kapazität. Betrachten Sie einige der Liedtexte des Klassikers aus den 1960er Jahren: Windmühlen deines Geistes:

Wie ein Karussell, das sich dreht und Kreise um den Mond zieht

Wie eine Uhr, deren Zeiger über die Minuten auf ihrem Zifferblatt hinweggleiten.

Und die Welt ist wie ein Apfel, der sich lautlos im Weltraum dreht.

Vergleiche dieser Art stellen einen Bereich poetischer Anspielungen dar, der für den Menschen weit über den künstlerischen Ausdruck hinaus bedeutsam ist; vielmehr ist er eng mit der Entwicklung unserer Wahrnehmungssysteme verbunden; indem wir unseren „Objekt“-Bereich erschaffen, entwickeln wir eine Fähigkeit zur visuellen Ähnlichkeitso dass beispielsweise Querschnitte, die einen Pfirsich und den Planeten Erde darstellen, oder fraktale Wiederholungen wie Kaffeespiralen und Galaxienäste entstehen. als analog registrieren mit uns.

Auf diese Weise können wir Zusammenhänge zwischen scheinbar unzusammenhängenden Objekten und Objekttypen herleiten, und inferenten Systeme (wie Gravitation, Impuls und Oberflächenkohäsion), die auf eine Vielzahl von Bereichen und in verschiedenen Maßstäben Anwendung finden können.

Dinge sehen

Selbst die neueste Generation von KI-Systemen zum Bildvergleich, wie z. B. Learned Perceptual Image Patch Similarity (LIPS) und DINO, die auf menschlichem Feedback basieren, führen lediglich oberflächliche Vergleiche durch.

Ihre Fähigkeit zu Finde Gesichter, wo keine sind – d.h. Pareidolie – stellt nicht die Art von visuellen Ähnlichkeitsmechanismen dar, die Menschen entwickeln, sondern entsteht dadurch, dass Gesichtserkennungsalgorithmen die niedrigstufige Gesichtsstruktur nutzen. Funktionen die manchmal mit zufälligen Objekten übereinstimmen:

Beispiele für falsch positive Ergebnisse bei der Gesichtserkennung im Datensatz „Faces with Things“. Quelle

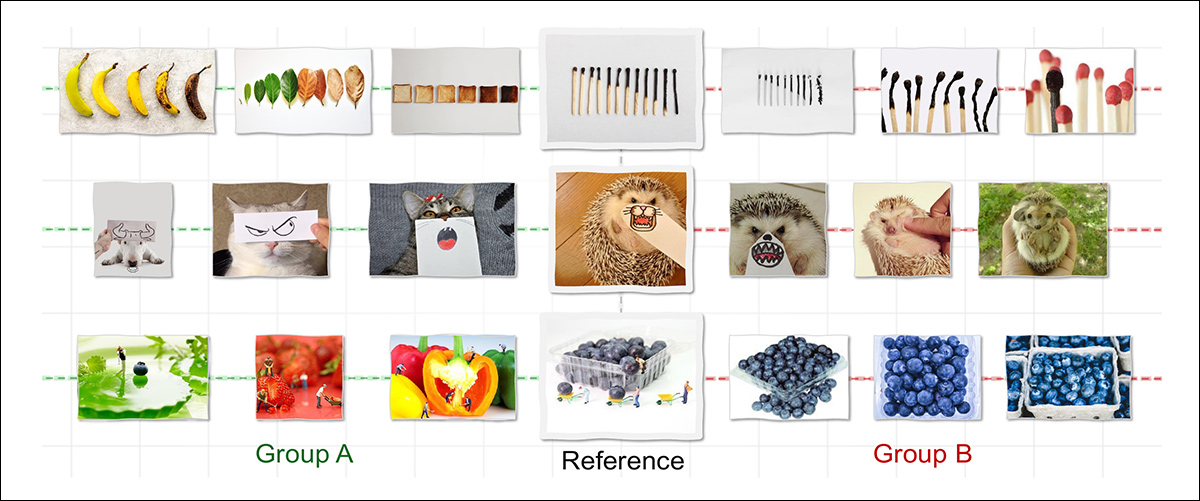

Um festzustellen, ob Maschinen tatsächlich unsere Vorstellungskraft zur Erkennung visueller Ähnlichkeiten über verschiedene Bereiche hinweg entwickeln können, haben Forscher in den USA eine Studie durchgeführt. Studie um Relationale visuelle Ähnlichkeit, Erstellung und Training eines neuen Datensatzes, der darauf abzielt, abstrakte Beziehungen zwischen verschiedenen Objekten zu erzwingen, die dennoch durch eine abstrakte Beziehung miteinander verbunden sind:

Die meisten KI-Modelle erkennen Ähnlichkeit nur, wenn Bilder oberflächliche Merkmale wie Form oder Farbe gemeinsam haben. Daher würden sie nur Gruppe B (siehe oben) mit dem Referenzbild verknüpfen. Menschen hingegen sehen auch Gruppe A als ähnlich an – nicht weil die Bilder ähnlich aussehen, sondern weil sie derselben zugrundeliegenden Logik folgen, beispielsweise der Darstellung einer Transformation im Zeitverlauf. Die neue Arbeit versucht, diese Art von struktureller oder relationaler Ähnlichkeit nachzubilden, um die maschinelle Wahrnehmung dem menschlichen Denken anzunähern.. Quelle: https://arxiv.org/pdf/2512.07833

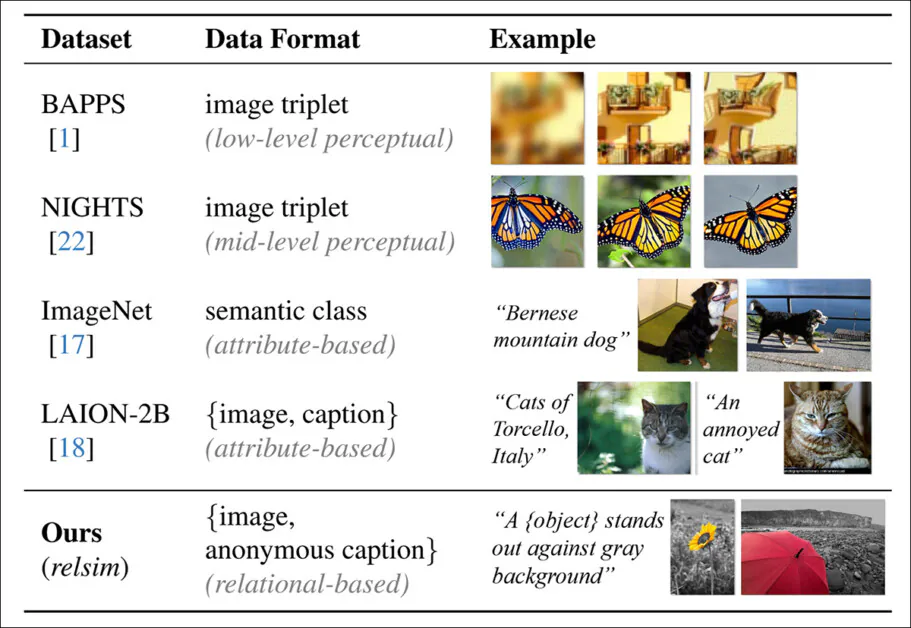

Das für den Datensatz entwickelte Beschriftungssystem ermöglicht ungewöhnlich abstrakte Annotationen, die KI-Systeme dazu zwingen sollen, sich auf grundlegende Merkmale anstatt auf spezifische lokale Details zu konzentrieren:

Die vorhergesagten „anonymen“ Bildunterschriften, die zur „relsim“-Metrik der Autoren beitragen.

Die kuratierte Sammlung und ihr ungewöhnlicher Bildunterschriftenstil bilden die Grundlage für den neuen, von den Autoren vorgeschlagenen Messwert. relsim, die die Autoren haben fein abgestimmt in ein Bild-Sprach-Modell (VLM).

Ein Vergleich zwischen dem Beschriftungsstil typischer Datensätze, der sich auf die Ähnlichkeit von Attributen konzentriert, und dem relsim-Ansatz (untere Zeile), der die relationale Ähnlichkeit betont.

Der neue Ansatz stützt sich auf Methoden der Kognitionswissenschaft, insbesondere auf die von Dedre Gentner. Strukturabbildungstheorie (eine Studie über Analogien) und Amos Tverskys Definition der relationalen Ähnlichkeit und der Attributähnlichkeit.

Auf der zugehörigen Projektwebsite findet sich ein Beispiel für relationale Ähnlichkeit.. Quelle

Die Autoren geben an:

„[Menschen] verarbeiten Ähnlichkeiten von Attributen auf perzeptueller Ebene, während relationale Ähnlichkeit konzeptuelle Abstraktion erfordert, die oft durch Sprache oder Vorwissen unterstützt wird. Dies legt nahe, dass das Erkennen relationaler Ähnlichkeit zunächst das Verständnis des Bildes, das Zurückgreifen auf Wissen und die Abstraktion seiner zugrunde liegenden Struktur voraussetzt.“

Die neues Papier ist betitelt Relationale visuelle Ähnlichkeitund verfügt über eine Projekt-Website (Siehe das eingebettete Video am Ende dieses Artikels).

Methodik

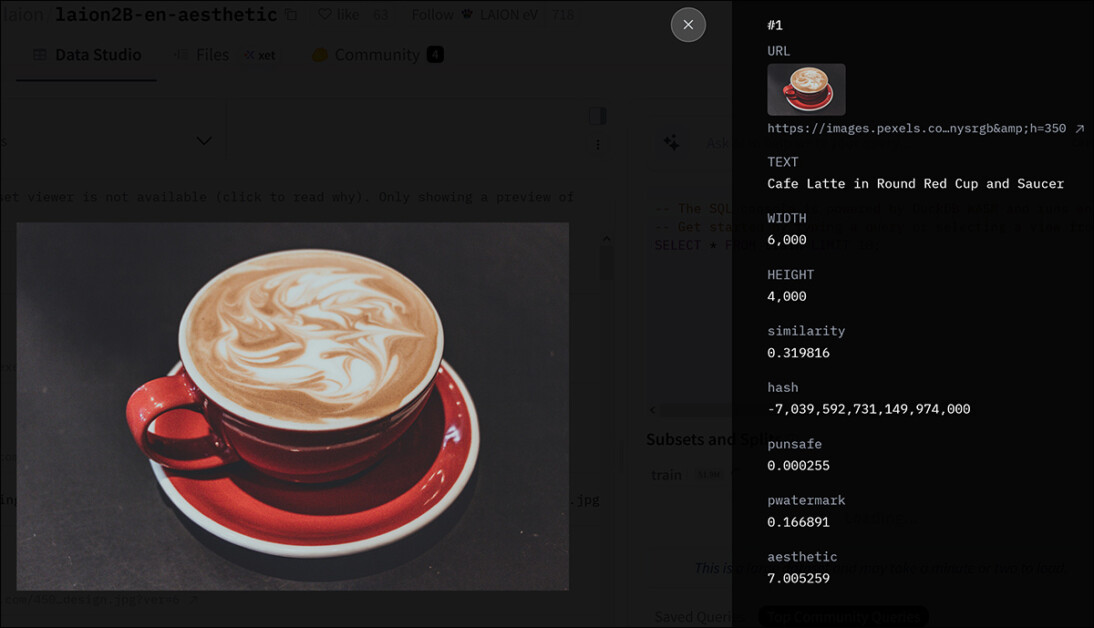

Die Forscher nutzten einen der bekanntesten Hyperscale-Datensätze als Ausgangspunkt für ihre eigene Datensammlung – LAION-2B:

Metadaten für einen Eintrag in der LAION-2B-Sammlung. Quelle

Aus LAION-2B wurden 114,000 Bilder extrahiert, die wahrscheinlich elastische Beziehungsstrukturen enthalten. Dazu wurden die vielen qualitativ minderwertigen Bilder, die in dem minimal kuratierten Datensatz vorhanden sind, herausgefiltert.

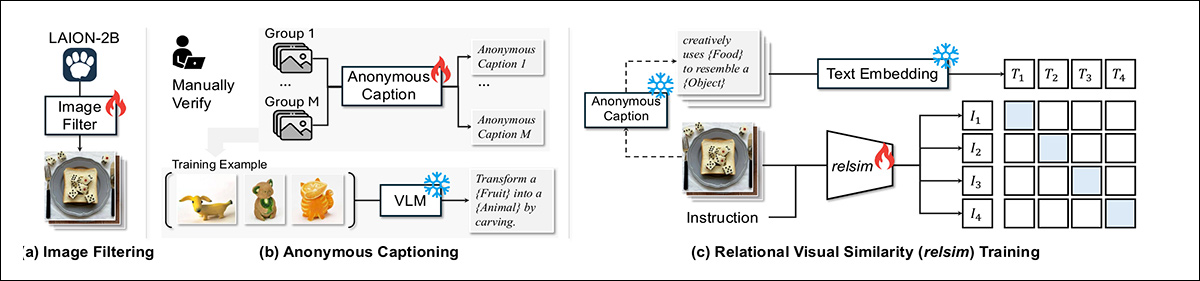

Um einen Ablauf für diesen Auswahlprozess zu erstellen, nutzten die Autoren Qwen2.5-VL-7Bunter Verwendung von 1,300 positiven und 11,000 negativen, von Menschen gekennzeichneten Beispielen:

Das relsim-System wird in drei Schritten trainiert: Filtern von Bildern aus LAION-2B nach relationalen Inhalten; Zuordnen einer gemeinsamen anonymen Bildunterschrift zu jeder Gruppe, die ihre zugrunde liegende Logik erfasst; und Lernen, Bilder mithilfe eines kontrastiven Verlusts diesen Bildunterschriften zuzuordnen.

Das Papier sagt:

Die Annotatoren wurden angewiesen: „Können Sie in diesem Bild relationale Muster, Logik oder Strukturen erkennen, die für die Erstellung oder Verknüpfung mit einem anderen Bild nützlich sein könnten?“ Das feinabgestimmte Modell erzielt eine Übereinstimmung von 93 % mit menschlichen Beurteilungen und liefert bei Anwendung auf LAION-2B N = 114 als relational interessant identifizierte Bilder.

Um relationale Bezeichnungen zu generieren, forderten die Forscher das Qwen-Modell auf, die gemeinsame Logik hinter Bilderserien zu beschreiben, ohne dabei spezifische Objekte zu benennen. Diese Abstraktion war schwierig zu erreichen, wenn das Modell nur ein einziges Bild sah, wurde aber praktikabel, sobald mehrere Beispiele das zugrundeliegende Muster verdeutlichten.

Die so entstandenen Gruppenunterschriften ersetzten spezifische Begriffe durch Platzhalter wie zum Beispiel '{Thema}' or '{Art der Bewegung}'wodurch sie breit anwendbar sind.

Nach manueller Überprüfung wurde jede Bildunterschrift mit allen Bildern ihrer Gruppe verknüpft. Über 500 solcher Gruppen dienten zum Trainieren des Modells, das anschließend auf die 114,000 gefilterten Bilder angewendet wurde, um einen großen Satz abstrakter, relational annotierter Beispiele zu erzeugen.

Daten und Tests

Nach der Extraktion relationaler Merkmale mit Qwen2.5-VL-7B wurde ein Modell anhand der Daten feinabgestimmt. LoRA, für 15,000 Schritte, über acht A100-GPUs*. Für den Text wurden relationale Bildunterschriften eingebettet. All-MiniLM-L6-v2 von der Satztransformatoren-Bibliothek.

Der Datensatz umfasste 114,000 beschriftete Bilder. gespalten Das Modell wurde in 100,000 Trainingsbilder und 14,000 Evaluierungsbilder unterteilt. Zum Testen des Systems wurde ein Retrieval-Setup verwendet: Ausgehend von einem Suchbild musste das Modell aus einem Pool von 28,000 Bildern ein anderes Bild finden, das dieselbe relationale Idee ausdrückte. Der Suchpool umfasste 14,000 Evaluierungsbilder und 14,000 zusätzliche Beispiele aus LAION-2B. Für die Benchmark-Erstellung wurden 1,000 Suchbilder zufällig aus dem Evaluierungsdatensatz ausgewählt.

Zur Bewertung der Abrufqualität GPT-4o wurde verwendet, um die relationale Ähnlichkeit zwischen jeder Anfrage und dem abgerufenen Bild auf einer Skala von 0 bis 10 zu bewerten. Zusätzlich wurde eine separate Studie mit menschlichen Probanden durchgeführt, um die Präferenzen der Nutzer zu ermitteln (siehe unten).

Jedem Teilnehmer wurde ein anonymisiertes Suchbild mit zwei Kandidatenbildern gezeigt: eines, das mit der vorgeschlagenen Methode gefunden wurde, und ein Vergleichsbild. Die Teilnehmer wurden gefragt, welches Bild der Suchabfrage relational ähnlicher war oder ob beide gleich ähnlich waren. Für jedes Vergleichsbild wurden 300 Bildtripletts erstellt und jeweils von mindestens drei Personen bewertet, was etwa 900 Antworten ergab.

Der relsim-Ansatz wurde mit mehreren etablierten Bild-zu-Bild-Ähnlichkeitsmethoden verglichen, darunter die bereits erwähnten LPIPS und DINO, sowie Dreamsimund CLIP-IZusätzlich zu den Basisverfahren, die Ähnlichkeitswerte zwischen Bildpaaren direkt berechnen, wie LPIPS, DINO, dreamsim und CLIP-I, testeten die Autoren auch bildunterschriftenbasierte Methoden, bei denen Qwen verwendet wurde, um für jedes Bild eine anonyme oder abstrakte Bildunterschrift zu generieren; diese diente dann als Suchanfrage.

Es wurden zwei Retrieval-Varianten evaluiert: CLIP-basiertes Text-zu-Bild-Retrieval (CLIP-T) für Text-zu-Bild-Retrieval und Qwen-T für Text-zu-Text-Retrieval. Beide bildunterschriftenbasierten Baselines nutzten das ursprüngliche, vortrainierte Qwen-Modell anstelle der auf relationaler Logik feinabgestimmten Version. Dadurch konnten die Autoren den Effekt des gruppenbasierten Trainings isolieren, da das feinabgestimmte Modell mit Bilddatensätzen und nicht mit einzelnen Beispielen trainiert worden war.

Bestehende Metriken und relationale Ähnlichkeit

Die Autoren testeten zunächst, ob bestehende Metriken die relationale Ähnlichkeit erfassen können:

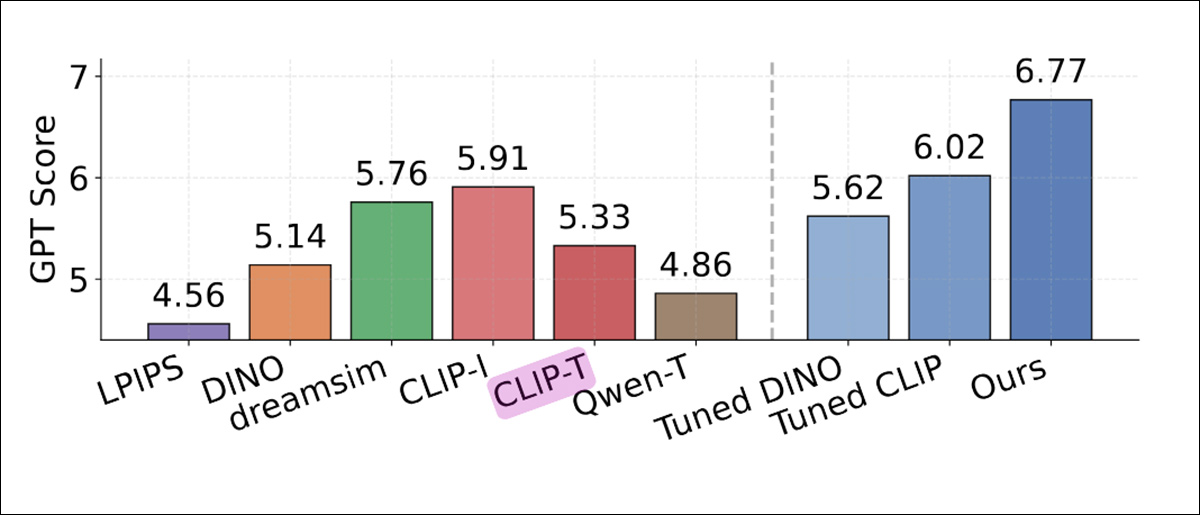

Vergleich der Retrieval-Leistung, bewertet mit GPT-4o, mit Angabe des durchschnittlichen relationalen Ähnlichkeitswerts für jede Methode. Herkömmliche Ähnlichkeitsmetriken wie LPIPS, DINO und CLIP-I schnitten schlechter ab. Auch die auf Bildunterschriften basierenden Vergleichsmethoden Qwen-T und CLIP-T erzielten geringere Ergebnisse. Den höchsten Wert erreichte relsim (6.77, rechte blaue Spalte), was darauf hindeutet, dass die Feinabstimmung gruppenbasierter Beziehungsmuster die Übereinstimmung mit den Bewertungen von GPT-4o verbesserte.

Zu diesen Ergebnissen erklären die Autoren:

LPIPS, das sich ausschließlich auf die wahrgenommene Ähnlichkeit konzentriert, erzielt den niedrigsten Wert (4.56). DINO schneidet nur geringfügig besser ab (5.14), vermutlich weil es ausschließlich selbstüberwacht mit Bilddaten trainiert wurde. CLIP-I liefert unter den Vergleichsmodellen die besten Ergebnisse (5.91), vermutlich weil Bildunterschriften mitunter Abstraktionen enthalten.

„Allerdings schneidet CLIP-I im Vergleich zu unserer Methode weiterhin schlechter ab, da für eine bessere Bewertung möglicherweise die Fähigkeit erforderlich ist, noch höhere Abstraktionsebenen zu erreichen, wie sie beispielsweise in anonymen Bildunterschriften vorkommen.“

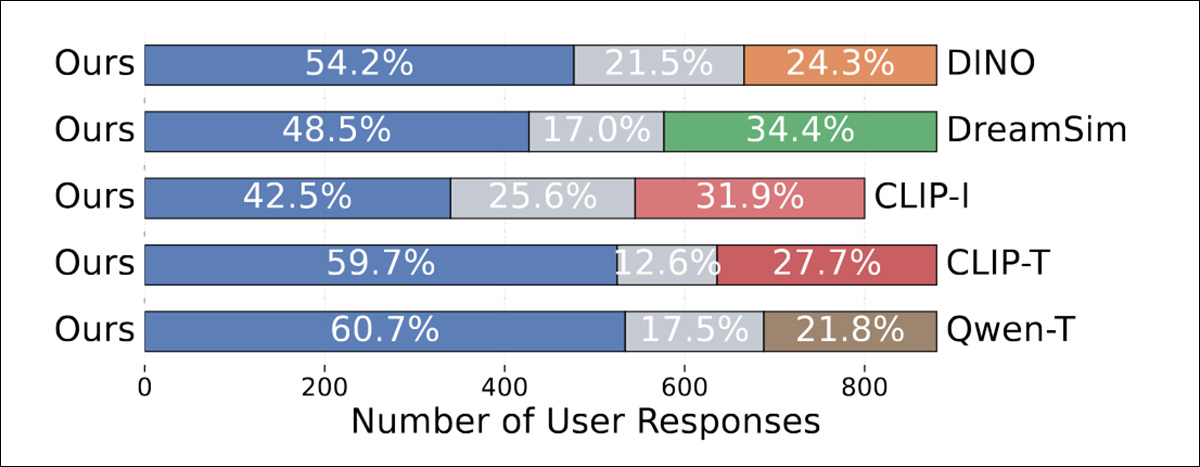

In der Nutzerstudie bevorzugten die Probanden in allen Vergleichsvarianten durchweg die relsim-Methode:

Die von GPT-4o für jede Methode vergebenen Werte für relationale Ähnlichkeit wurden ermittelt. Standardmäßige Ähnlichkeitsmetriken wie LPIPS, DINO und CLIP-I schnitten schlechter ab, und die auf Bildunterschriften basierenden Varianten Qwen-T und CLIP-T erzielten nur geringfügig bessere Ergebnisse. Selbst optimierte Versionen von DINO und CLIP konnten die Lücke nicht schließen. Den höchsten Wert von 6.77 erreichte das mit gruppenbasierter Überwachung trainierte Modell relsim.

Die Autoren bemerken:

„Das ist sehr ermutigend, denn es zeigt nicht nur, dass unser Modell …“ relsimkann relational ähnliche Bilder erfolgreich abrufen und bestätigt damit erneut, dass Menschen relationale Ähnlichkeit wahrnehmen – und nicht nur Attributähnlichkeit!

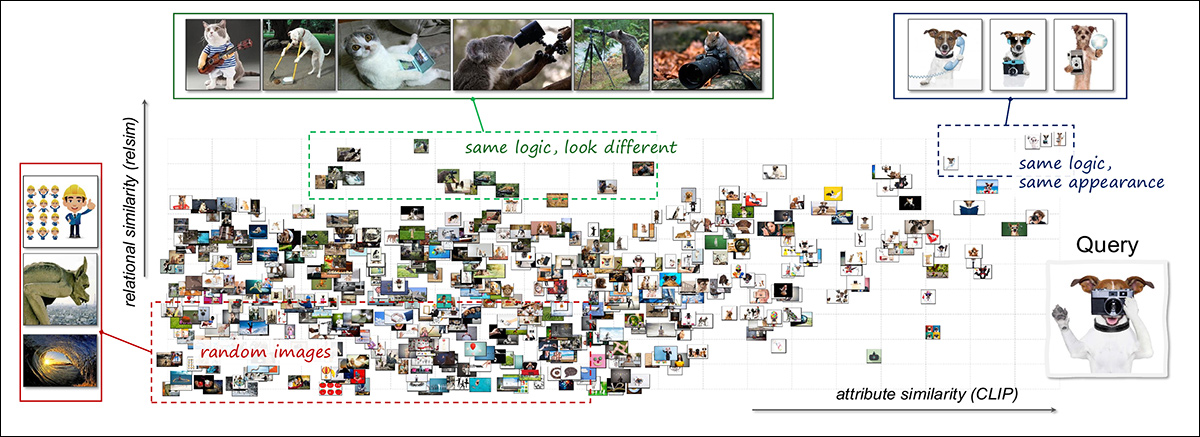

Um zu untersuchen, wie sich relationale und attributive Ähnlichkeit ergänzen könnten, verwendeten die Forscher eine kombinierte Visualisierungsmethode. Ein einzelnes Abfragebild ('Ein Hund, der eine Kamera hält') wurde mit 3,000 zufällig ausgewählten Bildern verglichen, und die Ähnlichkeit wurde mithilfe von relationalen und attributbasierten Modellen berechnet:

Gemeinsame Visualisierung des visuellen Ähnlichkeitsraums mithilfe relationaler und attributiver Achsen. Ein einzelnes Suchbild, das einen Hund mit einer Kamera zeigt, wurde mit 3,000 anderen verglichen. Die Ergebnisse wurden nach relationaler Ähnlichkeit (vertikal) und attributiver Ähnlichkeit (horizontal) geordnet. Der Bereich oben rechts enthält Bilder, die dem Suchbild sowohl inhaltlich als auch optisch ähneln, beispielsweise andere Hunde mit Werkzeugen. Der Bereich oben links enthält semantisch verwandte, aber visuell unterschiedliche Fälle, wie etwa verschiedene Tiere, die kamerabezogene Aktionen ausführen. Die meisten übrigen Beispiele gruppieren sich weiter unten im Raum und spiegeln eine geringere Ähnlichkeit wider. Die Darstellung veranschaulicht, wie relationale und attributive Modelle komplementäre Aspekte visueller Daten hervorheben. Für eine detailliertere Darstellung verweisen wir auf die Originalveröffentlichung.

Die Ergebnisse offenbarten Cluster, die verschiedenen Arten von Ähnlichkeit entsprachen: Einige Bilder waren sowohl relational als auch visuell ähnlich, wie zum Beispiel andere Hunde in menschenähnlichen Posen; andere teilten relationale Logik, aber kein Aussehen, wie zum Beispiel verschiedene Tiere, die menschliche Handlungen nachahmten; der Rest zeigte keines von beidem.

Diese Analyse legt nahe, dass die beiden Ähnlichkeitstypen unterschiedliche Rollen erfüllen und in Kombination eine reichhaltigere Struktur ergeben.

Anwendungsfälle

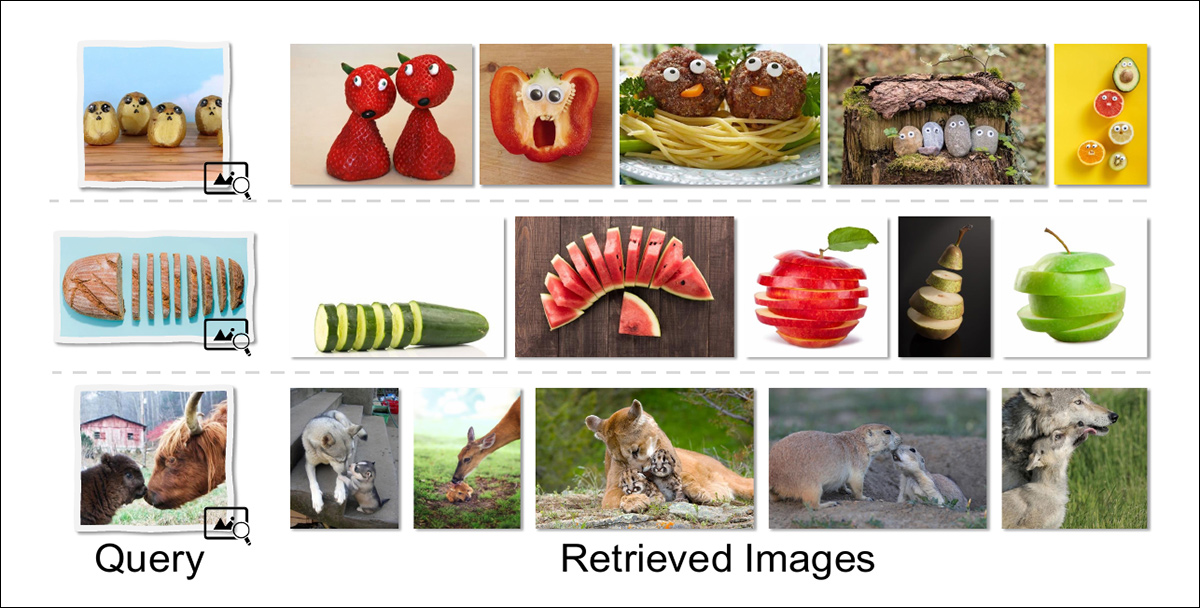

Die Arbeit untersucht außerdem einige mögliche Anwendungsfälle für relationale Ähnlichkeit, darunter relationale BildsucheDies ermöglicht eine Bildersuche, die besser mit der kreativen Art und Weise übereinstimmt, wie Menschen die Welt betrachten:

Die relationale Suche liefert Bilder, die eine tiefere konzeptuelle Struktur mit der Suchanfrage teilen, anstatt nur oberflächliche Merkmale abzugleichen. Beispielsweise liefert ein Lebensmittel, das einem Gesicht ähnelt, weitere anthropomorphe Gerichte; ein geschnittenes Objekt liefert weitere geschnittene Formen; und Szenen der Interaktion zwischen Erwachsenen und Jungtieren liefern Bilder mit ähnlichen relationalen Rollen, selbst wenn sich Arten und Zusammensetzung unterscheiden.

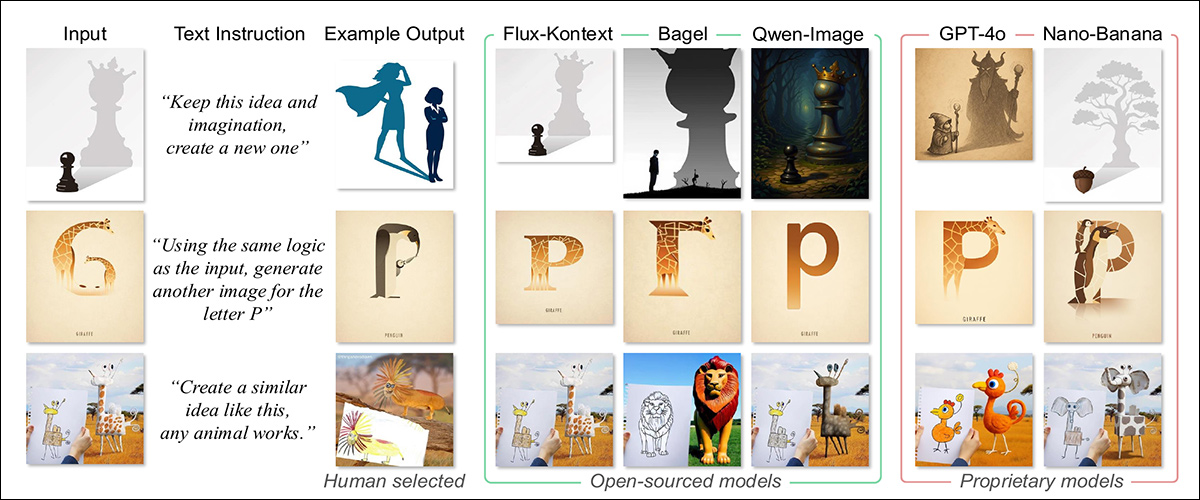

Eine andere Möglichkeit ist analoge BilderzeugungDies würde die Synthese von Anfragen ermöglichen, die relationale Strukturen anstelle direkter Beschreibungen verwenden. Ein Vergleich der Ergebnisse aktueller Text-zu-Bild-Modelle zeigt, dass die Ergebnisse eines solchen Ansatzes wahrscheinlich vielfältiger ausfallen werden.

Anhand eines Eingabebildes und einer relationalen Vorgabe sollten Modelle ein neues Bild generieren, das dasselbe zugrundeliegende Konzept ausdrückt. Proprietäre Modelle erzeugten präzisere Analogien und bewahrten die strukturelle Logik trotz großer Formänderungen, während Open-Source-Modelle eher zu wörtlichen oder stilistischen Entsprechungen neigten und die tiefere Idee nicht vermitteln konnten. Die Ergebnisse wurden mit von Menschen erstellten Analogien verglichen, die die beabsichtigte Transformation veranschaulichten.

Fazit

Generative KI-Systeme würden, so scheint es, durch die Fähigkeit, abstrakte Repräsentationen in ihre Konzeptualisierungen einzubeziehen, deutlich verbessert. Derzeit liefert die Anfrage nach konzeptbasierten Bildern wie „Wut“ oder „Freude“ tendenziell Bilder, die den beliebtesten oder am häufigsten vorkommenden Bildern mit diesen Assoziationen im Datensatz nachempfunden sind; was Auswendiglernen eher als Abstraktion.

Vermutlich wäre dieses Prinzip noch vorteilhafter, wenn es auf generatives Schreiben angewendet werden könnte – insbesondere auf analytische, spekulative oder fiktionale Texte.

Zum Abspielen drücken. Quelle

* Ein A100 kann über 40 GB oder 80 GB VRAM verfügen; dies wird in der Veröffentlichung nicht spezifiziert.

** Die Zitate der Autoren sind redundant und wurden daher nicht berücksichtigt.

Erstveröffentlichung Dienstag, 16. Dezember 2025