Andersons Blickwinkel

KI-generierte Texte ermüden nie und zeigen sich damit

ChatGPT-ähnliche KI gibt sich durch zunehmende Konsistenz zu erkennen, während menschliches Schreiben das ganze Durchgang hindurch unregelmäßig bleibt.

Die begrenzte Kontextfenster der meisten verbraucherorientierten Large Language Models (LLMs) ist einer der Faktoren, die sie dazu bringen können, frühere Teile von Benutzerkonversationen zu vergessen oder falsch wiederzugeben – Erinnerungsfehler, die allmählich dazu führen können, dass die Ausgabe in völligen Unsinn ausartet – oder, schlimmer noch, in deceptiv kohärent aussehenden Texten, die subtile Fehler enthalten.

Da diese Umstände zu Halluzinationen führen und da Halluzinationen immer noch das größte Hindernis für den totalen Marktvorstoß von KI sind, wurde viel Forschungsarbeit in die Entwicklung generativer KI-Systeme investiert, die konsistentere und längere Textpassagen erstellen können.

Tatsächlich wird so viel Fortschritt erzielt, dass die Erkennung von KI-generierten Inhalten (d. h. Inhalten, die rein von KI generiert werden, mit – vermutlich – minimaler oder keiner menschlicher Nachbearbeitung) als wachsendes Problem betrachtet wird.

Enttarnung einer KI-Rede

Trotzdem behaupten aktuelle empirische Studien , dass es desto einfacher ist, zu bestimmen, ob ein Text von einem Menschen oder einer KI generiert wurde, je mehr Ausgabe die KI-Textgeneratoren in einem Durchgang produzieren; aber die allgemein anerkannte Weisheit in Bezug auf diese Erkennung “Anker” hat angenommen, dass KI zu erkennen ist, weil was auch immer sie anders als Menschen macht, sie die Chance hat, öfter in längeren Passagen zu tun.

Es werden keine Annahmen über die Verteilung dieser “Merkmale” im Text selbst gemacht.

Um dies herauszufordern und das Problem zu erweitern, bietet eine interessante aktuelle Forschungsstudie aus China eine neue Methode, um die neue Generation von KI-generierten Inhalten von echten menschlichen Autoren zu unterscheiden. Die Forscher hinter der Arbeit behaupten, dass die Token-für-Token-Natur, mit der KI-Text generiert wird, dazu führt, dass er mit zunehmender Länge konsistenter wird, während die Eigenheiten der Menschen nicht mit der Länge abnehmen.

Auf diese Weise schlagen die Autoren vor, dass ihre Erkenntnis ein potenzielles neues Maß für KI-Text-Erkennungssysteme bietet*:

‘KI-generierte Token im letzten Teil des Textes zeigen kleinere und stabilere Wahrscheinlichkeitsfluktuationen, da die Vorhersagen des Modells mit zunehmendem Kontext konsistenter werden.

‘Wir bezeichnen dieses Muster als Späte Volatilitätsabnahme. Dieses Phänomen spiegelt das inhärente Verhalten der autoregressiven Generierung wider: Wenn mehr Kontext verfügbar wird, schärft sich die Vorhersageverteilung des Modells, was zu einer verringerten Variabilität in den Token-Statistiken führt.

‘Menschliches Schreiben hingegen führt weiterhin unerwartete lexikalische Auswahlmöglichkeiten ein und behält eine höhere Volatilität aufrecht.’

Um diese seltsame “Glattheit”, die in KI-Texten gegen Ende auftritt, zu erfassen, definieren die Forscher zwei einfache Merkmale: Das erste misst, wie sehr das statistische Verhalten des Schreibens “herumhüpft” zwischen Token; das zweite überprüft, wie stabil die Dinge in kurzen Textpassagen bleiben.

Beide werden nur aus der zweiten Hälfte der Ausgabe berechnet, wo KI deutlich regelmäßiger wird und menschliches Schreiben nicht. Die Autoren bemerken, dass diese Signale gut funktionieren, wenn sie mit älteren Erkennungsmethoden kombiniert werden, die nach umfassenderen Mustern suchen. Sie bemerken auch, dass dieser Ansatz am besten auf längere Texte funktioniert, wo der Kontrast deutlicher werden kann.

Die neue Studie bietet eine Methodik zur Überprüfung von “KI-ähnlichkeit” über die Analyse von temporalen Merkmalen in der zweiten Hälfte, ohne zusätzliches Training oder Feintuning oder privilegierten Modellzugriff.

Die neue Arbeit trägt den Titel Wenn KI sich niederlässt: Späte Stabilität als Signatur der KI-generierten Texterkennung und stammt von vier Autoren der Westlake-Universität in Hangzhou.

Methode

Um die zunehmende Glattheit in KI-generierten Texten zu erfassen, entwarfen die Forscher zwei Messungen, die sich nur auf die zweite Hälfte eines Textes konzentrieren. Diese basieren auf Log-Wahrscheinlichkeitswerten von einem Standard-Sprachmodell und erfordern kein Feintuning, keine Neuschulung oder zusätzliche Proben:

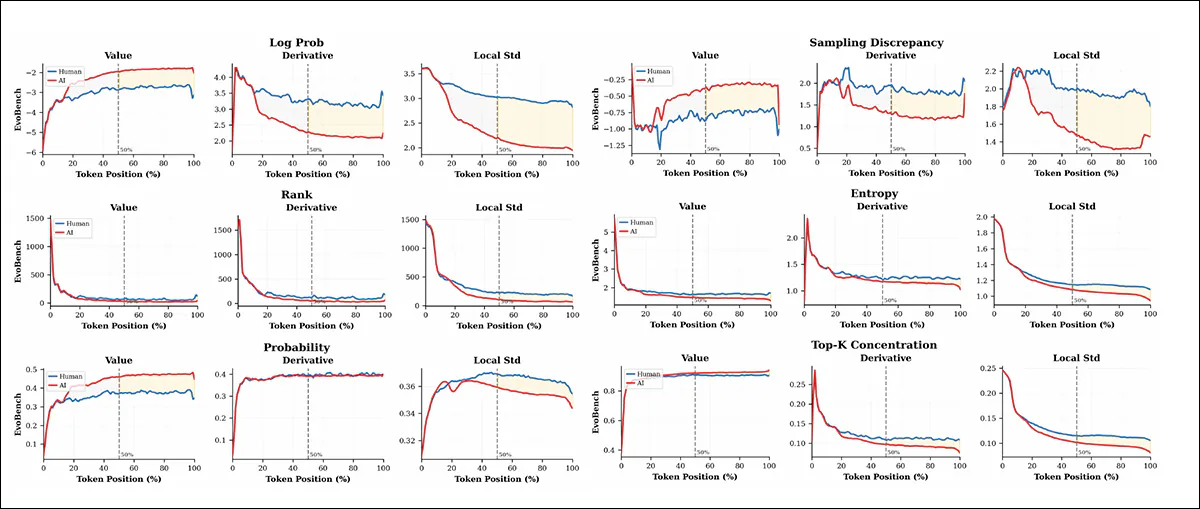

Aus der neuen Studie – jede Zeile zeigt das Verhalten einer Basismetrik von EvoBench über die Token-Sequenz: Rohwert (links), absoluter Ableitungswert (Mitte) und lokale Standardabweichung (rechts). Human- und KI-Linien sind in Blau und Rot dargestellt. Die meisten Abweichungen treten in der zweiten Hälfte des Textes auf, insbesondere für Log-Wahrscheinlichkeit und Stichproben-Unterschied, die eine zunehmende Trennung und eine glattere KI-Ausgabe zeigen. Entropie und Top-K-Konzentration zeigen wenig Änderung über die Zeit. Quelle

Die erste Messung, genannt Ableitungs-Dispersion (DD), verfolgt, wie scharf die Zuversicht des Modells von einem Wort zum nächsten wechselt. KI-Text neigt dazu, in einen Rhythmus zu fallen, sodass diese Änderungen kleiner und vorhersehbarer in der zweiten Hälfte werden. Im Gegensatz dazu bleibt menschliches Schreiben “uneben”.

Die zweite Messung, Lokale Volatilität (LV), untersucht, wie sehr die Zuversicht des Modells “herumhüpft” innerhalb eines kleinen Textfensters. Wiederum neigt KI dazu, im Laufe der Zeit stabiler zu werden, während menschliche Auswahlmöglichkeiten überraschender und weniger konsistent bleiben:

KI-Text wird glatter, während menschliches Schreiben uneben bleibt. Diese Grafiken verfolgen, wie die Zuversicht des Modells über den Verlauf eines Textes wechselt, wobei sowohl die Schärfe der Änderung zwischen aufeinanderfolgenden Wörtern als auch die Menge der Variation innerhalb lokaler Textpassagen berücksichtigt werden. In beiden Aspekten ist der Rückgang viel steiler in maschinengenerierten Ausgaben, wobei der Kontrast besonders nach dem Mittelpunkt deutlich wird. Die gelben Kästchen heben diese wachsende Lücke in der zweiten Hälfte hervor, wo KI-Schreiben bis zu 32 % mehr Stabilität als menschliches Schreiben erreicht.

Sowohl die Messungen werden nur aus der zweiten Hälfte des Textes berechnet, wo der Unterschied zwischen menschlichem und maschinengeneriertem Schreiben am deutlichsten ist. Diese werden dann in einen einzigen Wert namens Temporale Stabilitätserkennung (TSD) integriert – der anfällig ist, zu steigen, wenn das Schreiben “glatter” (und daher wahrscheinlicher maschinengeneriert) wird. Ein einfacher Schwellenwert wird dann verwendet, um zu entscheiden, ob ein bestimmter Text wahrscheinlich von einer Maschine geschrieben wurde.

Da diese Merkmale sich auf wann ein Muster auftritt konzentrieren, anstatt nur darauf, wie das Muster aussieht, werden sie durch ältere Methoden ergänzt, die statistische Anomalien im gesamten Text suchen. Die Hinzufügung des TSD-Werts zur Ausgabe des Fast-DetectGPT-Angebots von Ende 2024 (auch in Zusammenarbeit mit Westlake) bietet eine weitere Verbesserung der Ergebnisse (insbesondere für lange Inhalte, bei denen der Effekt der späten Glättung am stärksten ist).

Daten und Tests

Die Autoren führten Tests auf zwei verwandten Benchmark-Datensätzen durch: EvoBench enthält 32.000 menschliche/KI-Textpaare, die über sieben Modellfamilien generiert wurden, einschließlich GPT-4; GPT-4o; Claude; Google Gemini; LLaMA-3; und Qwen, mit insgesamt 29 Modellversionen.

Das andere Framework war MAGE, das 30.000 Testpaare über acht Modellfamilien anbietet, einschließlich (aber nicht beschränkt auf) der GPT-Serie von OpenAI und der LLaMA-, OPT– und FLAN-T5-Familien.

Konkurrenten

Die neue Methode wurde gegen eine Reihe von Zero-Shot-Detektoren getestet, die den gleichen Surrogat-Modell verwenden. Wahrscheinlichkeit, Entropie, Rang und Log-Rang (DetectGPT) messen Token-Statistiken über den gesamten Text; LLR (DetectLLM) wendet Normalisierung an, um direkten Vergleich zwischen Modellen zu ermöglichen; und Fast-Detect schätzt lokale Krümmung durch stichprobenbasierte Störungen.

Lastde analysiert diskriminative Subsequenzen im Wahrscheinlichkeitssignal, während FourierGPT im Frequenzbereich operiert. Diveye erfasst Änderungen in der “Überraschung”-Vielfalt über die Sequenz.

Schließlich bewertet UCE das Unsicherheitsprofil von Token-Vorhersagen, um unnatürliche Zuverlässigkeitsmuster zu identifizieren.

Implementierung und Ergebnisse

Alle Erkennungsmethoden wurden unter Verwendung von Llama-3-8B-Instruct als gemeinsamem Surrogat-Modell durchgeführt, wobei die Eingabesequenzen auf 512 Token beschränkt waren. Temporale Merkmale wurden nur aus der zweiten Hälfte jedes Textes extrahiert, unter Verwendung eines gleitenden Fensters von 20 Token, um die Volatilität zu messen. Eine kombinierte Version der Methode, genannt TSD+, kombinierte das vorgeschlagene Signal mit Fast-DetectGPT.

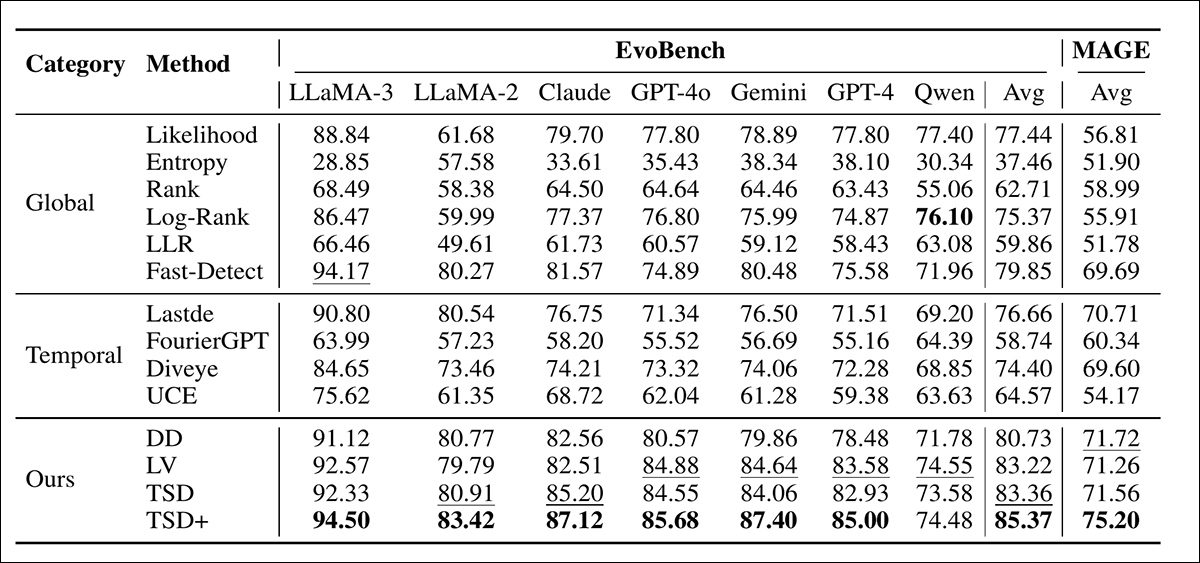

Der Bereich unter der Receiver-Operating-Characteristic-Kurve (AUROC) war die primäre Bewertungsmetrik†:

Vielfältige Leistung unter den verschiedenen getesteten Methoden gegenüber KI-generierten Texten. Die Erkennungsgenauigkeit wird über zwei Benchmark-Datensätze dargestellt: EvoBench, der mehrere bekannte LLMs abdeckt, und MAGE, ein komplementärer Datensatz. Metriken sind nach Methode gruppiert: globale Statistiken, temporale Merkmale und vorgeschlagene Varianten. Durchschnittliche AUROC-Werte werden in den letzten Spalten angegeben. Die Ergebnisse der Varianten der Autoren überbieten konsistent die vorherigen Baselines, wobei TSD+ die höchsten Werte in fast jedem Modellsetting erzielt.

Von diesen anfänglichen Ergebnissen sagen die Autoren:

‘Unsere einfachen temporalen Merkmale erreichen eine Leistung auf dem Stand der Technik unter den eigenständigen Methoden, wobei TSD 83,36 % auf EvoBench und 71,56 % auf MAGE erzielt, was alle Baselines, einschließlich Fast-DetectGPT, übertrifft.

‘Dies ist bemerkenswert, wenn man bedenkt, dass unsere Methode einfach ist: Wir berechnen nur zweite Ordnungsstatistiken aus der zweiten Hälfte der Sequenzen, ohne Störproben oder Frequenzbereichstransformationen.’

Die neue Methode funktionierte besonders gut auf neuen KI-Modellen wie GPT-4 und GPT-4o, wobei KI-generierte Texte genauer identifiziert wurden als der nächste führende Detektor, mit einer Leistungsunterschied von bis zu 9,66 %. Obwohl neuere, fortschrittlichere Modelle weniger offensichtlich “konsistente” Texte produzieren, die einige Anzeichen von Automatisierung verbergen, sind bestimmte subtile Zeitmuster immer noch gegen Ende erkennbar.

Konkurrierende Ansätze, die sich auf breite Strukturmerkmale konzentrieren, versäumten es, diese späten Muster zu erfassen. Durch die Integration eines globalen Detektors scheint das Hybrid-System diese verpassten Signale wiederzuerlangen und die Leistung zu verbessern, insbesondere auf Benchmark-Datensätzen, bei denen kürzere KI-Ausgaben die temporalen Hinweise schwächen können.

Schlussfolgerung

Ein Aspekt, der in der neuen Arbeit nicht direkt angesprochen wird, ist die Tendenz von menschlichen Schreibern, ihre Arbeit durch Entwürfe und verschiedene Schichten von Überwachung zu iterieren – manchmal einschließlich externer Überwachung, wie z. B. der Eingabe von Redakteuren und Korrektoren, sowie möglicher Vorschläge von Rechtsabteilungen, je nach Kontext.

Die vielen an einem Dokument beteiligten Interessengruppen, wie z. B. einer gut vergrabenen Zeitungsartikel, können alle Eigenheiten, auf die das neue vorgeschlagene System abzielt, praktisch auslöschen und sich in einer Art “analoger Version” eines KI-gestützten Entwurfsprozesses äußern.

Darüber hinaus haben die untersuchten Systeme selbst auf derartigen Werken trainiert, und – da Trainingsdaten zunehmend nach Autorität bei der Trainingszeit gewichtet werden – können die “gewichtigsten” oder angesehensten Quellen diejenigen sein, die am wenigsten “natürlich” sind; zumindest im Vergleich zu jemandem, der schnell eine informelle E-Mail an einen Kollegen verfasst, anstatt einen Jahresbericht für eine Hauptversammlung zusammenzustellen.

Eine weitere und kontrastierende Überlegung ist, dass Textinhalte, an denen mehrere Personen mitgewirkt haben, auch zu den fragmentiertesten, fehlerhaftesten und wiederholten Stücken von Prosa gehören können, die in einen Datensatz eingehen, da sie oft nicht den Vorteil einer endgültigen einheitlichen Stimme hatten, was die stückweise Natur ihrer Entwicklung im Text offensichtlich macht.

* Originaltext-Stil der Autoren aus dem Papier; nicht meine Betonungen.

† Die Autoren sagen “primär”, während sie keine anderen Bewertungsmetriken auflisten.

Erstveröffentlicht am Montag, den 26. Januar 2026