Andersons Blickwinkel

Sprachmodellen einen „Wahrheitsregler“ geben

Wahrheitsgemäß oder gesprächig: Sie haben die Wahl. Eine neue Trainingsmethode ermöglicht es Nutzern, KI-Chatbots genau vorzugeben, wie „faktenbasiert“ sie sein sollen, und macht die Genauigkeit so zu einem Regler, den man nach Belieben erhöhen oder verringern kann.

Eine neue Forschungskooperation zwischen den USA und China bietet etwas, das nahezu alle Nutzer von KI-Chatbots begrüßen würden: einen virtuellen „Regler“, mit dem der Bot festlegen kann, ob er „gesprächig“ oder „wahrheitsgemäß“ sein soll.

Das System wurde erstellt von Feintuning a Mistral-7B Modell auf synthetische DatenSo konnte das Schema einer „Wahrheitsskala“ im Modell verankert werden. Nach dieser Überarbeitung kann das Mistral-Modell die Anzahl der Fakten in einer Antwort steuern; je höher der vom Benutzer angegebene „Wahrheitswert“, desto weniger – aber dafür sicherer – werden die Fakten sein. kürzere Antwort.

Bei niedrigeren Einstellungen wird die Antwort des Chatbots, wie die Autoren der Studie es nennen, „informativ“, d. h. sie ist länger und enthält mehr Fakten; einige dieser Fakten können jedoch … halluziniert.

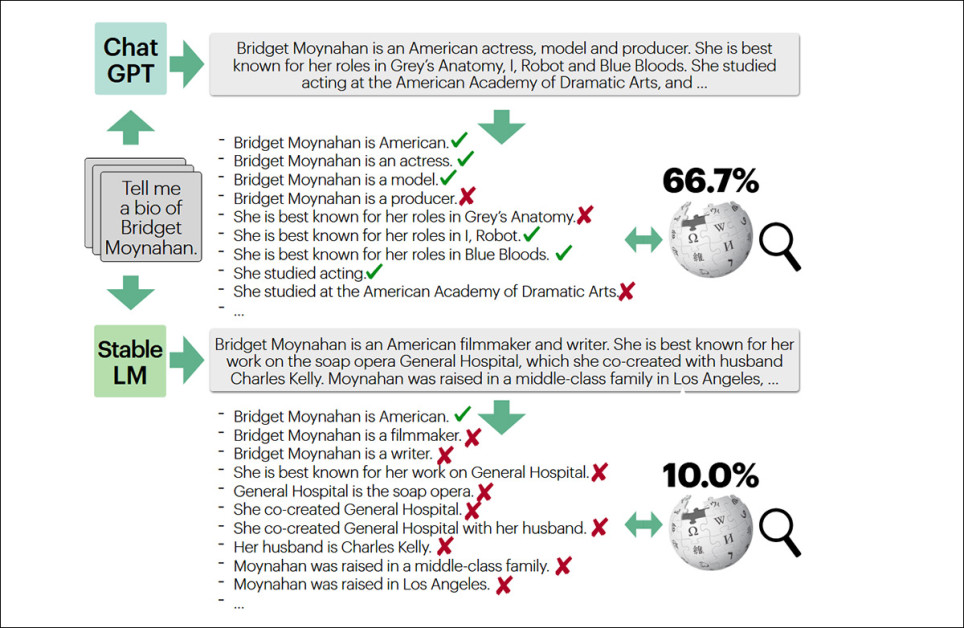

Die synthetischen Daten, mit denen das System trainiert wurde, nutzten Wikipedia als Referenz für einen Testbereich: reale biografische Fakten über Personen. Unabhängig davon, ob man Wikipedia als autoritative Quelle ansieht oder nicht, liegt der Wert der Arbeit in der Entwicklung von für Ein System, das die natürlichen Grenzen von LLMs einschränken kann Zwang, Antworten zu gebenauch dann, wenn es keine Antworten geben kann.

Ein Beispiel aus dem FactScore-Projekt, das die Zusammenstellung des Datensatzes für die hier besprochene Arbeit ermöglichte, wobei Wikipedia als Referenzquelle für biografische Details verwendet wurde. Quelle

Die Autoren weisen darauf hin, dass in Kontexten mit hohem Sicherheitsbedarf, wie etwa im medizinischen und juristischen Bereich, konservative und verlässlich faktische Ergebnisse erforderlich sind, während viele andere Benutzergruppen eher flexible und kreative, interpretative Ergebnisse benötigen (z. B. diskursives Schreiben und akademische Analysen).

Sie beobachten*:

'[Die aktuellen] LLMs bieten keinen eingebauten Mechanismus, um diesen Zielkonflikt zu kontrollieren.

„Obwohl Benutzer versuchen können, das Verhalten des Modells mit Aufforderungen wie ‚Seien Sie sachlicher‘ zu lenken, stellen wir fest, dass Frontier-Modelle ihre Ausgaben bei dieser Aufgabe nicht zuverlässig an solche Aufforderungen anpassen.“

'An FactScoreWir stellen fest, dass Standardmodelle oft selbst moderate bis strenge Anforderungen nicht erfüllen. Diese Diskrepanz motiviert eine steuerbare Alternative, die es Nutzern ermöglicht, ein bestimmtes Maß an Faktentreue anzufordern und das Modell seine Antworten entsprechend anpassen zu lassen.

Nur die Fakten

Um die Arbeit und die darin vorgeschlagenen Lösungsansätze zu verstehen, ist es notwendig, die eigene Definition von „Informationsgehalt“ zu überdenken. Die Autoren geben an, dass die Quantifizierung eines informativ Antwort gleich „Die Menge des unterstützten Inhalts in der Ausgabe, gemessen als Anzahl der validierten atomaren Anweisungen, normalisiert auf die Ausgabelänge.“.

An anderer Stelle im Artikel wird einfacher formuliert, dass Informationsgehalt 'die Gesamtzahl der atomaren Fakten in der Ausgabe, unabhängig davon, ob sie korrekt sind oder nicht'.

Die Forscher weisen außerdem darauf hin, dass die Tendenz von LLMs, zwischen faktischer Richtigkeit und subjektiven Vermutungen zu schwanken, eine sehr menschliche Eigenschaft ist, die durch diverse wissenschaftliche Studien belegt ist*:

Das Wissen von Hochschulabsolventen ist uneinheitlich zuverlässig: Manche Aussagen sind gut belegt, andere hingegen spekulativ, veraltet oder unsicher. Daher muss bei der Wissensgenerierung entschieden werden, wie viel und wie vorsichtig man es formuliert, wodurch ein Spannungsverhältnis zwischen faktischer Genauigkeit und Informationsgehalt entsteht.

„Menschen treffen analoge Entscheidungen: Sie beginnen mit hochzuverlässigen Fakten und Hinzufügen geringere Gewissheit Details nur auf Anfrage.

Obwohl die Experimente nur am mittelgroßen Mistral-Modell durchgeführt wurden, sollten die angewandten Prinzipien auf verschiedene Maßstäbe und Plattformen übertragbar sein, da es sich um ein neuartiges Verfahren handelt. Quantifizierung Daten, als Ergänzung zum internen Schema eines LLM; und eine solche Änderung ist nicht architekturspezifisch.

Die neues Papier ist betitelt Faktentreue auf Abruf: Die Kontrolle des Zielkonflikts zwischen Faktentreue und Informationsgehalt bei der Textgenerierungund stammt von sieben Forschern der Columbia University, der New York University und der NYU Shanghai.

Methode und Daten

Der in dem Artikel vorgestellte neue Ansatz wird als Faktizitätskontrollierte Generation (FCG) und führt einen virtuellen Drehregler ein, mit dem Benutzer festlegen können, wie genau die Antwort eines Chatbots sein soll. 'Im Wesentlichen,' In dem Artikel heißt es: „FCG verbessert das Modell mit einem steuerbaren „Regler“ für Faktentreue.“.

Das Modell berücksichtigt sowohl eine Benutzerfrage als auch den gewünschten Faktizitätsgrad und generiert dann eine Antwort, die nur Informationen enthält, die es für ausreichend zuverlässig hält, wobei es gleichzeitig versucht, innerhalb dieser Vertrauensbeschränkung so detailliert wie möglich zu sein.

Mithilfe des (oben verlinkten) FactScore-Systems wird die segmentierte Ausgabe von Beispielabfragen auf Genauigkeit hin bewertet, eine Qualitätsdefinition wie folgt: Einhaltung der Fakten:

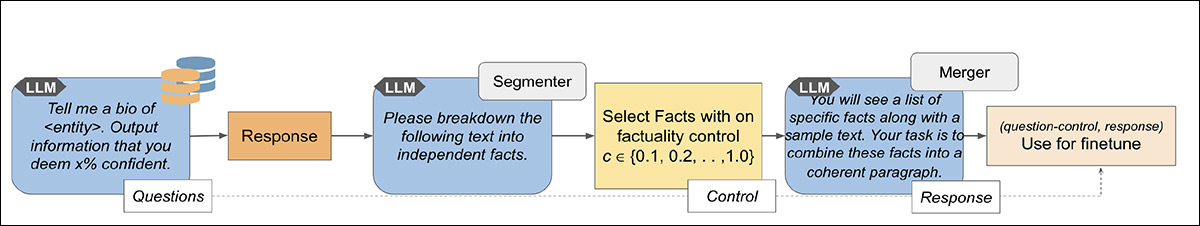

Trainingsdatenpipeline für FCG: Ein Sprachmodell generiert eine erste Antwort, zerlegt diese in atomare Fakten, ordnet sie nach ihrer Zuverlässigkeit und verwirft die am wenigsten zuverlässigen Fakten, bis der gewünschte Wahrheitsgrad erreicht ist. Quelle

Da kein existierender Datensatz den Anforderungen von FCG entsprach, erstellten die Autoren einen synthetischen Datensatz mithilfe des GPT-4.† Das Sprachmodell generiert zunächst eine unbeschränkte Antwort und entfernt dann die Fakten mit der geringsten Zuverlässigkeit, bis die Antwort ein vorgegebenes Genauigkeitsniveau erreicht.

Frühere Arbeiten legten nahe, dass ein Training nur auf Bodenwahrheit frustrierten könnte tatsächlich Modelle herstellen weniger sachlichIndem man sie davon abhielt, überhaupt zusätzliche Details preiszugeben, wurden die FCG-Trainingsbeispiele nur minimal bearbeitet, wobei die ursprüngliche Ausdrucksweise und der Rhythmus des Modells beibehalten, aber gerade so weit gekürzt wurden, dass das erforderliche Zielvertrauen erreicht wurde.

Durch die Anwendung dieses Bearbeitungsprozesses auf eine Reihe von Ziel-Konfidenzniveaus, von 10 % bis zu einer strikten Schwelle von 100 %, wurde ein synthetischer Datensatz erstellt, in dem jede Frage mit mehreren gefilterten Antworten gepaart wurde.

In jeder Version wurden nur diejenigen Fakten beibehalten, die vom Modell als ausreichend zuverlässig eingestuft wurden, um den geforderten Grad an Faktentreue zu erreichen; diese Beispiele wurden dann als Trainingsdaten für die überwachte Feinabstimmung verwendet.

Der endgültige Datensatz umfasste 3,302 (Frage, Smartgeräte App, Antwort) Dreier für das Training und 396 für Validierungsprüfungen, erstellt aus 500 Entitäten, aufgeteilt in 450 für das Training und 50 für die Entwicklung. Zusätzlich wurden 183 verschiedene Entitäten zum Testen verwendet.

Schulungen und Tests

Die Autoren haben die Feinabstimmung vorgenommen. Mistral-7B-Instruct-v0.2 LLM Modell bei verschiedenen Lernraten (3e-6, 1e-5, 3e-5), um zum optimalen (nicht genannten) LR zu gelangen, für 30 Epochen, an einer Losgröße von 256 (nb Die Trainingshardware wird nicht spezifiziert.

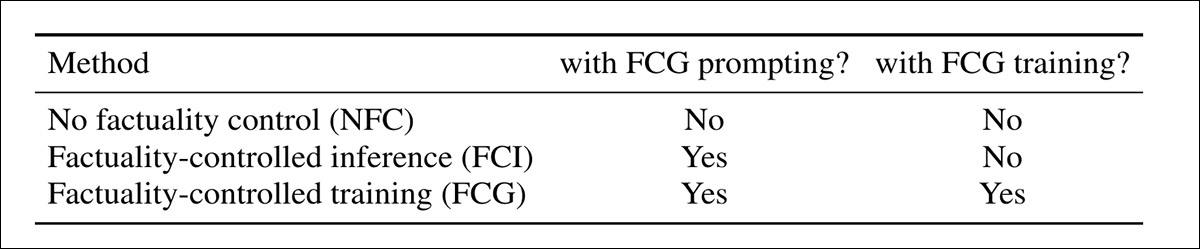

FCG wurde anhand zweier Ausgangswerte getestet. Der erste war Keine Faktenkontrolle (NFC), wobei das Modell einfach mit einer Anfrage wie beispielsweise Erzählen Sie mir eine kurze Biografie von X.Ohne Angabe von Genauigkeit oder Zuverlässigkeit. Diese Version spiegelt das Standardverhalten eines LLM wider, ohne jeglichen Mechanismus zur Filterung oder Einschränkung.

Die zweite Methode, genannt Faktizitätskontrollierte Schlussfolgerung (FCI) verwendete dieselben Konfidenzniveau-Prompts ohne jegliche Feinabstimmung. Beispielsweise könnte das Modell mit folgenden Prompts konfrontiert werden: „Ausgabe von Informationen, denen Sie zu 90 % vertrauen“In diesem Fall ähnelte die Anweisung denjenigen, die im Training verwendet wurden, aber das Modell war zuvor keiner solchen Einschränkung ausgesetzt gewesen:

Vergleich der drei getesteten Ansätze: die Basislinie ohne Kontrollgruppe; eine Version mit Faktenchecks ohne Training; und das feinabgestimmte Modell, das durch die Auseinandersetzung mit gefilterten Daten gelernt hat, den Genauigkeitseinstellungen zu folgen.

Zunächst wurde ein Test durchgeführt für Einhaltung der Fakten:

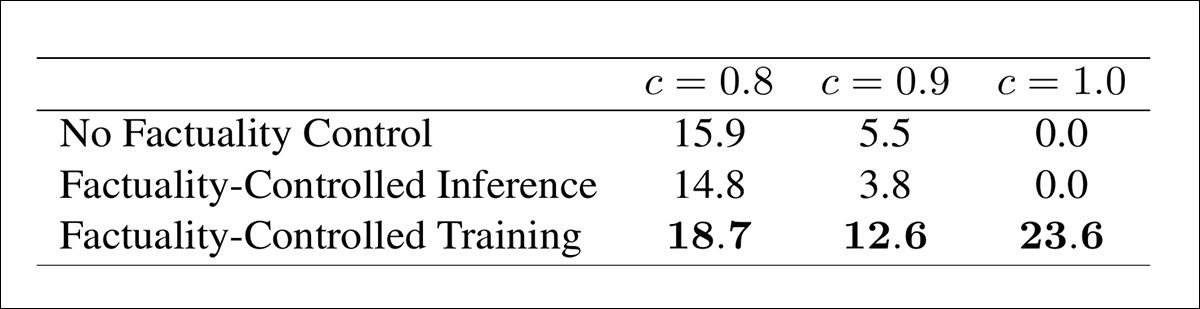

Leistung bei drei Zielkonfidenzniveaus. Nur das vollständig trainierte Modell war in der Lage, vollständig faktische Ergebnisse zu liefern, und es übertraf beide Vergleichsmodelle durchweg, insbesondere bei höheren Schwellenwerten.

Bei Tests mit Faktentreue-Schwellenwerten von 80 %, 90 % und 100 % erreichte nur das feinabgestimmte Modell die Zielvorgaben durchgängig. Überraschenderweise brachte das bloße Hinzufügen von Konfidenzanweisungen ohne entsprechendes Training des Modells keine Verbesserung. In einigen Fällen verschlechterte es die Situation sogar; beispielsweise erreichten nur 3.8 % der Ausgaben des Modells mit Anweisungen den Schwellenwert von 90 %, verglichen mit 5.5 % bei der Version ohne jegliche Anweisung.

Dies deutet laut den Autoren darauf hin, dass das Basismodell Mistral-7B nicht in der Lage war, Eingabeaufforderungen wie diese zu interpretieren. „Sei zu 90 % zuversichtlich“ auf eine nützliche Weise, und dass die zusätzliche Anweisung möglicherweise sogar die übliche Ausgabe gestört hat.

Im Gegensatz dazu reagierte das trainierte Modell zuverlässig auf Steuersignale und lieferte 18.7 % konforme Ausgaben bei 80 %, 12.6 % bei 90 % und 23.6 % bei 100 %; es erwies sich als die einzige Methode, die beliebige Ergebnisse generieren konnte. vollständig faktisch Antworten:

„Diese Verbesserungen deuten darauf hin, dass die Fähigkeit zur Kontrolle der Faktentreue tatsächlich durch angeleitetes Training vermittelt werden kann. Das FCG-Modell hat gelernt, seine Inhalte anzupassen und nur Fakten aufzunehmen, von denen es ausreichend überzeugt ist, während das Standardmodell das Kontrollsignal nicht selbstständig effektiv nutzen konnte.“

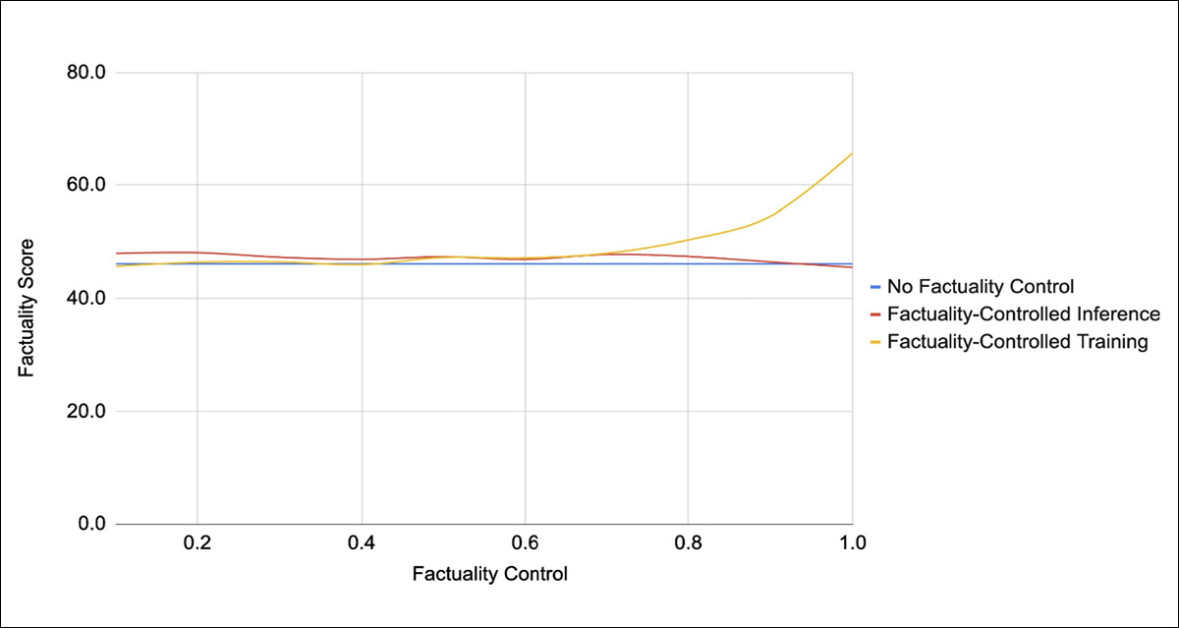

In einem separaten Test, der bestätigen sollte, dass das Modell tatsächlich gelernt hatte, das Kontrollsignal zu interpretieren, überprüften die Forscher, ob die durchschnittliche Faktizität der Antworten mit steigenden geforderten Wahrheitseinstellungen zunahm.

Vor dem Training war kein solches Muster erkennbar, danach zeigten die Ergebnisse jedoch einen stetigen Aufwärtstrend: Je höher das geforderte Selbstvertrauen, desto genauer die Antworten.

Mit steigender Zielvorgabe für die Wahrheit lieferte das feinabgestimmte Modell zunehmend faktenkonforme Ergebnisse, während die Basismodelle über denselben Bereich hinweg keine konsistente Veränderung zeigten.

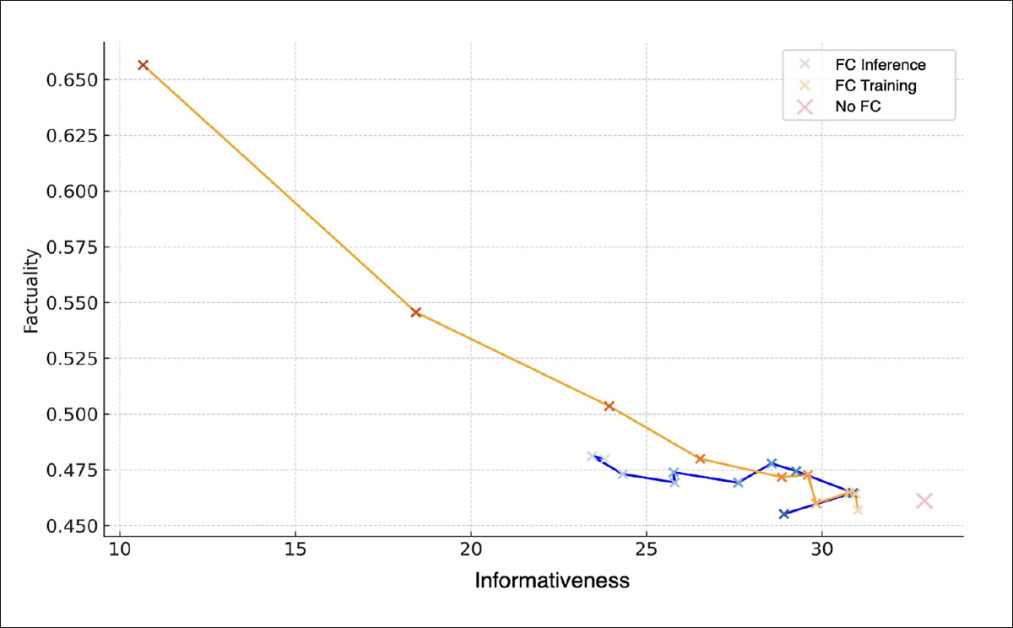

Der Zielkonflikt zwischen Wahrhaftigkeit und Informationsgehalt wurde ebenfalls untersucht. Die Ergebnisse wurden nicht nur hinsichtlich ihrer Genauigkeit bewertet, sondern auch danach, wie viele verifizierte Informationen unter zunehmend strengeren Anforderungen an die Faktentreue erhalten blieben. Wie die folgende Grafik zeigt, übertraf das FCG-Modell sowohl die reine Inferenz-Baseline als auch das uneingeschränkte Modell auf den meisten Ebenen.

Eine Grafik veranschaulicht den Zielkonflikt zwischen Faktentreue und Informationsgehalt bei drei Methoden. Das optimierte Modell bot ein besseres Gleichgewicht zwischen Wahrheit und Detailgenauigkeit als beide Vergleichsmethoden. Bei vergleichbarer Genauigkeit blieb mehr Fakteninhalt erhalten, und selbst bei höchster Genauigkeit war es die einzige Methode, die vollständig verifizierte und nicht inhaltsleere Antworten lieferte.

Bei einer Zielgenauigkeit von rund 90 % wurden mit FCG mehr Fakten beibehalten als mit jeder anderen Methode, und über den gesamten Bereich der Konfidenzeinstellungen hinweg lieferte keine Basislinie durchweg bessere Ergebnisse.

Der Unterschied war am deutlichsten in der strengsten Einstellung, wo FCG weiterhin informative Ergebnisse lieferte, während die Basislinie mit reinen Eingabeaufforderungen gezwungen war, alle Antworten zu entfernen. In diesen Fällen führte bereits eine einzige Aussage mit geringer Konfidenz dazu, dass die gesamte Antwort verworfen wurde.

Im Gegensatz dazu war das trainierte Modell in der Lage, seine Ausgabe so umzugestalten, dass nur Fakten beibehalten wurden, die es als absolut zuverlässig einstufte, wodurch das Zusammenbrechen in Schweigen vermieden wurde, das die anderen Modelle betraf.

Die Faktentreue wurde direkt durch die Kontrollgruppe eingeschränkt, während der Informationsgehalt optimiert wurde, indem das Modell so viele verlässliche Inhalte wie möglich enthielt. Bei höheren Einstellungen wurden nur vertrauenswürdige Aussagen beibehalten; bei niedrigeren Einstellungen wurden mehr spekulative Details zugelassen, was zwar die Länge erhöhte, aber die Genauigkeit verringerte.

Die Autoren folgern:

Bei hohen Anforderungen an die Faktentreue priorisiert das Modell faktisch überprüfbare Aussagen und berücksichtigt dabei so viele relevante Informationen wie möglich. Umgekehrt kann das Modell ein breiteres Spektrum an Details einbeziehen, darunter auch weniger überprüfbare oder spekulativere, was zu einer höheren Informationsdichte (mehr erwähnte Fakten) führt, jedoch auf Kosten der Genauigkeit.

„Dieses Verhalten entspricht unserer Gestaltung der Trainingsdaten: Da wir stets die minimal notwendigen Fakten entfernt haben, lernte das Modell: ‚Wenn x % der Fakten stimmen müssen, lasse die unsichersten Details weg, behalte aber alles andere bei.‘“

Der Artikel schließt mit der Hoffnung, dass die neue Methodik unter anderem in Zukunft auch an größeren Modellen erprobt und auf komplexere Aufgaben angewendet wird.

Fazit

Die hier angebotene Lösung befasst sich mit einem der gravierendsten und am häufigsten beklagten Probleme selbst der neuesten Generation großer Sprachmodelle – ihrer Tendenz, Redseligkeit über Genauigkeit zu stellen, scheinbar nur um „das Gespräch am Laufen zu halten“, und entweder veraltete oder völlig halluzinierte Informationen selbstbewusst als Tatsachen darzustellen.

Für ChatGPT-Nutzer stammt jede sichere Antwort, der nicht kurz ein „Websuche“-Widget vorausgeht, entweder aus den Grenzen des Modells. WissensstichtagOder es könnte sich ebenso gut um eine Halluzination wie um eine Tatsache handeln.

Allerdings erhöhen Websuchen die Latenz und die Betriebskosten des LLM-Hosts und werden, wie jeder Benutzer weiß, selektiv, auf Anfrage des Benutzers oder als „Sondereinstellung“ ausgeführt, die zusätzliche Token-Gebühren verursachen kann.

Dennoch können solche internen ökonomischen Faktoren in bestimmten Bereichen oder bei bestimmten Anfragetypen einen entscheidenden Einfluss auf LLM-Anfragen haben. Jede Methode, die ein Schema zur Sicherstellung der Ausgabegenauigkeit vorgibt, ist daher ein willkommener Forschungsansatz.

* Meine Konvertierung der Inline-Zitate der Autoren in Hyperlinks.

† Die vollständige Versionsnummer wurde nicht angegeben.

Erstveröffentlichung: Freitag, 6. Februar 2026. In den folgenden fünf Minuten aufgrund einer Wortwiederholung korrigiert.