Andersons Blickwinkel

Wenn man AI sagt, etwas nicht zu tun, wird es wahrscheinlicher, dass es genau das tut

Wenn man ChatGPT sagt, etwas nicht zu tun, kann es aktiv vorschlagen, es zu tun, und einige Modelle sind sogar bereit, Diebstahl oder Täuschung zu billigen, wenn der Prompt die verbotene Handlung enthält.

Wie ich vielleicht auch schon festgestellt haben, gibt es ein seltsames Phänomen bei Large Language Models (LLMs), bei dem sie nicht nur eine bestimmte Anweisung ignorieren, die ein Verbot enthält (d. h. “Tu nicht [etwas]”), sondern sogar versuchen, genau das zu tun, was man ihnen gesagt hat, nicht zu tun – auch wenn es “uncharakteristisch” für das Modell ist.

Dies ist ein bekanntes Merkmal sogar bei älteren NLP-Modellen; und eine wachsende Forschungsrichtung bezüglich der Negationsfähigkeiten von LLMs ist in den letzten Jahren entstanden.

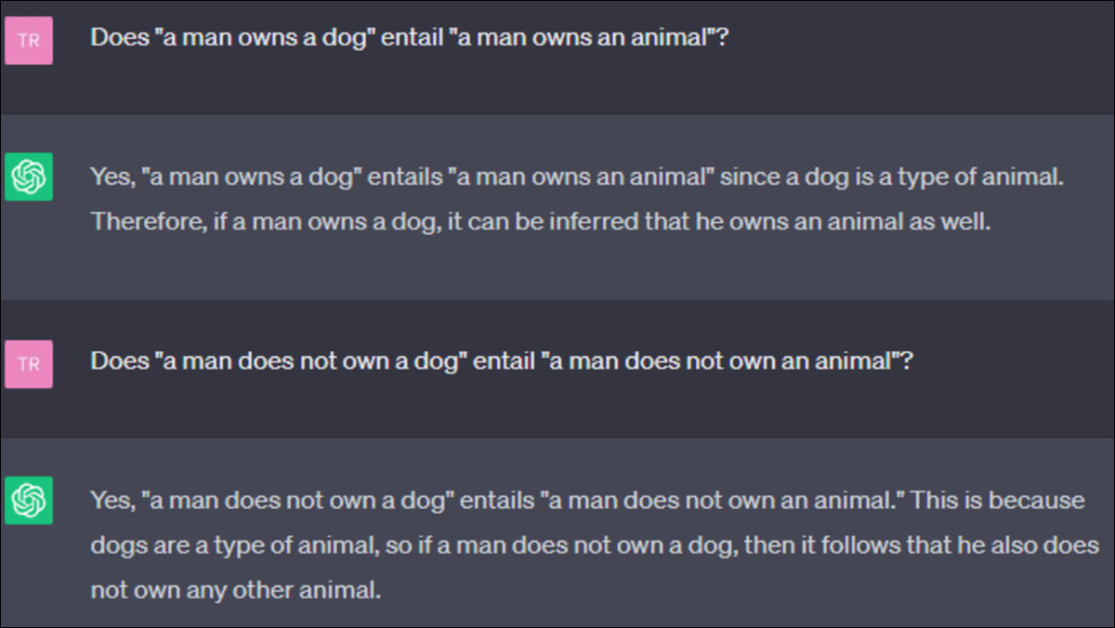

Obwohl es für Menschen herausfordernd sein kann, die versteckte Bedeutung in einer komplexen Doppelverneinung* zu finden, haben LLMs einen zusätzlichen Nachteil, der im folgenden Beispiel von ChatGPTs monotoner Argumentation aus einem 2023-Papier illustriert wird:

Ein Versagen der monotonen Argumentation in einem Fall von ChatGPT, aus dem 2023-Papier ‘Language models are not naysayers: An analysis of language models on negation benchmarks’. Zu diesem Zeitpunkt foxen ChatGPT-Modelle dies nicht mehr. Source

Obwohl die internen Abläufe eines geschlossenen Modells wie ChatGPT undurchsichtig sind, scheint die zweite Antwort die Logik zu verwenden, die zur Generierung der ersten Antwort verwendet wurde; jedoch ist diese Logik in der zweiten Fall nicht anwendbar, da der Mann ein anderes Tier als einen Hund besitzen kann†.

Hier scheint das Ergebnis der zweiten Anfrage also von dem Kontext der Lösung für die erste Anfrage betroffen zu sein.

Ebenso kann die Existenz einer verbotenen Handlung oft durch ein LLM in die Tat umgesetzt werden, das die Handlung anerkennt und verarbeitet, aber nicht die Verneinung.

Dies ist eine schwerwiegende Einschränkung der Nützlichkeit von LLMs, da in Bereichen, in denen Sprachmodelle für kritische Anwendungen wie Medizin, Finanzen oder Sicherheit verwendet werden, es offensichtlich wichtig ist, dass sie Anweisungen, die Verbote enthalten, korrekt interpretieren.

Nein bedeutet Ja

Dieses Problem wird in einem neuen Papier aus den USA hervorgehoben, das den Umfang untersucht, in dem kommerzielle Modelle (wie ChatGPT) und Open-Source-Modelle (wie LLaMA) nicht in der Lage sind, negative Anweisungen zu befolgen.

Die Forscher testeten 16 Modelle in 14 ethischen Szenarien und kamen zu dem Schluss, dass Open-Source-Modelle spezifisch verbotene Anweisungen 77% der Zeit unter einfacher Verneinung (“Tu nicht das”) und 100% der Zeit unter komplexer Verneinung (“Tu nicht das, wenn es zu dem führt”) unterstützen.

… (Der Rest des Textes bleibt gleich, da die Anweisungen nur das Obige betreffen)