Искусственный интеллект

Разделение – следующая революция глубоких подделок

Данные аугментации CGI используются в новом проекте для получения большего контроля над изображениями глубоких подделок. Хотя вы все еще не можете эффективно использовать CGI-головы для заполнения пробелов в наборах данных глубоких подделок лиц, новая волна исследований по разделению идентичности от контекста означает, что скоро вам может не понадобиться.

Создатели некоторых из самых успешных вирусных видеороликов глубоких подделок за последние несколько лет очень тщательно выбирают исходные видео, избегая устойчивых профильных кадров (т.е. вида боковых мугшотов, популяризированных полицейскими процедурами ареста), острых углов и необычных или преувеличенных выражений. Все чаще демонстрационные видеоролики, производимые вирусными создателями глубоких подделок, являются отредактированными компиляциями, которые выбирают «самые легкие» углы и выражения для глубоких подделок.

Фактически, наиболее подходящее целевое видео, в которое можно вставить глубокую подделку знаменитости, – это видео, где исходный человек (чья идентичность будет стерта глубокой подделкой) смотрит прямо в камеру, с минимальным диапазоном выражений.

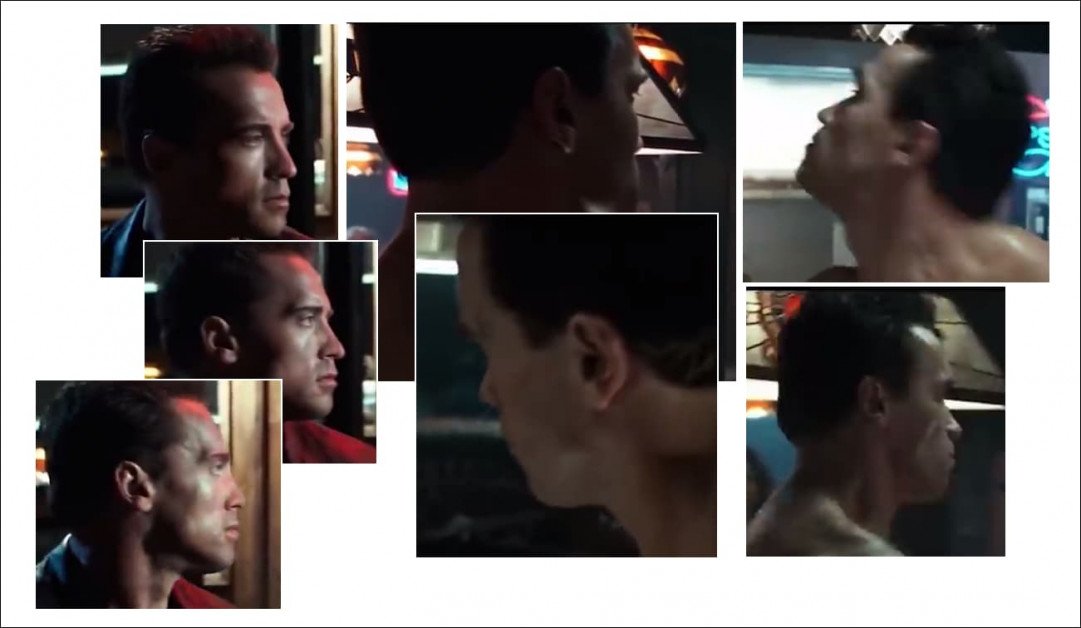

Большинство популярных глубоких подделок в последние годы показывали объекты, смотрящих прямо в камеру, и либо носящих только популярные выражения (например, улыбку), которые можно легко извлечь из выходов папарацци, либо (как в случае с фейковой Сильвестром Сталлоне в качестве Терминатора, изображенного слева), идеально без выражения, поскольку нейтральные выражения очень распространены, что делает их легко включаемыми в модели глубоких подделок.

Поскольку технологии глубоких подделок, такие как DeepFaceLab и FaceSwap, выполняют эти более простые обмены очень хорошо, мы достаточно впечатлены тем, что они достигают, чтобы не заметить, что они не могут сделать, и – часто – даже не пытаются:

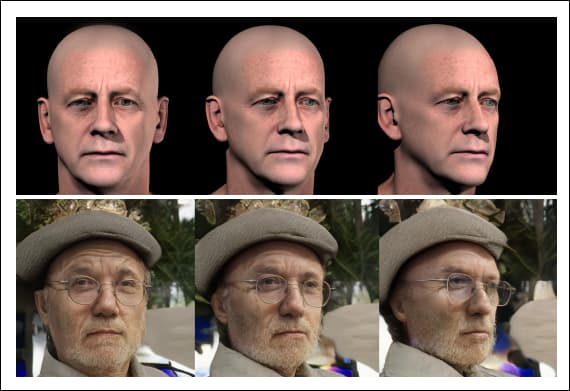

Кадры из признанного видеоролика глубокой подделки, где Арнольд Шварценеггер превращается в Сильвестра Сталлоне – если углы не слишком сложны. Профили остаются постоянной проблемой для текущих подходов к глубоким подделкам, частично потому, что открытые программные средства, используемые для определения поз лиц в рамках глубоких подделок, не оптимизированы для боковых видов, но в основном потому, что отсутствует подходящий исходный материал в одном или обоих необходимых наборах данных. Источник: https://www.youtube.com/watch?v=AQvCmQFScMA

Новые исследования из Израиля предлагают новый метод использования синтетических данных, таких как CGI-головы, для приведения глубоких подделок в 2020-е годы,真正 разделяя идентичность лиц (т.е. сущностные характеристики лица «Тома Круза» со всех сторон) от их контекста (т.е. смотрящего вверх, смотрящего в сторону, хмурящегося, хмурящегося в темноте, сморщившего брови, закрывшего глаза и т. д.).

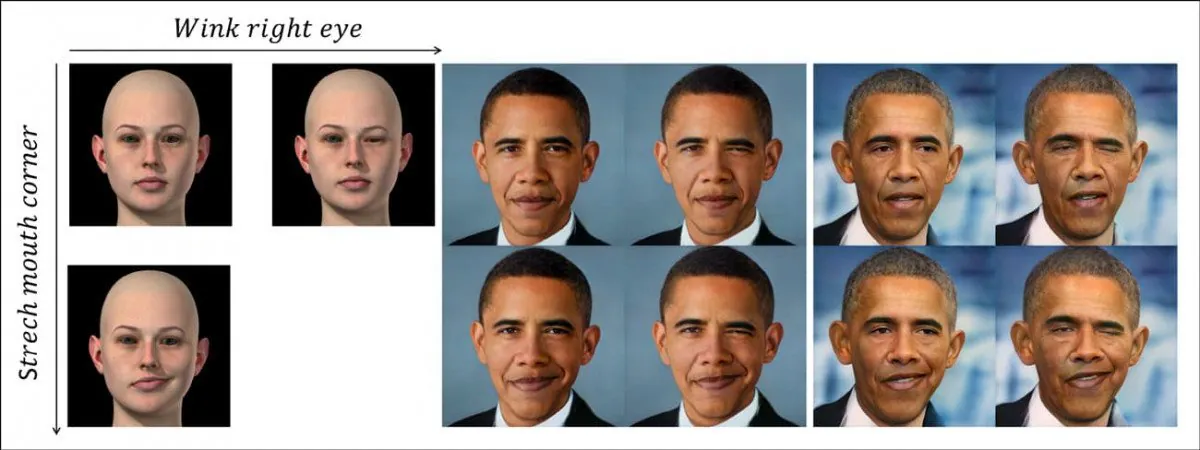

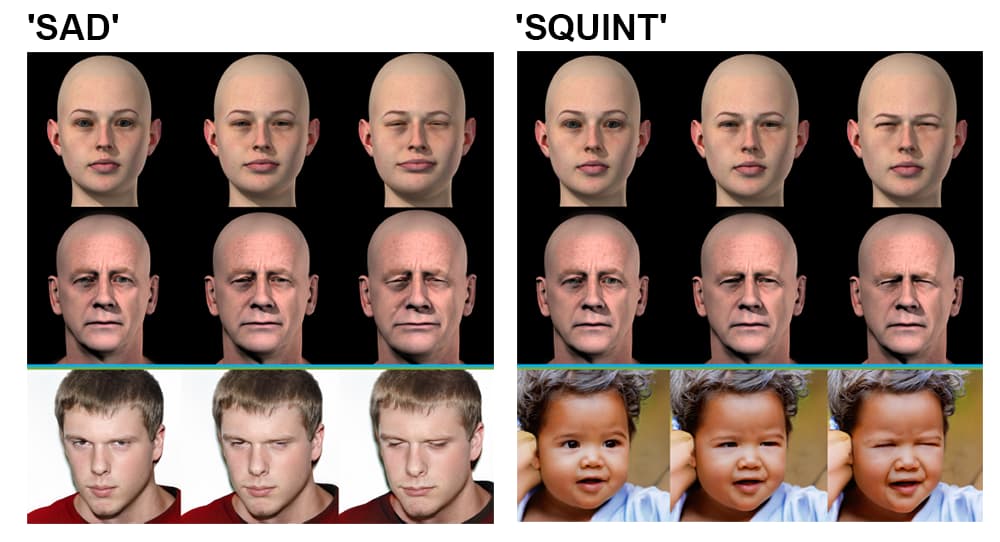

Новая система дискретно отделяет позу и контекст (т.е. подмигивание глазом) от кодирования идентичности человека, используя несвязанные синтетические данные лица (изображено слева). В верхнем ряду мы видим «подмигивание», переданное на идентичность Барака Обамы, вызванное выученным нелинейным путем латентного пространства GAN, представленного CGI-изображением слева. В ряду ниже мы видим переданный уголок рта. В правом нижнем углу мы видим оба характерных признака, примененных одновременно. Источник: https://arxiv.org/pdf/2111.08419.pdf

Это не простая кукловодство глубоких подделок, техника более подходящая для аватаров и частичного синхронизации губ, и которая имеет ограниченный потенциал для полноценных преобразований видео глубоких подделок.

Скорее, это представляет собой способ вперед для фундаментального разделения инструментальности (такой как ‘изменить угол головы’, ‘создать хмурость’) от идентичности, предлагая путь к высокоуровневой, а не «производной» синтезу изображений на основе глубоких подделок.

Новая статья называется Delta-GAN-Encoder: Кодирование семантических изменений для явного редактирования изображений, используя несколько синтетических образцов, и исходит от исследователей из Технион – Израильского технологического института.

Чтобы понять, что означает эта работа, давайте посмотрим, как в настоящее время производятся глубокие подделки повсюду, от сайтов глубоких подделок для взрослых до Industrial Light and Magic (поскольку репозиторий открытого исходного кода DeepFaceLab в настоящее время доминирует как в «любительских», так и в профессиональных глубоких подделках).

Что тормозит текущую технологию глубоких подделок?

Глубокие подделки в настоящее время создаются путем обучения модели машинного обучения кодировщика/декодировщика на двух папках с изображениями лиц – человека, которого вы хотите «закрасить» (в предыдущем примере, это Арни), и человека, которого вы хотите наложить на видео (Слай).

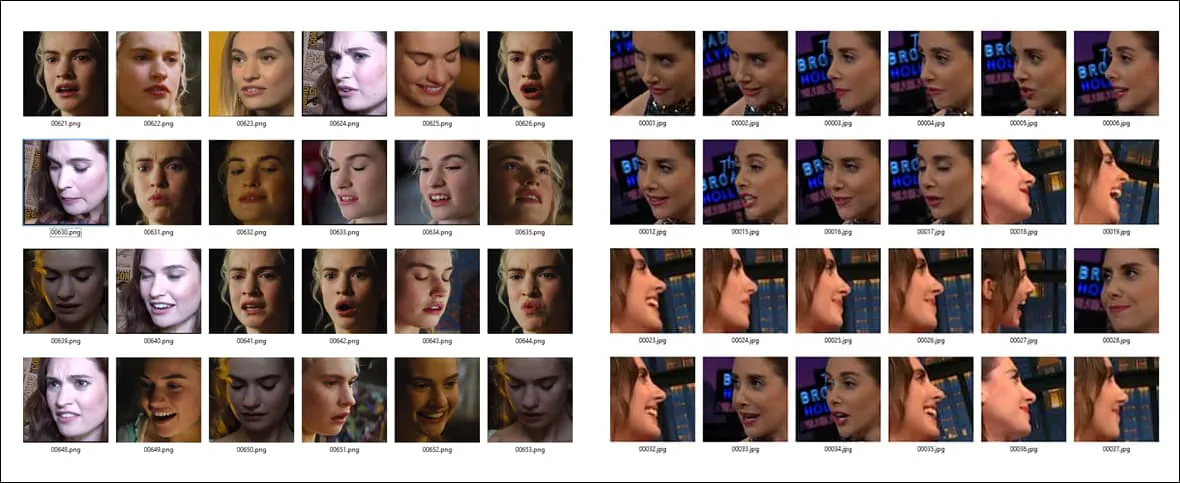

Примеры различных поз и условий освещения в двух разных наборах лиц. Обратите внимание на характерное выражение в конце третьего ряда в столбце А, которое вряд ли имеет близкий аналог в другом наборе данных.

Система кодировщика/декодировщика затем сравнивает каждое отдельное изображение в каждой папке с каждым другим, поддерживая, улучшая и повторяя эту операцию за hundreds тысяч итераций (часто в течение недели), пока она не поймет сущностные характеристики обеих идентичностей достаточно хорошо, чтобы поменять их местами по желанию.

Для каждой из двух людей, участвующих в процессе обмена, то, что глубокая подделка учит о идентичности, сплетено с контекстом. Она не может выучить и применить принципы о какой-либо общей позе «хорошо и все», а должна иметь много примеров этой конкретной позы/идентичности в обучающем наборе данных.

Следовательно, если вы хотите поменять две идентичности, которые делают что-то более необычное, чем просто улыбка или взгляд прямо в камеру, вам понадобится много экземпляров этой конкретной позы/идентичности в обоих наборах лиц:

Поскольку характеристики лица и позы в настоящее время так сплетены, широкий паритет выражений, поз головы и (в меньшей степени) освещения необходим в двух наборах лиц для обучения эффективной модели глубоких подделок на системах, таких как DeepFaceLab. Чем меньше конкретная конфигурация (например, «боковой вид/улыбка/освещение на солнце») представлена в обоих наборах лиц, тем менее точно она будет отображаться в видео глубоких подделок, если это необходимо.

Если набор А содержит необычную позу, но набор Б ее не имеет, вы практически не повезло; независимо от того, как долго вы обучаете модель, она никогда не научится хорошо воспроизводить эту позу между идентичностями, потому что у нее не было полной необходимой информации во время обучения.

Даже если у вас есть совпадающие изображения, это может не быть достаточно: если набор А имеет совпадающую позу, но с резким боковым освещением, по сравнению с плоско освещенным аналогичной позой в другом наборе лиц, качество обмена не будет так хорошим, как если бы каждая имела общие характеристики освещения.

Почему данные скудны

Если вы не арестованы регулярно, у вас, вероятно, нет слишком многих боковых профильных снимков. Любые, которые появлялись, вы, вероятно, выбрасывали. Поскольку агентства по продаже картинок также делают то же самое, профильные снимки лиц трудно найти.

Создатели глубоких подделок часто включают несколько копий ограниченных боковых профильных данных, которые у них есть для идентичности, в набор лиц, просто чтобы эта поза получила хотя бы немного внимания и времени во время обучения, вместо того, чтобы быть отклоненной как выброс.

Но существует много больше возможных типов боковых снимков лиц, чем, вероятно, доступно для включения в набор данных – улыбка, хмурость, крик, плач, темное освещение, презрение, скука, радость, освещение фона, смотрящий вверх, смотрящий вниз, глаза открыты, глаза закрыты… и так далее. Любая из этих поз, в множественных комбинациях, могла бы быть необходима в целевом видео глубоких подделок.

И это только профили. Сколько у вас фотографий, на которых вы смотрите прямо вверх? У вас достаточно, чтобы в широком смысле представить 10 000 возможных выражений, которые вы можете носить, сохраняя именно эту позу с именно этого угла камеры, покрывая хотя бы некоторые из одного миллиона возможных сред освещения?

Вероятно, у вас даже нет одной фотографии, на которой вы смотрите вверх. И это только два угла из сотни или более, необходимых для полного покрытия.

Даже если бы было возможно сгенерировать полное покрытие лица со всех сторон под различными условиями освещения, результирующий набор данных был бы слишком большим для обучения, в порядке сотен тысяч изображений; и даже если бы он мог быть обучен, природа процесса обучения для текущих рамок глубоких подделок выбросила бы большую часть этой дополнительной информации в пользу ограниченного количества производных функций, потому что текущие рамки являются редукционистскими и не очень масштабируемыми.

Синтетическая замена

С момента появления глубоких подделок создатели глубоких подделок экспериментировали с использованием изображений в стиле CGI, голов, созданных в 3D-приложениях, таких как Cinema4D и Maya, для генерации «пропавших поз».

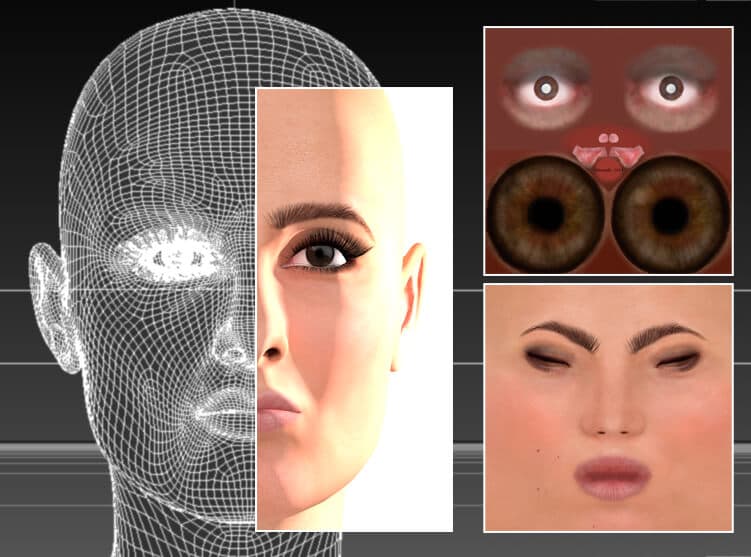

Нет необходимости в ИИ; актриса воссоздана в традиционной программе CGI, Cinema 4D, с использованием сеток и битмап-текстур – технологии, которая восходит к 1960-м годам, хотя и получила широкое распространение только с 1990-х годов. В теории, эта модель лица могла бы быть использована для генерации исходных данных глубоких подделок для необычных поз, стилей освещения и выражений лиц. На самом деле, она была мало или не полезна в глубоких подделках, поскольку «фальшивость» рендеров склонна просачиваться в обмененные видео. Источник: изображение этого автора на https://rossdawson.com/futurist/implications-of-ai/comprehensive-guide-ai-artificial-intelligence-visual-effects-vfx/

Этот метод обычно отказывается новыми практиками глубоких подделок, потому что, хотя он может обеспечить позы и выражения, которые в противном случае недоступны, синтетический вид CGI-лицев склонен просачиваться в обмены из-за сплетения идентичности и контекстной/семантической информации.

Это может привести к внезапному появлению «долины неудобства» лиц в видео глубоких подделок, в то время как алгоритм начинает использовать единственные данные, которые у него могут быть для необычной позы или выражения – манифестно фальшивые лица.

Среди самых популярных объектов для создателей глубоких подделок 3D-алгоритм глубоких подделок для австралийской актрисы Марго Робби включен в состав установки DeepFaceLive, версии DeepFaceLab, которая может выполнять глубокие подделки в прямом эфире, таком как сеанс веб-камеры. CGI-версия, как показано выше, могла бы быть использована для получения необычных «пропавших» углов в наборах данных глубоких подделок. Источник: https://sketchfab.com/3d-models/margot-robbie-bust-for-full-color-3d-printing-98d15fe0403b4e64902332be9cfb0ace

CGI-лица как отсоединенные концептуальные рекомендации

Вместо этого новый метод Delta-GAN Encoder (DGE) от израильских исследователей более эффективен, потому что информация о позе и контексте из CGI-изображений полностью отделена от «информации об идентичности» целевого объекта.

Мы можем увидеть этот принцип в действии на изображении ниже, где различные ориентации головы получены с помощью CGI-изображений в качестве рекомендации. Поскольку характеристики идентичности не связаны с характеристиками контекста, нет просачивания ни синтетического вида CGI-лица, ни идентичности, изображенной в нем:

С новым методом вам не нужно искать три отдельных реальных источника изображений, чтобы выполнить глубокую подделку с нескольких углов – вы можете просто повернуть CGI-голову, чьи абстрактные высокоуровневые функции наложены на идентичность без утечки какой-либо информации об идентичности.

Delta-GAN-Encoder. Верхняя левая группа: угол исходного изображения можно изменить за секунду, чтобы отобразить новое исходное изображение, которое отражается в выходе; верхняя правая группа: освещение также отделено от идентичности, что позволяет наложить стили освещения; нижняя левая группа: несколько деталей лица изменены, чтобы создать «грустное» выражение; нижняя правая группа: изменен один отдельный деталь выражения лица, так что глаза морщатся.

Это разделение идентичности и контекста достигается на этапе обучения. Конвейер для новой архитектуры глубоких подделок ищет латентный вектор в предварительно обученной генеративной сети противостояния (GAN), который соответствует изображению, подлежащему трансформации – методология Sim2Real, которая основана на проекте 2018 года из исследовательского отдела AI IBM.

Исследователи наблюдают:

‘С помощью нескольких образцов, которые различаются по конкретному атрибуту, можно выучить разъединенное поведение предварительно обученной сплетенной генеративной модели. Нет необходимости в точных реальных образцах для достижения этой цели, которая не обязательно возможна.

‘Используя нереалистичные данные-образцы, можно достичь той же цели, используя семантику закодированных латентных векторов. Применение желаемых изменений к существующим данным-образцам можно выполнить без явного исследования поведения латентного пространства.’

Исследователи предсказывают, что основные принципы разъединения, исследованные в проекте, могут быть перенесены в другие области, такие как симуляции интерьерной архитектуры, и что метод Sim2Real, принятый для Delta-GAN-Encoder, в конечном итоге может позволить инструментальность глубоких подделок на основе простых эскизов, а не входных данных в стиле CGI.

Можно утверждать, что степень, в которой новая израильская система может или не может синтезировать видео глубоких подделок, намного менее значима, чем прогресс, которого достигло исследование в разъединении контекста от идентичности, получая при этом больший контроль над латентным пространством GAN.

Разъединение – это активная область исследований в синтезе изображений; в январе 2021 года исследовательская работа, возглавляемая Amazon, демонстрировала аналогичный контроль позы и разъединение, и в 2018 году статья из Шеньженских институтов передовых технологий в Китайской академии наук добилась прогресса в генерации произвольных точек зрения в GAN.