Inteligência artificial

A Desentrelação é a Próxima Revolução dos Deepfakes

Aumento de dados CGI está sendo usado em um novo projeto para obter um controle maior sobre as imagens de deepfakes. Embora você ainda não possa usar cabeças CGI para preencher as lacunas nos conjuntos de dados de deepfakes faciais, uma nova onda de pesquisa sobre a desentrelação da identidade do contexto significa que em breve, você pode não precisar.

Os criadores de alguns dos vídeos de deepfakes mais bem-sucedidos dos últimos anos selecionam seus vídeos de origem muito cuidadosamente, evitando fotos de perfil prolongadas (ou seja, o tipo de fotos de perfil popularizadas por procedimentos de prisão da polícia), ângulos agudos e expressões incomuns ou exageradas. Cada vez mais, os vídeos de demonstração produzidos por criadores de deepfakes virais são compilações editadas que selecionam os ângulos e expressões mais “fáceis” para deepfakes.

Na verdade, o vídeo-alvo mais acomodatício para inserir um deepfake de celebridade é um onde a pessoa original (cuja identidade será apagada pelo deepfake) está olhando diretamente para a câmera, com um mínimo de expressões.

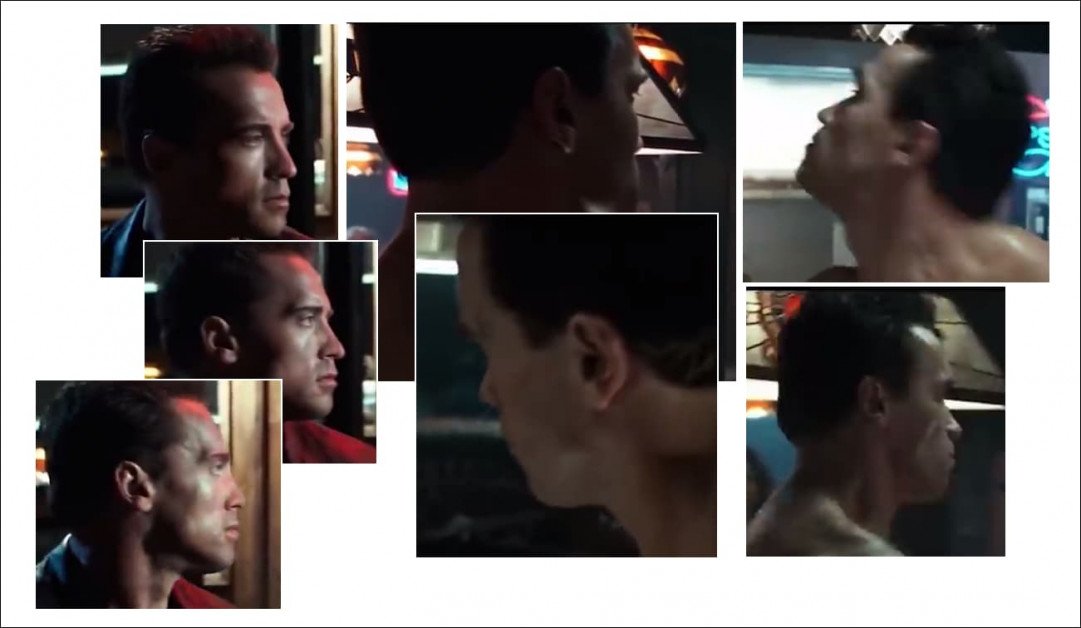

A maioria dos deepfakes populares dos últimos anos mostrou assuntos diretamente enfrentando a câmera, e ou com expressões populares (como sorrindo), que podem ser facilmente extraídas de saídas de paparazzi de tapete vermelho, ou (como no fake de 2019 de Sylvester Stallone como o Terminator, imagem à esquerda), idealmente com nenhuma expressão, desde que expressões neutras sejam extremamente comuns, tornando-as fáceis de incorporar em modelos de deepfakes.

Porque as tecnologias de deepfakes, como DeepFaceLab e FaceSwap, realizam essas trocas mais simples muito bem, estamos suficientemente impressionados com o que elas realizam para não notar o que elas são incapazes de fazer, e – frequentemente – nem mesmo tentam:

Grabs de um vídeo de deepfake aclamado onde Arnold Schwarzenegger é transformado em Sylvester Stallone – a menos que os ângulos sejam muito complicados. Perfis permanecem um problema persistente com as abordagens de deepfakes atuais, parcialmente porque o software de código aberto usado para definir poses faciais em frameworks de deepfakes não é otimizado para vistas laterais, mas principalmente porque da falta de material de origem adequado em um ou ambos os conjuntos de dados necessários. Fonte: https://www.youtube.com/watch?v=AQvCmQFScMA

Nova pesquisa de Israel propõe um método novo de usar dados sintéticos, como cabeças CGI, para trazer deepfakes para os anos 2020, separando verdadeiramente identidades faciais (ou seja, as características faciais essenciais de ‘Tom Cruise’, de todos os ângulos) de seu contexto (ou seja, olhando para cima, olhando para o lado, franzindo a testa, franzindo a testa no escuro, sobrancelhas franzidas, olhos fechados, etc.).

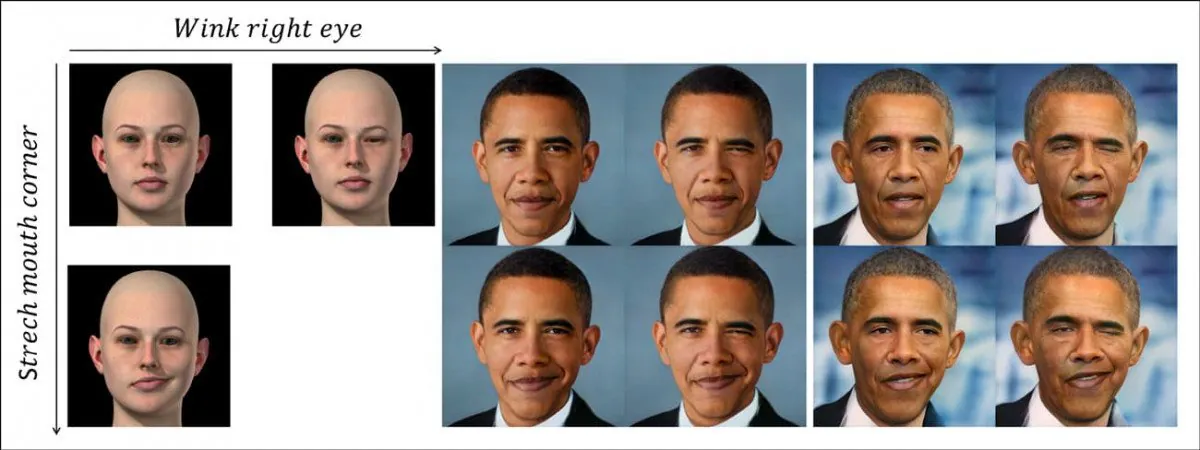

O novo sistema separa discretamente a pose e o contexto (ou seja, piscar um olho) do código de identidade do indivíduo, usando dados faciais sintéticos não relacionados (imagem à esquerda). Na linha superior, vemos um ‘piscar’ transferido para a identidade de Barack Obama, provocado pelo caminho não linear aprendido do espaço latente de um GAN, representado pela imagem CGI à esquerda. Na linha abaixo, vemos o canto da boca esticado transferido para o ex-presidente. Na parte inferior direita, vemos ambas as características aplicadas simultaneamente. Fonte: https://arxiv.org/pdf/2111.08419.pdf

Isso não é apenas marionetismo de deepfake, uma técnica mais adequada para avatares e lip-sincronização parcial de face, e que tem um potencial limitado para transformações de vídeo de deepfake completas.

Em vez disso, isso representa uma forma de avançar para uma separação fundamental de instrumentalidade (como ‘mudar o ângulo da cabeça’, ‘criar uma careta’) da identidade, oferecendo um caminho para um quadro de síntese de imagem de nível superior em vez de um baseado em derivação de deepfake.

O novo artigo é intitulado Delta-GAN-Encoder: Encoding Semantic Changes for Explicit Image Editing, using Few Synthetic Samples, e vem de pesquisadores do Technion – Israel Institute of Technology.

Para entender o que o trabalho significa, vamos dar uma olhada em como os deepfakes são produzidos atualmente, desde sites de deepfake pornográficos até Industrial Light and Magic (já que o repositório de código aberto DeepFaceLab é atualmente dominante tanto em deepfaking “amador” quanto profissional).

O que Está Segurando a Tecnologia de Deepfake Atual?

Os deepfakes são atualmente criados treinando um modelo de aprendizado de máquina encoder/decoder em duas pastas de imagens de faces – a pessoa que você deseja “pintar” (no exemplo anterior, é Arnie) e a pessoa que você deseja superpor ao vídeo (Sly).

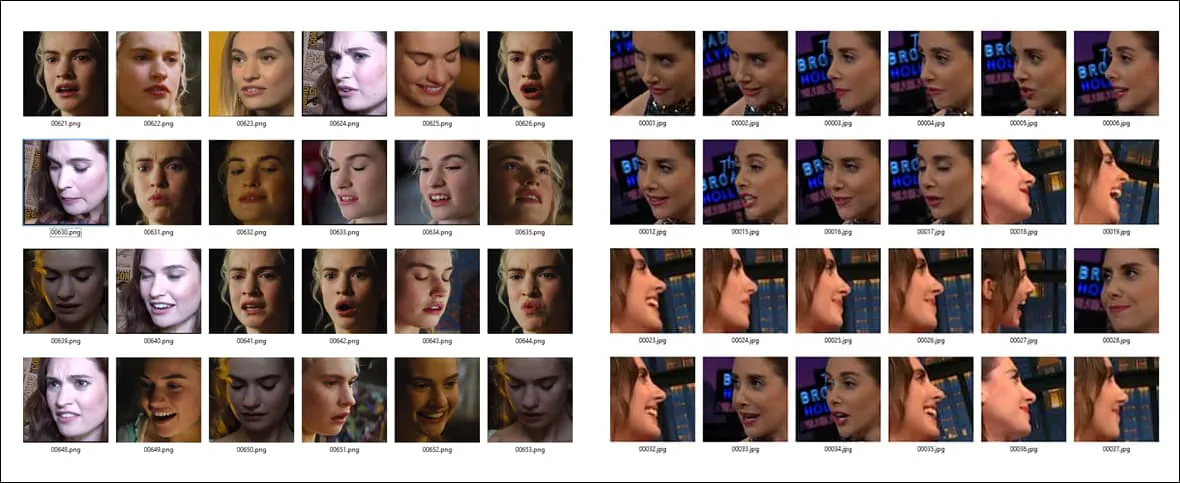

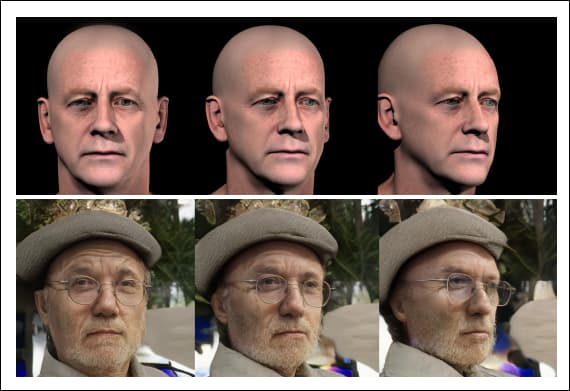

Exemplos de pose e condições de iluminação variadas em dois conjuntos de faces diferentes. Observe a expressão distinta no final da terceira linha na coluna A, que é improvável ter um equivalente próximo no outro conjunto de dados.

O sistema encoder/decoder então compara cada imagem em cada pasta com cada uma das outras, sustentando, melhorando e repetindo essa operação por centenas de milhares de iterações (frequentemente por tanto tempo quanto uma semana), até que ele entenda as características essenciais de ambas as identidades o suficiente para trocá-las à vontade.

Para cada uma das duas pessoas sendo trocadas no processo, o que a arquitetura de deepfake aprende sobre identidade está entrelaçado com contexto. Ele não pode aprender e aplicar princípios sobre uma pose genérica “para sempre”, mas precisa de exemplos abundantes no conjunto de dados de treinamento, para cada uma das identidades que serão envolvidas na troca de faces.

Portanto, se você quiser trocar duas identidades que estão fazendo algo mais incomum do que apenas sorrir ou olhar diretamente para a câmera, você precisará de muitos exemplos dessa pose particular em ambos os conjuntos de faces:

Porque a ID facial e as características de pose estão atualmente tão entrelaçadas, uma ampla paridade de expressão, pose de cabeça e (em menor medida) iluminação é necessária em dois conjuntos de dados faciais para treinar um modelo de deepfake eficaz em sistemas como o DeepFaceLab. Quanto menos uma configuração particular (como ‘vista lateral/sorrindo/iluminada pelo sol’) for apresentada em ambos os conjuntos de faces, menos precisamente ela será renderizada em um vídeo de deepfake, se necessário.

Se o conjunto A contém a pose incomum, mas o conjunto B falta, você está quase sem sorte; não importa quanto tempo você treine o modelo, ele nunca aprenderá a reproduzir essa pose bem entre as identidades, porque ele só teve metade das informações necessárias quando foi treinado.

Mesmo que você tenha imagens correspondentes, pode não ser suficiente: se o conjunto A tem a pose correspondente, mas com iluminação lateral intensa, em comparação com a pose equivalente achatada no outro conjunto de faces, a qualidade da troca não será tão boa quanto se cada um compartilhasse características de iluminação comuns.

Por Que os Dados São Escassos

A menos que você seja preso regularmente, você provavelmente não tem muitas fotos de perfil lateral. Qualquer uma que tenha surgido, você provavelmente jogou fora. Desde que agências de fotos também fazem o mesmo, fotos de perfil facial são difíceis de encontrar.

Os criadores de deepfakes frequentemente incluem múltiplas cópias dos dados de perfil lateral limitados que eles têm para uma identidade em um conjunto de faces, apenas para que a pose obtenha pelo menos um pouco de atenção e tempo durante o treinamento, em vez de ser descontado como um outlier.

Mas há muitos mais tipos possíveis de fotos de faces laterais do que provavelmente estarão disponíveis para inclusão em um conjunto de dados – sorrindo, franzindo a testa, gritando, chorando, iluminada pelo escuro, desdenhosa, entediada, alegre, iluminada por flash, olhando para cima, olhando para baixo, olhos abertos, olhos fechados… e assim por diante. Qualquer uma dessas poses, em combinações múltiplas, poderia ser necessária em um vídeo de deepfake alvo.

E isso é apenas perfis. Quantas fotos você tem de si mesmo olhando diretamente para cima? Você tem o suficiente para representar amplamente as 10.000 expressões possíveis que você pode estar usando enquanto mantém exatamente essa pose daquele ângulo de câmera específico, cobrindo pelo menos algumas das um milhão de ambientes de iluminação possíveis?

É provável que você não tenha nenhuma foto de si mesmo olhando para cima. E isso é apenas dois ângulos de uma cobertura total de cem ou mais necessários.

Mesmo que fosse possível gerar uma cobertura completa de um rosto de todos os ângulos sob uma variedade de condições de iluminação, o conjunto de dados resultante seria muito grande para treinar, na ordem de centenas de milhares de imagens; e mesmo que fosse possível treinar, a natureza do processo de treinamento para os frameworks de deepfakes atuais jogaria fora a maioria desses dados extras em favor de um número limitado de recursos derivados, porque os frameworks atuais são reducionistas e não muito escaláveis.

Substituição Sintética

Desde o início dos deepfakes, os criadores de deepfakes experimentaram o uso de imagens de estilo CGI, cabeças feitas em aplicativos 3D como Cinema4D e Maya, para gerar essas “poses perdidas”.

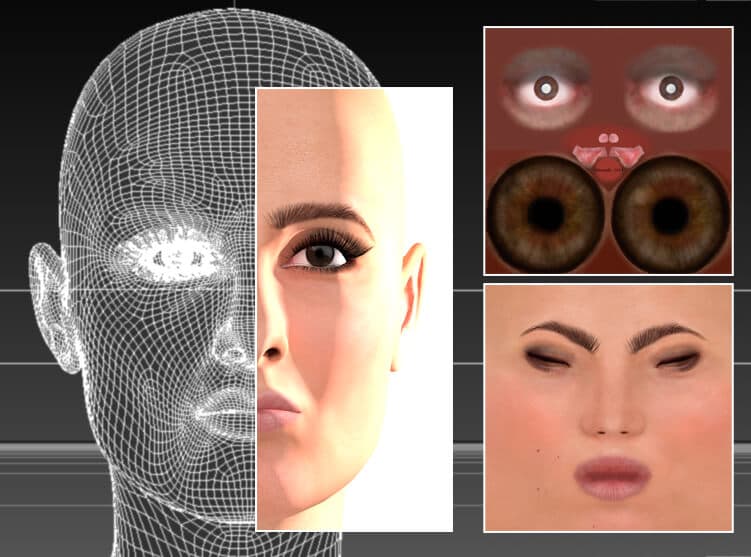

Nenhuma IA necessária; uma atriz é recriada em um programa CGI tradicional, Cinema 4D, usando malhas e texturas bitmap – tecnologia que remonta aos anos 1960, embora tenha alcançado uso generalizado apenas a partir dos anos 1990. Em teoria, esse modelo de face poderia ser usado para gerar dados de origem de deepfake para poses, estilos de iluminação e expressões faciais incomuns. Na realidade, ele tem sido de uso limitado ou nenhum em deepfakes, desde que a ‘falsidade’ dos renders tende a passar para os vídeos trocados. Fonte: imagem do autor deste artigo em https://rossdawson.com/futurist/implications-of-ai/comprehensive-guide-ai-artificial-intelligence-visual-effects-vfx/

Esse método é geralmente abandonado cedo por novos praticantes de deepfakes, porque embora possa fornecer poses e expressões que de outra forma estariam indisponíveis, a aparência sintética das faces CGI geralmente passa para as trocas devido ao entrelaçamento de ID e informações contextuais/semânticas.

Isso pode levar ao flash repentino de faces do “vale da estranheza” em um vídeo de deepfake de outra forma convincente, à medida que o algoritmo começa a se basear nos únicos dados que ele pode ter para uma pose ou expressão incomum – faces manifestamente falsas.

Entre os assuntos mais populares para deepfakers, um algoritmo de deepfake 3D para a atriz australiana Margot Robbie está incluído na instalação padrão do DeepFaceLive, uma versão do DeepFaceLab que pode realizar deepfakes em uma transmissão ao vivo, como uma sessão de webcam. Uma versão CGI, como mostrada acima, poderia ser usada para obter ângulos ‘perdidos’ incomuns em conjuntos de dados de deepfakes. Fonte: https://sketchfab.com/3d-models/margot-robbie-bust-for-full-color-3d-printing-98d15fe0403b4e64902332be9cfb0ace

Faces CGI como Diretrizes Conceituais Desacopladas

Em vez disso, o novo método Delta-GAN Encoder (DGE) dos pesquisadores israelenses é mais eficaz, porque a pose e as informações contextuais das imagens CGI foram completamente separadas das informações de “identidade” do alvo.

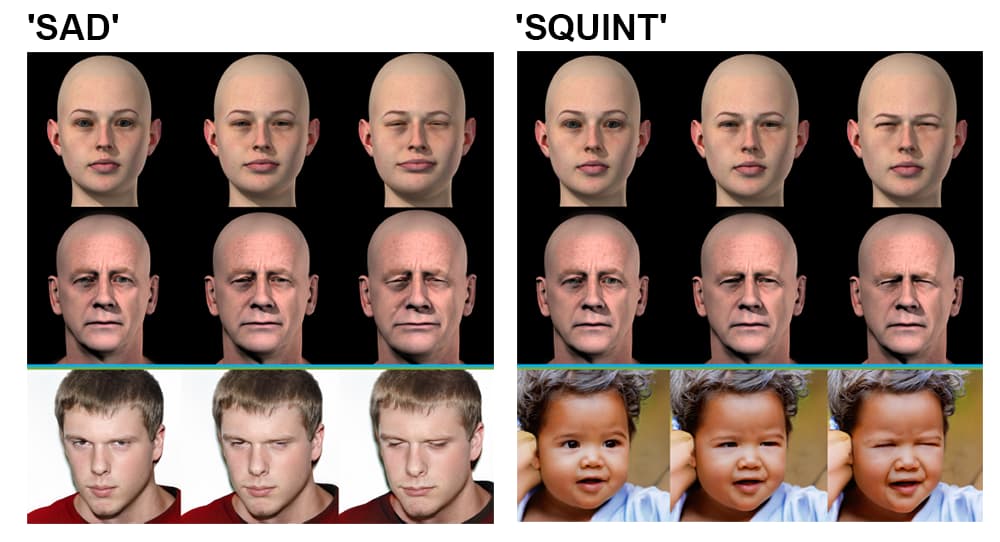

Podemos ver esse princípio em ação na imagem abaixo, onde várias orientações de cabeça foram obtidas usando a imagem CGI como uma diretriz. Como as características de identidade são não relacionadas às características contextuais, não há vazamento de nenhuma aparência sintética falsa da face CGI, nem da identidade representada nela:

Com o novo método, você não precisa encontrar três imagens de origem separadas para realizar um deepfake de múltiplos ângulos – você pode apenas girar a cabeça CGI, cujas características abstratas de alto nível são impostas à identidade sem vazamento de informações de ID.

Delta-GAN-Encoder. Grupo superior esquerdo: o ângulo de uma imagem de origem pode ser alterado em um segundo para renderizar uma nova imagem de origem, que é refletida na saída; grupo superior direito: a iluminação também é desentrelaçada da identidade, permitindo a superposição de estilos de iluminação; grupo inferior esquerdo: vários detalhes faciais são alterados para criar uma expressão ‘triste’; grupo inferior direito: um único detalhe de expressão facial é alterado, de modo que os olhos estejam franzindo.

Essa separação de identidade e contexto é alcançada na etapa de treinamento. O pipeline para a nova arquitetura de deepfake procura o vetor latente em uma Rede Generativa Adversária (GAN) pré-treinada que corresponde à imagem a ser transformada – uma metodologia Sim2Real que se baseia em um projeto de 2018 da seção de pesquisa de IA da IBM.

Os pesquisadores observam:

‘Com apenas alguns exemplos, que diferem por um atributo específico, é possível aprender o comportamento desentrelaçado de um modelo gerativo entrelaçado pré-treinado. Não há necessidade de amostras do mundo real exatas para atingir esse objetivo, o que não é necessariamente viável.

‘Usando amostras de dados não realistas, o mesmo objetivo pode ser alcançado graças à exploração das semânticas dos vetores latentes codificados. Aplicar alterações desejadas sobre amostras de dados existentes pode ser feito sem exploração explícita do comportamento do espaço latente.’

Os pesquisadores antecipam que os princípios centrais de desentrelaçamento explorados no projeto possam ser transferidos para outros domínios, como simulações de arquitetura de interiores, e que o método Sim2Real adotado para o Delta-GAN-Encoder possa eventualmente permitir a instrumentação de deepfakes baseada em esboços, em vez de entrada de estilo CGI.

Pode-se argumentar que a extensão com que o novo sistema israelense possa ou não ser capaz de sintetizar vídeos de deepfakes é muito menos significativa do que o progresso que a pesquisa fez em desentrelaçar o contexto da identidade, ganhando mais controle sobre o espaço latente de uma GAN.

A desentrelaçamento é um campo de pesquisa ativo na síntese de imagens; em janeiro de 2021, um artigo liderado pela Amazon demonstrou controle de pose e desentrelaçamento semelhantes, e em 2018 um artigo do Shenzhen Institutes of Advanced Technology na Academia Chinesa de Ciências fez progressos na geração de pontos de vista arbitrários em uma GAN.