Ângulo de Anderson

AI Vídeo Aperfeiçoa a Selfie do Gato

Os geradores de vídeo de IA frequentemente fornecem resultados que estão perto, mas não são exatamente o que o prompt de texto desejava. Mas uma nova solução de alto nível faz toda a diferença.

Os sistemas de vídeo gerativos frequentemente têm dificuldade em criar vídeos que sejam realmente criativos ou selvagens e frequentemente não atendem às expectativas dos prompts de texto dos usuários.

Parte do motivo disso é entanglement – o fato de que os modelos de visão/linguagem têm que comprometer quanto ao tempo de treinamento nos dados de origem. Treinamento insuficiente, e os conceitos são flexíveis, mas não totalmente formados – treinamento excessivo, e os conceitos são precisos, mas não são mais flexíveis o suficiente para incorporar combinações novas.

Você pode ter uma ideia a partir do vídeo incorporado abaixo. À esquerda está o tipo de compromisso de meio-termo que muitos sistemas de IA entregam em resposta a um prompt exigente (o prompt está no topo do vídeo em todos os quatro exemplos) que pede alguma justaposição de elementos que é demasiado fantástico para ter sido um exemplo de treinamento real. À direita, está uma saída de IA que adere muito melhor ao prompt:

Clique para reproduzir (sem áudio). À direita, vemos ‘factorizado’ WAN 2.2 realmente entregando nos prompts, em comparação com as interpretações vagas de ‘vanilla’ Wan 2.2., à esquerda. Por favor, consulte os arquivos de vídeo de origem para melhor resolução e muitos mais exemplos, embora as versões curadas vistas aqui não existam no site do projeto e tenham sido montadas para este artigo. Fonte

Bem, embora tenhamos que perdoar as mãos humanas do pato que bate palmas (!), está claro que os exemplos à direita aderem ao prompt de texto original muito melhor do que os da esquerda.

Interessantemente, ambas as arquiteturas apresentadas são essencialmente a mesma arquitetura – a popular e muito capaz Wan 2.2, uma versão chinesa que ganhou terreno significativo nas comunidades de código aberto e hobbyistas este ano.

A diferença é que o segundo pipeline gerativo é factorizado, o que, neste caso, significa que um grande modelo de linguagem (LLM) foi usado para reinterpretar o primeiro (semente) quadro do vídeo, para que seja muito mais fácil para o sistema entregar o que o usuário está pedindo.

Este ‘ancoramento visual’ envolve injetar uma imagem criada a partir deste prompt LLM melhorado no pipeline gerativo como um ‘quadro de início’, e usar um LoRA modelo interpretativo para ajudar a integrar o ‘intruso’ quadro no processo de criação de vídeo.

Os resultados, em termos de fidelidade do prompt, são bastante notáveis, particularmente para uma solução que parece bastante elegante:

Clique para reproduzir (sem áudio). Mais exemplos de gerações de vídeo ‘factorizadas’ realmente aderindo ao roteiro. Por favor, consulte os arquivos de vídeo de origem para melhor resolução e muitos mais exemplos, embora as versões curadas vistas aqui não existam no site do projeto e tenham sido montadas para este artigo.

Esta solução vem na forma de um novo artigo Factorized Video Generation: Decoupling Scene Construction and Temporal Synthesis in Text-to-Video Diffusion Models, e seu site de projeto acompanhante vídeo.

Enquanto muitos sistemas atuais tentam aumentar a precisão do prompt usando modelos de linguagem para reescrever prompts vagos ou subespecificados, o novo trabalho argumenta que essa estratégia ainda leva ao fracasso quando a representação interna de cena do modelo é defeituosa.

Mesmo com um prompt reescrito detalhado, os modelos de texto-para-vídeo frequentemente miscompoem elementos-chave ou geram estados iniciais incompatíveis que quebram a lógica da animação. Enquanto o primeiro quadro não refletir o que o prompt descreve, o vídeo resultante não pode se recuperar, independentemente de quão bom o modelo de movimento seja.

O artigo afirma*:

‘[Text-to-video] modelos frequentemente produzem quadros com deslocamento de distribuição, mas ainda assim alcançam [pontuações de avaliação] comparáveis aos modelos I2V, indicando que seu modelamento de movimento permanece razoavelmente natural, mesmo quando a fidelidade da cena é relativamente pobre.

‘[Image-to-Video] modelos exibem o comportamento complementar, fortes [pontuações de avaliação] de cenas iniciais precisas e coerência temporal mais fraca, enquanto I2V+texto equilibra ambos os aspectos.

‘Essa contraste sugere uma diferença estrutural nos modelos T2V atuais: a ancoragem da cena e a síntese temporal se beneficiam de induções distintas, mas as arquiteturas existentes tentam aprender ambas simultaneamente dentro de um único modelo.’

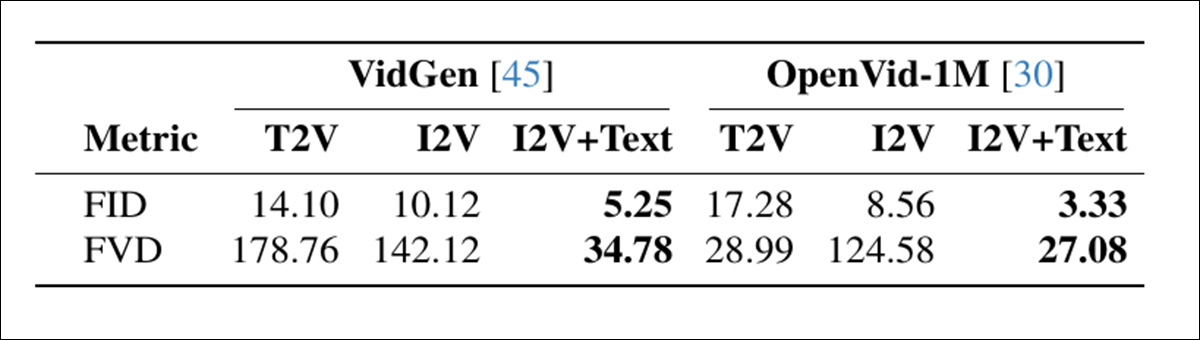

Uma comparação diagnóstica dos modos de geração encontrou que os modelos sem ancoragem de cena explícita pontuaram bem no movimento, mas frequentemente comprometeram o layout da cena, enquanto as abordagens condicionadas por imagem mostraram o padrão oposto:

Comparação dos modos de geração de vídeo em dois conjuntos de dados, mostrando que I2V+texto alcança a melhor qualidade de quadro (FID) e coerência temporal (FVD), destacando o benefício de separar a construção da cena do movimento. Fonte

Essas descobertas apontam para uma falha estrutural na qual os modelos atuais tentam aprender tanto o layout da cena quanto a animação de uma vez, embora as duas tarefas exijam diferentes tipos de indução, e são melhor tratadas separadamente.

Talvez o mais interessante seja que esse ‘truque’ pode potencialmente ser aplicado a instalações locais de modelos como Wan 2.1 e 2.2, e modelos de difusão de vídeo semelhantes, como Hunyuan Video. Anecdoticamente, comparando a qualidade da saída de hobbyistas com portais gerativos comerciais, como Kling e Runway, a maioria dos principais fornecedores de API parece estar melhorando as ofertas de código aberto, como WAN, com LoRAs, e – parece – com truques do tipo visto no novo artigo. Portanto, essa abordagem particular pode representar uma recuperação para o contingente FOSS.

Os testes realizados para o método indicam que essa abordagem simples e modular oferece um novo estado da arte no benchmark T2V-CompBench, melhorando significativamente todos os modelos testados. Os autores observam em conclusão que, embora seu sistema radicalmente melhore a fidelidade, não aborda (nem é feito para abordar) deriva de identidade, atualmente o azar da pesquisa de IA gerativa.

O novo artigo vem de quatro pesquisadores da Ecole Polytechnique Fédérale de Lausanne (EPFL) na Suíça.

Método e Dados

A proposição central da nova técnica é que os modelos de difusão de texto-para-vídeo (T2V) precisam ser ‘ancorados’ em quadros iniciais que realmente se encaixem no prompt de texto desejado.

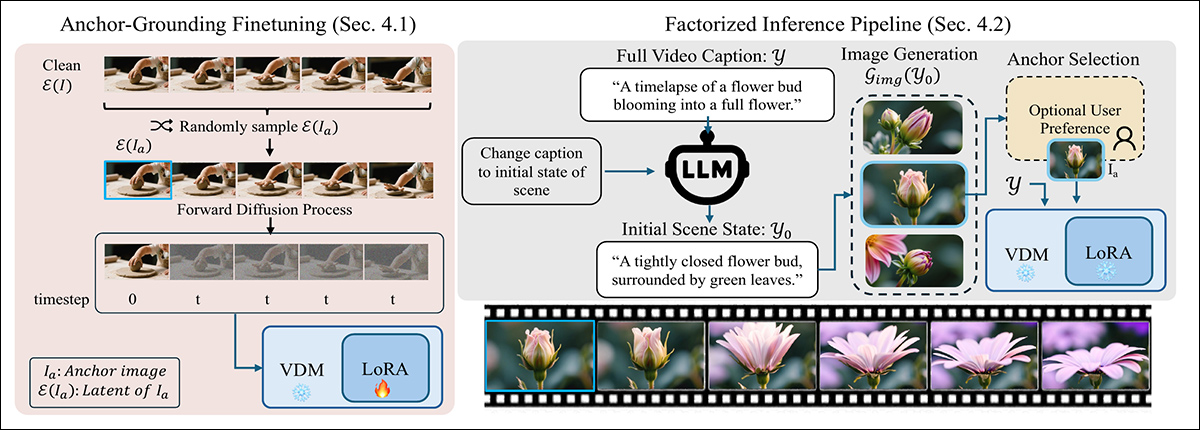

Para garantir que o modelo respeite o quadro inicial, o novo método interrompe o processo de difusão padrão injetando um latente limpo da imagem âncora no timestep zero, substituindo uma das entradas ruidosas usuais. Essa entrada desconhecida confunde o modelo no início, mas com um mínimo de finetuning LoRA, ele aprende a tratar o quadro injetado como uma âncora visual fixa em vez de parte da trajetória de ruído:

Um método de duas etapas para ancorar a geração de vídeo de texto-para-vídeo com uma âncora visual: à esquerda, o modelo é finetuned usando um LoRA leve para tratar um latente limpo injetado como uma restrição de cena fixa. À direita, o prompt é dividido em uma legenda de quadro inicial, que é usada para gerar a imagem âncora que orienta o vídeo.

Na inferência, o método reescreve o prompt para descrever apenas o primeiro quadro, usando um LLM para extrair um estado de cena inicial plausível focado no layout e aparência.

Esse prompt reescrito é passado para um gerador de imagens para produzir um quadro âncora candidato (que pode ser opcionalmente refinado pelo usuário). O quadro selecionado é codificado em um latente e injetado no processo de difusão, substituindo o primeiro timestep, permitindo que o modelo gere o restante do vídeo enquanto permanece ancorado na cena inicial – um processo que funciona sem exigir alterações na arquitetura subjacente.

O processo foi testado criando LoRAs para Wan2.2-14B, Wan2.1-1B e CogVideo1.5-5B. O treinamento LoRA foi realizado em um rank de 256, em 5000 cliques aleatoriamente amostrados da coleção UltraVideo.

O treinamento durou 6000 etapas e exigiu 48 horas de GPU para Wan-1B e CogVideo-5B, e 96 horas de GPU para Wan-14B. Os autores observam que Wan-5B suporta nativamente condicionamento de texto e texto-imagem (que estão sendo forçados sobre as estruturas mais antigas), e, portanto, não exigiu nenhum finetuning.

Testes

Nos experimentos realizados para o processo, cada prompt de texto foi inicialmente refinado usando Qwen2.5-7B-Instruct, que usou o resultado para gerar uma legenda de imagem ‘semente’ detalhada contendo uma descrição da cena inteira. Isso foi passado para QwenImage, que foi encarregado de gerar o ‘quadro mágico’ para ser interposto no processo de difusão.

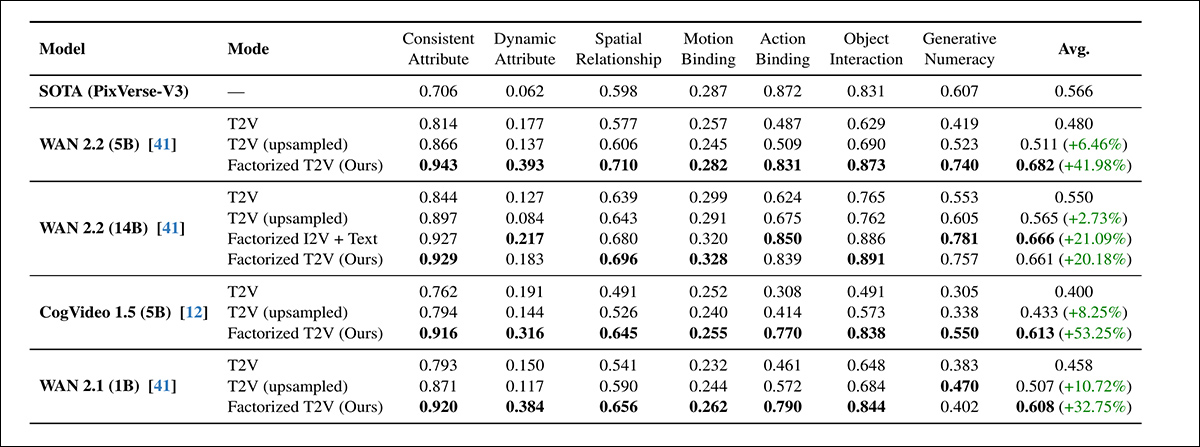

Os benchmarks usados para avaliar o sistema incluíram o mencionado T2V-CompBench, para testar a compreensão composicional, pontuando como os modelos preservam objetos, atributos e ações dentro de uma cena coerente; e VBench 2.0, para avaliar a razão e a consistência mais ampla em 18 métricas, agrupadas em criatividade, raciocínio de senso comum, controle, fidelidade humana e física:

Através de todas as sete categorias de avaliação do T2V-CompBench, o método T2V factorizado superou as linhas de base T2V padrão e upsampladas para todos os modelos testados, com ganhos que alcançam 53,25%. As variantes com pontuação mais alta frequentemente igualaram ou superaram o benchmark PixVerse-V3 proprietário.

Com relação a essa primeira rodada de testes, os autores afirmam*:

‘[Através] de todos os modelos, adicionar uma imagem âncora consistentemente melhora as performances composicionais. Todos os modelos Factorizados menores (CogVideo 5B, Wan 5B e Wan 1B) superam o modelo T2V Wan 14B maior.

‘Nossa Wan 5B factorizada também supera a linha de base comercial PixVerse-V3, que é o melhor modelo relatado no benchmark. Isso demonstra que o ancoramento visual melhora substancialmente a compreensão da cena e da ação, mesmo em modelos de capacidade menor.

‘Dentro de cada família de modelos, a versão factorizada supera o modelo original. Notavelmente, nossa LoRA ancorada leve em WAN 14B alcança um desempenho comparável ao seu variante I2V 14B pré-treinado (0,661 vs. 0,666), apesar de não exigir re-treinamento completo.’

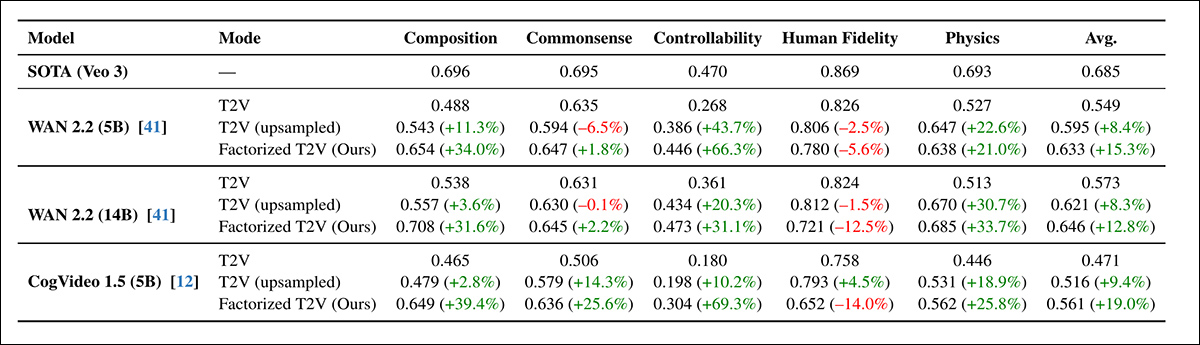

Em seguida, veio a rodada VBench2.0:

A abordagem T2V factorizada consistentemente melhorou o desempenho do VBench 2.0 em composição, raciocínio de senso comum, controle e física, com alguns ganhos excedendo 60% – embora a fidelidade humana tenha permanecido abaixo da linha de base Veo 3 proprietária.

Através de todas as arquiteturas, a abordagem factorizada aumentou as pontuações em todas as categorias do VBench, exceto fidelidade humana, que declinou ligeiramente, mesmo com upsampling do prompt. Wan 5B superou o maior Wan 14B, reforçando resultados anteriores do T2V-CompBench que o ancoramento visual contribuiu mais do que a escala.

Embora os ganhos no VBench tenham sido consistentes, eles foram menores do que os vistos no T2V-CompBench, e os autores atribuem isso ao regime de pontuação binária mais estrito do VBench.

Para os testes qualitativos, o artigo fornece imagens estáticas, mas nos referimos ao leitor para os vídeos compostos incorporados neste artigo, para uma ideia mais clara, com a ressalva de que os vídeos de origem são mais numerosos e diversificados, bem como possuem maior resolução e detalhe. Encontre-os aqui. Com relação aos resultados qualitativos, o artigo afirma:

‘Os vídeos ancorados consistentemente exibem uma composição de cena mais precisa, ligação de objeto-atributo mais forte e progressão temporal mais clara.’

A abordagem factorizada permaneceu estável, mesmo quando o número de etapas de difusão foi reduzido de 50 para 15, mostrando quase nenhuma perda de desempenho no T2V-CompBench. Em contraste, as linhas de base de texto-somente e upsampladas degradaram-se fortemente sob as mesmas condições.

Embora a redução de etapas pudesse teoricamente triplicar a velocidade, o pipeline de geração completo tornou-se apenas 2,1x mais rápido na prática, devido a custos fixos da geração de imagem âncora. Ainda assim, os resultados indicaram que o ancoramento não apenas melhorou a qualidade da amostra, mas também ajudou a estabilizar o processo de difusão, apoiando uma geração mais rápida e eficiente sem perda de precisão.

O site do projeto fornece exemplos de gerações upsampladas versus a nova abordagem, dos quais oferecemos alguns (resolução mais baixa) exemplos editados aqui:

Clique para reproduzir (sem áudio). Fontes de início upsampladas versus a abordagem factorizada dos autores.