Intelligenza Artificiale

AnimateLCM: accelerare l'animazione di modelli di diffusione personalizzati

Negli ultimi anni, i modelli di diffusione hanno ottenuto un enorme successo e riconoscimento per le attività di generazione di immagini e video. I modelli di diffusione video, in particolare, hanno guadagnato un'attenzione significativa grazie alla loro capacità di produrre video con elevata coerenza e fedeltà. Questi modelli generano video di alta qualità impiegando un processo iterativo di denoising nella loro architettura che trasforma gradualmente il rumore gaussiano ad alta dimensionalità in dati reali.

La diffusione stabile è uno dei modelli più rappresentativi per le attività di generazione di immagini, che si basa su un Variational AutoEncoder (VAE) per mappare l'immagine reale e le caratteristiche latenti sottocampionate. Ciò consente al modello di ridurre i costi generativi, mentre il meccanismo di attenzione incrociata nella sua architettura facilita la generazione di immagini condizionate dal testo. Più recentemente, il framework Stable Diffusion ha gettato le basi per diversi adattatori plug-and-play per ottenere una generazione di immagini o video più innovativa ed efficace. Tuttavia, il processo generativo iterativo impiegato dalla maggior parte dei modelli di diffusione video rende il processo di generazione delle immagini lungo e relativamente costoso, limitandone le applicazioni.

In questo articolo parleremo di AnimateLCM, un modello di diffusione personalizzato con adattatori mirato a generare video ad alta fedeltà con passaggi e costi computazionali minimi. Il framework AnimateLCM si ispira al modello di coerenza, che accelera il campionamento con passaggi minimi distillando modelli di diffusione delle immagini pre-addestrati. Inoltre, l'estensione di successo del modello di coerenza, il modello di coerenza latente (LCM), facilita la generazione di immagini condizionali. Invece di condurre l'apprendimento della coerenza direttamente sul set di dati video grezzi, il framework AnimateLCM propone l'utilizzo di una strategia di apprendimento della coerenza disaccoppiata. Questa strategia disaccoppia la distillazione dei precedenti di generazione del movimento e dei precedenti di generazione delle immagini, consentendo al modello di migliorare la qualità visiva del contenuto generato e migliorare contemporaneamente l'efficienza dell'addestramento. Inoltre, il modello AnimateLCM propone adattatori di training da zero o adattando adattatori esistenti al suo modello di coerenza video distillato. Ciò facilita la combinazione di adattatori plug-and-play nella famiglia dei modelli a diffusione stabile per ottenere diverse funzioni senza compromettere la velocità del campione.

Questo articolo si propone di approfondire il framework AnimateLCM. Esploreremo il meccanismo, la metodologia e l'architettura del framework, confrontandolo con i framework di generazione di immagini e video più all'avanguardia. Iniziamo.

AnimateLCM: Animazione di modelli di diffusione personalizzati

I modelli di diffusione sono stati il quadro di riferimento per le attività di generazione di immagini e video grazie alla loro efficienza e capacità nelle attività generative. La maggior parte dei modelli di diffusione si basa su un processo iterativo di denoising per la generazione di immagini che trasforma gradualmente un rumore gaussiano ad alta dimensione in dati reali. Sebbene il metodo fornisca risultati abbastanza soddisfacenti, il processo iterativo e il numero di campioni iterativi rallentano il processo di generazione e aumentano anche i requisiti computazionali dei modelli di diffusione che sono molto più lenti rispetto ad altri framework generativi come GAN o Reti del contraddittorio generativo. Negli ultimi anni, i Modelli di Coerenza o CM sono stati proposti come alternativa ai modelli di diffusione iterativi per accelerare il processo di generazione mantenendo costanti i requisiti computazionali.

Il punto forte dei modelli di coerenza è che apprendono mappature di coerenza che mantengono l'autoconsistenza delle traiettorie introdotte dai modelli di diffusione pre-addestrati. Il processo di apprendimento dei modelli di coerenza consente di generare immagini di alta qualità con passaggi minimi ed elimina inoltre la necessità di iterazioni ad alta intensità di calcolo. Inoltre, il modello di coerenza latente o LCM costruito sulla base del quadro di diffusione stabile può essere integrato nell'interfaccia utente web con gli adattatori esistenti per ottenere una serie di funzionalità aggiuntive come la traduzione da immagine a immagine in tempo reale. In confronto, sebbene i modelli di diffusione video esistenti forniscano risultati accettabili, i progressi devono ancora essere fatti nel campo dell'accelerazione dei campioni video, ed è di grande importanza a causa degli elevati costi computazionali di generazione video.

Questo ci porta ad AnimateLCM, un framework di generazione video ad alta fedeltà che richiede un numero minimo di passaggi per le attività di generazione video. Seguendo il modello di coerenza latente, il framework AnimateLCM tratta il processo di diffusione inversa come la risoluzione del flusso di probabilità aumentata CFG o Classifier Free Guidance e addestra il modello per prevedere la soluzione di tali flussi di probabilità direttamente nello spazio latente. Tuttavia, invece di condurre direttamente l'apprendimento coerente sui dati video grezzi che richiede formazione elevata e risorse computazionali e spesso porta a una scarsa qualità, il framework AnimateLCM propone una strategia di apprendimento coerente disaccoppiata che disaccoppia la distillazione coerente della generazione del movimento e della generazione di immagini a priori.

Il framework AnimateLCM esegue innanzitutto la distillazione della coerenza per adattare il modello di diffusione della base dell'immagine nel modello di coerenza dell'immagine, quindi esegue l'inflazione 3D sia sui modelli di coerenza dell'immagine che su quelli di diffusione dell'immagine per accogliere le funzionalità 3D. Alla fine, il framework AnimateLCM ottiene il modello di coerenza video eseguendo una distillazione della coerenza sui dati video. Inoltre, per alleviare la potenziale corruzione delle funzionalità come risultato del processo di diffusione, il framework AnimateLCM propone anche di utilizzare una strategia di inizializzazione. Poiché il framework AnimateLCM è costruito sopra il framework Stable Diffusion, può sostituire i pesi spaziali del suo modello di coerenza video addestrato con i pesi di diffusione delle immagini personalizzate disponibili al pubblico per ottenere risultati di generazione innovativi.

Inoltre, per addestrare adattatori specifici da zero o per adattarsi meglio agli adattatori disponibili al pubblico, il framework AnimateLCM propone un'efficace strategia di accelerazione per gli adattatori che non richiedono la formazione di modelli insegnanti specifici.

I contributi del framework AnimateLCM possono essere riassunti molto bene come: Il framework AnimateLCM proposto mira a ottenere una generazione di video di alta qualità, veloce e ad alta fedeltà e, per raggiungere questo obiettivo, il framework AnimateLCM propone una strategia di distillazione disaccoppiata che disaccoppia il movimento e l'immagine generazioni precedenti con conseguente migliore qualità della generazione e maggiore efficienza della formazione.

InstantID: metodologia e architettura

Fondamentalmente, il framework InstantID trae forte ispirazione dai modelli di diffusione e dalle strategie di velocità di campionamento. I modelli di diffusione, noti anche come modelli generativi basati su punteggi, hanno dimostrato notevoli capacità generative di immagini. Sotto la guida della direzione del punteggio, la strategia di campionamento iterativo implementata dai modelli di diffusione elimina gradualmente il rumore dai dati corrotti dal rumore. L’efficienza dei modelli di diffusione è uno dei motivi principali per cui vengono utilizzati dalla maggior parte delle persone modelli di diffusione video allenandosi su strati temporali aggiunti. D'altra parte, le strategie di velocità e accelerazione del campionamento aiutano ad affrontare le velocità di generazione lente nei modelli di diffusione. Il metodo di accelerazione basato sulla distillazione ottimizza i pesi di diffusione originali con un'architettura o uno scheduler raffinato per migliorare la velocità di generazione.

Andando avanti, il framework InstantID è costruito sul modello di diffusione stabile che consente a InstantID di applicare nozioni rilevanti. Il modello tratta il processo di diffusione diretta discreta come SDE che preserva la varianza nel tempo continuo. Inoltre, il modello di diffusione stabile è un'estensione del DDPM o modello probabilistico di diffusione di denoising, in cui il punto dati di addestramento viene perturbato gradualmente dalla catena di Markov discreta con un canile di perturbazione che consente la distribuzione di dati rumorosi in diversi passaggi temporali per seguire la distribuzione.

Per ottenere una generazione di video ad alta fedeltà con un numero minimo di passaggi, il framework AnimateLCM doma i modelli video stabili basati sulla diffusione per seguire la proprietà di autoconsistenza. La struttura complessiva della formazione del framework AnimateLCM consiste in una strategia di apprendimento coerente disaccoppiata per l'adattamento libero dell'insegnante e un apprendimento coerente efficace.

Transizione dai modelli di diffusione ai modelli di consistenza

Il framework AnimateLCM introduce il proprio adattamento del Modello di Diffusione Stabile o DM al Modello di Coerenza o CM seguendo la progettazione del Modello di Coerenza Latente o LCM. Vale la pena notare che, sebbene i modelli di diffusione stabile in genere prevedano il rumore aggiunto ai campioni, sono modelli di diffusione sigma essenziali. È in contrasto con i modelli di coerenza che mirano a prevedere direttamente la soluzione della traiettoria PF-ODE. Inoltre, nei modelli di diffusione stabile con determinati parametri, è essenziale che il modello utilizzi una strategia di guida priva di classificatore per generare immagini di alta qualità. Il framework AnimateLCM, tuttavia, utilizza un solutore ODE aumentato con guida senza classificatore per campionare le coppie adiacenti nelle stesse traiettorie, con conseguente migliore efficienza e migliore qualità. Inoltre, i modelli esistenti hanno indicato che la qualità della generazione e l’efficienza dell’addestramento sono fortemente influenzate dal numero di punti distinti nella traiettoria. Un numero inferiore di punti discreti accelera il processo di addestramento mentre un numero maggiore di punti discreti comporta una minore distorsione durante l'addestramento.

Apprendimento della coerenza disaccoppiato

Per il processo di distillazione della consistenza, gli sviluppatori hanno osservato che i dati utilizzati per l'addestramento influenzano fortemente la qualità della generazione finale dei modelli di consistenza. Tuttavia, il problema principale con i set di dati attualmente disponibili al pubblico è che spesso sono costituiti da dati di filigrana o sono di bassa qualità e potrebbero contenere didascalie eccessivamente brevi o ambigue. Inoltre, addestrare il modello direttamente su video ad alta risoluzione è costoso dal punto di vista computazionale e richiede tempo, rendendolo un'opzione non fattibile per la maggior parte dei ricercatori.

Data la disponibilità di set di dati filtrati di alta qualità, il framework AnimateLCM propone di disaccoppiare la distillazione dei movimenti a priori e dei priori di generazione delle immagini. Per essere più specifici, il framework AnimateLCM prima distilla i modelli di diffusione stabile in modelli di coerenza dell'immagine con set di dati di testo immagine filtrati di alta qualità con una migliore risoluzione. Il framework quindi addestra i pesi leggeri LoRA sugli strati del modello di diffusione stabile, congelando così i pesi del modello stabile modello di diffusione. Una volta che il modello ha messo a punto i pesi LoRA, funziona come un modulo di accelerazione versatile e ha dimostrato la sua compatibilità con altri modelli personalizzati nelle comunità a diffusione stabile. Per l'inferenza, il framework AnimateLCM unisce i pesi di LoRA con i pesi originali senza alterare la velocità di inferenza. Dopo che il framework AnimateLCM ha ottenuto il modello di coerenza a livello di generazione dell'immagine, congela i pesi del modello di diffusione stabile e i pesi LoRA su di esso. Inoltre, il modello gonfia i kernel di convoluzione 2D nei kernel pseudo-3D per addestrare i modelli di coerenza per la generazione video. Il modello aggiunge anche livelli temporali con inizializzazione zero e una connessione residua a livello di blocco. La configurazione generale aiuta a garantire che l'output del modello non venga influenzato quando viene addestrato per la prima volta. Il framework AnimateLCM, sotto la guida di modelli di diffusione video open source, addestra gli strati temporali estesi dai modelli di diffusione stabile.

È importante riconoscere che, sebbene i pesi spaziali LoRA siano progettati per accelerare il processo di campionamento senza tenere conto della modellazione temporale e i moduli temporali siano sviluppati tramite tecniche di diffusione standard, la loro integrazione diretta tende a corrompere la rappresentazione all'inizio dell'addestramento. Ciò presenta sfide significative nell'unirli in modo efficace ed efficiente con il minimo conflitto. Attraverso la ricerca empirica, il framework AnimateLCM ha identificato un approccio di inizializzazione efficace che non solo utilizza i priori di coerenza dei pesi spaziali LoRA, ma mitiga anche gli effetti negativi della loro combinazione diretta.

All'inizio dell'addestramento sulla coerenza, i pesi spaziali LoRA pre-addestrati vengono integrati esclusivamente nel modello di coerenza online, evitando l'inserimento del modello di coerenza target. Questa strategia garantisce che il modello target, che funge da guida didattica per il modello online, non generi previsioni errate che potrebbero influire negativamente sul processo di apprendimento del modello online. Durante il periodo di addestramento, i pesi LoRA vengono progressivamente incorporati nel modello di coerenza target tramite un processo di media mobile esponenziale (EMA), raggiungendo il bilanciamento ottimale dei pesi dopo diverse iterazioni.

Adattamento gratuito per gli insegnanti

I modelli a diffusione stabile e gli adattatori plug and play spesso vanno di pari passo. Tuttavia, è stato osservato che anche se gli adattatori plug and play funzionano in una certa misura, tendono a perdere il controllo nei dettagli anche quando la maggior parte di questi adattatori sono addestrati con modelli di diffusione dell'immagine. Per contrastare questo problema, il framework AnimateLCM opta per l'adattamento gratuito dell'insegnante, una strategia semplice ma efficace che adatta gli adattatori esistenti per una migliore compatibilità o addestra gli adattatori da zero o. L'approccio consente al framework AnimateLCM di ottenere la generazione di video controllabile e la generazione di immagini in video con un numero minimo di passaggi senza richiedere modelli dell'insegnante.

AnimateLCM: esperimenti e risultati

Il framework AnimateLCM utilizza Stable Diffusion v1-5 come modello base e implementa il solutore DDIM ODE per scopi di formazione. Il framework applica anche Stable Diffusion v1-5 con pesi di movimento open source come modello di diffusione video dell'insegnante con gli esperimenti condotti sul set di dati WebVid2M senza dati aggiuntivi o aumentati. Inoltre, il framework utilizza il set di dati TikTok con brevi istruzioni testuali con didascalie BLIP per la generazione di video controllabile.

Risultati qualitativi

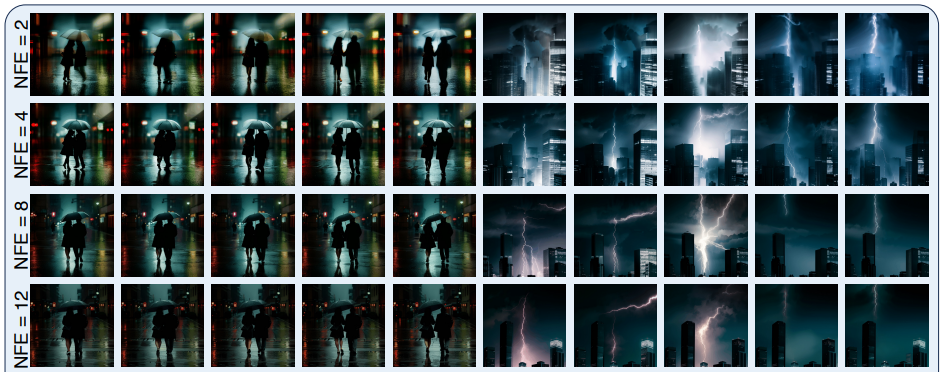

La figura seguente mostra i risultati del metodo di generazione in quattro fasi implementato dal framework AnimateLCM nella generazione da testo a video, da immagine a video e nella generazione di video controllabile.

Come si può osservare, i risultati forniti da ciascuno di essi sono soddisfacenti e i risultati generati dimostrano la capacità del framework AnimateLCM di seguire la proprietà di coerenza anche con passaggi di inferenza variabili, mantenendo movimento e stile simili.

Risultati quantitativi

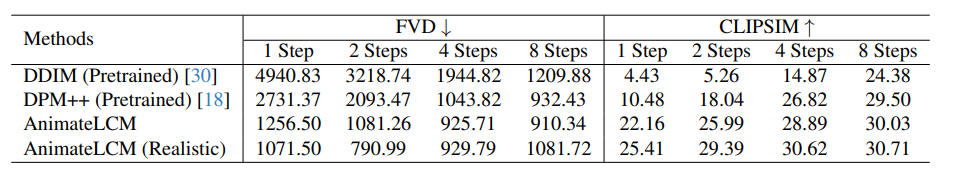

La figura seguente illustra i risultati quantitativi e il confronto del framework AnimateLCM con i metodi DDIM e DPM++ all'avanguardia.

Come si può osservare, il framework AnimateLCM supera i metodi esistenti con un margine significativo, soprattutto nel regime a passaggi bassi che vanno da 1 a 4 passaggi. Inoltre, i parametri AnimateLCM visualizzati in questo confronto vengono valutati senza utilizzare il CFG o la guida gratuita del classificatore che consente al framework di risparmiare quasi il 50% del tempo di inferenza e del costo di memoria di picco dell'inferenza. Inoltre, per convalidare ulteriormente le sue prestazioni, i pesi spaziali all'interno del framework AnimateLCM sono sostituiti con un modello realistico personalizzato disponibile al pubblico che raggiunge un buon equilibrio tra fedeltà e diversità, che aiuta a migliorare ulteriormente le prestazioni.

Considerazioni finali

In questo articolo abbiamo parlato di AnimateLCM, un modello di diffusione personalizzato con adattatori che mira a generare video ad alta fedeltà con passaggi e costi computazionali minimi. Il framework AnimateLCM si ispira al modello di coerenza che accelera il campionamento con passaggi minimi distillando modelli di diffusione di immagini pre-addestrati e all'estensione di successo del modello di coerenza, il modello di coerenza latente o LCM che facilita la generazione di immagini condizionali. Invece di condurre direttamente l'apprendimento della coerenza sul set di dati video non elaborati, il framework AnimateLCM propone di utilizzare una strategia di apprendimento della coerenza disaccoppiata che disaccoppia la distillazione dei precedenti di generazione del movimento e dei precedenti di generazione delle immagini, consentendo al modello di migliorare la qualità visiva del contenuto generato e migliorare contemporaneamente l’efficienza della formazione.