Angolo di Anderson

I modelli AI preferiscono la scrittura umana alla scrittura generata da AI

Secondo una nuova ricerca, ChatGPT e modelli simili mostrano ora un chiaro pregiudizio verso il testo che ritengono sia stato scritto da esseri umani, anche quando tale convinzione è errata. Il semplice fatto di etichettare un testo come “creato dall’uomo” induce i modelli AI a favorirlo – e, ironicamente, potrebbero apprendere questo pregiudizio da noi.

Le nozioni di autenticità, provenienza e condivisione di esperienze umane potrebbero avere un ruolo più importante nell’assalto dell’AI al settore della scrittura creativa di quanto sia stato finora evidente: test condotti per uno studio alla Princeton hanno scoperto che una serie di importanti modelli linguistici di codice chiuso e open source, tra cui ChatGPT, preferiscono ciò che ritengono essere testi “generati dall’uomo”.

Anche quando le etichette sui campioni di scrittura venivano invertite, sia i modelli AI che i partecipanti umani continuavano a trovare difetti nel testo scritto da AI, echeggiando le stesse critiche che avevano espresso quando era etichettato correttamente.

I ricercatori ritengono che parte del motivo potrebbe essere che la crescente ostilità umana nei confronti dell’AI generativa, che sembra manifestarsi in nuovi e interessanti eventi ogni giorno, potrebbe essere alimentata nei sistemi AI stessi. Notando la misura in cui l’AI disprezza la scrittura AI più di quanto non facciano gli esseri umani, affermano*:

‘I 13 modelli AI che abbiamo testato hanno dimostrato un pregiudizio del 34,3% rispetto ai 13,7 punti percentuali degli esseri umani, rendendoli 2,5 volte più suscettibili ai segnali di attribuzione rispetto ai nostri valutatori umani.

‘Questa amplificazione ha senso una volta che riconosciamo che i modelli contemporanei sono valutatori di preferenze. L’addestramento allineato attraverso il Reinforcement Learning from Human Feedback (RLHF) insegna esplicitamente ai modelli a trattare i giudizi umani come loro standard d’oro, installando efficacemente una priorità di affidabilità appresa.

‘I modelli imparano che deferire alle preferenze umane viene premiato, creando un’adulazione in cui echeggiano le attitudini degli utenti previste piuttosto che fornire una valutazione indipendente.’

I risultati si applicano al dominio della scrittura creativa, con i ricercatori che utilizzano storie di un noto autore francese come campioni di dati; e indicano che il pregiudizio umano contro l’AI potrebbe, in definitiva, superare qualsiasi miglioramento quantitativo nella costruzione del linguaggio che i Large Language Models (LLM) possano produrre man mano che evolvono – e che l’etichetta “AI” potrebbe forse significare “inautentico”, “sostitutivo” e persino “di seconda classe” in questo dominio.

Molti dei motivi si concentrano sulla pratica e sull’uso culturale: il documento indica che la creatività viene spesso descritta in termini di novità, valore e tipicità, cioè quanto nuovo sembra; quanto apprezzato dagli esperti; e quanto bene si adatta alla sua categoria. Quando un passaggio è etichettato come scritto dall’uomo, i tratti del genere familiare vengono premiati come preziosi; quando etichettato come AI generato, gli stessi tratti vengono respinti come non originali.

In effetti, rivelare la fonte provoca una rivalutazione del merito dell’opera, plasmata da assunzioni su come sia stata realizzata. Una volta che la paternità dell’AI viene resa nota, i lettori rifiutano istintivamente la possibilità di scoperta o intenzione individuale dietro l’output.

Il documento afferma*:

‘Nella maggior parte delle arti, non esiste uno standard d’oro per “abbastanza creativo”, rendendo le indicazioni di provenienza potenti primi che possono spostare quale criterio sembra più rilevante: artigianato disciplinato o novità vistosa, accessibilità o difficoltà.

‘Poiché gli osservatori spesso inferiscono il processo dal prodotto, le indicazioni di provenienza spingono i giudizi su come qualcosa sia stato realizzato, oltre a ciò che è: mosse conservative possono essere accreditate come artigianato da un essere umano, ma respinte come “semplice generazione” da un modello’.

Tredici modelli, tra cui varianti di ChatGPT, Claude, Gemini e Mistral, hanno preso parte insieme a lettori umani, con tutti che valutavano le storie in modo più favorevole quando veniva detto loro che erano state create dall’uomo, con i LLM che mostravano più pregiudizio degli esseri umani.

L’idea che i modelli AI possano aver assorbito un pregiudizio contro la loro stessa produzione solleva domande su dove abbia origine quel pregiudizio. Dal momento che la scrittura AI non è sempre facile da identificare, qualsiasi associazione negativa formata durante l’addestramento probabilmente deriva da esempi che vengono esplicitamente etichettati, sia attraverso copertura dei media di contenuti AI, o articoli auto-dichiarati generati da AI su pubblicazioni mainstream.

Il nuovo documento è intitolato Tutti preferiscono gli scrittori umani, compresa l’AI, e proviene da due scrittori del Center for Digital Humanities di Princeton. Il lavoro è accompagnato da una pubblicazione di dati correlati su Zenodo (con una versione GitHub citata nel documento, ma il repo non era attivo al momento della scrittura).

Metodo

Per esplorare come l’attribuzione influisca e formi le percezioni di stile e creatività, gli autori hanno utilizzato Exercices de style, un’opera eccentrica del 1947 di Raymond Queneau che riscrive una semplice aneddoto in 99 stili diversi. La storia segue un uomo che sale su un autobus, litiga con un altro passeggero e in seguito riceve consigli di moda da un amico.

Sebbene abbia origini letterarie, questa struttura anticipa trasformazioni basate su prompt nei moderni modelli linguistici, dove gli utenti richiedono riscritture in toni, voci o registri specifici. Questo processo era stato definito transstylization – un inquadramento ora ecoato nella ricerca AI nel contesto di Style Transfer. Mentre la maggior parte dei metodi computazionali si concentra su cambiamenti funzionali come spostamenti di sentimento o disintossicazione, le riscritture di Queneau mirano a un notevole contrasto stilistico.

Da una popolare traduzione inglese dell’opera di Queneau, sono stati selezionati trenta esercizi che hanno conservato la narrazione mentre coprivano un’ampia gamma stilistica. Tra questi erano inclusi forme vincolate come alexandrines e lipogrammi, cambi di registro come nobile o abuso, spostamenti narrativi come retrogrado e esitazione, e distorsioni giocose che coinvolgono spoonerismi, onomatopee o latino canino:

Esempi dallo studio che mostrano come GPT-4 abbia riscritto le storie di Queneau in diversi stili letterari, accoppiati con le descrizioni di stile che i valutatori umani e AI hanno visto durante il test. Fonte: https://arxiv.org/pdf/2510.08831

Poiché gli esperimenti di Queneau sono difficili da classificare, queste categorie sono solo raggruppamenti approssimativi, con l’intento non di testare il riconoscimento o la conformità al genere, ma piuttosto di creare condizioni diverse in cui (i lettori umani) e i modelli potrebbero rivelare i loro pregiudizi.

Per produrre controparti autorevoli AI per ogni stile selezionato, i ricercatori hanno utilizzato istruzioni intenzionalmente minimali. Ogni modello ha ricevuto la versione più semplice dell’aneddoto di Queneau (l’esercizio di apertura, Notazione), insieme a un breve istruzione per riscriverlo in uno stile specifico, come Riscrivi la storia come una versione di fantascienza. Questo approccio ha consentito di creare prompt che riflettevano lo spirito delle trasformazioni originali di Queneau, mentre consentivano ancora al modello di interpretare lo stile in modo libero.

Doppia visione

Il primo studio condotto dagli autori ha utilizzato GPT-4o per generare tutte e trenta le varianti di stile, poiché era il modello più avanzato disponibile al momento. L’uso di un singolo modello ha garantito output coerenti, aiutando a isolare l’effetto delle etichette di attribuzione, che lo studio ha cercato di testare.

Gli output non sono stati modificati per stile o tono, ad eccezione di elementi di cornice come Qui c’è la versione riscritta.

Nel secondo studio, il processo di generazione è stato ripetuto attraverso tredici grandi modelli linguistici: Qwen 2.5 72B Instruct, Mistral Nemo, Mistral Medium 3, Llama 4 Maverick, Llama 3.3 70B Instruct, Gemini 2.5 Flash, GPT-4o Mini, GPT-4o, GPT-3.5 Turbo Instruct, DeepSeek RI (0528), DeepSeek Chat v3 (0324), Cohere Command R (08-2024), Claude Sonnet 4, e Claude 3.5 Haiku.

Ogni modello ha ricevuto le stesse istruzioni e ha prodotto le proprie versioni dei trenta esercizi, producendo 420 storie riscritte in totale. Ciò ha consentito ai ricercatori di testare se gli effetti di attribuzione si mantenevano attraverso diversi autori AI, piuttosto che essere legati a un singolo modello.

Dati e test

I ricercatori hanno mostrato le stesse coppie di storie a diversi gruppi di persone, ma hanno cambiato le etichette per vedere quanto il nome dell’autore influenzava le opinioni: un gruppo non ha visto nomi di autori, solo etichette ‘A’ e ‘B’. Il secondo gruppo ha visto i nomi corretti, con una versione contrassegnata come scritta da un essere umano e l’altra contrassegnata come scritta da GPT-4o.

Un terzo gruppo ha visto i nomi scambiati, con la storia ‘AI’ contrassegnata come ‘umana’ e la versione ‘umana’ contrassegnata come ‘AI’:

Panoramica dello Studio 1. I giudici umani e AI hanno confrontato 30 paia di storie, ognuno contenente una versione scritta da Queneau e una da GPT-4. I giudici sono stati divisi in tre gruppi: uno non ha visto etichette di autore; uno ha visto etichette corrette; e uno ha visto etichette scambiate – un’impostazione progettata per testare la misura in cui i nomi degli autori influenzano le opinioni sullo stile di scrittura.

Studio 1

I ricercatori hanno diviso i 30 stili creati in insiemi più piccoli, con ogni partecipante allo studio che vedeva solo cinque stili, e ogni stile testato in tutte e tre le impostazioni di etichettatura.

Ogni partecipante ha visto solo un’impostazione di etichettatura: il gruppo cieco non ha visto menzione di AI, mentre gli altri gruppi hanno visto etichette autore corrette o invertite. L’assegnazione del gruppo, l’ordine della storia e la disposizione sinistra-destra sono stati tutti casualizzati.

I modelli AI hanno seguito lo stesso processo, ricevendo la stessa miscela di stili e la stessa casualizzazione. Ogni test è stato eseguito tre volte per modello per assicurarsi che i risultati fossero coerenti, rendendo possibile il confronto delle reazioni umane e AI alle etichette di autore.

Studio 2 ha utilizzato le stesse tre impostazioni di etichettatura del test precedente, ma ha esteso il test per includere tutte le 420 storie generate dai 14 diversi modelli LLM menzionati in precedenza. Ogni modello ha valutato ogni storia in ogni condizione di etichettatura, producendo 1.260 decisioni per modello, e risultando in 17.596 valutazioni valide:

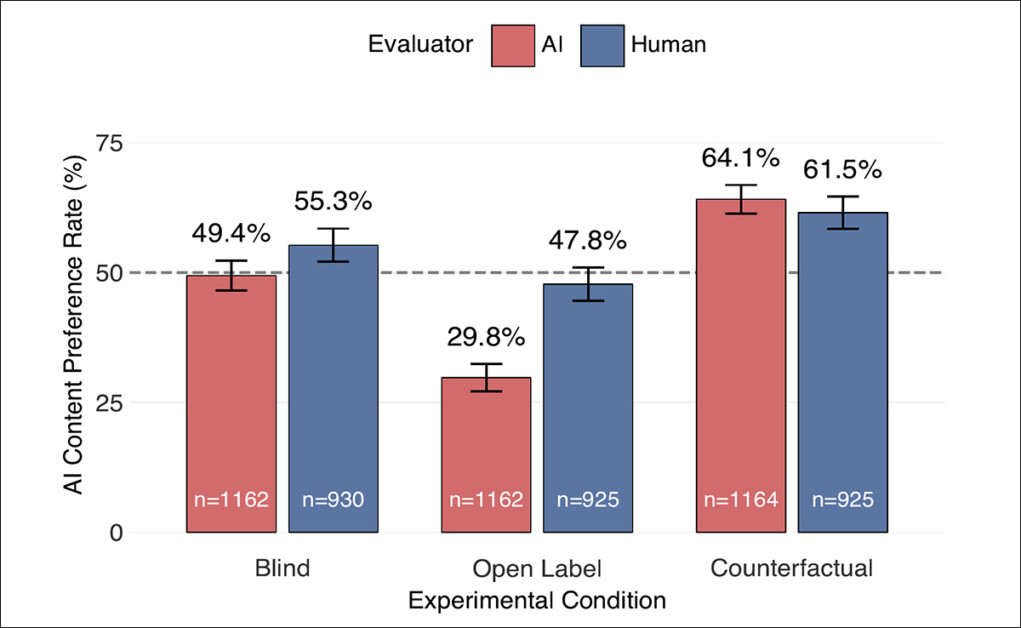

Risultati dello Studio 1. I giudici AI e umani hanno entrambi mostrato pregiudizio basato su etichette di autore. Quando non sono state mostrate etichette (Cieco), le preferenze erano quasi pari; quando sono state mostrate etichette corrette (Etichetta aperta), entrambi i gruppi hanno favorito il testo scritto dall’uomo; e quando le etichette sono state invertite (Controfattuale), entrambi i gruppi sono passati a favorire il testo che credevano fosse umano – e questo effetto è stato molto più forte nei modelli AI che negli esseri umani. Le barre di errore mostrano intervalli di confidenza del 95%.

Tra tutti e tredici i modelli, il modello ha corrisposto al pregiudizio umano, ma è stato molto più forte: senza etichette, i sistemi AI hanno valutato i testi umani e AI quasi allo stesso modo, scegliendo il testo AI il 49,4% delle volte; quando l’etichetta AI era visibile, la preferenza è scesa bruscamente al 29,8%, mostrando un chiaro svilimento del lavoro AI riconosciuto; e quando lo stesso testo era etichettato come umano, la preferenza è salita al 64,1%.

La differenza tra le due condizioni di etichettatura è stata del 34,3%, il che significa che i modelli AI hanno cambiato la loro preferenza molto di più degli esseri umani quando le etichette sono state scambiate. Inoltre, i modelli sono stati altamente coerenti tra esecuzioni ripetute, confermando che il pregiudizio era stabile piuttosto che casuale.

Per verificare se il pregiudizio fosse causato dalla formulazione delle etichette piuttosto che da chi ha scritto il testo, i ricercatori hanno eseguito due test aggiuntivi: uno ha utilizzato etichette che facevano sembrare l’AI più impressionante; e l’altro ha utilizzato termini neutrali come ‘autore AI’ e ‘autore umano’.

Entrambi hanno mostrato lo stesso pregiudizio, e anche quando i modelli AI producevano la stessa risposta ogni volta, il pregiudizio persisteva, indicando che il pregiudizio è causato dal tipo di etichetta (‘umano’ o ‘AI’), piuttosto che dalle parole esatte utilizzate.

Studio 2

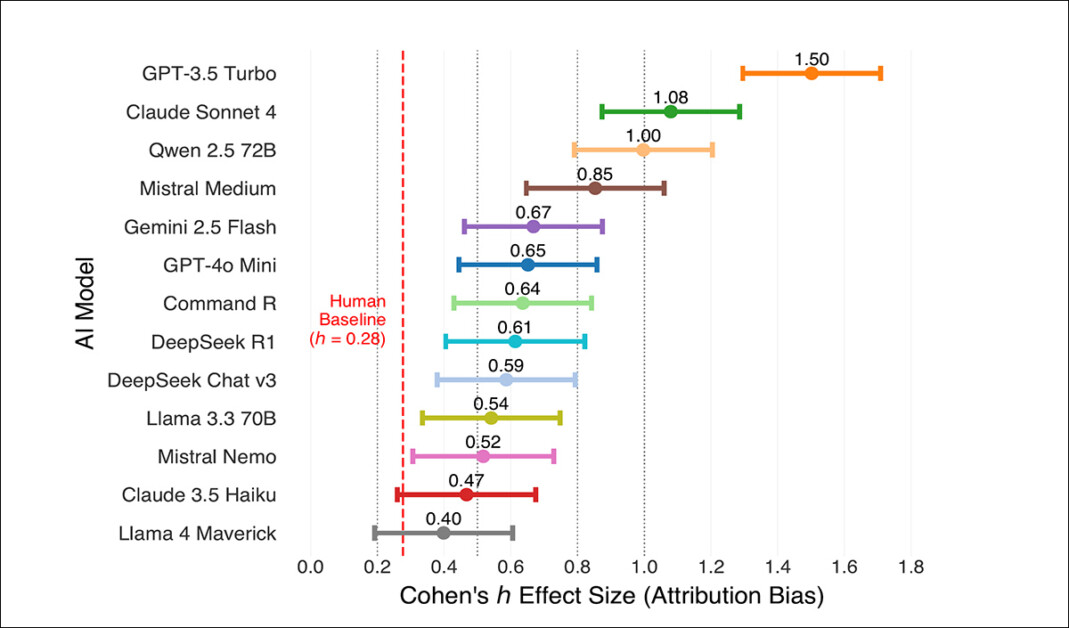

Il secondo studio ha trovato lo stesso pregiudizio pro-umano in tutti e 13 i modelli AI, indipendentemente dall’architettura o dal fornitore:

Pregiudizio di attribuzione per ciascuno dei 13 modelli AI: le barre mostrano le dimensioni degli effetti con intervalli di confidenza del 95%, e la linea rossa segna la linea di base umana. Tutti i modelli hanno mostrato un pregiudizio più forte degli esseri umani, con solo piccole differenze tra loro.

Ogni modello ha preferito storie etichettate come scritte dall’uomo, con effetti più forti di quelli osservati nelle persone. Anche dopo aver rimosso il caso più estremo, il pregiudizio medio è rimasto più del doppio di quello umano, suggerendo che l’effetto non è un difetto in un modello, ma una caratteristica condivisa dei LLM in generale.

Conclusione

Sebbene, come nota il documento, studi precedenti abbiano mostrato che l’AI può produrre scritti pari o persino migliori di quelli umani, gli autori sottolineano che nella letteratura, il valore attribuito all’autore e all’autenticità è una convenzione vecchia e profondamente radicata:

‘Quando GPT-4o Mini respinge l’approccio “creativo e umoristico” di Queneau come “esagerato” sotto l’etichetta di attribuzione AI, mentre elogia caratteristiche identiche sotto l’etichetta umana, implicitamente rivela come queste etichette scatenino assunzioni che nessun processo psicologico autentico sia avvenuto.

‘Le indicazioni di provenienza contrabbandano il processo in ciò che potrebbe altrimenti essere un giudizio di prodotto: la “semplice generazione” sembra accettabile da un artigiano umano (giudicato come abile artigianato), ma sospetto da un modello (giudicato come ricombinazione algoritmica).’

I LLM non sono ancora abbastanza affidabili per la ricerca basata su fatti senza supervisione, sebbene una supervisione attenta possa ancora renderli produttivi – ma la scrittura creativa basata su LLM potrebbe affrontare un futuro più incerto, se le opere creative generate da AI diventassero stigmatizzate attraverso una più ampia disapprovazione pubblica dell’intrusione dell’AI nei domini umani, piuttosto che basate sul merito letterario.

Le implicazioni dei risultati di studi di questo tipo sono influenzate notevolmente dalla disposizione delle aziende e degli utenti individuali a essere onesti sul fatto che l’AI abbia contribuito o meno al loro output. In alcuni casi, una riluttanza ad ammettere tale utilizzo potrebbe avere più a che fare con pirateria di copyright aziendale che con la preoccupazione che il pubblico accetti le opere creative generate da AI.

Tuttavia, soluzioni legali, finanziarie e politiche sono possibili (sebbene molto impegnative) riguardo al copyright. Se si possa mai far sì che le persone apprezzino il lavoro creativo AI che non ha una singola mente umana relazionabile alla guida – potrebbe essere una prospettiva ancora più difficile.

* Si prega di fare riferimento al documento di origine per le citazioni in linea omesse. Come necessario, queste saranno incluse nell’articolo.

Pubblicato per la prima volta lunedì, 13 ottobre 2025