Intelligence artificielle

Guidance d’auto-attention : amélioration de la qualité des échantillons de modèles de diffusion

Les modèles de diffusion de débruitage sont des cadres d’intelligence artificielle générative qui synthétisent des images à partir de bruit via un processus de débruitage itératif. Ils sont célébrés pour leurs capacités exceptionnelles de génération d’images et de diversité, attribuées en grande partie aux méthodes de guidage conditionnelles basées sur du texte ou des classes, notamment la guidage de classeur et la guidage sans classeur. Ces modèles ont été remarquablement réussis dans la création d’images diverses et de haute qualité. Des études récentes ont montré que les techniques de guidage telles que les légendes de classe et les étiquettes jouent un rôle crucial dans l’amélioration de la qualité des images générées par ces modèles.

Cependant, les modèles de diffusion et les méthodes de guidage sont limités dans certaines conditions externes. La méthode de guidage sans classeur (CFG), qui utilise la suppression d’étiquettes, ajoute de la complexité au processus d’entraînement, tandis que la méthode de guidage de classeur (CG) nécessite un entraînement de classeur supplémentaire. Les deux méthodes sont quelque peu limitées par leur dépendance à l’égard de conditions externes difficiles à obtenir, ce qui limite leur potentiel et les confine à des paramètres conditionnels.

Pour remédier à ces limitations, les développeurs ont formulé une approche plus générale de guidage de diffusion, connue sous le nom de guidage d’auto-attention (SAG). Cette méthode utilise les informations provenant d’échantillons intermédiaires de modèles de diffusion pour générer des images. Nous allons explorer le SAG dans cet article, en discutant son fonctionnement, sa méthodologie et ses résultats par rapport aux cadres et pipelines actuels de pointe.

Guidance d’auto-attention : amélioration de la qualité des échantillons de modèles de diffusion

Les modèles de diffusion de débruitage (DDM) ont gagné en popularité pour leur capacité à créer des images à partir de bruit via un processus de débruitage itératif. La puissance de synthèse d’images de ces modèles est en grande partie due aux méthodes de guidage de diffusion employées. Malgré leurs forces, les modèles de diffusion et les méthodes de guidage basées sur celles-ci sont confrontés à des défis tels que la complexité ajoutée et les coûts de calcul accrus.

Pour surmonter les limitations actuelles, les développeurs ont introduit la méthode de guidage d’auto-attention, une formulation plus générale de guidage de diffusion qui ne repose pas sur les informations externes provenant du guidage de diffusion, facilitant ainsi une approche condition-free et flexible pour guider les cadres de diffusion. L’approche choisie par le guidage d’auto-attention améliore finalement l’applicabilité des méthodes de guidage de diffusion traditionnelles aux cas avec ou sans exigences externes.

Le guidage d’auto-attention repose sur le principe simple de formulation généralisée, et sur l’hypothèse que les informations internes contenues dans les échantillons intermédiaires peuvent servir de guidage. Sur la base de ce principe, la méthode SAG introduit d’abord le guidage de flou, une solution simple et directe pour améliorer la qualité des échantillons. Le guidage de flou vise à exploiter les propriétés benignes du flou gaussien pour supprimer les détails à fine échelle de manière naturelle en guidant les échantillons intermédiaires à l’aide des informations éliminées à la suite du flou gaussien. Bien que la méthode de guidage de flou améliore la qualité des échantillons avec une échelle de guidage modérée, elle échoue à reproduire les résultats sur une grande échelle de guidage, car elle introduit souvent une ambiguïté structurelle dans les régions entières. Par conséquent, la méthode de guidage de flou a du mal à aligner la prédiction de l’entrée originale avec la prédiction de l’entrée dégradée.

Pour améliorer la stabilité et l’efficacité de la méthode de guidage de flou sur une plus grande échelle de guidage, le guidage d’auto-attention tente d’exploiter le mécanisme d’auto-attention des modèles de diffusion, car les modèles de diffusion modernes contiennent déjà un mécanisme d’auto-attention dans leur architecture.

En supposant que l’auto-attention est essentielle pour capturer les informations saillantes à son cœur, la méthode de guidage d’auto-attention utilise les cartes d’auto-attention des modèles de diffusion pour brouiller de manière adverse les régions contenant des informations saillantes, et dans le processus, guide les modèles de diffusion avec les informations résiduelles requises. La méthode utilise ensuite les cartes d’attention pendant le processus inverse des modèles de diffusion pour améliorer la qualité des images et utilise l’auto-conditionnement pour réduire les artefacts sans nécessiter d’entraînement ou d’informations externes supplémentaires.

Pour résumer, la méthode de guidage d’auto-attention

- Est une approche novatrice qui utilise les cartes d’auto-attention internes des cadres de diffusion pour améliorer la qualité des échantillons d’images générés sans nécessiter d’entraînement ou de conditions externes supplémentaires.

- La méthode SAG tente de généraliser les méthodes de guidage conditionnelles en une méthode condition-free qui peut être intégrée à tout modèle de diffusion sans nécessiter de ressources ou de conditions externes supplémentaires, améliorant ainsi l’applicabilité des cadres de guidage basés sur les conditions.

- La méthode SAG tente également de démontrer ses capacités orthogonales par rapport aux méthodes et cadres conditionnels existants, facilitant ainsi une amélioration des performances en permettant une intégration flexible avec d’autres méthodes et modèles.

En poursuivant, la méthode de guidage d’auto-attention apprend des résultats des cadres associés, notamment les modèles de diffusion de débruitage, la guidage d’échantillonnage, les méthodes d’auto-attention de l’intelligence artificielle générative et les représentations internes des modèles de diffusion. Cependant, à son cœur, la méthode de guidage d’auto-attention met en œuvre les enseignements des DDPM ou des modèles de diffusion de débruitage probabilistes, de la guidage de classeur, de la guidage sans classeur et de l’auto-attention dans les cadres de diffusion. Nous allons en discuter en profondeur dans la section suivante.

Guidage d’auto-attention : préliminaires, méthodologie et architecture

Modèle de diffusion de débruitage probabiliste ou DDPM

Le DDPM ou le modèle de diffusion de débruitage probabiliste est un modèle qui utilise un processus de débruitage itératif pour récupérer une image à partir de bruit blanc. Traditionnellement, un modèle DDPM reçoit une image d’entrée et un calendrier de variance à un moment pour obtenir l’image en utilisant un processus avant appelé processus markovien.

Guidage de classeur et guidage sans classeur avec mise en œuvre de GAN

Les réseaux antagonistes génératifs (GAN) possèdent un échange unique entre la diversité et la fidélité, et pour apporter cette capacité des cadres GAN aux modèles de diffusion, le cadre de guidage d’auto-attention propose d’utiliser une méthode de guidage de classeur qui utilise un classeur supplémentaire. Inversement, une méthode de guidage sans classeur peut également être mise en œuvre sans utiliser de classeur pour atteindre les mêmes résultats. Bien que la méthode livre les résultats souhaités, elle n’est pas viable sur le plan computationnel car elle nécessite des étiquettes supplémentaires et confine le cadre à des modèles de diffusion conditionnels qui nécessitent des conditions supplémentaires comme un texte ou une classe, ainsi que des détails d’entraînement supplémentaires qui ajoutent à la complexité du modèle.

Généralisation du guidage de diffusion

Bien que les méthodes de guidage de classeur et de guidage sans classeur livrent les résultats souhaités et aident à la génération conditionnelle dans les modèles de diffusion, elles dépendent d’entrées supplémentaires. Pour tout moment donné, l’entrée pour un modèle de diffusion comprend une condition généralisée et un échantillon perturbé sans la condition généralisée. De plus, la condition généralisée englobe les informations internes dans l’échantillon perturbé ou une condition externe, ou les deux. Le guidage résultant est formulé en utilisant un régresseur imaginaire avec l’hypothèse qu’il peut prédire la condition généralisée.

Amélioration de la qualité d’image en utilisant les cartes d’auto-attention

Le guidage de diffusion généralisé implique qu’il est possible de fournir un guidage au processus inverse des modèles de diffusion en extrayant les informations saillantes dans la condition généralisée contenue dans l’échantillon perturbé. En s’appuyant sur le même principe, la méthode de guidage d’auto-attention capture les informations saillantes pour les processus inverses de manière efficace tout en limitant les risques qui découlent des problèmes de distribution hors de l’entraînement préalable dans les modèles de diffusion.

Guidage de flou

Le guidage de flou dans le guidage d’auto-attention repose sur le flou gaussien, une méthode de filtrage linéaire dans laquelle le signal d’entrée est convolué avec un filtre gaussien pour générer une sortie. Avec une augmentation de l’écart-type, le flou gaussien réduit les détails à fine échelle dans les signaux d’entrée et aboutit à des signaux d’entrée localement indiscernables en les lissant vers la constante. De plus, les expériences ont indiqué un déséquilibre d’informations entre le signal d’entrée et la sortie du signal de flou gaussien où le signal de sortie contient plus d’informations à fine échelle.

Sur la base de cette connaissance, le cadre de guidage d’auto-attention introduit le guidage de flou, une technique qui exclut intentionnellement les informations des reconstructions intermédiaires pendant le processus de diffusion, et utilise ces informations pour guider ses prédictions vers l’augmentation de la pertinence des images par rapport aux informations d’entrée. Le guidage de flou entraîne essentiellement la déviation de la prédiction originale par rapport à la prédiction de l’entrée floue. De plus, la propriété bénigne du flou gaussien empêche les signaux de sortie de s’écarter significativement du signal original avec une déviation modérée. En termes simples, le flou se produit naturellement dans les images, ce qui rend le flou gaussien une méthode plus appropriée pour les modèles de diffusion pré-entraînés.

Dans le pipeline de guidage d’auto-attention, le signal d’entrée est d’abord floué en utilisant un filtre gaussien, puis diffusé avec du bruit supplémentaire pour produire le signal de sortie. En faisant cela, le pipeline SAG atténue l’effet secondaire du flou résultant qui réduit le bruit gaussien, et fait en sorte que le guidage repose sur le contenu plutôt que sur le bruit aléatoire.

Ces résultats peuvent être le résultat de l’ambiguïté structurelle introduite dans le cadre par le flou global qui rend difficile pour le pipeline SAG d’aligner les prédictions de l’entrée originale avec la prédiction de l’entrée dégradée, aboutissant à des sorties bruyantes.

Mécanisme d’auto-attention

Comme mentionné précédemment, les modèles de diffusion ont généralement un composant d’auto-attention intégré, et il s’agit de l’un des composants les plus essentiels dans un cadre de modèle de diffusion. Le mécanisme d’auto-attention est mis en œuvre au cœur des modèles de diffusion, et il permet au modèle de prêter attention aux parties saillantes de l’entrée pendant le processus génératif, comme le montre l’image suivante avec des masques à haute fréquence dans la rangée supérieure, et des masques d’auto-attention dans la rangée inférieure des images finalement générées.

La méthode de guidage d’auto-attention proposée repose sur le même principe et exploite les capacités des cartes d’auto-attention dans les modèles de diffusion. Dans l’ensemble, la méthode de guidage d’auto-attention floue les patchs auto-attentionnés dans le signal d’entrée ou, en termes simples, dissimule les informations des patchs auxquels les modèles de diffusion prêtent attention. De plus, les signaux de sortie dans le guidage d’auto-attention contiennent des régions intactes des signaux d’entrée, ce qui signifie qu’il ne résulte pas en une ambiguïté structurelle des entrées, et résout le problème de flou global. Le pipeline obtient ensuite les cartes d’auto-attention agrégées en effectuant un poolage moyen global (GAP) pour agréger les cartes d’auto-attention à la dimension, et en effectuant un échantillonnage le plus proche pour faire correspondre la résolution du signal d’entrée.

Guidage d’auto-attention : expériences et résultats

Pour évaluer ses performances, le pipeline de guidage d’auto-attention est échantillonné en utilisant 8 GPU Nvidia GeForce RTX 3090, et est construit sur les cadres IDDPM, ADM et Stable Diffusion pré-entraînés.

Génération inconditionnelle avec guidage d’auto-attention

Pour mesurer l’efficacité du pipeline SAG sur les modèles inconditionnels et démontrer la propriété condition-free non possédée par la guidage de classeur et la guidage sans classeur, le pipeline SAG est exécuté sur des cadres pré-entraînés de manière inconditionnelle sur 50 000 échantillons.

Comme on peut l’observer, la mise en œuvre du pipeline SAG améliore les métriques FID, sFID et IS de l’entrée inconditionnelle tout en réduisant la valeur de rappel en même temps. De plus, les améliorations qualitatives résultant de la mise en œuvre du pipeline SAG sont évidentes dans les images suivantes où les images du haut sont les résultats des cadres ADM et Stable Diffusion, tandis que les images du bas sont les résultats des cadres ADM et Stable Diffusion avec le pipeline SAG.

Génération conditionnelle avec SAG

L’intégration du pipeline SAG dans les cadres existants livre des résultats exceptionnels dans la génération inconditionnelle, et le pipeline SAG est capable d’agnosticité de condition qui permet au pipeline SAG d’être mis en œuvre pour la génération conditionnelle.

Stable Diffusion avec guidage d’auto-attention

Même si le cadre Stable Diffusion original génère des images de haute qualité, l’intégration du cadre Stable Diffusion avec le pipeline de guidage d’auto-attention peut améliorer considérablement les résultats. Pour évaluer son effet, les développeurs utilisent des invites vides pour Stable Diffusion avec une graine aléatoire pour chaque paire d’images, et utilisent une évaluation humaine sur 500 paires d’images avec et sans guidage d’auto-attention. Les résultats sont présentés dans l’image suivante.

De plus, la mise en œuvre du SAG peut améliorer les capacités du cadre Stable Diffusion, car la fusion de la guidage sans classeur avec le guidage d’auto-attention peut élargir la gamme des modèles Stable Diffusion à la synthèse d’image à partir de texte. De plus, les images générées par le modèle Stable Diffusion avec le guidage d’auto-attention sont de meilleure qualité avec moins d’artefacts grâce à l’effet d’auto-conditionnement du pipeline SAG, comme le montre l’image suivante.

Limitations actuelles

Bien que la mise en œuvre du pipeline de guidage d’auto-attention puisse améliorer considérablement la qualité des images générées, il comporte certaines limitations.

L’une des principales limitations est l’orthogonalité avec la guidage de classeur et la guidage sans classeur. Comme on peut l’observer dans l’image suivante, la mise en œuvre du SAG améliore le score FID et le score de prédiction, ce qui signifie que le pipeline SAG contient un composant orthogonal qui peut être utilisé avec les méthodes de guidage traditionnelles simultanément.

Cependant, il nécessite encore que les modèles de diffusion soient entraînés d’une manière spécifique qui ajoute à la complexité ainsi qu’aux coûts de calcul.

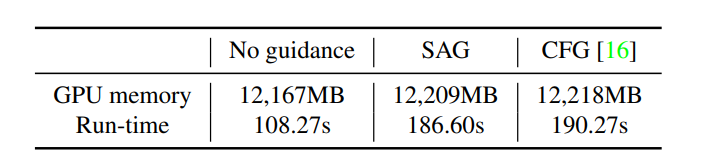

De plus, la mise en œuvre du guidage d’auto-attention n’augmente pas la consommation de mémoire ou de temps, indication que la surcharge résultant des opérations comme le masquage et le flou dans le SAG est négligeable. Cependant, il ajoute encore aux coûts de calcul car il inclut une étape supplémentaire par rapport aux approches sans guidage.

Pensées finales

Dans cet article, nous avons discuté du guidage d’auto-attention, une formulation novatrice et générale de la méthode de guidage qui utilise les informations internes disponibles dans les modèles de diffusion pour générer des images de haute qualité. Le guidage d’auto-attention repose sur le principe simple de formulation généralisée, et sur l’hypothèse que les informations internes contenues dans les échantillons intermédiaires peuvent servir de guidage. Le pipeline de guidage d’auto-attention est une approche condition-free et sans entraînement qui peut être mise en œuvre sur divers modèles de diffusion, et utilise l’auto-conditionnement pour réduire les artefacts dans les images générées, et améliore la qualité globale.