Inteligencia artificial

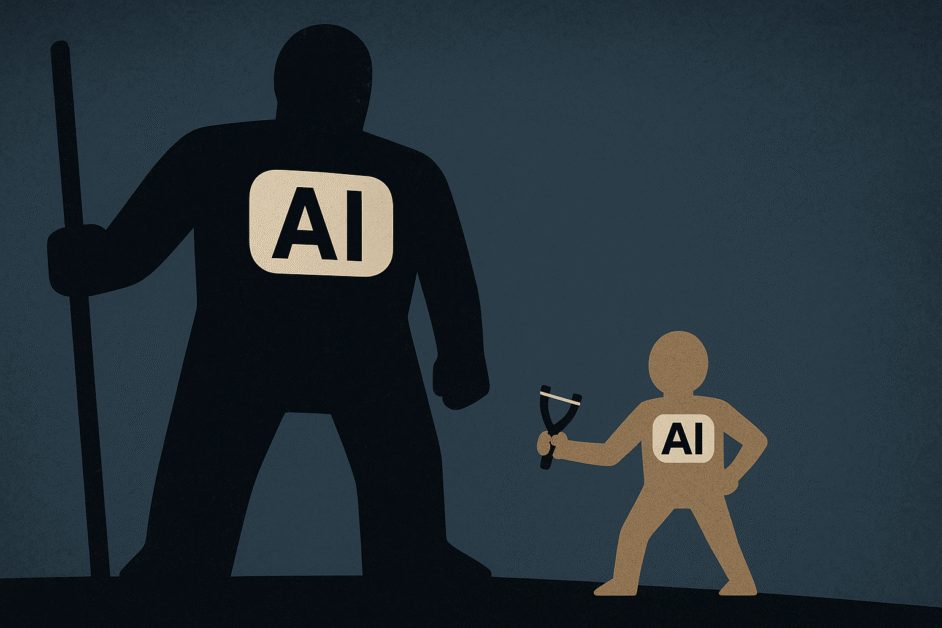

La Revuelta del Modelo Pequeño: Por Qué el Pequeño Inteligencia Artificial Superó a los Gigantes de los Modelos de Lenguaje

En los últimos años, la inteligencia artificial ha estado marcada por la carrera para construir modelos cada vez más grandes. Cada nuevo lanzamiento se ha medido por la cantidad de parámetros, el tamaño de los datos de entrenamiento y la escala de la infraestructura detrás de él. Se asumió que más grande significaba mejor. Mientras que los gigantes tecnológicos continúan construyendo modelos de lenguaje cada vez más masivos con cientos de miles de millones de parámetros, una revolución silenciosa está teniendo lugar. Los modelos de inteligencia artificial pequeños, a menudo miles de veces más pequeños que sus contrapartes gigantes, están logrando un rendimiento comparable y sometimes superior en tareas específicas. Este cambio desafía todo lo que creíamos saber sobre la escalabilidad de la inteligencia artificial y abre nuevas posibilidades para la inteligencia artificial democratizada y eficiente.

La Historia de David y Goliat de la Inteligencia Artificial Moderna

Durante años, la industria de la inteligencia artificial operó bajo la suposición de que los modelos más grandes proporcionan un mejor rendimiento. La serie GPT de OpenAI creció de 117 millones de parámetros a más de 175 mil millones. El PaLM de Google alcanzó 540 mil millones de parámetros. Las grandes empresas tecnológicas han invertido miles de millones de dólares en entrenar estos modelos y están invirtiendo aún más para construir modelos aún más grandes. En esta situación, cuando la cantidad de parámetros se convirtió en un factor clave para determinar la capacidad del modelo y la construcción de la capacidad de inteligencia artificial se convirtió en una carrera de recursos computacionales y gastos de infraestructura, un fenómeno interesante comenzó a ocurrir en laboratorios de investigación de todo el mundo.

Los ingenieros comenzaron a descubrir que los modelos más pequeños y cuidadosamente diseñados podían igualar o superar el rendimiento de estos gigantes en tareas específicas. La serie Phi de Microsoft demostró que un modelo de 2.700 millones de parámetros podía competir con modelos diez veces más grandes. El LLaMA de Meta demostró que los modelos de 7 mil millones de parámetros podían entregar resultados excepcionales cuando se entrenaban adecuadamente. Estos desarrollos representan un cambio fundamental en nuestra comprensión de la eficiencia de la inteligencia artificial.

Este cambio de paradigma tiene implicaciones significativas en la forma en que se utiliza y opera la inteligencia artificial. Los modelos pequeños pueden ejecutarse en hardware de consumo, procesar solicitudes más rápido y consumir una fracción de la energía necesaria para los modelos grandes. Hacen que la inteligencia artificial sea accesible para las organizaciones que no pueden permitirse una infraestructura computacional masiva. Lo más importante, desafían las tendencias monopolísticas del desarrollo de la inteligencia artificial, donde solo las empresas con vastos recursos podían competir.

El Auge de la Arquitectura de Inteligencia Artificial Eficiente

La revolución del modelo pequeño se basa en enfoques de ingeniería sofisticados que maximizan el rendimiento dentro de presupuestos de parámetros limitados. Estos modelos emplean técnicas avanzadas como la destilación de conocimiento, donde los modelos “estudiantes” más pequeños aprenden de los modelos “maestros” más grandes, capturando el conocimiento esencial mientras reducen drásticamente los requisitos computacionales.

La serie Phi-4 de Microsoft ejemplifica este enfoque. El modelo de razonamiento Phi-4, con solo 14 mil millones de parámetros, compite con modelos cinco veces más grandes en razonamiento matemático y resolución de problemas lógicos. De manera similar, el modelo Gemma 3 270M de Google demuestra que un modelo compacto de 270 millones de parámetros puede entregar capacidades sólidas de seguimiento de instrucciones y servir como una excelente base para afinar.

El modelo Llama 3.2 1B de Meta es otro avance en la eficiencia del modelo pequeño. A través de la poda estructurada y la destilación de conocimiento de los modelos Llama más grandes, mantiene un rendimiento notable mientras opera de manera eficiente en dispositivos de borde. Estos modelos demuestran que la innovación arquitectónica y la metodología de entrenamiento son más importantes que la cantidad de parámetros para muchas aplicaciones del mundo real.

La arquitectura de mezcla de expertos es un avance significativo en el diseño eficiente de la inteligencia artificial. En lugar de utilizar todos los parámetros para cada tarea, estos modelos activan solo los componentes especializados relevantes. Rutean diferentes consultas a subredes especializadas, manteniendo una amplia capacidad mientras utilizan menos parámetros activos en cualquier momento dado. El modelo Mixtral 8x7B de Mistral AI demuestra este enfoque de manera efectiva. A pesar de tener 47 mil millones de parámetros totales, solo activa 13 mil millones de parámetros por consulta, logrando un rendimiento comparable a modelos más grandes y densos mientras mantiene velocidades de inferencia más rápidas.

Las técnicas de cuantificación también han tenido un impacto significativo en el aumento de la eficiencia de los modelos pequeños. Al representar los pesos del modelo con menos bits, los investigadores pueden reducir el tamaño de los modelos mientras mantienen la precisión. Los métodos modernos de cuantificación pueden reducir el tamaño del modelo en un 75 por ciento con una pérdida de rendimiento mínima. El Phi-3-mini de Microsoft ha demostrado la eficacia de este enfoque. Cuando se cuantifica a una precisión de 4 bits, mantiene más del 95 por ciento de su rendimiento original mientras reduce los requisitos de memoria de 7 GB a menos de 2 GB, lo que lo hace práctico especialmente para la implementación móvil.

La Especialización Superó a la Generalización

La revolución del modelo pequeño reveló una verdad importante sobre la implementación de la inteligencia artificial. La mayoría de las aplicaciones del mundo real no necesitan un modelo que pueda escribir poesía, resolver cálculo y discutir filosofía. Necesitan modelos que sobresalgan en tareas específicas. Un chatbot de servicio al cliente no necesita saber sobre Shakespeare. Una herramienta de finalización de código no necesita conocimientos médicos. Esta realización cambió el enfoque de la construcción de modelos universales a la creación de modelos especializados.

El entrenamiento específico del dominio permite que los modelos pequeños concentren su capacidad limitada en conocimientos relevantes. Un modelo de 3 mil millones de parámetros entrenado exclusivamente en documentos legales puede superar a un modelo general de 70 mil millones de parámetros en tareas legales. El modelo especializado aprende patrones más profundos dentro de su dominio en lugar de dispersar la capacidad en temas no relacionados. Es como comparar a un médico especialista con un médico general para procedimientos complejos.

Las estrategias de afinamiento se han vuelto cada vez más sofisticadas. En lugar de entrenar modelos desde cero, los desarrolladores comienzan con modelos base pequeños y los adaptan a necesidades específicas. Este enfoque requiere recursos computacionales mínimos mientras produce modelos especializados altamente capaces. Las organizaciones ahora pueden crear soluciones de inteligencia artificial personalizadas sin inversiones masivas en infraestructura.

Rompiendo el Techo de Rendimiento

Las pruebas recientes revelan ventajas de rendimiento sorprendentes para los modelos pequeños en dominios específicos. El modelo Olmo 2 1B de AI2 supera a modelos de tamaño similar de las principales empresas tecnológicas en tareas de comprensión del lenguaje natural. El modelo Phi-4-mini-flash-reasoning de Microsoft logra hasta 10 veces más velocidad de procesamiento con 2-3 veces menos latencia en comparación con los modelos de razonamiento tradicionales mientras mantiene capacidades de razonamiento matemático.

La brecha de rendimiento se vuelve aún más impresionante al examinar aplicaciones específicas de tareas. Los modelos pequeños afinados para dominios especializados superan consistentemente a los modelos grandes de propósito general en precisión y relevancia. Las aplicaciones de atención médica, el análisis de documentos legales y las implementaciones de servicio al cliente muestran resultados particularmente impresionantes cuando los modelos pequeños se entrenan en conjuntos de datos específicos del dominio.

Esta ventaja de rendimiento proviene de enfoques de entrenamiento enfocados. En lugar de aprender conocimientos amplios pero superficiales en numerosos dominios, los modelos pequeños desarrollan una gran experiencia en áreas específicas. El resultado es respuestas más confiables y contextualmente apropiadas para casos de uso específicos.

La Ventaja de Velocidad y Eficiencia

El rendimiento no se trata solo de precisión. También se trata de velocidad, costo y impacto ambiental. Los modelos pequeños sobresalen en todas estas dimensiones. Un modelo pequeño puede generar respuestas en milisegundos donde los modelos grandes tardan segundos. Esta diferencia de velocidad puede parecer trivial, pero se vuelve crítica en aplicaciones que requieren interacción en tiempo real o procesamiento de millones de solicitudes.

El consumo de energía es otro aspecto crítico. Los modelos grandes requieren centros de datos masivos con sistemas de enfriamiento sofisticados. Cada consulta consume una cantidad significativa de electricidad. Los modelos pequeños pueden ejecutarse en servidores estándar o incluso en computadoras personales, utilizando una fracción de la energía. A medida que las organizaciones enfrentan presión para reducir su huella de carbono, la ventaja ambiental de los modelos pequeños se vuelve cada vez más importante.

La implementación en el borde es quizás la capacidad más transformadora de los modelos pequeños. Estos modelos pueden ejecutarse directamente en teléfonos, laptops o dispositivos IoT sin conectividad a Internet. Imagina herramientas de diagnóstico médico que funcionan en áreas remotas sin acceso a Internet, o dispositivos de traducción en tiempo real que no necesitan conectividad a la nube. Los modelos pequeños hacen que estos escenarios sean posibles, llevando capacidades de inteligencia artificial a miles de millones de dispositivos en todo el mundo.

Las preocupaciones de privacidad también favorecen a los modelos pequeños. Cuando la inteligencia artificial se ejecuta localmente en los dispositivos de los usuarios, los datos sensibles nunca dejan el dispositivo. Los proveedores de atención médica pueden analizar datos de pacientes sin subirlos a servidores en la nube. Las instituciones financieras pueden procesar transacciones sin exponer la información del cliente a sistemas externos. Esta capacidad de procesamiento local aborda una de las principales preocupaciones sobre la adopción de la inteligencia artificial en industrias sensibles.

En Resumen

El auge de los modelos de inteligencia artificial pequeños está desafiando la creencia de que los modelos más grandes siempre entregan un mejor rendimiento. Los modelos compactos con menos parámetros ahora están igualando o incluso superando a los modelos más grandes en ciertas tareas al utilizar técnicas como la destilación de conocimiento, la cuantificación y la especialización. Este cambio hace que la inteligencia artificial sea más accesible al permitir un uso más rápido y eficiente en dispositivos cotidianos. También reduce los costos, disminuye el impacto ambiental y mejora la privacidad al permitir la implementación local. Al centrarse en modelos eficientes y específicos de tareas en lugar de sistemas universales masivos, la inteligencia artificial se vuelve más práctica, asequible y útil tanto para las organizaciones como para los individuos.