Inteligencia artificial

La IA multimodal evoluciona a medida que ChatGPT gana visión con GPT-4V (visión)

En el esfuerzo continuo por hacer que la IA sea más similar a los humanos, los modelos GPT de OpenAI han estado empujando constantemente los límites. GPT-4 ahora puede aceptar instrucciones de texto e imágenes.

La multimodalidad en la IA generativa denota la capacidad de un modelo para producir diversas salidas como texto, imágenes o audio en función de la entrada. Estos modelos, entrenados en datos específicos, aprenden patrones subyacentes para generar nuevos datos similares, enriqueciendo las aplicaciones de la IA.

Avances recientes en la IA multimodal

Un avance notable en este campo se puede ver con la integración de DALL-E 3 en ChatGPT, una mejora significativa en la tecnología de texto a imagen de OpenAI. Esta combinación permite una interacción más fluida donde ChatGPT ayuda a crear instrucciones precisas para DALL-E 3, convirtiendo las ideas de los usuarios en arte generado por IA vívido. Así, mientras los usuarios pueden interactuarectamente con DALL-E 3, tener ChatGPT en la mezcla hace que el proceso de crear arte de IA sea mucho más amigable para el usuario.

Consulte más información sobre DALL-E 3 y su integración con ChatGPT aquí. Esta colaboración no solo muestra el avance en la IA multimodal, sino que también hace que la creación de arte de IA sea fácil para los usuarios.

Google’s health, por otro lado, introdujo Med-PaLM M en junio de este año. Es un modelo generativo multimodal capacitado para codificar e interpretar diversos datos biomédicos. Esto se logró mediante la fine-tuning de PaLM-E, un modelo de lenguaje, para adaptarse a dominios médicos utilizando una referencia de código abierto, MultiMedBench. Esta referencia, que consta de más de 1 millón de muestras en 7 tipos de datos biomédicos y 14 tareas como la generación de informes de radiología y la respuesta a preguntas médicas.

Varías industrias están adoptando herramientas de IA multimodal innovadoras para impulsar el crecimiento empresarial, simplificar las operaciones y elevar la participación del cliente. El progreso en las capacidades de voz, video y texto de la IA está impulsando el crecimiento de la IA multimodal.

Las empresas buscan aplicaciones de IA multimodal capaces de reformar modelos y procesos comerciales, abriendo vías de crecimiento en todo el ecosistema de IA generativa, desde herramientas de datos hasta aplicaciones de IA emergentes.

Después del lanzamiento de GPT-4 en marzo, algunos usuarios observaron una disminución en la calidad de sus respuestas con el tiempo, una preocupación expresada por desarrolladores notables y en los foros de OpenAI. Inicialmente descartada por OpenAI, un estudio posterior estudio confirmó el problema. Reveló una disminución en la precisión de GPT-4 del 97,6% al 2,4% entre marzo y junio, lo que indica una disminución en la calidad de las respuestas con las actualizaciones posteriores del modelo.

El revuelo sobre Open AI’s ChatGPT está de regreso ahora. Ahora viene con una función de visión GPT-4V, que permite a los usuarios que GPT-4 analice imágenes proporcionadas por ellos. Esta es la función más nueva que se ha abierto a los usuarios.

Agregar análisis de imágenes a grandes modelos de lenguaje (LLM) como GPT-4 se considera un gran avance en la investigación y el desarrollo de la IA. Este tipo de LLM multimodal abre nuevas posibilidades, llevando a los modelos de lenguaje más allá del texto para ofrecer nuevas interfaces y resolver nuevos tipos de tareas, creando experiencias frescas para los usuarios.

El entrenamiento de GPT-4V se completó en 2022, con acceso anticipado en marzo de 2023. La función visual en GPT-4V está impulsada por la tecnología GPT-4. El proceso de entrenamiento siguió siendo el mismo. Inicialmente, el modelo se entrenó para predecir la próxima palabra en un texto utilizando un conjunto de datos masivo de texto e imágenes de diversas fuentes, incluyendo Internet.

Posteriormente, se fine-tuneó con más datos, empleando un método llamado aprendizaje de refuerzo desde la retroalimentación humana (RLHF), para generar salidas que los humanos preferían.

Mecánica de visión de GPT-4

Las notables capacidades de visión y lenguaje de GPT-4, aunque impresionantes, tienen métodos subyacentes que permanecen en la superficie.

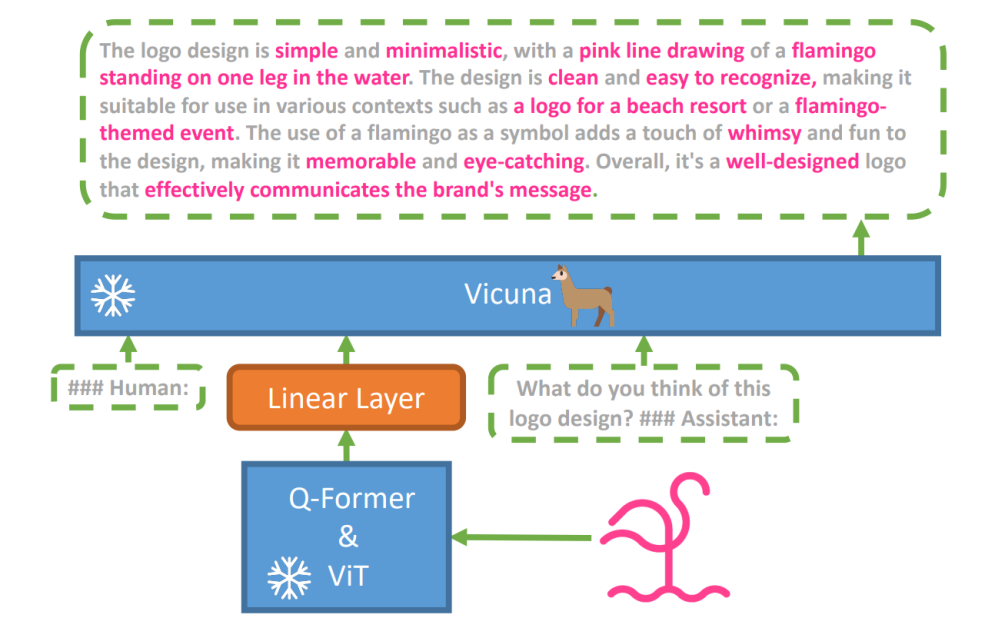

Para explorar esta hipótesis, se introdujo un nuevo modelo de lenguaje y visión, MiniGPT-4, que utiliza un LLM avanzado llamado Vicuna. Este modelo utiliza un codificador de visión con componentes preentrenados para la percepción visual, alineando las características visuales codificadas con el modelo de lenguaje Vicuna a través de una sola capa de proyección. La arquitectura de MiniGPT-4 es simple pero efectiva, con un enfoque en alinear las características visuales y de lenguaje para mejorar las capacidades de conversación visual.

La arquitectura de MiniGPT-4 incluye un codificador de visión con ViT y Q-Former preentrenados, una capa de proyección lineal única y un modelo de lenguaje avanzado Vicuna.

La tendencia de los modelos de lenguaje autoregresivos en tareas de lenguaje y visión también ha crecido, aprovechando la transferencia entre modalidades para compartir conocimientos entre el lenguaje y los dominios multimodales.

MiniGPT-4 conecta los dominios visual y de lenguaje alineando la información visual de un codificador de visión preentrenado con un LLM avanzado. El modelo utiliza Vicuna como decodificador de lenguaje y sigue un enfoque de entrenamiento en dos etapas. Inicialmente, se entrena en un conjunto de datos grande de pares de imagen y texto para comprender el conocimiento de lenguaje y visión, seguido de una fine-tuning en un conjunto de datos más pequeño y de alta calidad para mejorar la confiabilidad y la usabilidad de la generación.

Para mejorar la naturalidad y la usabilidad del lenguaje generado en MiniGPT-4, los investigadores desarrollaron un proceso de alineación en dos etapas, abordando la falta de conjuntos de datos de alineación de lenguaje y visión adecuados. Crearon un conjunto de datos especializado para este propósito.

Inicialmente, el modelo generó descripciones detalladas de las imágenes de entrada, mejorando el detalle mediante el uso de una invitación conversacional alineada con el formato del modelo de lenguaje Vicuna. Esta etapa tenía como objetivo generar descripciones de imágenes más completas.

Prompt de descripción de imagen inicial:

###Humano: <Img><ImageFeature></Img>Describe esta imagen con detalle. Proporciona tantos detalles como sea posible. Di todo lo que ves. ###Asistente:

Para el posprocesamiento de datos, se corrigieron cualquier inconsistencia o error en las descripciones generadas utilizando ChatGPT, seguido de una verificación manual para garantizar la alta calidad.

Prompt de fine-tuning de la segunda etapa:

###Humano: <Img><ImageFeature></Img><Instruction>###Asistente:

Esta exploración abre una ventana para comprender la mecánica de la IA generativa multimodal como GPT-4, arrojando luz sobre cómo las modalidades de visión y lenguaje pueden integrarse efectivamente para generar salidas coherentes y ricas en contexto.

Explorando GPT-4 Vision

Determinar el origen de las imágenes con ChatGPT

GPT-4 Vision mejora la capacidad de ChatGPT para analizar imágenes y determinar su origen geográfico. Esta función transiciona las interacciones del usuario de solo texto a una mezcla de texto y visuales, convirtiéndose en una herramienta útil para aquellos curiosos sobre diferentes lugares a través de datos de imágenes.

Conceptos matemáticos complejos

GPT-4 Vision sobresale al analizar ideas matemáticas complejas analizando expresiones gráficas o manuscritas. Esta función actúa como una herramienta útil para las personas que buscan resolver problemas matemáticos intrincados, convirtiendo a GPT-4 Vision en una ayuda notable en campos educativos y académicos.

Convertir entrada manuscrita en códigos LaTeX

Una de las capacidades notables de GPT-4V es su capacidad para traducir entradas manuscritas en códigos LaTeX. Esta función es una bendición para investigadores, académicos y estudiantes que a menudo necesitan convertir expresiones matemáticas manuscritas o otra información técnica en un formato digital. La transformación de manuscrito a LaTeX amplía el horizonte de la digitalización de documentos y simplifica el proceso de escritura técnica.

Extraer detalles de tablas

GPT-4V demuestra habilidad para extraer detalles de tablas y responder a preguntas relacionadas, un activo vital en el análisis de datos. Los usuarios pueden utilizar GPT-4V para buscar en tablas, recopilar información clave y resolver preguntas impulsadas por datos, convirtiéndolo en una herramienta robusta para analistas de datos y otros profesionales.

Comprender señalamientos visuales

La capacidad única de GPT-4V para comprender señalamientos visuales agrega una nueva dimensión a la interacción del usuario. Al comprender las señales visuales, GPT-4V puede responder a consultas con una comprensión contextual más alta.

Crear sitios web de demostración simples utilizando un dibujo

Inspirado por este tuit, intenté crear un prototipo para el sitio web de Unite.AI.

Limitaciones y defectos de GPT-4V(ision)

Para analizar GPT-4V, el equipo de Open AI realizó evaluaciones cualitativas y cuantitativas. Las evaluaciones cualitativas incluyeron pruebas internas y revisiones de expertos externos, mientras que las cuantitativas midieron las negativas del modelo y la precisión en varios escenarios, como la identificación de contenido dañino, el reconocimiento demográfico, las preocupaciones de privacidad, la geolocalización, la ciberseguridad y las fugas multimodales.

Aún así, el modelo no es perfecto.

El documento destaca las limitaciones de GPT-4V, como inferencias incorrectas y texto o caracteres faltantes en las imágenes. Puede alucinar o inventar hechos. En particular, no es adecuado para identificar sustancias peligrosas en imágenes, a menudo confundiéndolas.

En la imagen médica, GPT-4V puede proporcionar respuestas inconsistentes y carece de conocimiento de las prácticas estándar, lo que puede llevar a posibles diagnósticos incorrectos.

Rendimiento no confiable para fines médicos (Fuente)

También falla al comprender las sutilezas de ciertos símbolos de odio y puede generar contenido inapropiado basado en las entradas visuales. OpenAI aconseja contra el uso de GPT-4V para interpretaciones críticas, especialmente en contextos médicos o sensibles.

Resumen

Creado utilizando Fast Stable Diffusion XL https://huggingface.co/spaces/google/sdxl

La llegada de GPT-4 Vision (GPT-4V) trae consigo un montón de posibilidades emocionantes y nuevos desafíos. Antes de lanzarlo, se ha puesto mucho esfuerzo en asegurarse de que los riesgos, especialmente cuando se trata de imágenes de personas, se investiguen y reduzcan adecuadamente. Es impresionante ver cómo GPT-4V ha mejorado, mostrando mucho potencial en áreas complicadas como la medicina y la ciencia.

Ahora, hay algunas grandes preguntas en la mesa. Por ejemplo, ¿deben estos modelos ser capaces de identificar a personas famosas en fotos? ¿Deben adivinar el género, la raza o los sentimientos de una persona a partir de una imagen? ¿Y debería haber ajustes especiales para ayudar a las personas con discapacidad visual? Estas preguntas abren un debate sobre la privacidad, la equidad y cómo la IA debería encajar en nuestras vidas, lo que es algo en lo que todos deberían tener una opinión.