Inteligencia Artificial

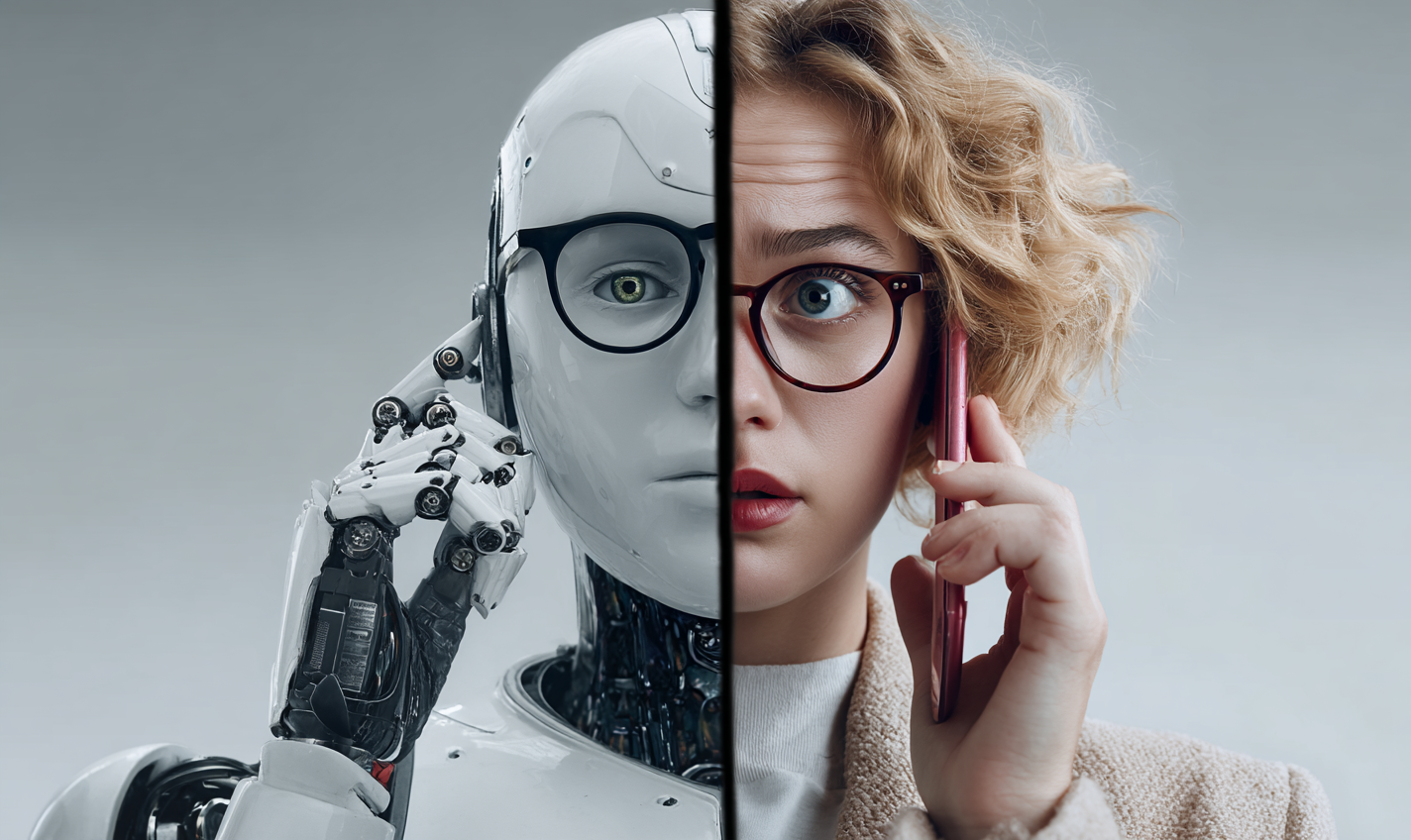

Cómo detectar deepfakes de audio

Los audios generados por IA suenan casi idénticos a los de personas reales, a veces incluso a los de personas conocidas. Basta con grabar unos segundos de voz para recrear con precisión el tono y el ritmo de una persona gracias a las modernas herramientas de clonación de voz basadas en modelos de aprendizaje automático. Lo que antes sonaba robótico o monótono ahora se percibe emotivo y natural, con patrones de respiración y acentos incluidos.

Si bien este progreso impulsa usos creativos como los asistentes virtuales y la narración accesible, también abre la puerta a graves riesgos. Detectar audios falsificados es crucial porque tu voz forma parte de tu identidad. Una vez que se puede clonar, la confianza en la comunicación digital disminuye. Aprender a reconocer audios falsos va más allá de protegerte de estafas y desinformación. Implica salvaguardar la autenticidad de cada conversación que tienes en línea.

El impacto de los deepfakes de audio en la sociedad y la seguridad

Las falsificaciones de audio profundas han dificultado confiar en lo que se oye en internet o por teléfono. Cuando la voz de alguien se puede clonar con solo unos segundos de audio, incluso voces familiares pueden usarse para engañar. Estafadores Cada vez se utiliza más el habla sintética para suplantar identidades. Directores ejecutivos, compañeros de trabajo y familiares: convencen a las víctimas para que transfieran dinero o compartan datos confidenciales.

Estas estafas causan daños financieros y erosionan la confianza en las conversaciones digitales. Para las empresas, los riesgos van más allá del dinero, afectando su reputación y la confianza de sus clientes. Los equipos de seguridad y las fuerzas del orden combinan herramientas forenses, sistemas de autenticación de voz y modelos de detección de inteligencia artificial (IA) para combatir estas amenazas. Sin embargo, a medida que la tecnología deepfake evoluciona, mantenerse alerta e informado es la mejor defensa contra el engaño en un mundo donde las voces pueden mentir.

7 consejos para identificar deepfakes de audio

Incluso los mejores deepfakes de audio dejan pistas sutiles. Puedes detectar la manipulación antes de que te perjudique prestando atención a los detalles de la calidad del sonido, el ritmo del habla y el contexto. A continuación, te ofrecemos 10 consejos prácticos para ayudarte a detectar audio sintético o manipulado.

1. Presta atención a las pausas o transiciones poco naturales.

El habla generada por IA puede sonar real, pero si escuchas con atención, a menudo encontrarás pequeñas pistas. Estas incluyen pausas que suenan antinaturales, un ritmo ligeramente irregular o un cambio de tono a mitad de la frase. Estas pequeñas inconsistencias de sincronización delatan que algo no es del todo humano. Aun así, incluso con estas pistas, detectar un audio deepfake no es fácil.

Las investigaciones demuestran que solo puedes detectarlos con una precisión de aproximadamente el 62%.Esto significa que, casi la mitad de las veces, una falsificación convincente puede pasar desapercibida. A medida que los deepfakes se vuelven más sofisticados, es recomendable verificar dos veces los mensajes sospechosos, especialmente si contienen información confidencial o solicitudes urgentes. Una verificación rápida podría evitar que caigas en la trampa de una voz que suena real pero no lo es.

2. Observa la falta de emoción o la exageración.

Al escuchar un audio generado por IA, es posible que notes algo ligeramente extraño en el tono de voz del hablante. Los audios generados por IA suelen sonar o demasiado monótonos —careciendo de los matices naturales de las emociones humanas— o excesivamente expresivos, con un énfasis exagerado que no se ajusta al contexto.

Los modelos de IA pueden imitar el tono y el ritmo, pero les cuesta captar el sutil equilibrio emocional de las conversaciones reales. Si una voz suena inusualmente plana o dramática, sobre todo en momentos que deberían ser naturales, considéralo una señal de alerta. Prestar atención a estas inconsistencias tonales puede ayudarte a detectar audio falso antes de que te convenza de actuar en base a algo que no es real.

3. Presta atención a los artefactos de audio.

Pistas sutiles —como estática tenue, distorsiones extrañas o cambios repentinos de tono que suenan mal— pueden delatar un audio manipulado con inteligencia artificial. Estos pequeños fallos se producen porque los sistemas de IA combinan fragmentos de sonido para imitar el habla natural. Lo más sorprendente es la poca cantidad de audio que necesitan estas herramientas para crear un clon convincente de tu voz.

En algunos casos, simplemente tres segundos de discurso grabado Basta con eso para lograr una coincidencia de voz del 85% entre la tuya y la de la persona que la imita. Esto significa que un breve fragmento de un mensaje de voz, una publicación en redes sociales o un vídeo corto podría ser suficiente para que alguien copie tu tono y ritmo. Si algo te suena un poco raro, confía en tu intuición. Esas pequeñas imperfecciones podrían ser las únicas señales de que la voz que oyes no es real.

4. Comparar con grabaciones conocidas

Las voces reales tienen una fluidez natural que la IA aún no logra captar por completo. Al hablar, el tono, el ritmo y la respiración de una persona reflejan constantemente su personalidad y emoción. Generalmente se pueden percibir señales sutiles —una breve inhalación antes de un pensamiento, un ritmo constante cuando está tranquila o un ligero cambio de ritmo— cuando enfatiza una idea.

Por otro lado, los deepfakes de audio suelen carecer de estos detalles orgánicos. La respiración puede sonar mecánica, el ritmo irregular o el tono extrañamente plano o exagerado. Si una voz suena demasiado suave o carece de esas pequeñas imperfecciones humanas, es probable que sea sintética. Prestar atención a cómo habla una persona de forma natural ayuda a detectar cuando una voz no suena como ella.

5. Utilizar la verificación multicanal

Cuando un mensaje de voz o una llamada te parezca sospechosa, tómate un momento para verificarla antes de responder. La forma más sencilla de protegerte es confirmar el mensaje por otro medio: envía un mensaje de texto, realiza una videollamada o responde desde una dirección de correo electrónico oficial de confianza. Este paso adicional te protege de estafas que utilizan voces clonadas y una falsa sensación de urgencia para engañarte y hacerte actuar con rapidez.

Los ciberdelincuentes actuales son cada vez más astutos y combinan deepfakes de audio con phishing de voz para robar datos. Es una amenaza creciente. El 71% de las organizaciones informaron haber enfrentado Estos intentos. Por eso, verificar la información dos veces es un hábito inteligente. Cuando algo no parezca correcto, confía en la confirmación en lugar de la urgencia y date tiempo para confirmar la verdad antes de actuar.

6. Comprobar el contexto del discurso

Cuando recibas una llamada o un mensaje de voz inesperado, presta tanta atención a lo que se dice como a cómo suena. Las estafas con deepfakes suelen usar frases inusuales, una urgencia repentina o solicitudes de datos confidenciales para presionarte a actuar con rapidez. Podrías escuchar una voz que dice ser tu jefe pidiéndote una transferencia de dinero inmediata, o la de un ser querido angustiado pidiendo ayuda; ambas son tácticas comunes de los estafadores.

Estos detonantes emocionales te hacen entrar en pánico antes de pensar con claridad. Si un mensaje te parece apresurado, sospechoso o algo fuera de lugar, tómate un respiro y verifícalo por otro medio. Una breve pausa para confirmar puede evitar que una voz falsa derive en un problema real.

7. Confía en herramientas de verificación de confianza.

Los detectores de audio con inteligencia artificial y el software forense se están convirtiendo en herramientas esenciales para detectar deepfakes. Estas tecnologías analizan las ondas sonoras, el ruido de fondo y los patrones del habla para identificar sutiles signos de manipulación que el oído humano puede pasar por alto fácilmente. Si bien puedes confiar en tu intuición, los estudios demuestran que El juicio humano no siempre es fiable. — incluso los oyentes entrenados pueden ser engañados por clones de voz muy realistas.

Confiar únicamente en la intuición ya no es suficiente. Se necesitan con urgencia sistemas de detección robustos para ayudar a particulares, empresas y equipos de seguridad a verificar qué es real y qué es falso. A medida que la tecnología deepfake evoluciona, la combinación de la detección automatizada con el pensamiento crítico puede proteger la comunicación, la reputación y la confianza en el mundo digital.

Manténgase alerta, manténgase informado

Aunque la tecnología deepfake mejore, tu capacidad para escuchar con espíritu crítico y cuestionar lo que oyes sigue siendo una defensa poderosa. Prestar atención a las señales sutiles y verificar la información a través de canales confiables puede detener la manipulación antes de que se propague. Mantenerte alerta y escéptico te ayuda a proteger tus datos y la confianza que mantiene la autenticidad de la comunicación digital.