Künstliche Intelligenz

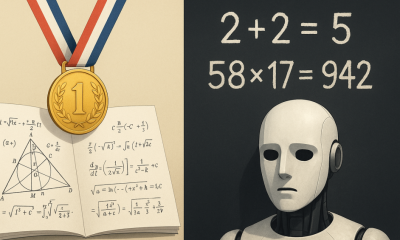

Warum Wettbewerbe zum neuen Standard für die Überprüfung von KI werden

Für viele Jahre waren Benchmarks wie ImageNet für die ComputerVision und GLUE für die Verarbeitung von natürlichen Sprachen die wichtigsten Werkzeuge für die Bewertung von KI. Sie boten eine einfache Möglichkeit, den Fortschritt zu verfolgen und verschiedene Modelle zu vergleichen. Aber da KI-Systeme fortschrittlich wurden, wurden viele dieser Benchmarks gesättigt, mit Modellen, die die menschliche Leistung erreichten oder sogar übertrafen. Diese Herausforderung hat die Notwendigkeit für neue Methoden hervorgerufen, die die Fähigkeiten von KI besser testen können. Als Reaktion auf diese Herausforderung wenden sich Forscher nun an Wettbewerbe als alternative Möglichkeit, KI zu bewerten. Anstatt auf feste Datensätze zu vertrauen, werden KI-Modelle nun durch Brettspiele, Codierwettbewerbe, Mathematik-Olympiaden, E-Sports und Roboter-Herausforderungen bewertet. In diesen Umgebungen müssen Modelle anpassen, begründen und Strategien entwickeln, um neue Probleme und Gegner zu meistern. Dieser Artikel untersucht die Grenzen traditioneller Benchmarks und zeigt, wie Wettbewerbe als neuer Standard für die Bewertung von KI entstehen.

Warum traditionelle Benchmarks nicht ausreichen

Traditionelle Benchmarks haben die KI-Entwicklung für Jahrzehnte geleitet. Sie bieten eine standardisierte Möglichkeit, die Leistung von KI-Modellen zu vergleichen. Diese Datensätze enthielten feste Eingaben mit klaren Zielen, die es Forschern ermöglichten, verschiedene Ansätze auf einfache Weise zu vergleichen. Ein Modell, das besser performte, galt als fähiger.

Allerdings haben sich mit der Zunahme der Leistung von KI-Systemen die Grenzen dieser Benchmarks gezeigt. Das offensichtlichste Problem ist die Sättigung von Benchmarks. Wenn Modelle perfekte oder nahezu perfekte Ergebnisse erzielen, verliert der Test die Fähigkeit, zwischen stärkeren und schwächeren Modellen zu unterscheiden. Studien zeigen, dass viele Benchmarks schnell gesättigt sind und diese Tendenz in den letzten Jahren noch häufiger geworden ist.

Eine weitere Herausforderung ist die Kontamination von Daten. Viele Benchmark-Instanzen sind online verfügbar und können in Trainingsdatensätzen enthalten sein. Wenn ein Modell ein Problem löst, kann es möglicherweise eine Antwort abrufen, die es bereits während des Trainings gesehen hat. Dies erzeugt eine Illusion von Intelligenz, ohne tatsächliche Denkfähigkeit zu demonstrieren.

Einige Forscher haben versucht, dies durch die Verwendung von menschlicher Bewertung zu lösen. Während dies Nuancen hinzufügt, bringt menschliche Bewertung auch Subjektivität und Vorurteile. Diese Bewertungen sind auch zeitaufwändig, teuer und schwierig zu skalieren, um mehrere Modelle zu vergleichen. Diese Grenzen haben eine dringende Notwendigkeit für Bewertungsmethoden geschaffen, die mit den schnell voranschreitenden KI-Fähigkeiten Schritt halten können.

Warum Wettbewerbe einen besseren Ansatz bieten

Wettbewerbe bieten eine dynamische Testumgebung, die viele Mängel traditioneller Benchmarks anspricht. Sie bieten klare Regeln, definierte Ziele und messbare Ergebnisse, die nicht von subjektiver Interpretation abhängen. Erfolg wird durch transparente Ergebnisse bestimmt, die jeder überprüfen kann.

Der größte Vorteil von Wettbewerben ist ihre natürliche Fähigkeit, die Schwierigkeit zu skalieren. Wenn KI verbessert wird, werden die Herausforderungen automatisch schwieriger. In Spielen stehen stärkere Modelle komplexeren Gegnern gegenüber. In mathematischen Wettbewerben steigt die Komplexität der Probleme. In Codierwettbewerben werden die algorithmischen Herausforderungen anspruchsvoller. Diese Eigenschaft stellt sicher, dass die Bewertung auch bei fortschreitender Technologie relevant bleibt.

Wettbewerbe fordern auch vielfältige kognitive Fähigkeiten. Strategische Spiele erfordern langfristige Planung und Gegnermodellierung. Mathematische Olympiaden testen kreative Problemlösung und strenge Argumentation. Codierwettbewerbe bewerten algorithmisches Denken und Implementierungsfähigkeiten. Realwelt-Herausforderungen wie Kaggle-Wettbewerbe bewerten praktische Problemlösungsfähigkeiten in verschiedenen Bereichen.

Am wichtigsten ist, dass Wettbewerbe einen direkten Vergleich mit menschlicher Leistung ermöglichen. Diese Eigenschaft bietet einen sinnvollen Referenzpunkt, den statische Benchmarks nicht bieten können. Wenn ein KI-System am Internationalen Mathematik-Olympiad teilnimmt oder Schach gegen Großmeister spielt, gewinnen wir Einblicke in die Fähigkeiten von KI im Vergleich zu menschlichen Fähigkeiten.

Die Transparenz der Wettbewerbsbewertung ermöglicht auch eine tiefere Analyse. Jeder Zug im Spiel, jeder Schritt in einem mathematischen Beweis und jede Zeile Code kann untersucht werden, um zu verstehen, wie KI-Systeme Probleme angehen. Diese Offenheit wandelt die Bewertung von einer einfachen Punktzahl in ein Fenster für die Entscheidungsfindung.

Beispiele für KI in Wettbewerben

Die Bewertung von KI durch Wettbewerbe ist keine neue Idee. 2016 besiegte DeepMinds AlphaGo den Go-Weltmeister Lee Sedol, und sein Nachfolger, AlphaZero, besiegte den amtierenden Computer-Champion Stockfish, indem es sich das Schachspiel selbst beibrachte. Im E-Sport besiegte OpenAIs Dota-2-System (OpenAI Five) 2019 das Weltmeister-Team, während DeepMinds AlphaStar den Großmeister-Status in StarCraft II erreichte. Diese Siege zeigten, dass KI-Systeme sich anpassen und in hochstrategischen, Echtzeit-Umgebungen erfolgreich sein können.

In jüngerer Zeit haben Forscher KI-Modelle für akademische Wettbewerbe entwickelt. Tatsächlich erreichten Google DeepMind und OpenAI-Systeme eine Goldmedaille bei der Internationalen Mathematik-Olympiade. Bei der Programmierung bewältigte AlphaCode neue Codeforces-Probleme und erreichte den Median der menschlichen Konkurrenz. Diese Ergebnisse zeigten, dass KI-Systeme in olympischen Wettbewerben wettbewerbsfähig sein können.

Der Wettbewerb in der Robotik folgt einem ähnlichen Ansatz. Veranstaltungen wie RoboCup, DARPA-Herausforderungen und XPrize-Aufgaben erfordern, dass Teams Agenten bauen, die in realen Umgebungen operieren, von fußballspielenden Robotern bis hin zu autonomen Fahrzeugen. Diese Wettbewerbsformate machen den Fortschritt messbar und ermöglichen einen direkten Vergleich zwischen Systemen.

Was wettbewerbsbasiertes Testen zeigt

Wettbewerbe zeigen Aspekte von Intelligenz, die traditionelle Benchmarks oft übersehen. Die Fähigkeit zur Verallgemeinerung wird sofort deutlich, wenn KI neue Herausforderungen gegenübersteht, die sie noch nie zuvor gesehen hat. Im Gegensatz zu Benchmarks, die das Auswendiglernen begünstigen, stellen Wettbewerbe ständig neue Szenarien, die echte Problemlösungsfähigkeiten erfordern.

Kreative Argumentation tritt als entscheidender Faktor insbesondere in mathematischen und wissenschaftlichen Wettbewerben hervor. KI muss originelle Einblicke generieren und neue Argumente konstruieren, um ein Problem zu lösen, das sie noch nie zuvor gesehen hat. Diese Kreativität kann nicht durch Mustererkennung auf festen Datensätzen gemessen werden.

Anpassungsfähigkeit ist ein wesentlicher Aspekt aller Wettbewerbsbereiche. Spiel-KI muss Strategien basierend auf dem Verhalten des Gegners anpassen. Wettbewerbslösung-KI muss Ansätze ändern, wenn erste Versuche fehlschlagen. Diese Flexibilität spiegelt realweltliche Anforderungen wider, bei denen starre Antworten oft versagen.

Robustheit unter Neuheit ist ein weiterer wichtiger Faktor bei der wettbewerbsbasierten Bewertung. Die Wettbewerbsumgebung ändert sich ständig, was KI zwingt, mit neuen Situationen und unerwarteten Zügen umzugehen. Ein Modell, das unter diesen Bedingungen gut performt, ist wahrscheinlich zuverlässiger und effektiver in realen Anwendungen.

Schließlich bieten Wettbewerbe eine direkte Möglichkeit, menschliche Denkfähigkeit mit maschineller Intelligenz zu vergleichen. Durch den Wettbewerb gegen menschliche Experten in einem Spiel oder einem Problemlösungswettbewerb werden KI-Systeme auf den höchsten Standard gehoben. Diese Eigenschaft bietet ein klares, ambitioniertes Ziel für das Feld, anstatt abstrakte Leistungsmerkmale.

Herausforderungen bei der wettbewerbsbasierten Bewertung

Während die wettbewerbsbasierte Bewertung viele Vorteile bietet, stellt sie auch verschiedene Herausforderungen dar. Ein Anliegen ist die Domänen-Spezifität. Ein Schach-Champion kann möglicherweise kein komplexes mathematisches Problem lösen. Erfolg in einem bestimmten Wettbewerb garantiert nicht allgemeine Intelligenz. Das Feld muss Wege finden, Ergebnisse aus mehreren Wettbewerben zu kombinieren, um ein umfassenderes Verständnis der Fähigkeiten eines KI-Systems zu erlangen.

Standardisierung ist ein weiteres Problem. Während Gewinn- und Verlustbilanzen innerhalb eines Spiels klar sind, ist der Vergleich von Ergebnissen über verschiedene Wettbewerbsarten hinweg schwierig. Zum Beispiel, wie vergleicht man die Leistung eines Modells in einer Roboter-Herausforderung mit seiner Leistung in einem Codierwettbewerb? Forscher arbeiten daran, Rahmenbedingungen zu schaffen, die diese verschiedenen Arten von Ergebnissen in eine faire Bewertung einbeziehen.

Schließlich gibt es das Problem der Zugänglichkeit. Während viele Wettbewerbe offen sind, erfordern einige erhebliche Rechenressourcen oder Expertenwissen, das möglicherweise nicht für alle Forscher, insbesondere aus kleineren Institutionen, verfügbar ist. Es ist wichtig, dass diese neuen Bewertungsmethoden inklusiv sind, um die Gesundheit und Vielfalt des Feldes zu gewährleisten.

Übergeordneter Einfluss auf die KI-Forschung

Der Aufstieg der wettbewerbsbasierten Bewertung hat bereits einen signifikanten Einfluss darauf, wie KI entwickelt wird. Sie ermutigt Forscher, sich von der einfachen Trainierung von Modellen auf Benchmarks hin zu Systemen zu bewegen, die planen, begründen und auf neue Situationen reagieren können. Diese Verschiebung ist entscheidend, um echten Fortschritt in Richtung allgemeinerer Formen von Intelligenz zu erzielen.

Wettbewerbsplattformen demokratisieren auch die Bewertung. Indem Spiele und Wettbewerbe für jeden zugänglich gemacht werden, können kleine Forschungsgruppen und einzelne Entwickler mit großen Technologieunternehmen konkurrieren. Diese Demokratisierung fördert Innovation aus einer breiteren Palette von Menschen und Institutionen. Plattformen wie Kaggle, die Internationale Mathematik-Olympiade und Programmierwettbewerbs-Websites bieten zugängliche Orte für die Überprüfung von KI-Fähigkeiten.

Schließlich beeinflussen die Lektionen aus dem Wettbewerb direkt realweltliche Anwendungen. Die Fähigkeit, zu planen, anzupassen und unter Druck robust zu bleiben, ist in Bereichen wie Finanzen, Verkehr, Gesundheitswesen und Verteidigung von großem Wert. Diese Bereiche erfordern KI, die mit Unsicherheit umgehen, sich an veränderte Bedingungen anpassen und zuverlässige Leistung liefern kann.

Zusammenfassung

Die wettbewerbsbasierte Bewertung definiert neu, wie wir den Fortschritt von KI messen. Im Gegensatz zu statischen Benchmarks testen Wettbewerbe Anpassungsfähigkeit, Kreativität und echte Problemlösung unter dynamischen Bedingungen. Während Herausforderungen wie Standardisierung und Zugänglichkeit bestehen bleiben, treibt diese Verschiebung KI in Richtung robuster, vielseitiger und menschlich vergleichbarer Intelligenz voran. Sie schärft nicht nur die Forschung, sondern beschleunigt auch die Entwicklung von KI-Systemen, die für die realen Anwendungen bereit sind.