Andersons Blickwinkel

Mit ‘Wahrscheinlichkeit’ als Deepfake-Erkennungsmetrik

Wenn künstlich erzeugte Videos und Audiodateien gut genug werden, werden Deepfake-Erkennungsmethoden, die auf visuellen Artefakten oder anderen herkömmlichen Signalen basieren, nicht mehr funktionieren. Aber angesichts der Tatsache, dass Menschen nur selten von ihrem vorhersehbaren Verhalten abweichen, könnte perhaps ‘Wahrscheinlichkeit’ tiefer als Signal dafür verwendet werden, ob ein Video oder ein Gerücht wahrscheinlich wahr ist.

Meinung In den frühen 1990er Jahren enthüllte der ehemalige britische Fußballspieler und Fernsehsportkommentator David Icke beiläufig auf einer Talkshow, dass er ‘der Sohn Gottes’ sei – eine bizarre und unerwartete Enthüllung, die sich im Laufe der folgenden Jahrzehnte zu einer anhaltenden und elaborate Verschwörungstheorie über eine geheime und mächtige globale Kabale von ‘Echsenmenschen’.

Mit der Internetadoption noch einige Jahre entfernt und dem Aufkommen sozialer Medien noch weiter in der Zukunft, hatte die sheer Dissonanz zwischen Ickes Ruhm und der Natur seiner neuen Erkenntnisse einen tiefgreifenden Einfluss auf die britische Öffentlichkeit – nicht zuletzt wegen des völligen Fehlens von Kontext oder irgendeiner Art von Vorbereitung auf diese massive Wendung, von einem bekannten und etablierten Sportpersönlichkeit.

Mehr als zwanzig Jahre später trat ein ähnlicher und viel dunklerer Strang dieses gesellschaftlichen Schocks auf, als der beliebte Wohltätigkeitskampagner und Kinderfernsehmoderator Jimmy Savile posthum als serieller und räuberischer Lebenslänglich-Sexstraftäter entlarvt wurde, der sein öffentliches Image genutzt hatte, um seine Verbrechen zu erleichtern.

Die anschließende Operation Yewtree-Polizeiuntersuchung würde viele weitere britische Prominente mit langen Vorgeschichten von Sexualstraftaten aufdecken; später würde die Verfolgung von Harvey Weinstein zu einer ähnlichen Entdeckung von Prominenten-Sexstraftätern in den USA führen, die sich zur #metoo-Bewegung entwickelte und sich dauerhaft in der amerikanischen Kultur verfestigte, in Ausgaben wie The Morning Show. ‘Schock’-Nachrichten schienen ein neues und abruptes Template zu entwickeln – eines, das schließlich von Deepfake-Angreifern übernommen werden würde.

Das Ende der ‘traditionellen’ Deepfake-Erkennung?

Selbst wenn soziale Medien und KI in den frühen Neunzigerjahren vorhanden gewesen wären, hätte kein Vorhersagesystem auf der Welt Ickes Chatshow-Enthüllungen vorhersehen können, die (wie ich mich gut erinnere) in den Jahren vor dem Ereignis in keiner Weise vorhergesagt wurden.

Aber wenn KI vorhanden gewesen wäre, hätte es vielleicht einige Zeit gedauert, um eine breitere Öffentlichkeit davon zu überzeugen, dass Ickes Aussagen nicht das Produkt von Google Veo 3 oder einem anderen der neuen Generation von hyperrealen Audio/Video-Deepfake-Frameworks waren.

Es ist erst in den letzten 6-12 Monaten, dass KI-Deepfake-Methoden effektiv genug geworden sind, um Jahre der Medien-Doomsday-Prophezeiungen über Deepfake-Wahlbeeinflussung zu erfüllen und in der Lage sind, die Art von Schnellangriff-Reputationsflecken zu generieren, der falsch ist, aber schwer zu tilgen in einer zunehmend gläubigen Kultur.

Bisher fällt die Ausgabe von KI-Videos typischerweise kurz vor der wahren Realität, begrenzt durch technische Hürden und zunehmend polarisiert durch eine sich verbreiternde Lücke zwischen restriktiven westlichen Modellen und Chinas unzensierten Open-Source-Veröffentlichungen**.

Trotzdem bemerke ich zunehmend in der Forschungsliteratur eine drohende Kapitulation in diesem Kalten Krieg, zum Beispiel in dem neuen Papier Leistungsverfall bei der Deepfake-Erkennung†:

‘[Wir] nehmen an, dass Deepfake-Videos weiterhin maschinell erlernbare Merkmale enthalten, die sie zuverlässig von echten Videos unterscheiden. Wenn die Fähigkeiten der generativen KI weiterhin rasch voranschreiten, kann diese Annahme möglicherweise zusammenbrechen.

‘In einem solchen Szenario bieten Wasserzeichen und andere Provenienz-Verfolgungsmethoden die einzige Möglichkeit, um Vertrauen in digitale Medien aufrechtzuerhalten.’

Jedoch räumt das gleiche Papier ein, dass provenienzbasierende Lösungen wie die von Adobe angeführte Content Authenticity Initiative (und die vielen kleineren Forschungs Angebote der letzten 7-8 Jahre) eine so weit verbreitete Akzeptanz erfordern, dass sie unrealistisch sind; und das Papier endet mit einer allgemeinen Note der Rückzug, wenn nicht der Niederlage.

Wenn audiovisuelle Deepfake-Erkennungsmethoden von der generativen KI überholt werden und die globale Akzeptanz eines aufdringlichen Wasserzeichens oder Provenienz-Schemas an den diversen logistischen Hürden scheitert, was könnte als gemeinsames zentrales Merkmal die Erkennung von potenziell gefälschten Ausgaben ersetzen? Oder müssen wir uns mit einer Welt abfinden, in der alle Medien in Frage gestellt werden und der Lügnerdividende herrscht?

Wissensgraphen

Es scheint Zeit, Wahrscheinlichkeit und Plausibilität von ‘gemeldeten Ereignissen’ als Signalmerkmal in der Deepfake-Erkennung tiefer zu nutzen. Weiterhin könnte es auch Zeit sein, die getrennten Forschungsstränge von ‘Fake News’ (als textbasiertes Erzählereignis) und gefälschten Bildern/Videos zu konvergieren.

Ein Wahrscheinlichkeits-Deepfake-Metrik ist nicht dasselbe wie RAG-unterstützte Faktüberprüfung, bei der ein KI-Modell aktuelle Web-Ergebnisse abrufen kann, um Kenntnisse von Ereignissen zu erlangen, die nach seinem eigenen Stichtag auftreten, und/oder um seine Behauptungen zu bestätigen.

Vielmehr würde es Vorhersagen auf der Grundlage allgemein indikativer statistischer Trends durchführen, die aus historischen Mustern abgeleitet werden, die einer aktuellen Anfrage entsprechen.

In diesem Sinne ist eine Wahrscheinlichkeitsmethode näher an statistischer Analyse als an modernen Ansätzen in der aktuellen maschinellen Lernszene.

Obwohl sie zuvor von moderneren Transformers-Ära-Ansätzen verdrängt wurden, machen Wissensgraphen inzwischen eine Art Comeback im Unternehmensbereich und scheinen für die potenzielle Bereitstellung von ‘Wahrscheinlichkeits’-Metriken in der Deepfake-Erkennung geeignet.

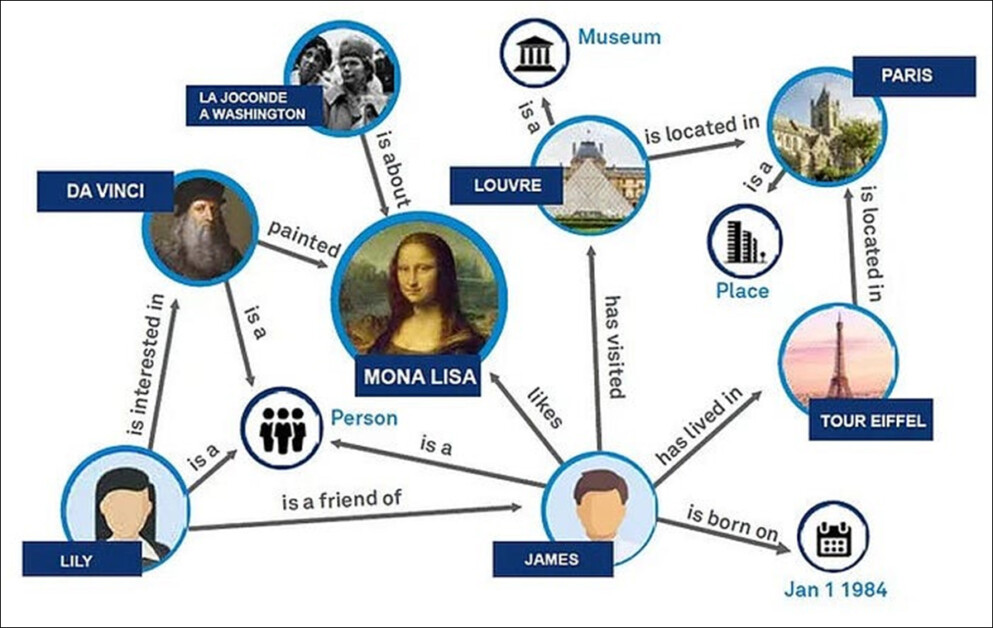

Ein vereinfachter Wissensgraph, der zeigt, wie Menschen, Orte, Kunstwerke und Ereignisse durch beschriftete Beziehungen miteinander verknüpft werden können, sodass Maschinen über reale Entitäten und ihre Verbindungen nachdenken können. Quelle

Ein Wissensgraph ist eine Möglichkeit, Informationen zu organisieren, indem reale Dinge wie Menschen, Unternehmen, Ereignisse oder Ideen in ein Netzwerk von verbundenen Fakten umgewandelt werden.

Jedes Sub-Element ist ein Knoten, und die Verbindungen zwischen ihnen (Kanten) beschreiben, wie sie miteinander in Beziehung stehen. Zum Beispiel könnte ‘Microsoft’ (ein Knoten) mit ‘OpenAI’ (ein weiterer Knoten) durch eine Kante verbunden sein, die sagt ‘ist ein Kunde von’. Diese Verbindungen werden oft in Graphendatenbanken gespeichert und folgen einer Subjekt-Prädikat-Objekt-Struktur, wie ‘Microsoft ist ein Kunde von OpenAI’.

Beständiges Gedächtnis

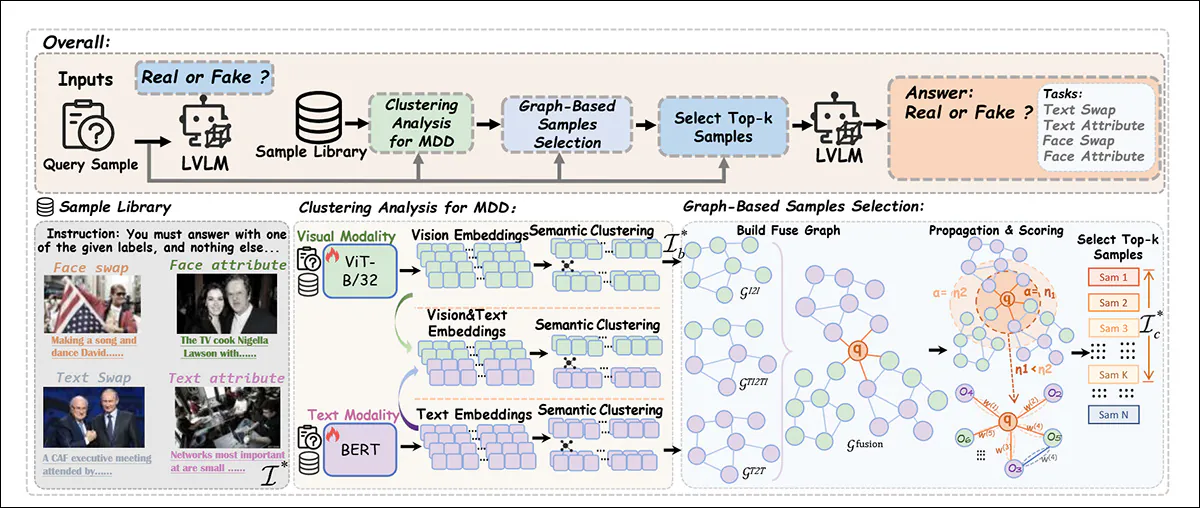

Eine chinesische Studie vom September dieses Jahres schlug eine trainingsfreie Methode vor, die graphbasiertes Denken verwendet, um subtile Inkonsistenzen in multimodalen Deepfakes zu erkennen.

Anstatt Rationales oder Feinabstimmung großer Modelle zu generieren, ruft das System Bild-Text-Paare ab, baut einen Ähnlichkeitsgraphen auf und bewertet Verbindungen, um die relevantesten Beispiele abzurufen, und diese leiten das Urteil des Modells ohne die Notwendigkeit neuer Schulung:

Überblick über den GASP-ICL-Rahmen, der die Deepfake-Erkennung durch Kombination von graphbasierter Stichprobenauswahl mit Kontextlernens verbessert, sodass ein eingefrorenes visuelles Sprachmodell Bild/Text-Paare als echt oder gefälscht klassifizieren kann, ohne Schulung oder Feinabstimmung. Quelle

Dies ist wahrscheinlich die nächste Arbeit, die mir untergekommen ist, zu einem ‘informierten’ und historisch bewussten Ansatz für die Bewertung und Verifizierung neuer Medienausgaben. Im Allgemeinen analysieren Computer-Vision-Ansätze weiterhin Bilder (einschließlich Videoframes und zeitliche Anomalien, die mehrere Frames umfassen), während ‘Fake News’-Erkennungsframeworks weiterhin textbasierte Daten betonen, auch in multimodalen Projekten.

Feature-Creep

Die Herausforderung eines prädiktiven Systems dieser Art ist der Umfang der Überwachung, die notwendig sein könnte, um den Ansatz vollständig leistungsfähig zu machen – zumindest jenseits der Analyse von Prominenten und öffentlichen Figuren, für die bereits frei zugängliche Daten existieren.

Wahrscheinlich ist der ähnlichste aktuelle Strang in der Forschung das Feld der Vorverbrechensbekämpfung, das diverse multimodale Intelligenzsignale als ‘verdächtig’ kennzeichnet und sich als zuverlässiger KI-Schreckadler in Ausgaben wie Jonathan Nolans Person of Interest (2011-2016) und Steven Spielbergs Minderheitbericht (2002) präsentiert.

Während ein Person of Interest-ähnliches allumfassendes Überwachungssystem optimale Ergebnisse liefern würde, ist es unwahrscheinlich, dass die westliche Kultur im Moment die erforderliche persönliche Aufdringlichkeit sanktionieren könnte, die Chinas interne Netzwerke ihren Bürgern auferlegen.

Daher wären in Bezug auf potenziell gefälschte Nachrichten über nicht-Prominente nur Regierungsbehörden wie die Polizei (sowie Geburts- und Sterberegister und Finanzämter) in der Lage, genügend relevante historische Informationen zu liefern, um Wahrscheinlichkeiten in einem graphbasierten Arbeitsablauf zu informieren; und selbst sie würden den Willen, die Kapazitäten, die Gesetzgebung und die Ressourcen benötigen, um average Bürger in ihre Abdeckung und Analysen einzubeziehen (d. h. über banale, aber obligatorische Datenpunkte wie Reisepassnummern und Autokennzeichen hinaus).

Wahrscheinlichkeitsbewertung

Es ist wahrscheinlich, dass die potenzielle Effektivität eines Systems dieser Art auf die offensichtlichsten (aktuelle) Anwendungsfälle für Deepfake-Inhalte beschränkt wäre: Destabilisierung (staatlich unterstützte Deepfakes); Prominenten- und ‘Unbekannte’-Porn-Deepfakes (die beide als bösartig angesehen werden können, obwohl der letzte Fall tendenziell mehr Medienaufmerksamkeit auf sich zieht); Betrug (einschließlich Audio/Video-Deepfakes, die zur Ausführung von ‘Impersonationsraubüberfällen’ konzipiert sind); und politische Charakterermordung.

Ein wissensbasierendes System benötigt eine Skala von Wahrscheinlichkeiten für eine Vielzahl von möglichen Ereignissen. An einem Ende des Spektrums befinden sich alltägliche menschliche Schwächen wie fragwürdige Finanzmanagement, Untreue, Sucht, Indiskretion usw.; am anderen Ende… die Enthüllung, dass man der Sohn Gottes ist, in einer Live-TV-Chatshow (oder Ereignisse ähnlicher Größenordnung und Auswirkung).

Selbst in letzterem Fall würden persönliche historische Faktoren für jeden Einzelnen das Wahrscheinlichkeitsergebnis gewichten: Ein prominentes politisches Gesicht, das in kontroversen Angelegenheiten (wie der Wahrhaftigkeit der Mondlandungen der 1960er/70er Jahre) öffentlich gezögert hat, um Kapital bei einem zunehmend ‘alternativ’-informierten Wähler zu gewinnen, könnte zusätzlichen Joker-Status in Verifizierungsroutinen erhalten, im Vergleich zu seinen eher zurückhaltenden Kollegen.

Im Falle von Prominenten-Pornos gibt es genügend realweltlichen Kontext (d. h. die 2012-Prominenten-Foto-Leaks und andere – relativ seltene – Vorfälle), um einen moderaten Lügnerdividenden in bestimmten Kontexten zu generieren; aber da diese Ausreißer-Vorfälle tendenziell als Ausnahmen dienen, die die Regel beweisen, würden die meisten der aktuellen Charge von Diffusions-basierten Prominenten-Porn-Videos als extrem ‘unwahrscheinlich’ angesehen (obwohl dies das Problem der Aneignung von Identitäten für solche Zwecke nicht löst).

In Bezug auf nationale Störungen gibt es eine erhebliche Menge an statistischen Daten, die bei der Bewertung der Wahrscheinlichkeiten von ‘katastrophalen’ Berichten helfen können. Selbst in der antiken Geschichte waren scheinbar ‘aus heiterem Himmel’ auftretende Ereignisse wie der Ausbruch des unbekannten Vesuvius im Jahr 79 n. Chr. vorhergesagt, wenn man nur genug Aufmerksamkeit geschenkt hätte; und abgesehen von der Verfügbarkeit einer Vielzahl von Regierungs- und NGO-gestützten Feeds kann die sich entwickelnde Fähigkeit von KI, Struktur aus rohen Daten zu extrahieren, zusätzlichen historischen Kontext für die Wahrscheinlichkeitsbewertung liefern.

Schlussfolgerung

Selbst ein gut implementiertes prädiktives System dieser Art könnte nicht mit Zufall, Akten Gottes, freak-Vorkommnissen oder bösartigen Ereignissen umgehen, die außerhalb aller Aufsicht konzipiert wurden.

Weiterhin wäre das reine Volumen und die Tiefe der Daten, die erforderlich wären, um auch eine Abdeckung für nicht berühmte Menschen zu bieten, ein politischer Stolperstein – zumindest für den Moment.

Jedoch scheinen die Auswahlmöglichkeiten sich zu verringern; die visuelle Analyse ist darauf vorbereitet, angesichts verbesserter generativer KI zu scheitern, während Verifizierungs- und Provenienz-Schemata eine behindernde Last an technischer Schulden und Reibung gegen die Akzeptanz mit sich tragen. Dies macht Lösungen wie die Content Authenticity Initiative und das unerfüllte Metaphysic.ai-Gesichts-Urheberrechtssystem Metaphysic Pro herausfordernd zu popularisieren.

In ihrer breitesten Verwendung können RAG-basierte Systeme nur bestimmen, ob eine Autoritätsquelle eine unverifizierte Behauptung unterstützt; und da viele große (wahre) Nachrichtengeschichten ohne vorherigen Kontext auftauchen, ist das Fehlen einer Bestätigung durch Autoritätsquellen nicht unbedingt bedeutungsvoll.

Ihr Wert mag sich als größer erweisen, wenn sie Teil eines umfassenderen Datenökosystems sind, das sich mit dem beschäftigt, was die meisten aktuellen Formen von KI herausfordert – historischen Kontext.

* Nicht zu verwechseln mit den frühen Autoencoder-Ausgaben, die 2017 debütierten und schließlich von überlegenen Ansätzen abgelöst werden würden.

† https://arxiv.org/abs/2511.07009

** Die normalerweise frei auf leistungsstärkeren Heim-PCs laufen können, anstatt nur über gate-gehütete APIs wie ChatGPT und die Veo-Serie verfügbar zu sein.

††† Ausgenommen legitime Unterhaltungszwecke, wie professionelle visuelle Effekte in Film- und Fernsehproduktionen.

Erstveröffentlichung: Donnerstag, 13. November 2025