Künstliche Intelligenz

Stabile Videodiffusion: Latente Videodiffusionsmodelle für große Datensätze

Generative KI ist seit einiger Zeit eine treibende Kraft in der KI-Community, und die Fortschritte auf dem Gebiet der generativen Bildmodellierung, insbesondere durch die Verwendung von Diffusionsmodellen, haben dazu beigetragen, dass die generativen Videomodelle nicht nur in der Forschung, sondern auch im Hinblick auf erhebliche Fortschritte erzielt wurden reale Anwendungen. Herkömmlicherweise werden generative Videomodelle entweder von Grund auf trainiert oder sie werden teilweise oder vollständig anhand vorab trainierter Bildmodelle mit zusätzlichen zeitlichen Schichten auf einer Mischung aus Bild- und Videodatensätzen verfeinert.

In diesem Artikel werden wir die Fortschritte bei generativen Videomodellen vorantreiben und darüber sprechen Stabiles Videodiffusionsmodell, ein latentes Videodiffusionsmodell, das hochauflösende, hochmoderne Bild-zu-Video- und Text-zu-Video-Inhalte erzeugen kann. Wir werden darüber sprechen, wie latente Diffusionsmodelle, die für die Synthese von 2D-Bildern trainiert wurden, die Fähigkeiten und Effizienz generativer Videomodelle verbessert haben, indem sie zeitliche Schichten hinzugefügt und die Modelle anhand kleiner Datensätze, die aus hochwertigen Videos bestehen, verfeinert haben. Wir werden tiefer in die Architektur und Funktionsweise des Stable Video Diffusion Model eintauchen, seine Leistung anhand verschiedener Metriken bewerten und es mit aktuellen State-of-the-Art-Frameworks für die Videogenerierung vergleichen. Also lasst uns anfangen.

Stabiles Videodiffusionsmodell und generative Videomodelle: Eine Einführung

Dank ihres nahezu unbegrenzten Potenzials ist generative KI seit einiger Zeit das Hauptforschungsthema für KI- und ML-Praktiker, und in den letzten Jahren gab es rasante Fortschritte sowohl hinsichtlich der Effizienz als auch der Leistung generativer Bildmodelle. Die Erkenntnisse aus generativen Bildmodellen haben es Forschern und Entwicklern ermöglicht, Fortschritte bei generativen Videomodellen zu erzielen, was zu einer verbesserten Praktikabilität und Anwendungen in der realen Welt führt. Die meisten Forschungsarbeiten zur Verbesserung der Fähigkeiten generativer Videomodelle konzentrieren sich jedoch hauptsächlich auf die genaue Anordnung zeitlicher und räumlicher Schichten, wobei der Untersuchung des Einflusses der Auswahl der richtigen Daten auf das Ergebnis dieser generativen Modelle kaum Aufmerksamkeit geschenkt wird.

Dank der Fortschritte generativer Bildmodelle haben Forscher beobachtet, dass der Einfluss der Trainingsdatenverteilung auf die Leistung generativer Modelle tatsächlich erheblich und unbestritten ist. Darüber hinaus haben Forscher auch beobachtet, dass das Vortraining eines generativen Bildmodells anhand eines großen und vielfältigen Datensatzes und die anschließende Feinabstimmung anhand eines kleineren Datensatzes mit besserer Qualität häufig zu einer erheblichen Leistungsverbesserung führt. Traditionell implementieren generative Videomodelle die Erkenntnisse aus erfolgreichen generativen Bildmodellen, und Forscher müssen die Wirkung von Daten noch untersuchen, und Trainingsstrategien müssen noch untersucht werden. Das Stable Video Diffusion Model ist ein Versuch, die Fähigkeiten generativer Videomodelle zu verbessern, indem man sich in bisher unbekannte Gebiete vorwagt, wobei der Schwerpunkt auf der Auswahl von Daten liegt.

Neuere generative Videomodelle basieren auf Diffusionsmodellen und Textkonditionierungs- oder Bildkonditionierungsansätzen, um mehrere konsistente Video- oder Bildrahmen zu synthetisieren. Diffusionsmodelle sind für ihre Fähigkeit bekannt, durch die Implementierung eines iterativen Verfeinerungsprozesses zu lernen, wie man eine Stichprobe schrittweise aus der Normalverteilung entrauscht, und sie haben wünschenswerte Ergebnisse bei hochauflösenden Videos und der Text-zu-Bild-Synthese geliefert. Das Stable Video Diffusion Model nutzt im Kern dasselbe Prinzip und trainiert ein latentes Videodiffusionsmodell auf seinem Videodatensatz zusammen mit der Verwendung von Generative Adversarial Networks oder GANs und in gewissem Umfang sogar autoregressiven Modellen.

Das stabile Videodiffusionsmodell folgt einer einzigartigen Strategie, die von keinem generativen Videomodell implementiert wurde, da es auf latenten Videodiffusionsbasislinien mit einer festen Architektur und einer festen Trainingsstrategie basiert, gefolgt von der Bewertung der Wirkung der Kuratierung der Daten. Das Stable Video Diffusion Model zielt darauf ab, die folgenden Beiträge im Bereich der generativen Videomodellierung zu leisten.

- Vorstellung eines systematischen und effektiven Datenkuratierungsworkflows mit dem Ziel, eine große Sammlung nicht kuratierter Videobeispiele in hochwertige Datensätze umzuwandeln, die dann von den generativen Videomodellen verwendet werden.

- Um hochmoderne Bild-zu-Video- und Text-zu-Video-Modelle zu trainieren, die die vorhandenen Frameworks übertreffen.

- Durchführung domänenspezifischer Experimente zur Untersuchung des 3D-Verständnisses und der starken Priorisierung der Bewegung des Modells.

Das stabile Videodiffusionsmodell implementiert nun die Erkenntnisse aus latenten Videodiffusionsmodellen und Datenkurationstechniken als Kern seiner Grundlage.

Latente Videodiffusionsmodelle

Latente Videodiffusionsmodelle oder Video-LDMs verfolgen den Ansatz, das primäre generative Modell in einem latenten Raum mit reduzierter Rechenkomplexität zu trainieren, und die meisten Video-LDMs implementieren ein vorab trainiertes Text-zu-Bild-Modell in Verbindung mit dem Hinzufügen zeitlicher Mischschichten im Vortraining die Architektur. Daher trainieren die meisten Video-Latent-Diffusion-Modelle entweder nur zeitliche Schichten oder überspringen den Trainingsprozess ganz, im Gegensatz zum Stable-Video-Diffusion-Modell, das das gesamte Framework feinabstimmt. Darüber hinaus bedingt sich das Stable Video Diffusion Model für die Synthese von Text-zu-Video-Daten direkt an eine Textaufforderung, und die Ergebnisse zeigen, dass das resultierende Framework problemlos in eine Multi-View-Synthese oder ein Bild-in-Video-Modell verfeinert werden kann.

Datenpflege

Die Datenkuration ist nicht nur eine wesentliche Komponente des Stable Video Diffusion Model, sondern für generative Modelle insgesamt, da es wichtig ist, große Modelle anhand umfangreicher Datensätze vorab zu trainieren, um die Leistung bei verschiedenen Aufgaben zu steigern, einschließlich Sprachmodellierung oder diskriminierender Text-zu-Bild-Generierung , und vieles mehr. Die Datenkuration wurde erfolgreich auf generativen Bildmodellen implementiert, indem die Fähigkeiten effizienter Sprach-Bild-Darstellungen genutzt wurden, obwohl solche Diskussionen bei der Entwicklung generativer Videomodelle nie im Mittelpunkt standen. Beim Kuratieren von Daten für generative Videomodelle stehen Entwickler vor mehreren Hürden. Um diese Herausforderungen zu bewältigen, implementiert das Stable Video Diffusion Model eine dreistufige Trainingsstrategie, die zu verbesserten Ergebnissen und einer erheblichen Leistungssteigerung führt.

Datenkuration für hochwertige Videosynthese

Wie im vorherigen Abschnitt erläutert, implementiert das Stable Video Diffusion Model eine dreistufige Trainingsstrategie, die zu verbesserten Ergebnissen und einer deutlichen Leistungssteigerung führt. Stufe I ist ein Bildvortraining Bühne, die ein 2D-Text-zu-Bild-Diffusionsmodell nutzt. Stufe II ist für Video-Vorschulung bei dem das Framework auf einer großen Menge an Videodaten trainiert. Endlich haben wir Stufe III für Video-Feinabstimmung Dabei wird das Modell anhand einer kleinen Teilmenge hochwertiger und hochauflösender Videos verfeinert.

Bevor das Stable Video Diffusion Model diese drei Phasen implementiert, ist es jedoch wichtig, die Daten zu verarbeiten und zu kommentieren, da sie als Grundlage für Phase II oder die Video-Vortrainingsphase dienen und eine entscheidende Rolle bei der Gewährleistung der optimalen Ausgabe spielen. Um maximale Effizienz zu gewährleisten, implementiert das Framework zunächst eine kaskadierte Schnitterkennungspipeline mit 3 verschiedenen FPS- oder Frames-per-Sekunde-Stufen. Die Notwendigkeit dieser Pipeline wird in der folgenden Abbildung veranschaulicht.

Als nächstes kommentiert das Stable Video Diffusion Model jeden Videoclip mit drei verschiedenen synthetischen Untertitelmethoden. In der folgenden Tabelle werden die im Stable Diffusion Framework verwendeten Datensätze vor und nach dem Filterprozess verglichen.

Stufe I: Bildvorschulung

Die erste Stufe in der dreistufigen Pipeline, die im Stable Video Diffusion Model implementiert ist, ist das Bild-Vortraining. Um dies zu erreichen, basiert das anfängliche Stable Video Diffusion Model-Framework auf einem vorab trainierten Bilddiffusionsmodell, nämlich dem Stalldiffusion 2.1 Modell, das es mit stärkeren visuellen Darstellungen ausstattet.

Stufe II: Video-Vorschulung

Die zweite Phase ist die Video-Pre-Training-Phase und baut auf den Erkenntnissen auf, dass der Einsatz der Datenkuration in multimodalen generativen Bildmodellen oft zu besseren Ergebnissen und einer gesteigerten Effizienz zusammen mit einer leistungsstarken diskriminierenden Bilderzeugung führt. Aufgrund des Mangels an ähnlich leistungsstarken Standarddarstellungen zum Herausfiltern unerwünschter Samples für generative Videomodelle verlässt sich das Stable Video Diffusion Model jedoch auf menschliche Präferenzen als Eingabesignale für die Erstellung eines geeigneten Datensatzes, der zum Vortraining des Frameworks verwendet wird. Die folgende Abbildung zeigt den positiven Effekt des Vortrainings des Frameworks auf einen kuratierten Datensatz, der dazu beiträgt, die Gesamtleistung für das Video-Vortraining auf kleineren Datensätzen zu steigern.

Genauer gesagt verwendet das Framework verschiedene Methoden, um Teilmengen der latenten Videodiffusion zu kuratieren, und berücksichtigt die Rangfolge der auf diesen Datensätzen trainierten LVD-Modelle. Darüber hinaus stellt das Stable Video Diffusion-Framework fest, dass die Verwendung kuratierter Datensätze zum Training der Frameworks dazu beiträgt, die Leistung des Frameworks und der Diffusionsmodelle im Allgemeinen zu steigern. Darüber hinaus funktioniert die Datenkurationsstrategie auch bei größeren, relevanteren und äußerst praktischen Datensätzen. Die folgende Abbildung zeigt den positiven Effekt des Vortrainings des Frameworks auf einen kuratierten Datensatz, der dazu beiträgt, die Gesamtleistung für das Video-Vortraining auf kleineren Datensätzen zu steigern.

Stufe III: Hochwertige Feinabstimmung

Bis Stufe II konzentriert sich das Stable Video Diffusion-Framework auf die Verbesserung der Leistung vor dem Video-Vortraining, und in der dritten Stufe legt das Framework seinen Schwerpunkt auf die Optimierung oder weitere Steigerung der Leistung des Frameworks nach der Feinabstimmung hochwertiger Videos und auf die Art und Weise Der Übergang von der Stufe II zur Stufe III wird im Rahmenwerk erreicht. In Stufe III stützt sich das Framework auf Trainingstechniken, die von Latent-Image-Diffusionsmodellen übernommen wurden, und erhöht die Auflösung der Trainingsbeispiele. Um die Wirksamkeit dieses Ansatzes zu analysieren, vergleicht das Framework ihn mit drei identischen Modellen, die sich lediglich hinsichtlich ihrer Initialisierung unterscheiden. Die Gewichte des ersten identischen Modells werden initialisiert und der Videotrainingsprozess wird übersprungen, während die verbleibenden beiden identischen Modelle mit den Gewichten initialisiert werden, die von anderen latenten Videomodellen übernommen wurden.

Ergebnisse und Erkenntnisse

Es ist an der Zeit, einen Blick auf die Leistung des Stable Video Diffusion-Frameworks bei realen Aufgaben zu werfen und es im Vergleich zu den aktuellen, hochmodernen Frameworks zu vergleichen. Das Stable Video Diffusion-Framework verwendet zunächst den optimalen Datenansatz, um ein Basismodell zu trainieren, und führt dann eine Feinabstimmung durch, um mehrere hochmoderne Modelle zu generieren, von denen jedes Modell eine bestimmte Aufgabe erfüllt.

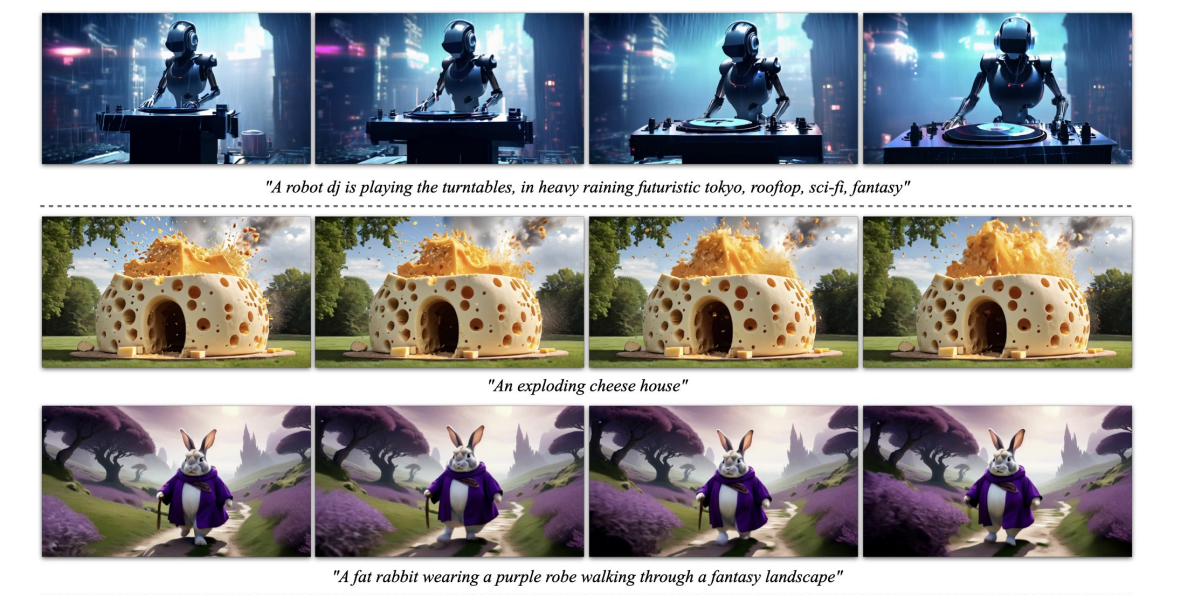

Das obige Bild stellt die vom Framework generierten hochauflösenden Bild-zu-Video-Beispiele dar, während die folgende Abbildung die Fähigkeit des Frameworks zeigt, hochwertige Text-zu-Video-Beispiele zu generieren.

Vorab trainierte Basis Modell

Wie bereits erwähnt, basiert das Stable Video Diffusion-Modell auf dem Stable Diffusion 2.1-Framework. Aufgrund neuerer Erkenntnisse war es für Entwickler von entscheidender Bedeutung, den Rauschplan zu übernehmen und das Rauschen zu erhöhen, um beim Training der Bildstreuung Bilder mit besserer Auflösung zu erhalten Modelle. Dank dieses Ansatzes lernt das Stable Video Diffusion-Basismodell leistungsstarke Bewegungsdarstellungen und übertrifft dabei die Basismodelle Text an Die Videogenerierung erfolgt in einer Zero-Shot-Einstellung. Die Ergebnisse werden in der folgenden Tabelle angezeigt.

Frame-Interpolation und Multi-View-Generierung

Das Stable Video Diffusion-Framework optimiert das Bild-Video-Modell für Datensätze mit mehreren Ansichten, um mehrere neuartige Ansichten eines Objekts zu erhalten. Dieses Modell ist als SVD-MV oder Stable Video Diffusion-Multi View-Modell bekannt. Das ursprüngliche SVD-Modell wird mithilfe von zwei Datensätzen so verfeinert, dass das Framework ein einzelnes Bild eingibt und als Ausgabe eine Folge von Bildern mit mehreren Ansichten zurückgibt.

Wie in den folgenden Bildern zu sehen ist, liefert das Stable Video Diffusion Multi View-Framework eine hohe Leistung, die mit dem hochmodernen Scratch Multi View-Framework vergleichbar ist, und die Ergebnisse sind ein klarer Beweis für die Fähigkeit von SVD-MV, die gewonnenen Erkenntnisse zu nutzen aus dem ursprünglichen SVD-Framework für die Generierung von Bildern mit mehreren Ansichten. Darüber hinaus deuten die Ergebnisse auch darauf hin, dass die Ausführung des Modells für eine relativ geringere Anzahl von Iterationen dazu beiträgt, optimale Ergebnisse zu liefern, wie dies bei den meisten Modellen der Fall ist, die anhand des SVD-Frameworks feinabgestimmt wurden.

In der obigen Abbildung sind die Metriken auf der linken Seite angegeben und wie man sehen kann, übertrifft das Stable Video Diffusion Multi-View-Framework die Scratch-MV- und SD2.1-Multi-View-Frameworks deutlich. Das zweite Bild zeigt die Auswirkung der Anzahl der Trainingsiterationen auf die Gesamtleistung des Frameworks im Hinblick auf den Clip Score. Die SVD-MV-Frameworks liefern nachhaltige Ergebnisse.

Fazit

In diesem Artikel haben wir über Stable Video Diffusion gesprochen, ein latentes Videodiffusionsmodell, das hochauflösende, hochmoderne Bild-zu-Video- und Text-zu-Video-Inhalte erzeugen kann. Das stabile Videodiffusionsmodell folgt einer einzigartigen Strategie, die von keinem generativen Videomodell implementiert wurde, da es auf latenten Videodiffusionsbasislinien mit einer festen Architektur und einer festen Trainingsstrategie basiert, gefolgt von der Bewertung der Wirkung der Kuratierung der Daten.

Wir haben darüber gesprochen, wie latente Diffusionsmodelle, die für die Synthese von 2D-Bildern trainiert wurden, die Fähigkeiten und Effizienz von verbessert haben Generative Videomodelle durch das Hinzufügen zeitlicher Schichten und die Feinabstimmung der Modelle anhand kleiner Datensätze, die aus hochwertigen Videos bestehen. Um die Daten vor dem Training zu sammeln, führt das Framework Skalierungsstudien durch und befolgt systematische Datenerfassungspraktiken. Schließlich schlägt es eine Methode zum Kuratieren einer großen Menge an Videodaten vor und wandelt verrauschte Videos in Eingabedaten um, die für generative Videomodelle geeignet sind.

Darüber hinaus verwendet das Stable Video Diffusion-Framework drei verschiedene Videomodell-Trainingsphasen, die unabhängig voneinander analysiert werden, um ihre Auswirkungen auf die Leistung des Frameworks zu bewerten. Das Framework gibt letztendlich eine Videodarstellung aus, die leistungsstark genug ist, um die Modelle für eine optimale Videosynthese zu verfeinern, und die Ergebnisse sind mit den bereits verwendeten hochmodernen Videogenerierungsmodellen vergleichbar.