Künstliche Intelligenz

Entflechtung ist die nächste Deepfake-Revolution

CGI-Datenergänzung wird in einem neuen Projekt verwendet, um eine größere Kontrolle über Deepfake-Bilder zu erlangen. Obwohl Sie immer noch keine CGI-Köpfe effektiv verwenden können, um die fehlenden Lücken in Deepfake-Gesichtsdatensätzen zu füllen, bedeutet eine neue Welle von Forschungen zur Entflechtung von Identität und Kontext, dass Sie dies bald vielleicht nicht mehr müssen.

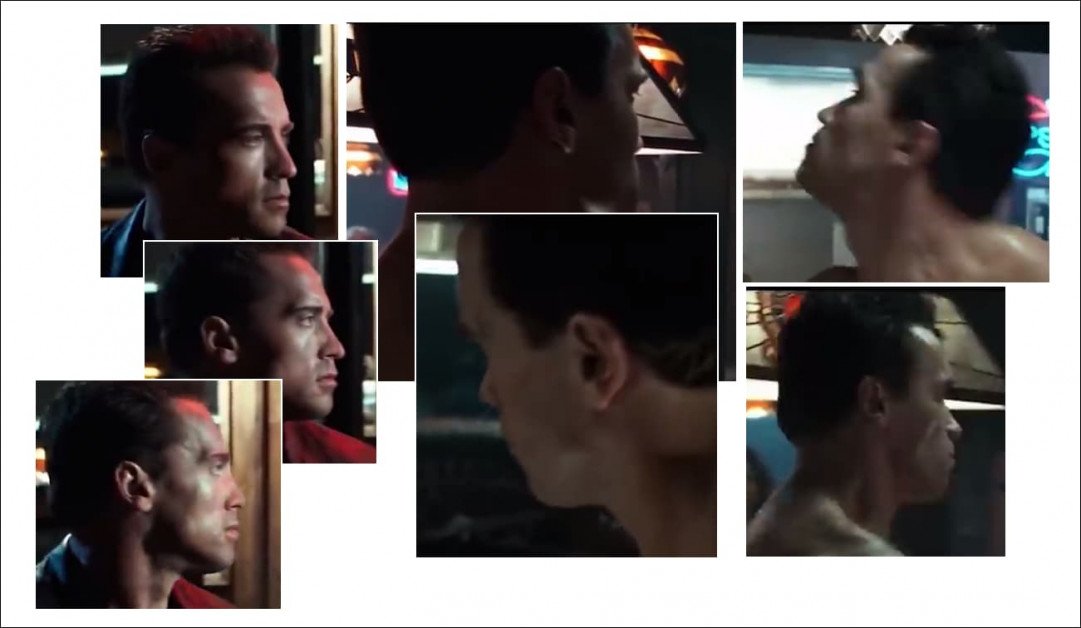

Die Ersteller einiger der erfolgreichsten viralen Deepfake-Videos der letzten Jahre wählen ihre Quellvideos sehr sorgfältig aus und vermeiden anhaltende Profilbilder (d. h. die Art von Seitenansichten, die von Polizeiverfahren popularisiert wurden), scharfe Winkel und ungewöhnliche oder übertriebene Ausdrücke. Immer mehr werden die Demonstrationsvideos, die von viralen Deepfakers produziert werden, zu bearbeiteten Kompilationen, die die “einfachsten” Winkel und Ausdrücke für Deepfakes auswählen.

Tatsächlich ist das zugänglichste Zielvideo, in das ein deepgefälschtes Celebrity eingefügt werden kann, ein Video, in dem die ursprüngliche Person (deren Identität durch den Deepfake gelöscht wird) direkt in die Kamera schaut, mit einem minimalen Ausdrucksbereich.

Die Mehrheit der beliebten Deepfakes der letzten Jahre zeigte Subjekte, die direkt in die Kamera schauten, und entweder nur beliebte Ausdrücke (wie Lächeln) trugen, die leicht aus roten Teppich-Paparazzi-Ausgaben extrahiert werden können, oder (wie bei der 2019er Fälschung von Sylvester Stallone als Terminator, links abgebildet), idealerweise mit keiner Ausdrucksweise, da neutrale Ausdrücke sehr häufig sind und leicht in Deepfake-Modelle integriert werden können.

Weil Deepfake-Technologien wie DeepFaceLab und FaceSwap diese einfacheren Austausche sehr gut durchführen, sind wir ausreichend beeindruckt von dem, was sie erreichen, um nicht zu bemerken, was sie nicht können, und – oft – nicht einmal zu versuchen:

Grabs aus einem anerkannten Deepfake-Video, in dem Arnold Schwarzenegger in Sylvester Stallone verwandelt wird – es sei denn, die Winkel sind zu knifflig. Profile bleiben ein anhaltendes Problem bei aktuellen Deepfake-Ansätzen, teilweise weil die Open-Source-Software, die zur Definition von Gesichtsposen in Deepfake-Frameworks verwendet wird, nicht für Seitenansichten optimiert ist, aber hauptsächlich weil es an geeigneten Quellenmaterial in einem oder beiden der notwendigen Datensätze mangelt. Quelle: https://www.youtube.com/watch?v=AQvCmQFScMA

Neue Forschung aus Israel schlägt eine neue Methode vor, bei der synthetische Daten wie CGI-Köpfe verwendet werden, um Deepfakes in die 2020er Jahre zu bringen, indem sie tatsächlich Identität von Kontext trennen (d. h. die wesentlichen Gesichtsmerkmale von “Tom Cruise” aus allen Winkeln von allen Winkeln).

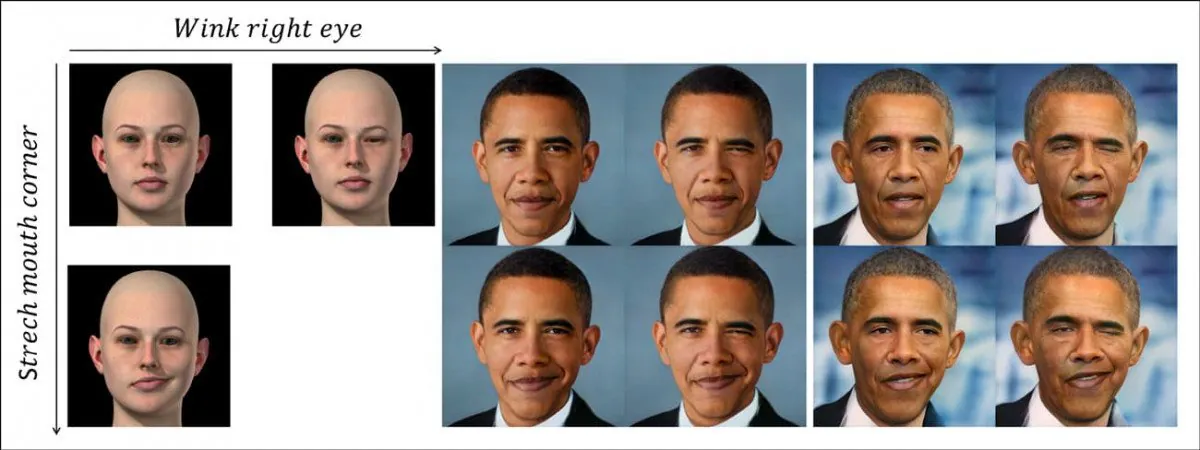

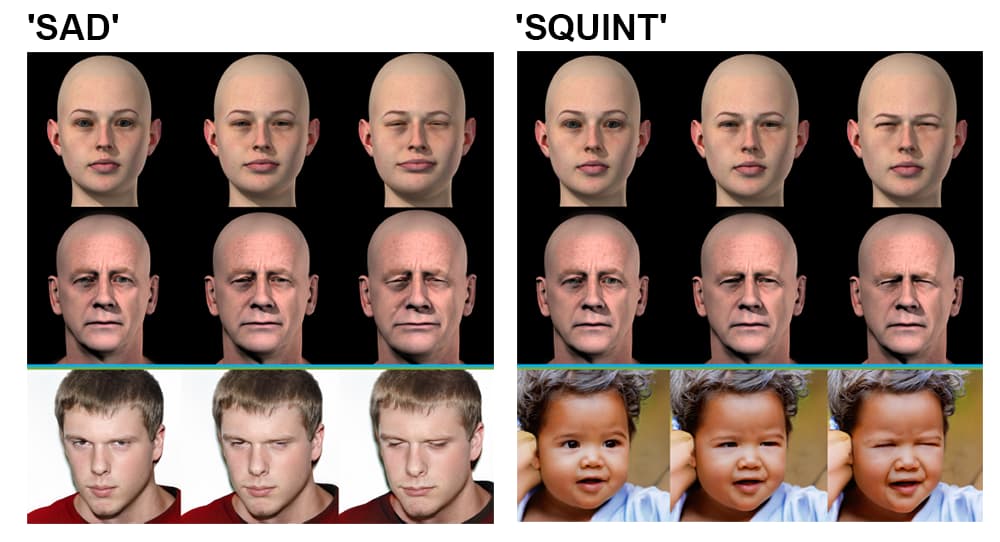

Das neue System trennt Pose und Kontext (d. h. ein Auge zwinkern) von der Identitätskodierung der Person, indem es unabhängige synthetische Gesichtsdaten (links abgebildet) verwendet. In der oberen Reihe sehen wir ein “Zwinkern”, das auf die Identität von Barack Obama übertragen wird, ausgelöst durch den erlernten nichtlinearen Pfad des latenten Raums eines GAN, der durch das CGI-Bild links repräsentiert wird. In der Reihe darunter sehen wir die übertragene Facette der Mundwinkel. Unten rechts sehen wir beide Merkmale gleichzeitig angewendet. Quelle: https://arxiv.org/pdf/2111.08419.pdf

Dies ist nicht bloßes Deepfake-Kopfpuppen, eine Technik, die eher für Avatare und partielle Lippen-Synchronisation geeignet ist und nur begrenztes Potenzial für vollständige Deepfake-Video-Transformationen hat.

Vielmehr stellt dies einen Weg nach vorne für eine grundlegende Trennung von Instrumentalität (wie z. B. “den Kopf neigen” oder “eine Falte schaffen”) von Identität dar, was einen Weg zu einem hochentwickelten anstelle eines “abgeleiteten” Bildsynthese-basierten Deepfake-Framework bietet.

Das neue Papier trägt den Titel Delta-GAN-Encoder: Kodierung semantischer Änderungen für explizite Bildbearbeitung mit wenigen synthetischen Proben und stammt von Forschern am Technion – Israel Institute of Technology.

Um zu verstehen, was die Arbeit bedeutet, lassen Sie uns einen Blick darauf werfen, wie Deepfakes derzeit überall von Deepfake-Pornoseiten bis hin zu Industrial Light and Magic (da das DeepFaceLab-Open-Source-Repository derzeit in beiden “Amateur”- und professionellen Deepfaking-Bereichen dominant ist) produziert werden.

Was hält die aktuelle Deepfake-Technologie zurück?

Deepfakes werden derzeit durch das Trainieren eines Encoder/Decoder-Machine-Learning-Modells auf zwei Ordnern mit Gesichtsbildern erstellt – der Person, die Sie “übermalen” möchten (in dem früheren Beispiel ist das Arnie), und der Person, die Sie in das Video einfügen möchten (Sly).

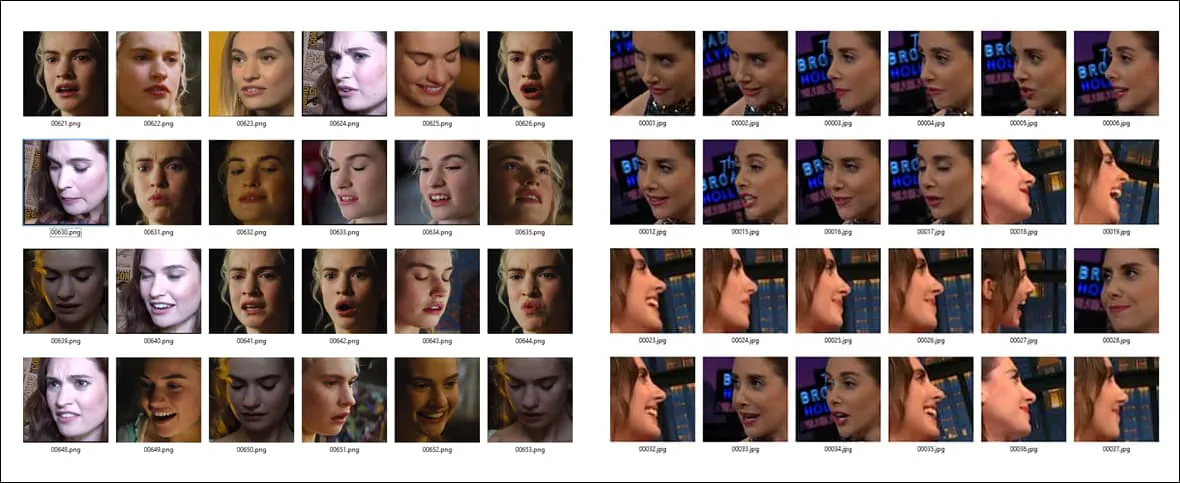

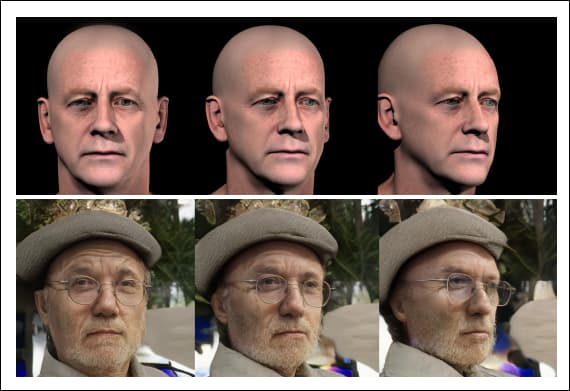

Beispiele für varying Pose und Beleuchtungsbedingungen über zwei verschiedene Gesichtssätze. Beachten Sie den deutlichen Ausdruck am Ende der dritten Reihe in Spalte A, der wahrscheinlich keine enge Entsprechung im anderen Datensatz hat.

Das Encoder/Decoder-System vergleicht dann jedes einzelne Bild in jedem Ordner mit jedem anderen, erhält, verbessert und wiederholt diese Operation für Hunderttausende von Iterationen (oft für so lange wie eine Woche), bis es die wesentlichen Merkmale beider Identitäten gut genug versteht, um sie nach Belieben austauschen zu können.

Für jede der beiden Personen, die im Prozess ausgetauscht werden, ist das, was die Deepfake-Architektur über Identität lernt, verflochten mit Kontext. Es kann nicht lernen und anwenden, was ein generischer Pose “für immer und ewig” ist, sondern benötigt reichlich Beispiele im Trainingsdatensatz für jede Identität, die am Gesichtsaustausch beteiligt ist.

Daher benötigen Sie, wenn Sie zwei Identitäten austauschen möchten, die etwas Ungewöhnlicheres tun als nur Lächeln oder direkt in die Kamera schauen, viele Instanzen dieser bestimmten Pose/Identität in beiden Gesichtssätzen:

Weil Gesichts-ID und Pose-Merkmale derzeit so eng miteinander verflochten sind, ist eine umfassende Parität von Ausdruck, Kopfhaltung und (in geringerem Maße) Beleuchtung erforderlich, um ein effektives Deepfake-Modell auf Systemen wie DeepFaceLab zu trainieren. Je weniger eine bestimmte Konfiguration (wie “Seitenansicht/Lächeln/sonnig”) in beiden Gesichtssätzen vorkommt, desto weniger genau wird sie in einem Deepfake-Video gerendert, wenn sie benötigt wird.

Wenn Satz A die ungewöhnliche Pose enthält, aber Satz B sie fehlt, sind Sie ziemlich ausgeschlossen; egal, wie lange Sie das Modell trainieren, es wird nie lernen, diese Pose gut zwischen den Identitäten zu reproduzieren, weil es nur die Hälfte der notwendigen Informationen hatte, als es trainiert wurde.

Even wenn Sie passende Bilder haben, kann es nicht ausreichen: Wenn Satz A die passende Pose hat, aber mit harter Seitenbeleuchtung im Vergleich zur flach beleuchteten äquivalenten Pose im anderen Gesichtssatz, ist die Qualität des Austauschs nicht so gut wie wenn beide gemeinsame Beleuchtungsmerkmale aufweisen.

Warum die Daten knapp sind

Es sei denn, Sie werden regelmäßig verhaftet, haben Sie wahrscheinlich nicht allzu viele Seitenansichten von sich selbst. Jede, die aufkam, haben Sie wahrscheinlich weggeworfen. Da Bildagenturen dies auch tun, sind Profilgesichtsaufnahmen schwer zu finden.

Deepfakers fügen oft mehrere Kopien der begrenzten Seitenansichtsdaten, die sie für eine Identität haben, in einen Gesichtssatz ein, nur damit diese Pose wenigstens ein bisschen Aufmerksamkeit und Zeit während des Trainings erhält, anstatt als Outlier abgelehnt zu werden.

Aber es gibt viele mehr mögliche Arten von Seitenansicht-Gesichtsbildern als wahrscheinlich in einem Datensatz enthalten sind – Lächeln, Falten, Schreien, Weinen, dunkel beleuchtet, verachtend, gelangweilt, heiter, blitzlichtartig beleuchtet, nach oben schauen, nach unten schauen, Augen offen, Augen geschlossen… und so weiter. Jede dieser Posen, in mehreren Kombinationen, könnte in einem Ziel-Deepfake-Video benötigt werden.

Und das ist nur Profil. Wie viele Bilder haben Sie von sich selbst, die direkt nach oben schauen? Haben Sie genug, um die 10.000 möglichen Ausdrücke darzustellen, die Sie während der genauen Pose aus der genauen Kameraperspektive tragen könnten, unter Berücksichtigung von mindestens einigen der eine Million möglichen Beleuchtungsumgebungen?

Wahrscheinlich haben Sie nicht einmal ein Bild von sich selbst, das nach oben schaut. Und das ist nur zwei Winkel von den hundert oder mehr, die für eine vollständige Abdeckung erforderlich sind.

Sogar wenn es möglich wäre, eine vollständige Abdeckung eines Gesichts aus allen Winkeln unter verschiedenen Beleuchtungsbedingungen zu erzeugen, wäre der resultierende Datensatz viel zu groß, um trainiert zu werden, in der Größenordnung von Hunderttausenden von Bildern; und selbst wenn er könnte trainiert werden, würde die Natur des Trainingsprozesses für aktuelle Deepfake-Frameworks den größten Teil dieser zusätzlichen Daten zugunsten einer begrenzten Anzahl abgeleiteter Merkmale verwerfen, da die aktuellen Frameworks reduktionistisch und nicht sehr skalierbar sind.

Synthetischer Ersatz

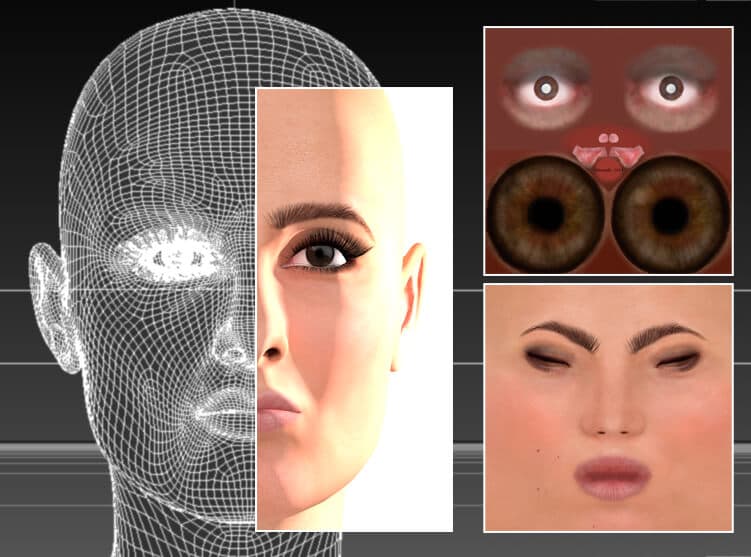

Seit den Anfängen von Deepfakes haben Deepfaker mit der Verwendung von CGI-ähnlichen Bildern, Köpfen, die in 3D-Anwendungen wie Cinema4D und Maya erstellt wurden, experimentiert, um diese “fehlenden Posen” zu erzeugen.

Kein AI notwendig; eine Schauspielerin wird in einem traditionellen CGI-Programm, Cinema 4D, mit Meshes und bitmapped Texturen rekonstruiert – Technologie, die bis in die 1960er Jahre zurückreicht, obwohl sie erst in den 1990er Jahren weite Verbreitung fand. Im Prinzip könnte dieses Gesichtsmodell verwendet werden, um Deepfake-Quelldaten für ungewöhnliche Posen, Beleuchtungsstile und Gesichtsausdrücke zu erzeugen. In Wirklichkeit war es jedoch von begrenztem oder keinem Nutzen für Deepfakes, da die “Falschheit” der Renderings tendenziell in ausgetauschten Videos durchsickert. Quelle: Dieses Bild des Autors bei https://rossdawson.com/futurist/implications-of-ai/comprehensive-guide-ai-artificial-intelligence-visual-effects-vfx/

Diese Methode wird im Allgemeinen früh von neuen Deepfake-Praktikern aufgegeben, weil sie zwar Posen und Ausdrücke liefern kann, die sonst nicht verfügbar sind, die synthetische Erscheinung der CGI-Gesichter jedoch aufgrund der Verflechtung von ID und kontextueller/semantischer Information in den Austausch durchsickert.

Dies kann zu plötzlichen Aufblitzen von “uncanny valley”-Gesichtern in einem ansonsten überzeugenden Deepfake-Video führen, wenn der Algorithmus beginnt, auf die einzigen Daten zurückzugreifen, die er für eine ungewöhnliche Pose oder einen ungewöhnlichen Ausdruck haben kann – offensichtlich falsche Gesichter.

Unter den beliebtesten Themen für Deepfaker ist ein 3D-Deepfake-Algorithmus für die australische Schauspielerin Margot Robbie im Standard-Installationspaket von DeepFaceLive enthalten, einer Version von DeepFaceLab, die Deepfakes in einem Live-Stream, wie z. B. einer Webcam-Sitzung, durchführen kann. Ein CGI-Modell, wie oben abgebildet, könnte verwendet werden, um ungewöhnliche “fehlende” Winkel in Deepfake-Datensätzen zu erhalten. Quelle: https://sketchfab.com/3d-models/margot-robbie-bust-for-full-color-3d-printing-98d15fe0403b4e64902332be9cfb0ace

CGI-Gesichter als abgetrennte, konzeptionelle Richtlinien

Stattdessen ist die neue Delta-GAN-Encoder-(DGE)-Methode der israelischen Forscher effektiver, weil die Pose- und Kontextinformationen aus den CGI-Bildern vollständig von der “Identitäts”-Information der Zielperson getrennt wurden.

Wir können dieses Prinzip in Aktion sehen, indem verschiedene Kopforientierungen durch die Verwendung von CGI-Bildern als Richtlinie erhalten werden. Da die Identitätsmerkmale nicht mit den Kontextmerkmalen verbunden sind, gibt es weder ein Durchsickern der falsch aussehenden synthetischen Erscheinung des CGI-Gesichts noch der Identität, die in ihm dargestellt wird:

Mit der neuen Methode müssen Sie nicht drei separate Echtbildbilder finden, um einen Deepfake aus mehreren Winkeln zu erstellen – Sie können einfach den CGI-Kopf drehen, dessen abstrakte Merkmale auf die Identität ohne Leckagen von ID-Informationen übertragen werden.

Delta-GAN-Encoder. Obere linke Gruppe: Der Winkel eines Quellbildes kann in einer Sekunde geändert werden, um ein neues Quellbild zu rendern, das im Ausgang reflektiert wird; obere rechte Gruppe: Beleuchtung ist auch von Identität getrennt, was die Überlagerung von Beleuchtungsstilen ermöglicht; untere linke Gruppe: Mehrere Gesichtsdetails werden geändert, um einen “traurigen” Ausdruck zu erstellen; untere rechte Gruppe: Ein einzelnes Gesichtsdetail wird geändert, so dass die Augen blinzeln.

Diese Trennung von Identität und Kontext wird im Trainingsstadium erreicht. Die Pipeline für die neue Deepfake-Architektur sucht den latenten Vektor in einem vorgefertigten Generative Adversarial Network (GAN) aus, der dem zu transformierenden Bild entspricht – eine Sim2Real-Methode, die auf einem 2018er Projekt von IBM’s AI-Forschungssektion aufbaut.