Vordenker

Entschlüsselung von Chancen und Herausforderungen für LLM-Agenten in der generativen KI

Wir sehen eine Weiterentwicklung generativer KI-Anwendungen, die auf großen Sprachmodellen (LLM) basieren, von Eingabeaufforderungen über Retrieval Augmented Generation (RAG) bis hin zu Agenten. In Industrie- und Forschungskreisen wird viel über Agenten gesprochen, vor allem wegen der Leistungsfähigkeit, die diese Technologie bietet, um Unternehmensanwendungen zu transformieren und erstklassige Kundenerlebnisse zu bieten. Es gibt gängige Muster für den Aufbau von Agenten, die erste Schritte in Richtung künstlicher allgemeiner Intelligenz (AGI) ermöglichen.

In meinem vorherigen ArtikelWir haben eine intelligente Musterleiter für die Erstellung von LLM-basierten Anwendungen gesehen. Beginnend mit Eingabeaufforderungen, die den Problembereich erfassen und den internen LLM-Speicher zur Ausgabe nutzen. Mit RAG erweitern wir die Eingabeaufforderung mit externem Wissen aus einer Vektordatenbank, um die Ausgaben zu steuern. Durch die Verkettung von LLM-Aufrufen können wir anschließend Workflows zur Realisierung komplexer Anwendungen erstellen. Agenten bringen dies auf die nächste Ebene, indem sie automatisch bestimmen, wie diese LLM-Ketten gebildet werden sollen. Sehen wir uns das im Detail an.

Agenten – Unter der Haube

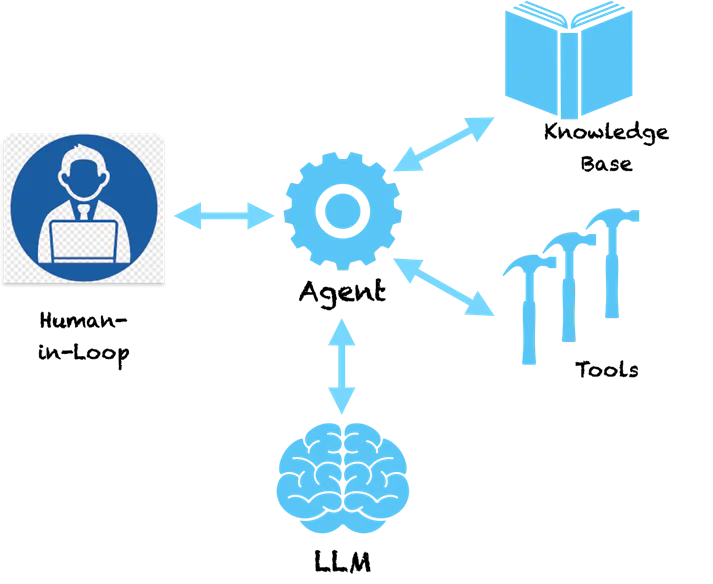

Ein wichtiges Muster bei Agenten besteht darin, dass sie die Sprachverständnisfähigkeiten des LLM nutzen, um einen Plan zur Lösung eines bestimmten Problems zu erstellen. Das LLM versteht das Problem und gibt uns eine Abfolge von Schritten zur Lösung vor. Doch damit ist es nicht getan. Agenten sind kein reines Supportsystem, das Ihnen Empfehlungen zur Problemlösung gibt und Sie dann zur Umsetzung der empfohlenen Schritte übergibt. Agenten verfügen über die nötigen Werkzeuge, um die Maßnahmen umzusetzen. Beängstigend, oder?

Wenn wir einem Agenten eine grundlegende Frage wie diese stellen:

Human: Welches Unternehmen gründete der Erfinder des Telefons?

Im Folgenden finden Sie Beispiele für Denkschritte, die ein Agent unternehmen kann.

Agent (DENKEN):

- Gedanke: Ich muss nach dem Erfinder des Telefons suchen.

- Action: Suche [Erfinder des Telefons]

- Beobachtung: Alexander Graham Bell

- Gedanke: Ich muss nach einem Unternehmen suchen, das von Alexander Graham Bell gegründet wurde

- Action: Suche [von Alexander Graham Bell gegründetes Unternehmen]

- Beobachtung: Alexander Graham Bell war 1885 Mitbegründer der American Telephone and Telegraph Company (AT&T).

- Gedanke: Ich habe die Antwort gefunden. Ich komme wieder.

Agent (ANTWORT): Alexander Graham Bell war 1885 Mitbegründer von AT&T

Sie können sehen, dass der Agent das Problem methodisch in Teilprobleme zerlegt, die durch spezifische Maßnahmen gelöst werden können. Die hier aufgeführten Maßnahmen werden vom LLM empfohlen und wir können sie spezifischen Tools zuordnen, um diese Maßnahmen umzusetzen. Wir könnten ein Suchtool für den Agenten aktivieren, sodass er, wenn er erkennt, dass LLM die Suche als Aktion bereitgestellt hat, dieses Tool mit den vom LLM bereitgestellten Parametern aufruft. Die Suche erfolgt hier im Internet, kann aber auch auf die Suche in einer internen Wissensdatenbank wie einer Vektordatenbank umgeleitet werden. Das System wird nun autark und kann anhand einer Reihe von Schritten herausfinden, wie komplexe Probleme gelöst werden können. Frameworks wie LangChain und LLaMAIndex bieten Ihnen eine einfache Möglichkeit, diese Agenten zu erstellen und eine Verbindung zu Tools und API herzustellen. Amazon hat kürzlich sein Bedrock Agents-Framework eingeführt, das eine visuelle Schnittstelle zum Entwerfen von Agenten bietet.

Unter der Haube verfolgen Agenten einen besonderen Stil, indem sie Eingabeaufforderungen an das LLM senden, die sie dazu veranlassen, einen Aktionsplan zu erstellen. Das obige Denk-Handlungs-Beobachtungsmuster ist bei einem Agententyp namens ReAct (Reasoning and Acting) beliebt. Weitere Arten von Agenten sind MRKL und Plan & Execute, die sich hauptsächlich in ihrem Aufforderungsstil unterscheiden.

Bei komplexeren Agenten können die Aktionen an Tools gebunden sein, die Änderungen in Quellsystemen verursachen. Beispielsweise könnten wir den Agenten mit einem Tool verbinden, das den Urlaubssaldo prüft und in einem ERP-System Urlaub für einen Mitarbeiter beantragt. Jetzt könnten wir einen netten Chatbot erstellen, der mit Benutzern interagiert und über einen Chat-Befehl Urlaub im System beantragt. Keine komplizierten Bildschirme mehr für die Beantragung von Urlaub, eine einfache, einheitliche Chat-Oberfläche. Klingt aufregend!?

Vorbehalte und Bedarf an verantwortungsvoller KI

Was wäre, wenn wir ein Tool hätten, das Transaktionen im Aktienhandel über eine vorab autorisierte API aufruft? Sie erstellen eine Anwendung, in der der Agent Bestandsveränderungen (mithilfe von Tools) untersucht und für Sie Entscheidungen über den Kauf und Verkauf von Lagerbeständen trifft. Was passiert, wenn der Agent die falschen Aktien verkauft, weil er halluziniert und eine falsche Entscheidung getroffen hat? Da es sich bei LLM um riesige Modelle handelt, ist es schwierig herauszufinden, warum sie bestimmte Entscheidungen treffen. Daher kommt es häufig zu Halluzinationen, wenn keine geeigneten Leitplanken vorhanden sind.

Obwohl Agenten alle faszinierend sind, hätten Sie wahrscheinlich erraten, wie gefährlich sie sein können. Wenn sie halluzinieren und falsche Maßnahmen ergreifen, kann dies zu enormen finanziellen Verlusten oder größeren Problemen in den Unternehmenssystemen führen. Daher wird verantwortungsvolle KI im Zeitalter LLM-gestützter Anwendungen immer wichtiger. Die Prinzipien der verantwortungsvollen KI rund um Reproduzierbarkeit, Transparenz und Verantwortlichkeit versuchen, den Entscheidungen von Agenten Grenzen zu setzen und eine Risikoanalyse vorzuschlagen, um zu entscheiden, welche Aktionen einen Menschen erfordern. Da komplexere Agenten entwickelt werden, benötigen sie mehr Kontrolle, Transparenz und Rechenschaftspflicht, um sicherzustellen, dass wir wissen, was sie tun.

Abschlussgedanken

Die Fähigkeit von Agenten, mit Aktionen einen Pfad aus logischen Schritten zu generieren, bringt sie dem menschlichen Denken wirklich nahe. Wenn man sie mit leistungsfähigeren Werkzeugen ausstattet, können sie Superkräfte erlangen. Muster wie ReAct versuchen nachzuahmen, wie Menschen das Problem lösen, und wir werden bessere Agentenmuster sehen, die für bestimmte Kontexte und Bereiche (Banken, Versicherungen, Gesundheitswesen, Industrie usw.) relevant sind. Die Zukunft ist da und die Technologie hinter den Agenten ist einsatzbereit. Gleichzeitig müssen wir die Leitplanken für verantwortungsvolle KI genau im Auge behalten, um sicherzustellen, dass wir kein Skynet aufbauen!