Künstliche Intelligenz

KI-Modelle scheitern beim einfachen Ablesen der Uhr, während Menschen brillieren

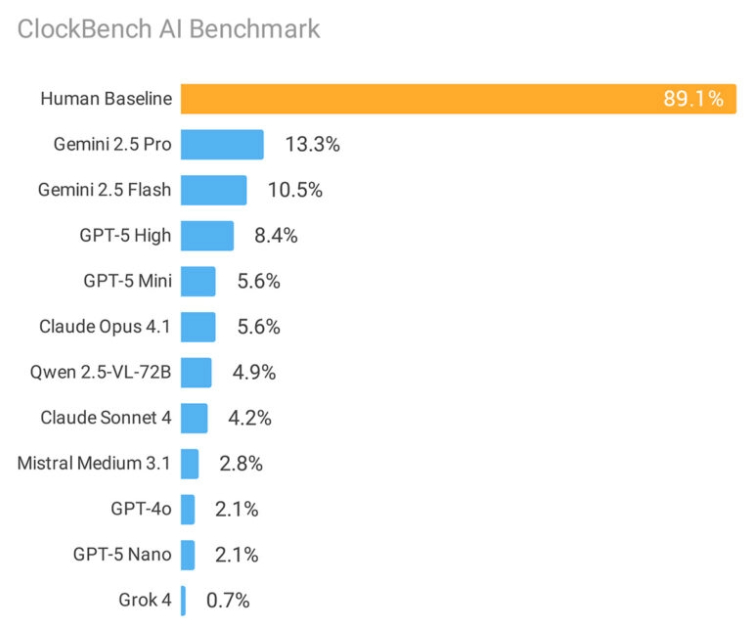

A umfassende Studie Der Vergleich von elf führenden KI-Modellen mit Menschen beim Ablesen analoger Uhren hat eine überraschende Schwäche aktueller künstlicher Intelligenzsysteme aufgedeckt. Während Menschen beim Ablesen der Uhrzeit eine Genauigkeit von 11 Prozent erreichten, erreichte Googles leistungsstärkstes Modell im selben Test nur eine Genauigkeit von 89.1 Prozent.

Die ClockBench-Studie des Forschers Alek Safar zeigt, dass selbst die fortschrittlichsten KI-Systeme mit visuellen Aufgaben zu kämpfen haben, die die meisten Menschen schon als Kinder beherrschen. Die Benchmark-getesteten Systeme von Google, OpenAI, Anthropischund andere große KI-Labore, die 180 speziell entwickelte analoge Uhren verwenden.

Dies geht über Uhren hinaus. Die Ergebnisse verdeutlichen grundlegende Einschränkungen bei der Verarbeitung und Auswertung visueller Informationen durch KI-Systeme. „Das Lesen analoger Uhren legt die Messlatte für das logische Denken im visuellen Raum hoch“, stellt Safar in der Forschungsarbeit fest. Die Aufgabe erfordert Modelle, die Uhrzeiger erkennen, ihre Beziehungen verstehen und visuelle Positionen in numerische Zeit übersetzen können.

Noch deutlicher wird die Leistungslücke, wenn man die Fehlermuster untersucht. Bei menschlichen Fehlern betrug die mittlere Fehlerquote lediglich drei Minuten. KI-Modelle hingegen verfehlten das Ziel um ein bis drei Stunden – was in etwa dem zufälligen Raten auf einer 12-Stunden-Uhr entspricht.

Spezifische Schwächen aufgedeckt

KI-Systeme hatten insbesondere mit folgenden Problemen zu kämpfen:

- Römische Ziffern (3.2 % Genauigkeit)

- Gespiegelte oder rückwärts gerichtete Zifferblätter

- Bunte Hintergründe oder komplexe Designs

- Uhren mit Sekundenzeigern, die eine genaue Ablesung erfordern

Interessanterweise schnitten KI-Modelle, die eine Uhr erfolgreich ablesen konnten, auch bei Folgeaufgaben wie dem Addieren von Uhrzeiten oder dem Umrechnen von Zeitzonen gut ab. Dies deutet darauf hin, dass die zentrale Herausforderung eher in der anfänglichen visuellen Erkennung als in der mathematischen Argumentation liegt.

Aufschlüsselung der Branchenleistung

Die Modelle von Google führten das Feld an, mit Gemini 2.5 Pro erreichte eine Genauigkeit von 13.3 % und Gemini 2.5 Flash eine Genauigkeit von 10.5 %. GPA-5 von OpenAI erreichte 8.4 %, während Anthropics Claude Die Modelle schnitten schlechter ab, mit Claude 4 Sonnet bei 4.2 % und Claude 4.1 Opus bei 5.6 %.

Grok 4 von xAI erzielte mit einer Genauigkeit von 0.7 % überraschend schlechte Ergebnisse. Dies lag jedoch daran, dass das Modell 63 % aller Uhren fälschlicherweise als unmögliche Zeiten anzeigend kennzeichnete, obwohl dies tatsächlich nur bei 20.6 % der Fall war.

Quelle: Alek Safar

Weitergehende Auswirkungen auf die KI-Entwicklung

Die Studie basiert auf dem Benchmark-Ansatz „einfach für Menschen, schwer für KI“, der in Tests wie ARC-AGI und SimpleBench. Während KI-Systeme wissensintensive Aufgaben schnell bewältigt und bei vielen standardisierten Tests sogar die menschliche Leistung übertroffen haben, bleibt das grundlegende visuelle Denken problematisch.

Die Forschung legt nahe, dass aktuelle Skalierungsansätze die Herausforderungen des visuellen Denkens möglicherweise nicht lösen. Safar vermutet, dass analoge Uhren in den Trainingsdaten unterrepräsentiert sein könnten und dass die Übersetzung visueller Uhrendarstellungen in Text für das logische Denken zusätzliche Komplikationen mit sich bringt.

ClockBench ergänzt eine wachsende Sammlung von Benchmarks, die darauf ausgelegt sind, KI-Einschränkungen zu identifizieren, die bei herkömmlichen Tests nicht sofort erkennbar sind. Der vollständige Datensatz bleibt vertraulich, um zukünftiges KI-Training zu verhindern. Nur kleine Stichproben werden für Tests öffentlich zugänglich gemacht.

Die Ergebnisse werfen die Frage auf, ob bestehende KI-Entwicklungsparadigmen diese Lücken im visuellen Denken schließen können oder ob völlig neue Ansätze erforderlich sind – ähnlich wie Test-Time-Computing in anderen Bereichen Fortschritte ermöglicht hat.

Derzeit stellt die einfache analoge Uhr eine unerwartete Festung gegen künstliche Intelligenz dar: Sie kann von praktisch jedem Menschen gelesen werden, verwirrt jedoch die fortschrittlichsten KI-Systeme der Welt.