أفضل من

أفضل 10 خوارزميات للتعلم الآلي

على الرغم من أننا نعيش في عصر من الابتكار الاستثنائي في مجال التعلم الآلي المعجل بواسطة وحدة معالجة الرسوميات، فإن أحدث أوراق البحث في كثير من الأحيان (وبشكل بارز) تتميز بخوارزميات عمرها عقود من الزمن، وفي بعض الحالات 70 عامًا.

قد يزعم البعض أن العديد من هذه الأساليب القديمة تندرج ضمن معسكر "التحليل الإحصائي" وليس التعلم الآلي، ويفضلون تحديد تاريخ ظهور هذا القطاع في عام 1957 فقط، مع اختراع Perceptron.

نظراً لمدى دعم هذه الخوارزميات القديمة لأحدث الاتجاهات والتطورات الرائجة في مجال التعلم الآلي وتداخلها معه، فإن هذا الموقف قابل للنقاش. لذا، دعونا نلقي نظرة على بعض الركائز الأساسية "الكلاسيكية" التي تُشكل أساس أحدث الابتكارات، بالإضافة إلى بعض الابتكارات الأحدث التي تُقدم على دخول قاعة مشاهير الذكاء الاصطناعي مبكراً.

1: المحولات

في عام 2017 ، قادت Google Research تعاونًا بحثيًا بلغ ذروته في ورقة الاهتمام هو كل ما تحتاجه. حدد العمل بنية جديدة روجت آليات الانتباه من "الأنابيب" في نماذج التشفير/فك التشفير والشبكات المتكررة إلى تقنية تحويلية مركزية في حد ذاتها.

النهج كان يطلق عليها اسم محول، ومنذ ذلك الحين أصبحت منهجية ثورية في معالجة اللغات الطبيعية (NLP)، مما يدعم، من بين العديد من الأمثلة الأخرى، نموذج اللغة الانحداري الذاتي وGPT-3 للذكاء الاصطناعي.

المحولات بأناقة حل مشكلة توصيل تسلسلي، ويُسمى أيضًا "التحويل"، وهو مُخصص لمعالجة تسلسلات الإدخال إلى تسلسلات الإخراج. يستقبل المحول البيانات ويديرها بشكل مستمر، بدلًا من الدفعات المتسلسلة، مما يسمح بـ"استمرار الذاكرة" الذي لا تُصمم هياكل الشبكات العصبية المتكررة لتحقيقه. لمزيد من التفاصيل حول المحولات، يُرجى الاطلاع على مقالنا المرجعي.

على النقيض من الشبكات العصبية المتكررة (RNNs) التي بدأت تهيمن على أبحاث تعلم الآلة في عصر CUDA، يمكن أيضًا تصميم بنية المحولات بسهولة مواز، مما يفتح الطريق للتعامل بشكل منتج مع مجموعة بيانات أكبر بكثير من RNNs.

الاستخدام الشائع

استحوذت Transformers على خيال الجمهور في عام 2020 مع إصدار GPT-3 من OpenAI، والذي حقق رقمًا قياسيًا في ذلك الوقت 175 مليار المعلمة. هذا الإنجاز المذهل على ما يبدو طغت عليه مشاريع لاحقة ، مثل 2021 الافراج عن من برنامج Megatron-Turing NLG 530B من Microsoft، والذي (كما يوحي الاسم) يحتوي على أكثر من 530 مليار معلمة.

جدول زمني لمشاريع Transformer NLP الفائقة. المصدر مایکروسوفت

لقد عبرت بنية المحولات أيضًا من البرمجة اللغوية العصبية (NLP) إلى رؤية الكمبيوتر، مما أدى إلى تشغيل الجيل الجديد من أطر تركيب الصور مثل OpenAI CLIP و لوح، التي تستخدم النص> تعيين مجال الصورة لإنهاء الصور غير المكتملة وتوليف الصور الجديدة من المجالات المدربة ، من بين عدد متزايد من التطبيقات ذات الصلة.

يحاول DALL-E إكمال صورة جزئية لتمثال نصفي لأفلاطون. المصدر: https://openai.com/blog/dall-e/

2: شبكات الخصومة التوليدية (GANs)

على الرغم من أن المحولات قد حظيت بتغطية إعلامية غير عادية من خلال إصدار واعتماد GPT-3 ، إلا أن شبكة الخصومة التوليدية (GAN) علامة تجارية معروفة في حد ذاتها ، وقد تنضم في النهاية deepfake كفعل.

اقترح أولا في 2014 وتستخدم بشكل أساسي لتركيب الصور ، وهي شبكة خصومة توليدية هندسة معمارية يتكون من مولد كهرباء و مميزيتنقل المُولِّد بين آلاف الصور في مجموعة بيانات، محاولًا إعادة بنائها بشكل متكرر. في كل محاولة، يُقيِّم المُميِّز عمل المُولِّد، ويُعيده لتحسين أدائه، ولكن دون أي فهم لكيفية حدوث خطأ في إعادة البناء السابقة.

المصدر: https://developers.google.com/machine-learning/gan/gan_structure

هذا يجبر المولد على استكشاف العديد من السبل ، بدلاً من اتباع الأزقة العمياء المحتملة التي كان من الممكن أن تنتج إذا أخبرها المُميّز بمكان حدوث الخطأ (انظر رقم 8 أدناه). بحلول الوقت الذي ينتهي فيه التدريب ، يكون لدى المُنشئ خريطة مفصلة وشاملة للعلاقات بين النقاط في مجموعة البيانات.

من الورق تحسين توازن GAN عن طريق رفع الوعي المكاني: يتنقل إطار عمل جديد عبر الفضاء الكامن الغامض أحيانًا لشبكة GAN ، مما يوفر وسيلة استجابة لبنية تركيب الصورة. المصدر: https://genforce.github.io/eqgan/

على سبيل القياس ، هذا هو الفرق بين تعلم رحلة رتابة واحدة إلى وسط لندن ، أو الحصول بشق الأنفس على المعرفة.

النتيجة هي مجموعة عالية المستوى من السمات في الفضاء الكامن للنموذج المُدرَّب. قد يكون المؤشر الدلالي للسمات عالية المستوى هو "شخص"، بينما قد يكشف الانحدار من خلال الخصوصية المتعلقة بالسمات عن سمات مُكتسبة أخرى، مثل "ذكر" و"أنثى". في المستويات الأدنى، يمكن تقسيم السمات الفرعية إلى "أشقر" و"قوقازي"، وما إلى ذلك.

التشابك هو قضية بارزة في الفضاء الكامن لشبكات GAN وأطر التشفير/فك التشفير: هل الابتسامة على وجه الأنثى الناتج عن شبكات GAN هي سمة متشابكة من "هويتها" في الفضاء الكامن، أم أنها فرع موازٍ؟

الوجوه التي تم إنشاؤها بواسطة GAN من هذه الصفات غير موجودة. المصدر: https://this-person-does-not-exist.com/en

شهدت السنوات القليلة الماضية عددًا متزايدًا من مبادرات البحث الجديدة في هذا الصدد، مما قد يُمهّد الطريق لتحرير على مستوى الميزات، بأسلوب فوتوشوب، في المساحة الكامنة لشبكات GAN. ولكن في الوقت الحالي، تُعدّ العديد من التحويلات حزمًا "الكل أو لا شيء". والجدير بالذكر أن إصدار EditGAN من NVIDIA في أواخر عام 2021 يحقق... مستوى عالي من التفسير في الفضاء الكامن باستخدام أقنعة التجزئة الدلالية.

الاستخدام الشائع

إلى جانب مشاركتهم (المحدودة في الواقع) في مقاطع الفيديو المزيفة الشائعة ، انتشرت شبكات GAN المرتكزة على الصور / الفيديو على مدار السنوات الأربع الماضية ، مما أثار إعجاب الباحثين والجمهور على حدٍ سواء. تمثل مواكبة المعدل المذهل وتواتر الإصدارات الجديدة تحديًا ، على الرغم من مستودع GitHub تطبيقات GAN الرائعة يهدف إلى تقديم قائمة شاملة.

يمكن لشبكات الخصومة التوليدية نظريًا اشتقاق ميزات من أي مجال مؤطر جيدًا ، بما في ذلك النص.

3: سفم

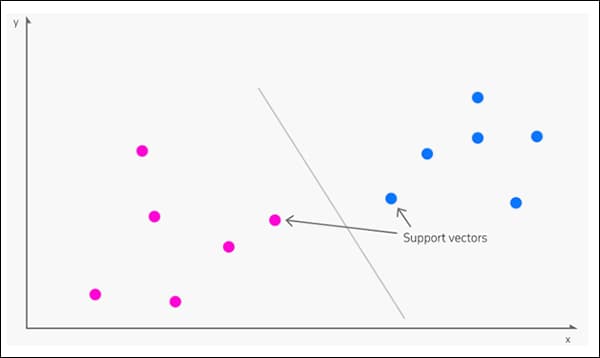

نشأت في 1963, دعم شاحنات النقل (SVM) هي خوارزمية أساسية تظهر بشكل متكرر في الأبحاث الجديدة. ضمن SVM ، تعين المتجهات الترتيب النسبي لنقاط البيانات في مجموعة البيانات ، بينما تقنية المتجهات ترسم الحدود بين المجموعات أو السمات أو السمات المختلفة.

نواقل الدعم تحدد الحدود بين المجموعات. المصدر: https://www.kdnuggets.com/2016/07/support-vector-machines-simple-explanation.html

تسمى الحدود المشتقة أ مستوي مفرط.

في مستويات الميزات المنخفضة ، يكون SVM هو ثنائي الأبعاد (الصورة أعلاه)، ولكن عندما يكون هناك عدد أكبر من المجموعات أو الأنواع المعترف بها، يصبح الأمر ثلاثي الأبعاد.

تتطلب مجموعة أعمق من النقاط والمجموعات استخدام SVM ثلاثي الأبعاد. المصدر: https://cml.rhul.ac.uk/svm.html

الاستخدام الشائع

نظرًا لأن أجهزة المتجهات الداعمة يمكنها معالجة البيانات عالية الأبعاد للعديد من الأنواع بفعالية وبشكل حيادي، فإنها تظهر على نطاق واسع عبر مجموعة متنوعة من قطاعات التعلم الآلي، بما في ذلك كشف التزييف العميق, تصنيف الصورة, تصنيف الكلام الذي يحض على الكراهية, تحليل الحمض النووي و توقع التركيبة السكانية، من بين عدة آخرين.

4: K-يعني التجميع

التجميع بشكل عام هو ملف تعليم غير مشرف عليه النهج الذي يسعى إلى تصنيف نقاط البيانات من خلال تقدير الكثافة، وإنشاء خريطة لتوزيع البيانات قيد الدراسة.

K-Means clustering يقسم الشرائح والمجموعات والمجتمعات في البيانات. المصدر: https://aws.amazon.com/blogs/machine-learning/k-means-clustering-with-amazon-sagemaker/

K- يعني التكتل لقد أصبح هذا النهج هو التنفيذ الأكثر شيوعًا، حيث يقوم بتجميع نقاط البيانات في "مجموعات K" المميزة، والتي قد تشير إلى القطاعات الديموغرافية، أو المجتمعات عبر الإنترنت، أو أي تجمع سري آخر محتمل ينتظر اكتشافه في البيانات الإحصائية الخام.

تتشكل المجموعات في تحليل K-Means. المصدر: https://www.geeksforgeeks.org/ml-determine-the-optimal-value-of-k-in-k-means-clustering/

قيمة K نفسها هي العامل المحدد في فائدة العملية ، وفي تحديد القيمة المثلى للكتلة. في البداية ، يتم تعيين قيمة K بشكل عشوائي ، وميزاتها وخصائصها المتجهية مقارنة بجيرانها. يتم تعيين تلك الأجهزة المجاورة التي تشبه إلى حد بعيد نقطة البيانات مع القيمة المعينة عشوائيًا إلى مجموعتها بشكل تكراري حتى تنتج البيانات جميع التجمعات التي تسمح بها العملية.

سيكشف الرسم البياني للخطأ التربيعي، أو "تكلفة" القيم المختلفة بين المجموعات عن نقطة الكوع للبيانات:

نقطة الكوع في الرسم البياني العنقودي. المصدر: https://www.scikit-yb.org/en/latest/api/cluster/elbow.html

تشبه نقطة الكوع من حيث المفهوم الطريقة التي تتسطح بها الخسارة إلى تناقص الغلة في نهاية جلسة التدريب لمجموعة البيانات. إنه يمثل النقطة التي لن يتضح عندها أي تمييز إضافي بين المجموعات ، مما يشير إلى لحظة الانتقال إلى المراحل اللاحقة في خط أنابيب البيانات ، أو الإبلاغ عن النتائج.

الاستخدام الشائع

ولأسباب واضحة، تعد تقنية K-Means Clustering تقنية أساسية في تحليل العملاء، لأنها تقدم منهجية واضحة وقابلة للتفسير لترجمة كميات كبيرة من السجلات التجارية إلى رؤى ديموغرافية و"عملاء محتملين".

خارج هذا التطبيق ، يتم استخدام K-Means Clustering أيضًا لـ توقع الانهيارات الأرضية, تجزئة الصورة الطبية, توليف الصور مع شبكات GAN, تصنيف الوثيقةو تخطيط المدينة، من بين العديد من الاستخدامات المحتملة والفعلية الأخرى.

5: غابة عشوائية

الغابة العشوائية هي تعلم المجموعة الأسلوب الذي يحسب متوسط النتيجة من مصفوفة من أشجار القرار لإنشاء توقع شامل للنتيجة.

المصدر: https://www.tutorialandexample.com/wp-content/uploads/2019/10/Decision-Trees-Root-Node.png

إذا قمت بالبحث عنه حتى ولو قليلاً مثل مشاهدة العودة إلى المستقبل ثلاثية، من السهل إلى حد ما تصور شجرة القرار في حد ذاتها: يوجد عدد من المسارات أمامك، وكل مسار يتفرع إلى نتيجة جديدة والتي بدورها تحتوي على المزيد من المسارات المحتملة.

In تعزيز التعلم، قد تتراجع عن مسار وتبدأ مرة أخرى من موقف سابق ، بينما تلتزم أشجار القرار برحلاتها.

وبالتالي، فإن خوارزمية الغابة العشوائية هي في الأساس مراهنة على الفروقات في القرارات. وتُسمى هذه الخوارزمية "عشوائية" لأنها تجعل مخصص التحديدات والملاحظات من أجل فهم متوسط مجموع النتائج من مصفوفة شجرة القرار.

نظرًا لأنه يأخذ في الاعتبار تعدد العوامل ، يمكن أن يكون تحويل نهج الغابة العشوائية إلى رسوم بيانية ذات مغزى أكثر صعوبة من تحويل شجرة القرار ، ولكن من المحتمل أن يكون أكثر إنتاجية بشكل ملحوظ.

أشجار القرار عرضة للمبالغة في التجهيز، حيث تكون النتائج المُحصّلة خاصة بالبيانات، ومن غير المُرجّح تعميمها. يُكافح اختيار راندوم فورست العشوائي لنقاط البيانات هذا الميل، مُستكشفًا اتجاهات تمثيلية ذات معنى ومفيدة في البيانات.

انحدار شجرة القرار. المصدر: https://scikit-learn.org/stable/auto_examples/tree/plot_tree_regression.html

الاستخدام الشائع

كما هو الحال مع العديد من الخوارزميات في هذه القائمة، تعمل الغابة العشوائية عادةً كمُصنِّف ومُرشِّح "مُبكر" للبيانات، ولذلك تظهر باستمرار في الأبحاث الجديدة. من أمثلة استخدام الغابة العشوائية: توليف صورة الرنين المغناطيسي, التنبؤ سعر بيتكوين, تجزئة التعداد, تصنيف النص و كشف الاحتيال في بطاقة الائتمان.

نظرًا لأن Random Forest هي خوارزمية منخفضة المستوى في بنيات التعلم الآلي ، فيمكنها أيضًا المساهمة في أداء طرق أخرى منخفضة المستوى ، بالإضافة إلى خوارزميات التصور ، بما في ذلك التجميع الاستقرائي, تحولات الميزات، تصنيف الوثائق النصية باستخدام ميزات متفرقةو عرض خطوط الأنابيب.

6: ساذج بايز

مقرونة بتقدير الكثافة (انظر 4، فوق بايز ساذجة المصنف هو خوارزمية قوية ولكنها خفيفة الوزن نسبيًا قادرة على تقدير الاحتمالات بناءً على الميزات المحسوبة للبيانات.

العلاقات المميزة في مصنف Bayes الساذج. المصدر: https://www.sciencedirect.com/topics/computer-science/naive-bayes-model

يشير مصطلح "ساذج" إلى الافتراض في مبرهنة بايز هذه الميزات غير مرتبطة ، والمعروفة باسم الاستقلال المشروطإذا تبنيت هذا الموقف، فإن المشي والتحدث مثل البطة ليس كافياً لإثبات أننا نتعامل مع بطة، ولا يتم تبني أي افتراضات "واضحة" قبل أوانها.

قد يكون هذا المستوى من الدقة الأكاديمية والتحقيقية مبالغًا فيه حيث يتوافر "الفطرة السليمة"، ولكنه معيار قيم عند عبور العديد من الغموضات والارتباطات غير ذات الصلة التي قد توجد في مجموعة بيانات التعلم الآلي.

في شبكة Bayesian الأصلية ، تخضع الميزات وظائف التهديف، بما في ذلك الحد الأدنى لطول الوصف و التهديف بايزي، والتي يمكن أن تفرض قيودًا على البيانات من حيث الاتصالات المقدرة الموجودة بين نقاط البيانات ، والاتجاه الذي تتدفق فيه هذه الاتصالات.

على العكس من ذلك، يعمل مصنف بايز الساذج على افتراض أن ميزات كائن معين مستقلة، ثم يستخدم بعد ذلك نظرية بايز لحساب احتمال وجود كائن معين، بناءً على ميزاته.

الاستخدام الشائع

يتم تمثيل مرشحات Naive Bayes بشكل جيد في التنبؤ بالمرض وتصنيف الوثائق, تصفية البريد المزعج, تصنيف المشاعر, أنظمة التوصيةو الكشف عن الغش، من بين تطبيقات أخرى.

7: K- أقرب الجيران (KNN)

تم اقتراحه لأول مرة من قبل كلية طب الطيران التابعة للقوات الجوية الأمريكية في 1951، والاضطرار إلى التكيف مع أحدث أجهزة الحوسبة في منتصف القرن العشرين ، K- أقرب الجيران (KNN) هي خوارزمية بسيطة لا تزال تبرز بشكل بارز عبر الأوراق الأكاديمية ومبادرات أبحاث التعلم الآلي في القطاع الخاص.

تمت تسمية KNN بـ "المتعلم الكسول"، لأنه يقوم بمسح مجموعة البيانات بشكل شامل من أجل تقييم العلاقات بين نقاط البيانات، بدلاً من طلب تدريب نموذج التعلم الآلي الكامل.

مجموعة KNN. مصدر: https://scikit-learn.org/stable/modules/neighbors.html

على الرغم من أن KNN نحيلة من الناحية المعمارية ، إلا أن نهجه النظامي يفرض طلبًا ملحوظًا على عمليات القراءة / الكتابة ، ويمكن أن يكون استخدامه في مجموعات البيانات الكبيرة جدًا مشكلة بدون تقنيات مساعدة مثل تحليل المكونات الرئيسية (PCA) ، والتي يمكن أن تحول مجموعات البيانات المعقدة وذات الحجم الكبير داخل التجمعات التمثيلية يمكن لـ KNN اجتيازها بجهد أقل.

A دراسة حديثة قام بتقييم فعالية واقتصاد عدد من الخوارزميات المكلفة بالتنبؤ بما إذا كان الموظف سيغادر الشركة ، ووجد أن KNN السبعيني ظل متفوقًا على المنافسين الأكثر حداثة من حيث الدقة والفعالية التنبؤية.

الاستخدام الشائع

على الرغم من بساطة مفهومها وتنفيذها الشائع، فإن KNN لم يبق عالقًا في الخمسينيات من القرن العشرين - بل تم تكييفه نهج أكثر تركيزًا على DNN في مقترح 2018 من جامعة ولاية بنسلفانيا ، ولا تزال عملية مركزية في مرحلة مبكرة (أو أداة تحليلية بعد المعالجة) في العديد من أطر التعلم الآلي الأكثر تعقيدًا.

في تكوينات مختلفة ، تم استخدام KNN أو من أجله التحقق من التوقيع عبر الإنترنت, تصنيف الصورة, تحليل النصوص, توقع المحاصيلو التعرف على الوجه، إلى جانب التطبيقات والتطبيقات الأخرى.

نظام التعرف على الوجه القائم على KNN في التدريب. Source: https://pdfs.semanticscholar.org/6f3d/d4c5ffeb3ce74bf57342861686944490f513.pdf

8: عملية اتخاذ القرار ماركوف (MDP)

إطار رياضي قدمه عالم الرياضيات الأمريكي ريتشارد بيلمان في 1957، تعد عملية قرار ماركوف (MDP) واحدة من أكثر الكتل الأساسية لـ تعزيز التعلم معماريات. خوارزمية مفاهيمية في حد ذاتها ، تم تكييفها في عدد كبير من الخوارزميات الأخرى ، وتتكرر بشكل متكرر في المحصول الحالي لأبحاث الذكاء الاصطناعي / تعلم الآلة.

يستكشف MDP بيئة البيانات باستخدام تقييمه لحالتها الحالية (أي "أين" توجد في البيانات) لتحديد عقدة البيانات التي سيتم استكشافها بعد ذلك.

المصدر: https://www.sciencedirect.com/science/article/abs/pii/S0888613X18304420

ستعطي عملية اتخاذ القرار الأساسية لماركوف الأولوية للميزة على المدى القريب على الأهداف المرغوبة على المدى الطويل. لهذا السبب، عادة ما يتم تضمينه في سياق بنية سياسة أكثر شمولاً في التعلم المعزز، وغالبًا ما يخضع لعوامل مقيدة مثل المكافأة المخفضة، وغيرها من المتغيرات البيئية المعدلة التي ستمنعه من الاندفاع نحو هدف فوري دون اعتبار. من النتيجة المرجوة على نطاق أوسع.

الاستخدام الشائع

مفهوم MDP منخفض المستوى منتشر على نطاق واسع في كل من الأبحاث والنشر النشط للتعلم الآلي. وقد تم اقتراحه لـ أنظمة الدفاع الأمني لإنترنت الأشياء, حصاد الأسماكو توقعات السوق.

إلى جانب ذلك قابلية التطبيق الواضحة في لعبة الشطرنج وغيرها من الألعاب المتسلسلة بدقة ، يعد MDP أيضًا منافسًا طبيعيًا لـ التدريب الإجرائي لأنظمة الروبوتاتكما نرى في الفيديو أدناه.

9: مصطلح وثيقة معكوس التردد

تردد المصطلح (TF) يقسم عدد مرات ظهور الكلمة في مستند على العدد الإجمالي للكلمات في ذلك المستند. هكذا كانت الكلمة ختم ظهور مقال مرة واحدة في كل ألف كلمة له تكرار المصطلح 0.001. في حد ذاته ، فإن TF غير مجدية إلى حد كبير كمؤشر على أهمية المصطلح ، بسبب حقيقة أن المقالات التي لا معنى لها (مثل a, و, القادمو it) تسود.

للحصول على قيمة ذات معنى لمصطلح ما ، يحسب تردد المستند العكسي (IDF) قيمة TF لكلمة عبر مستندات متعددة في مجموعة بيانات ، مع تخصيص تصنيف منخفض للتردد العالي جدًا كلمات التوقف، مثل المقالات. يتم تطبيع متجهات السمات الناتجة على القيم الكاملة ، مع تعيين وزن مناسب لكل كلمة.

يرجح TF-IDF أهمية المصطلحات بناءً على التكرار عبر عدد من المستندات ، مع ندرة حدوثها كمؤشر على البروز. المصدر: https://moz.com/blog/inverse-document-frequency-and-the-importance-of-uniqueness

على الرغم من أن هذا النهج يمنع فقدان الكلمات المهمة لغويًا مثل القيم المتطرفة، فإن عكس وزن التردد لا يعني تلقائيًا أن مصطلح التردد المنخفض هو لست الخارجة ، لأن بعض الأشياء نادرة و عديم القيمة. لذلك ، سيحتاج مصطلح التردد المنخفض إلى إثبات قيمته في السياق المعماري الأوسع من خلال عرضه (حتى عند التردد المنخفض لكل مستند) في عدد من المستندات في مجموعة البيانات.

على الرغم من موقعها السن، TF-IDF هي طريقة فعالة وشائعة لممرات التصفية الأولية في أطر معالجة اللغة الطبيعية.

الاستخدام الشائع

نظرًا لأن TF-IDF لعب دورًا على الأقل في تطوير خوارزمية PageRank الخفية إلى حد كبير من Google على مدار العشرين عامًا الماضية، فقد أصبح على نطاق واسع جدا كتكتيك تلاعب في تحسين محركات البحث، على الرغم من تقرير جون مولر لعام 2019 إنكار من أهميتها في نتائج البحث.

بسبب السرية التي تحيط بنظام ترتيب الصفحات ، لا يوجد دليل واضح على أن TF-IDF كذلك لست حاليًا، يُعد هذا تكتيكًا فعالًا للارتقاء في تصنيفات جوجل. مناقشة بين محترفي تكنولوجيا المعلومات مؤخرًا يشير إلى فهم شائع ، سواء كان صحيحًا أم لا ، أن إساءة استخدام المصطلح قد تؤدي إلى تحسين موضع تحسين محركات البحث (على الرغم من أنها إضافية اتهامات بتجاوزات الاحتكار و الإعلان المفرط طمس حدود هذه النظرية).

10: نزول التدرج العشوائي

الانحدار العشوائي (SGD) هي طريقة شائعة بشكل متزايد لتحسين تدريب نماذج التعلم الآلي.

نزول التدرج نفسه هو طريقة لتحسين ومن ثم قياس التحسن الذي يقوم به النموذج أثناء التدريب.

بهذا المعنى، يشير "التدرج" إلى انحدار تنازلي (بدلاً من التدرج اللوني، انظر الصورة أدناه)، حيث تُمثل أعلى نقطة في "التدرج"، على اليسار، بداية عملية التدريب. في هذه المرحلة، لم يرَ النموذج البيانات كاملةً ولو لمرة واحدة، ولم يتعلم ما يكفي عن العلاقات بين البيانات لإنتاج تحويلات فعّالة.

نزول متدرج في جلسة تدريب على تغيير الوجه. يمكننا أن نرى أن التدريب قد استقر لبعض الوقت في الشوط الثاني ، لكنه استعاد طريقه في النهاية إلى أسفل التدرج نحو تقارب مقبول.

تمثل أدنى نقطة ، على اليمين ، التقارب (النقطة التي يكون فيها النموذج فعّالاً بقدر ما سيخضع للقيود والإعدادات المفروضة).

يعمل التدرج كسجل ومتنبئ للتفاوت بين معدل الخطأ (مدى دقة النموذج في تعيين علاقات البيانات حاليًا) والأوزان (الإعدادات التي تؤثر على الطريقة التي سيتعلم بها النموذج).

يمكن استخدام سجل التقدم هذا لإبلاغ أ جدول معدل التعلم، وهي عملية تلقائية تخبر العمارة بأن تصبح أكثر دقة ودقة مع تحول التفاصيل الغامضة المبكرة إلى علاقات وتعيينات واضحة. في الواقع ، يوفر فقدان التدرج خريطة في الوقت المناسب للمكان الذي يجب أن يذهب إليه التدريب بعد ذلك ، وكيف يجب أن يستمر.

يكمن ابتكار الانحدار التدرجي العشوائي في تحديث معلمات النموذج في كل مثال تدريبي لكل تكرار، مما يُسرّع عادةً عملية التقارب. وبفضل ظهور مجموعات البيانات فائقة السعة في السنوات الأخيرة، ازدادت شعبية الانحدار التدرجي العشوائي مؤخرًا كإحدى الطرق الممكنة لمعالجة المشكلات اللوجستية الناتجة.

من ناحية أخرى ، فإن SGD الآثار السلبية لمقياس الميزة ، وقد يتطلب المزيد من التكرارات لتحقيق نفس النتيجة ، مما يتطلب تخطيطًا إضافيًا ومعلمات إضافية ، مقارنةً بالنزول المتدرج العادي.

الاستخدام الشائع

نظرًا لقابليته للتكوين ، وعلى الرغم من أوجه القصور فيه ، فقد أصبح SGD أكثر خوارزمية التحسين شيوعًا لتناسب الشبكات العصبية. أحد إعدادات SGD التي أصبحت مهيمنة في أوراق بحث AI / ML الجديدة هو اختيار تقدير اللحظة التكيفية (ADAM ، المقدمة في 2015) محسن.

يُكيّف ADAM معدل التعلم لكل معلمة ديناميكيًا ("معدل التعلم التكيفي")، بالإضافة إلى دمج نتائج التحديثات السابقة في التكوين اللاحق ("الزخم"). بالإضافة إلى ذلك، يمكن تهيئته لاستخدام ابتكارات لاحقة، مثل نيستيروف الزخم.

ومع ذلك ، يرى البعض أن استخدام الزخم يمكن أن يؤدي أيضًا إلى تسريع ADAM (وخوارزميات مماثلة) إلى a الاستنتاج دون الأمثل. كما هو الحال مع معظم حافة النزف في قطاع أبحاث التعلم الآلي ، فإن SGD هي عمل مستمر.

نُشر لأول مرة في 10 فبراير 2022. تم تعديله في 10 فبراير 20.05 EET - التنسيق.