زاوية Anderson

الصور “المحمية” أسهل، وليس أكثر صعوبة، للسرقة باستخدام الذكاء الاصطناعي

تشير الأبحاث الجديدة إلى أن أدوات العلامة المائية التي تهدف إلى حظر تحرير الصور بواسطة الذكاء الاصطناعي قد تؤدي إلى نتائج عكسية. بدلاً من منع نماذج مثل Stable Diffusion من إجراء التغييرات، قد تسهل بعض الحمايات في الواقع مساعدة الذكاء الاصطناعي على اتباع توجيهات التحرير بشكل أكثر دقة، مما يجعل التلاعب غير المرغوب فيه أكثر سهولة.

هناك سلاسل ملحوظة وقوية في أدب الرؤية الحاسوبية مخصصة لحماية الصور المحمية بحقوق التأليف والنشر من أن يتم تدريبها في نماذج الذكاء الاصطناعي، أو استخدامها في عمليات الصور إلى الصور المباشرة للذكاء الاصطناعي. تهدف الأنظمة من هذا القبيل بشكل عام إلى نماذج الانتشار الكامن (LDMs) مثل Stable Diffusion و Flux، والتي تستخدم إجراءات قائمة على الضوضاء لترميز وفك ترميز الصور.

من خلال إدخال ضوضاء معادية إلى الصور التي تبدو عادية، يمكن أن يكون من الممكن إحداث ارتباك في كاشفات الصور لتحديد محتوى الصورة بشكل غير صحيح، وعرقلة أنظمة توليد الصور من استغلال البيانات المحمية بحقوق التأليف والنشر:

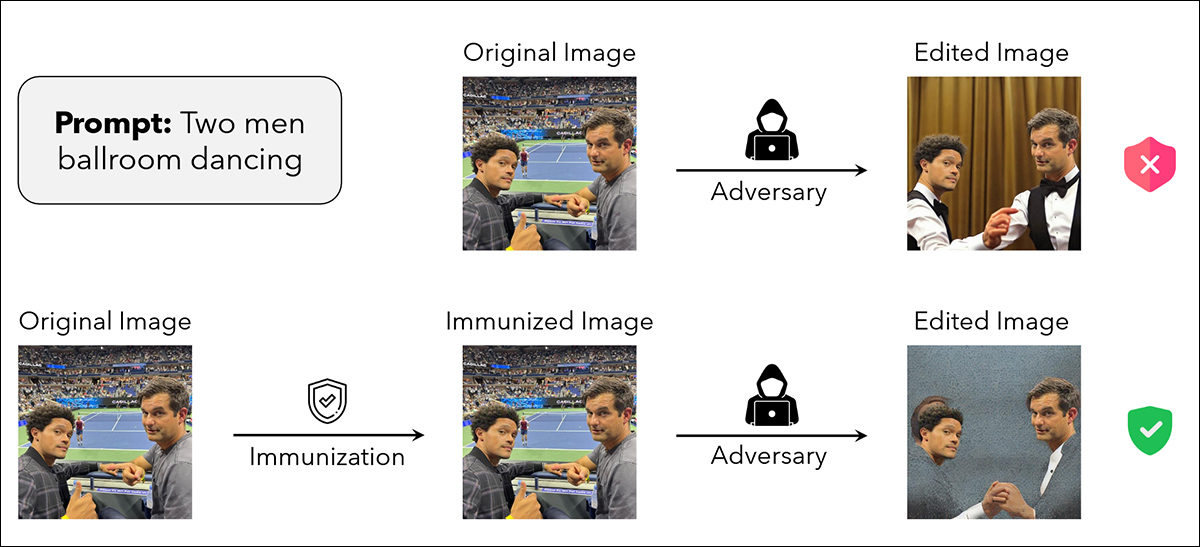

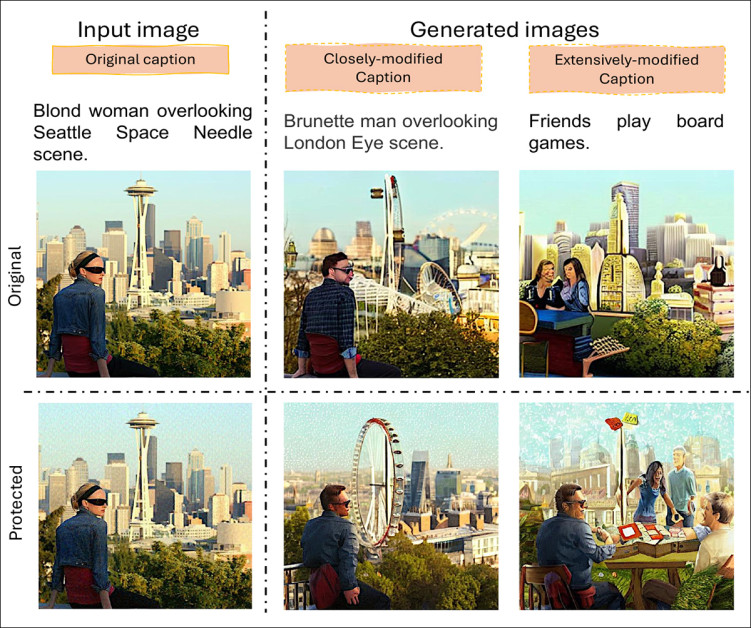

من ورقة MIT ‘رفع تكلفة التحرير القوي بواسطة الذكاء الاصطناعي’، أمثلة على صورة مصدر محمية ضد التلاعب (الصف السفلي). مصدر: https://arxiv.org/pdf/2302.06588

منذ رد فعل الفنانين ضد استخدام Stable Diffusion المتحرر لصور ملسوطة من الويب (بما في ذلك الصور المحمية بحقوق التأليف والنشر) في عام 2023، أنتجت ساحة البحث العديد من المتغيرات على نفس الموضوع – فكرة أن الصور يمكن أن تكون مخدرة بشكل غير مرئي ضد التدريب في أنظمة الذكاء الاصطناعي أو امتصاص أنابيب توليد الذكاء الاصطناعي، دون التأثير السلبي على جودة الصورة، للمشاهد العادي.

في جميع الحالات، هناك علاقة مباشرة بين شدة الاضطراب المفروض، ومدى حماية الصورة، ومدى عدم ظهور الصورة جيدة كما ينبغي:

على الرغم من أن جودة ملف البحث لا توضح تمامًا المشكلة، فإن كميات أكبر من الاضطراب المعادي يضحي بالجودة من أجل الأمان. هنا نرى مجموعة من اضطرابات الجودة في مشروع ‘Fawkes’ عام 2020 بقيادة جامعة شيكاغو. مصدر: https://arxiv.org/pdf/2002.08327

من الجوانب المهمة للفنانين الذين يبحثون عن حماية أسلوبهم ضد الاستخدام غير المصرح به هو القدرة على هذه الأنظمة لتحجية الهوية والمعلومات الأخرى، ولإقناع عملية تدريب الذكاء الاصطناعي بأنها ترى شيئًا مختلفًا عما هي في الواقع، بحيث لا تتشكل روابط بين المجالات الدلالية والبصرية للبيانات المحمية (أي، توجيه مثل ‘بالنمط بول كلي’).

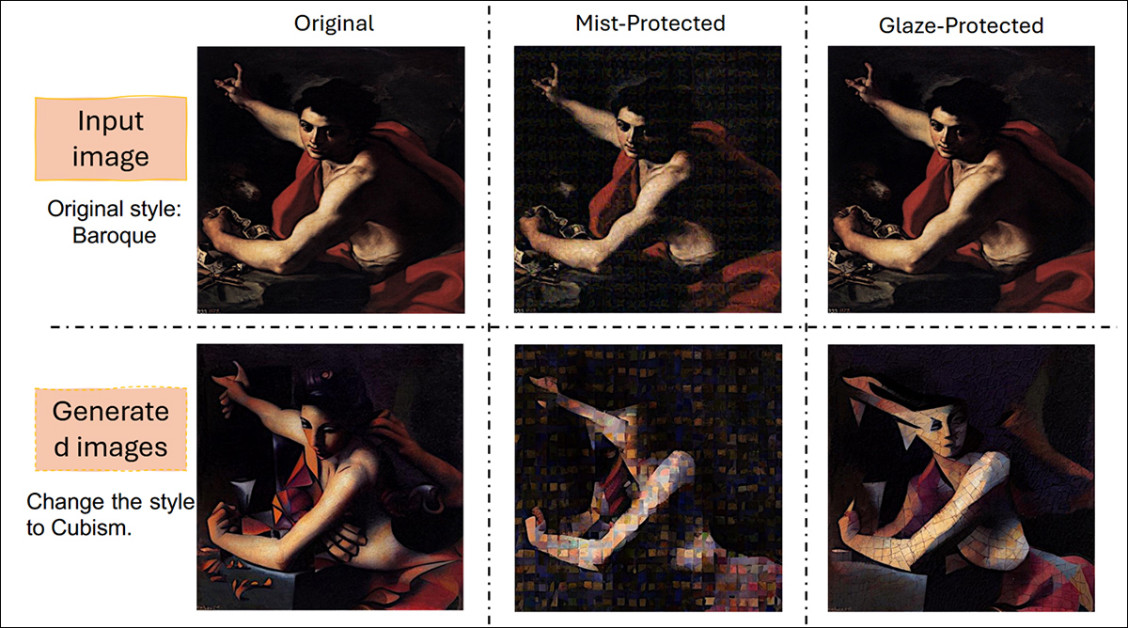

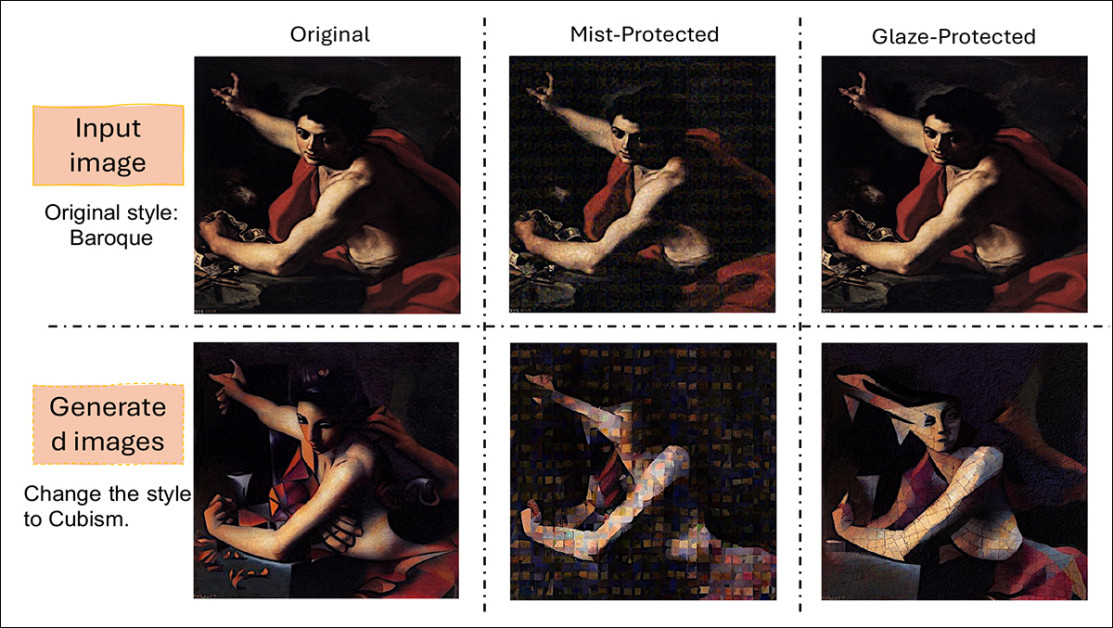

Mist و Glaze هما طريقتان شائعتان للحقن قادرتان على منع، أو على الأقل عرقلة محاولات استخدام أساليب محمية بحقوق التأليف والنشر في تدفقات العمل وتدريبات الذكاء الاصطناعي. مصدر: https://arxiv.org/pdf/2506.04394

هدف خودي

الآن، وجدت أبحاث جديدة من الولايات المتحدة أن الاضطرابات لا فقط تفشل في حماية الصورة، ولكن إضافة الاضطراب يمكن أن تحسن قابلية الصورة للتلاعب في جميع العمليات التي تهدف الاضطراب إلى منعها.

تنص الورقة على:

‘في تجاربنا مع طرق حماية الصور القائمة على الاضطراب عبر مجالات متعددة (صور المشاهد الطبيعية والفنون) ومهام التحرير (توليد الصور من الصور وتحرير الأسلوب)، اكتشفنا أن هذا الحماية لا يتحقق تمامًا.

‘في معظم السيناريوهات، يولد تحرير الصور المحمية بواسطة الانتشار صورة خروجة مرغوبة تتماشى بدقة مع توجيه التحرير.

‘تشير نتائجنا إلى أن إضافة الضوضاء إلى الصور قد تزيد بشكل معاكس من ارتباطها مع توجيهات النص المعطاة خلال عملية التوليد، مما يؤدي إلى عواقب غير مقصودة مثل تحريرات أفضل.

‘لذلك، نargument أن الأساليب القائمة على الاضطراب قد لا توفر حلًا كافيًا لحماية الصور بشكل قوي ضد التحرير القائم على الانتشار.’

في الاختبارات، تم كشف الصور المحمية عن سيناريوهين مألوفين لتحرير الذكاء الاصطناعي: توليد الصور من الصور بشكل مباشر وتحويل الأسلوب.

تمثل هذه العمليات الطرق الشائعة التي قد يستغل بها نماذج الذكاء الاصطناعي المحتوى المحمي، إما عن طريق تعديل الصورة بشكل مباشر، أو عن طريق اقتباس سماتها الأسلوبية لاستخدامها في مكان آخر.

تم تشغيل الصور المحمية، التي تم الحصول عليها من مصادر معيارية للتصوير والفن، من خلال هذه الأنابيب لتحديد ما إذا كانت الاضطرابات المضافة يمكن أن تعطل أو تدهور التحريرات.

بدلاً من ذلك، بدا أن وجود الحماية يُحسن بشكل متكرر تماشى النموذج مع التوجيهات، مما ينتج عنه مخرجات دقيقة وواقعية تطابق الإرشادات الجديدة.

ينصح المؤلفون، في الواقع، بأن هذه الطريقة الشائعة للحماية قد توفر شعورًا زائفًا بالأمان، وأن أي نهج للحماية القائمة على الاضطراب يجب اختباره بدقة ضد أساليب المؤلفين الخاصة.

الطريقة

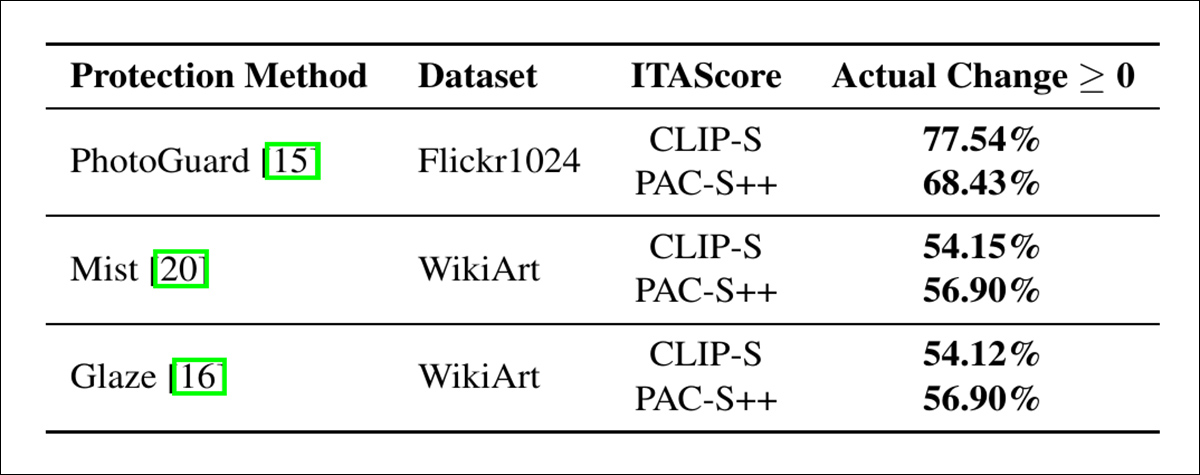

أجرى المؤلفون تجارب باستخدام ثلاثة طرق حماية تطبق اضطرابات معادية متعمدة: PhotoGuard؛ Mist؛ و Glaze.

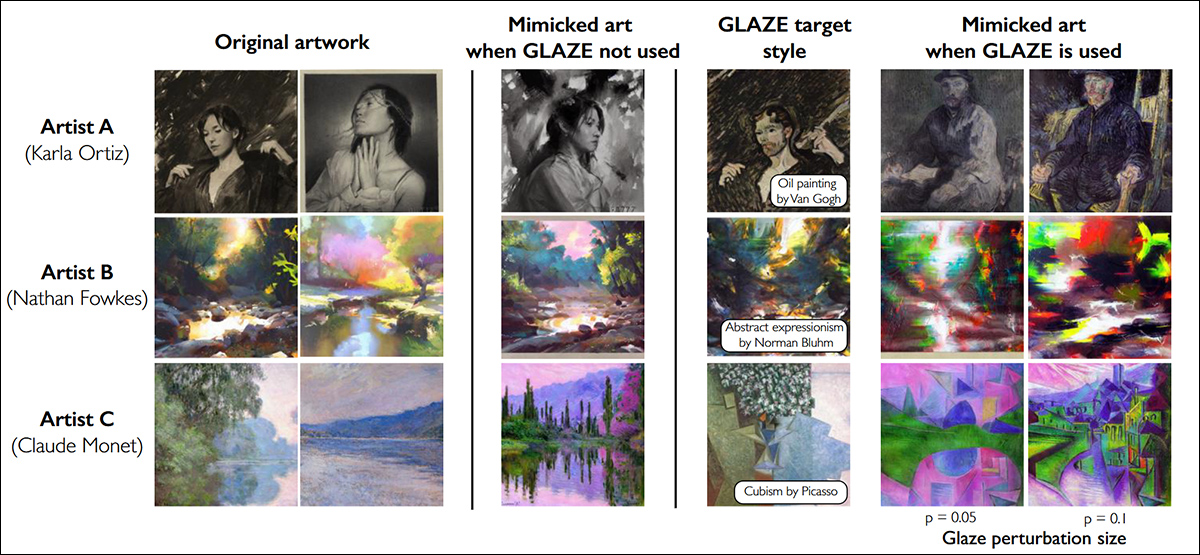

Glaze، إحدى الإطارات التي اختبرها المؤلفون، تظهر أمثلة حماية Glaze لثلاثة فنانين. العمودان الأولان يظهران الأعمال الفنية الأصلية؛ العمود الثالث يظهر نتائج التقليد دون حماية؛ العمود الرابع، نسخًا محولة بالنمط تم استخدامها لتحسين القناع، إلى جانب اسم النمط المستهدف. الأعمدة الخامسة والسادسة تظهر نتائج التقليد مع تطبيق الحماية عند مستويات الاضطراب p = 0.05 و p = 0.1. جميع النتائج تستخدم نماذج Stable Diffusion. https://arxiv.org/pdf/2302.04222

تم تطبيق PhotoGuard على صور المشاهد الطبيعية، في حين تم استخدام Mist و Glaze على الأعمال الفنية (أي، مجالات مصممة بأسلوب فني).

تم اختبار فعالية كل طريقة من خلال التحقق من ما إذا كان نموذج الذكاء الاصطناعي لا يزال بإمكانه إنتاج تحريرات واقعية ومرتبطة بالتوجيهات عند العمل على صور محمية؛ إذا كانت الصور الناتجة تبدو مقنعة ومتوافقة مع التوجيهات، فتم الحكم على أن الحماية قد فشلت.

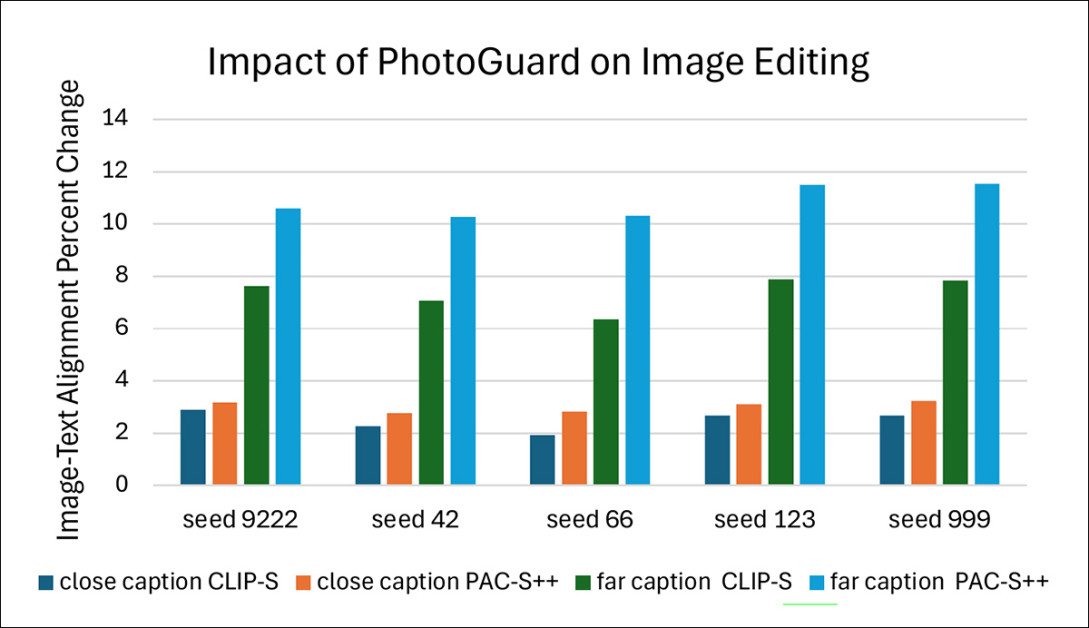

تم استخدام Stable Diffusion v1.5 كنموذج مولد للصور مسبق التدريب لمهام التحرير التي قام بها الباحثون. تم اختيار خمس بذور لضمان إمكانية التكرار: 9222، 999، 123، 66، و 42. اتبعت جميع إعدادات التوليد الأخرى، مثل مقياس التوجيه والقوة والخطوات الإجمالية، القيم الافتراضية المستخدمة في تجارب PhotoGuard.

تم اختبار PhotoGuard على صور المشاهد الطبيعية باستخدام مجموعة بيانات Flickr8k، التي تحتوي على أكثر من 8000 صورة مقترنة مع ما يصل إلى خمس تعليقات لكل صورة.

أفكار معارضة

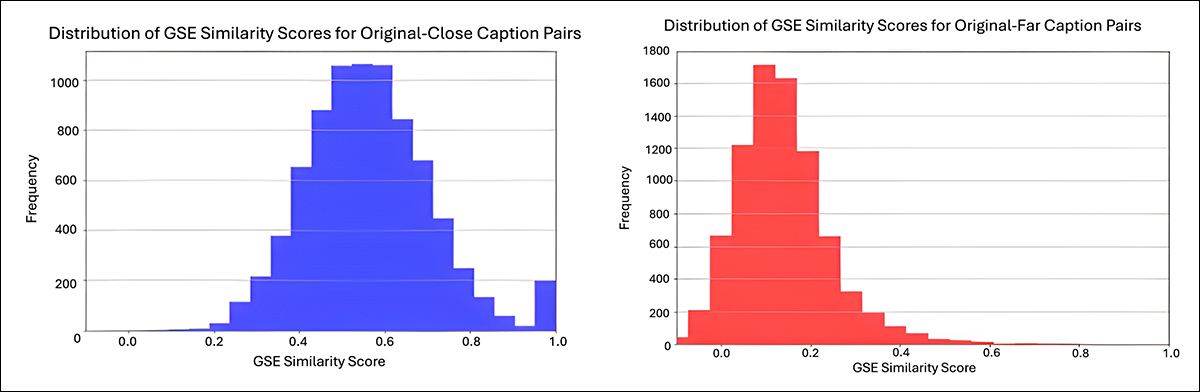

تم إنشاء مجموعتان من التعليقات المعدلة من التعليق الأول لكل صورة بمساعدة Claude Sonnet 3.5. تحتوي مجموعة على توجيهات قريبة سياقيًا من التعليقات الأصلية؛ تحتوي المجموعة الأخرى على توجيهات بعيدة سياقيًا.

على سبيل المثال، من التعليق الأصلي ‘فتاة شابة في فستان وردي تدخل كوخًا خشبيًا’، يكون التوجيه القريب ‘صبي شاب في قميص أزرق يدخل منزل من الطوب’. من ناحية أخرى، يكون التوجيه بعيد ‘قطةتان متكاسلتان على أريكة’.

تم بناء التوجيهات القريبة عن طريق استبدال الأسماء والصفات بمصطلحات شبيهة семantically؛ تم توليد التوجيهات البعيدة عن طريق توجيه النموذج لإنشاء تعليقات سياقية مختلفة جدًا.

تم فحص جميع التعليقات المولدة يدويًا لضمان الجودة والصلة الدلالية:

من المادة التكميلية، توزيعات التشابه الدلالي للتعليقات المعدلة المستخدمة في اختبارات Flickr8k. يظهر الرسم البياني على اليسار درجات التشابه للتعليقات المعدلة قريبًا، بمتوسط حوالي 0.6. يظهر الرسم البياني على اليمين التعليقات المعدلة بشكل مكثف، بمتوسط حوالي 0.1، مما يعكس مسافة دلالية أكبر من التعليقات الأصلية. تم حساب القيم باستخدام محدد الجملة العالمي من Google. مصدر: https://sigport.org/sites/default/files/docs/IncompleteProtection_SM_0.pdf

تم比较 كيفية اتباع الذكاء الاصطناعي للتوجيهات عند تحرير الصور المحمية مقابل غير المحمية. لقد بحثوا أولاً عن الفرق بينهما، الذي يسمى التغيير الفعلي. ثم تم تحويل الفرق إلى إنشاء نسبة التغيير، مما يجعل من السهل比较 النتائج عبر العديد من الاختبارات.

كشفت هذه العملية عن ما إذا كانت الحمايات تجعل من الصعب أو سهلًا على الذكاء الاصطناعي مطابقة التوجيهات. تم تكرار الاختبارات خمس مرات باستخدام بذور عشوائية مختلفة، تغطي التغييرات الصغيرة والكبيرة للأعترافات الأصلية.

هجوم فني

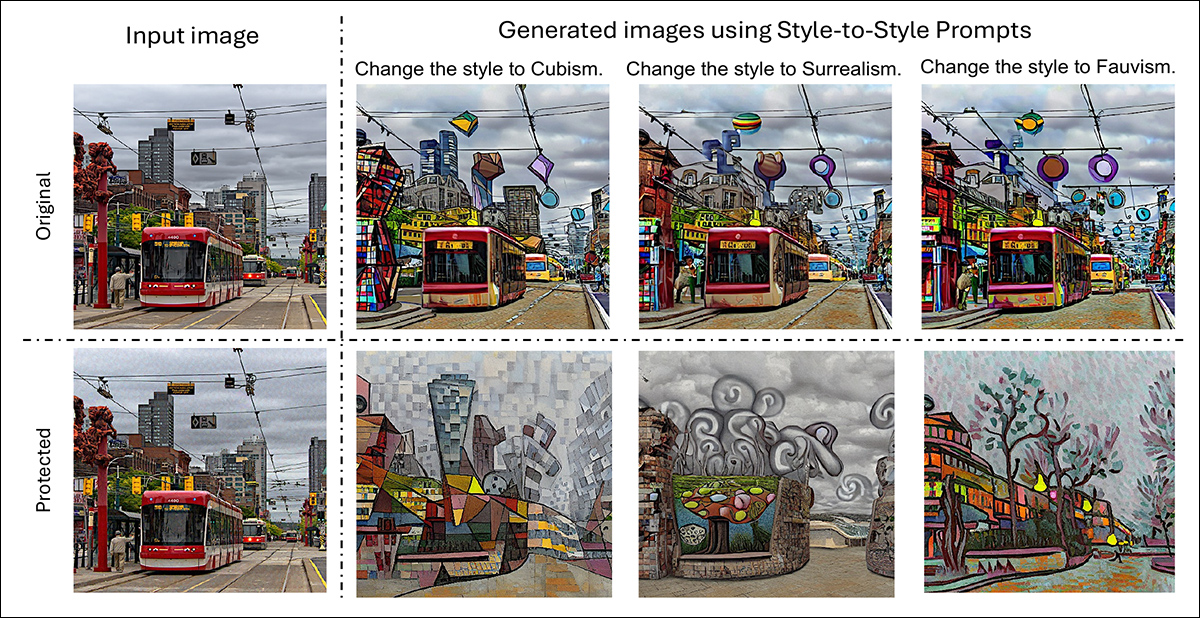

للاختبارات على الصور الطبيعية، تم استخدام مجموعة بيانات Flickr1024، التي تحتوي على أكثر من ألف صورة عالية الجودة. تم تحرير كل صورة بتوجيهات تتبع النمط: ‘تغيير الأسلوب إلى [V]’، حيث [V] يمثل واحدًا من سبعة أساليب فنية مشهورة: التكعيبية؛ بعد الانطباعية؛ الانطباعية؛ السريالية؛ الباروكية؛ الفوفية؛ والنهضة.

تم تطبيق PhotoGuard على الصور الأصلية، وتوليد نسخ محمية، ثم تشغيل كلاً من الصور المحمية وغير المحمية من خلال نفس مجموعة من تحويلات الأسلوب:

النسخ الأصلية والمحمية لصورة مشهد طبيعي، كل منها تم تحريره لتطبيق أساليب التكعيبية والسريالية والفوفية.

لاختبار طرق الحماية على الأعمال الفنية، تم إجراء تحويل الأسلوب على صور من مجموعة بيانات WikiArt، التي تجمع مجموعة واسعة من الأساليب الفنية. اتبعت توجيهات التحرير نفس الشكل السابق، حيث تم توجيه الذكاء الاصطناعي لتغيير الأسلوب إلى أسلوب عشوائي غير مرتبط تم سنه من تسميات WikiArt.

تم تطبيق طرق الحماية Glaze و Mist على الصور قبل التحرير، مما سمح للباحثين بمشاهدة كيفية أداء كل دفاع في منع أو تشويه نتائج تحويل الأسلوب:

أمثلة على كيفية تأثير طرق الحماية على تحويل الأسلوب على الأعمال الفنية. يظهر الصورة الأصلية بالباروك إلى جانب النسخ المحمية بواسطة Mist و Glaze. بعد تطبيق تحويل أسلوب التكعيبية، يمكن رؤية الفروق في كيفية تعديل كل حماية للصورة النهائية.

تم اختبار المقارنات كميًا أيضًا:

تغييرات في درجات التوجيه الصورة-النص بعد تحريرات تحويل الأسلوب.

من بين هذه النتائج، يعلق المؤلفون:

‘تظهر النتائج تحديًا كبيرًا للاضطرابات المعادية للحماية. بدلاً من عرقلة التوجيه، غالبًا ما تعزز الاضطرابات المعادية استجابة النموذج التوليدي للتوجيهات، مما يؤدي إلى عواقب غير مقصودة مثل تحريرات أفضل.

‘تظهر العواقب غير المقصودة لاستخدام الاضطرابات المعادية نقاط ضعف في الأساليب الحالية وتؤكد الحاجة الملحة إلى تقنيات حماية أكثر فعالية.’

يشرح المؤلفون أن النتائج غير المتوقعة يمكن أن تعزى إلى كيفية عمل نماذج الانتشار: تعمل نماذج LDM على تحرير الصور عن طريق تحويلها أولاً إلى نسخة مضغوطة تسمى كامنة؛ ثم يتم إضافة الضوضاء إلى هذه الكامنة عبر العديد من الخطوات، حتى يصبح البيانات شبه عشوائي.

يعكس النموذج هذه العملية أثناء التوليد، بإزالة الضوضاء خطوة خطوة. في كل مرحلة من مراحل هذا العكس، يساعد التوجيه النصي في توجيه كيفية تنظيف الضوضاء، مما يؤدي تدريجيًا إلى تشكيل الصورة لتناسب التوجيه:

مقارنة بين التوليد من صورة غير محمية و صورة محمية بواسطة PhotoGuard، مع تحويل الحالات الكامنة المتوسطة إلى صور للتصوير.

تضيف طرق الحماية كميات صغيرة من الضوضاء الإضافية إلى الصورة الأصلية قبل دخولها هذا العملية. بينما تكون هذه الاضطرابات صغيرة في البداية، تتراكم عندما يطبق النموذج طبقاته الخاصة من الضوضاء.

تترك هذه التراكمات المزيد من أجزاء الصورة “غير محددة” عندما يبدأ النموذج في إزالة الضوضاء. مع عدم اليقين الأكبر، يعتمد النموذج بشكل أكبر على التوجيه النصي لملء التفاصيل الناقصة، مما يمنح التوجيه نفوذًا أكبر مما كان سيحدث عادة.

في الواقع، تجعل الحمايات من السهل على الذكاء الاصطناعي إعادة تشكيل الصورة لتناسب التوجيه، بدلاً من جعله أكثر صعوبة.

أخيرًا، أجرى المؤلفون اختبارًا استبدل الاضطرابات المُصنعة من ورقة رفع تكلفة التحرير القوي بواسطة الذكاء الاصطناعي الورقة بالضوضاء الغاوسية النقية.

اتبعت النتائج نفس النمط الملاحظ سابقًا: عبر جميع الاختبارات، بقيت قيم نسبة التغيير إيجابية. حتى هذا الضوضاء العشوائية غير الهيكلية أدت إلى تعزيز أكبر في التوجيه بين الصور المولدة والتوجيهات.

تأثير الحماية المحاكاة باستخدام الضوضاء الغاوسية على مجموعة بيانات Flickr8k.

دعم هذا التفسير الكامن بأن أي ضوضاء مضافة، بغض النظر عن تصميمها، تزيد من عدم اليقين بالنسبة للنموذج أثناء التوليد، مما يسمح للتوجيه النصي بالسيطرة بشكل أكبر على الصورة النهائية.

الاستنتاج

لقد دفع مجال البحث الاضطراب المعادي إلى قضية حقوق التأليف والنشر في نماذج LDM منذ فترة طويلة؛ لكن لا حلول قوية ظهرت من العدد الكبير من الأوراق المنشورة حول هذا الموضوع.

إما أن الاضطرابات المفروضة تقلل بشكل مفرط من جودة الصورة، أو أن الأنماط لا تثبت أنها قوية ضد التلاعب والعمليات التحويلية.

ومع ذلك، يبدو أن البحث عن حماية حقوق التأليف والنشر من خلال هذه الوسائل قد يندرج تحت “الكيمياء”.