زاوية Anderson

AI الفيديو يُحسّن صورة القطة الذاتية

مُحسّنات الفيديو بالذكاء الاصطناعي غالبًا ما تُنتج نتائج قريبة، لكنها لا تُحقق تمامًا ما يُريد نص الإشارة. لكنّ إصلاحًا جديدًا على مستوى عالٍ يُحدث الفرق.

نظم الفيديو التوليدي غالبًا ما تواجه صعوبة في إنتاج فيديوهات حقًا إبداعية أو غير عادية، وأحيانًا تفشل في تلبية توقعات نص الإشارة للمستخدم.

جزء من سبب ذلك هو التشابك – حقيقة أن نماذج الرؤية واللغة يجب أن ت reached تعويضات حول مدة تدريبها على بياناتها المصدر. تدريب قليل جدًا، والConcepts مرنة، لكنها غير مكتملة الشكل – تدريب كثير جدًا، والConcepts دقيقة، لكنها لم تعد مرنة بدرجة كافية لدمجها في مجموعات جديدة.

يمكنك الحصول على الفكرة من الفيديو المضمن أدناه. على اليسار هو نوع من الحلول الوسط التي تُنتجها العديد من أنظمة الذكاء الاصطناعي استجابةً لإشارة مطالبية (الإشارة في الجزء العلوي من الفيديو في جميع الأمثلة الأربعة) التي تطلب بعض التضاد بين العناصر التي هي слишком خيالية لتكون مثالًا حقيقيًا للتدريب. على اليمين، هو مخرج الذكاء الاصطناعي الذي يلتزم بالإشارة بشكل أفضل:

انقر للعب (لا يوجد صوت). على اليمين، نرى ‘مُحسّن WAN 2.2’ يُحقق تمامًا ما تُريده الإشارات، بالمقارنة مع التأويلات الغامضة لـ ‘Wan 2.2 العادي’ على اليسار. يُرجى الرجوع إلى ملفات الفيديو المصدر للحصول على دقة أفضل وامثلة أكثر، على الرغم من أن الإصدارات المُختارة هنا لا توجد في موقع المشروع، وتم تجميعها لهذا المقال. المصدر

حسناً، على الرغم من أننا يجب أن نغفر لطائر البط الذي يصفق بيد إنسان (!)، من الواضح أن الأمثلة على اليمين تُحقق الإشارة الأصلية بشكل أفضل بكثير من تلك على اليسار.

من المثير للاهتمام أن كلا الهيكلين المُقدمين هو في الأساس نفس الهيكل – الهيكل الشائع والمُقتدر Wan 2.2، وهو إصدار صيني حصل على أرضية كبيرة في المجتمعات المفتوحة والمهتمة هذا العام.

الفرق هو أن خط أنابيب التوليد الثاني مُحسّن، مما يعني في هذه الحالة أن نموذج لغة كبير (LLM) تم استخدامه لإعادة تفسير الإطار الأول (البذرة) للفيديو، بحيث يُصبح من الأسهل على النظام أن يُحقق ما يُريده المستخدم.

تتضمن هذه “التأطير البصري” حقن صورة مصنوعة من هذا النموذج المُحسّن LLM إلى خط أنابيب التوليد كـ “إطار بدء”, و sử dụng نموذج LoRA لتفسير لمساعدة دمج “إطار الغريب” في عملية إنشاء الفيديو.

النتائج، من حيث إخلاص الإشارة، هي حقًا مُدهشة، خاصةً لحل يبدو متألقًا:

انقر للعب (لا يوجد صوت). المزيد من الأمثلة على توليدات الفيديو ‘المُحسّنة’ التي تُحقق تمامًا السيناريو. يُرجى الرجوع إلى ملفات الفيديو المصدر للحصول على دقة أفضل وامثلة أكثر، على الرغم من أن الإصدارات المُختارة هنا لا توجد في موقع المشروع، وتم تجميعها لهذا المقال.

يأتي هذا الحل في شكل ورقة جديدة توليد الفيديو المُحسّن: فك الارتباط بين بناء المشهد والتوليد الزمني في نماذج التخفيض النصية-الفيديوية، وموقع المشروع المصاحب المُحمل بالفيديو.

في حين أن العديد من الأنظمة الحالية تحاول تعزيز دقة الإشارة باستخدام نماذج اللغة لإعادة كتابة نص غامض أو غير محدد، تدعي الأعمال الجديدة أن هذه الاستراتيجية لا تزال تؤدي إلى الفشل عندما تكون تمثيل المشهد الداخلي للنموذج معيبًا.

حتى مع إشارة مُحسّنة بالتفصيل، غالبًا ما تُخلط نماذج النص-الفيديو بين العناصر الرئيسية أو تُولّد حالات أولية غير متوافقة التي تُخالف منطق التحرير. ما دامت الإطار الأولى لا تعكس ما تصفه الإشارة، لا يمكن للفيديو الناتج أن يُستعاد، بغض النظر عن مدى جودة نموذج الحركة.

تُذكر الورقة*:

‘[نماذج النص-الفيديو] غالبًا ما تُنتج إطارات ذات توزيعات مُختلفة ولا تزال تحقق درجات تقييم مماثلة لنموذج I2V، مما يشير إلى أن نمذجة الحركة لا تزال طبيعية بشكل معقول حتى عندما تكون إخلاص المشهد ضعيفًا نسبيًا.

‘[نموذج الصورة-الفيديو] يُظهر السلوك التكميلي، درجات تقييم قوية من مشاهد أولية دقيقة وأقل تماسك زمني، بينما يوازن I2V+نص الجانبين.

‘هذا التباين يشير إلى عدم تطابق هيكلي في نماذج T2V الحالية: التأطير المشهد والتوليد الزمني يستفيدان من تحيزات استقرائية مُختلفة، ومع ذلك تحاول الهياكل الحالية تعلم كليهما في نفس الوقت داخل نموذج واحد.’

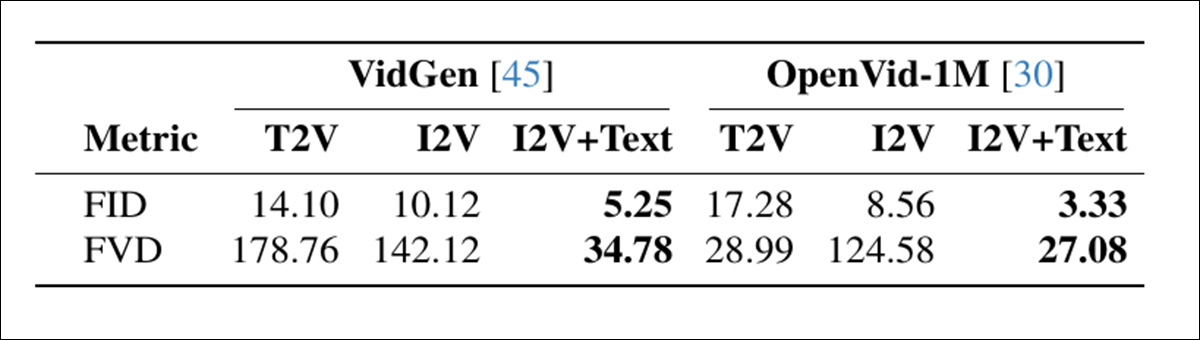

وجدت مقارنة تشخيصية لطرق التوليد أن النماذج التي لا تحتوي على تأطير مشهد صريح سجلت درجات جيدة على الحركة، لكنها أضحت تُضحى بمخطط المشهد:

مقارنة لطرق توليد الفيديو على مجموعتين من البيانات، تُظهر أن I2V+نص يُحقق أفضل جودة إطار (FID) وتوافق زمني (FVD)، مما يُبرز الفائدة من فصل بناء المشهد عن الحركة. المصدر

تشير هذه النتائج إلى عيب هيكلي حيث تحاول النماذج الحالية تعلم كلاً من مخطط المشهد والحركة في نفس الوقت، على الرغم من أن كلا المهمتين يتطلبان أنواعًا مُختلفة من التحيز الاستقرائي، ويُعالجان بشكل أفضل بشكل منفصل.

ربما يكون الأمر الأكثر إثارة للاهتمام هو أن هذا “الحيل” يمكن تطبيقه على تثبيتات محلية من نماذج مثل Wan 2.1 و 2.2، ونمذج التخفيض الفيديوي المُشابه مثل Hunyuan Video. من الناحية التاريخية، بالمقارنة مع جودة مُخرجات الهواة إلى منافذ التوليد التوليدي التجارية مثل Kling و Runway، يبدو أن معظم مزودي واجهات برمجة التطبيقات الرئيسيين يُحسّنون العروض المفتوحة المصدر مثل WAN مع LoRAs، و – يبدو – مع حيل من نفس النوع المُشاهدة في الورقة الجديدة. لذلك يمكن أن يُمثل هذا النهج تحسينًا لمجموعة FOSS.

تُشير الاختبارات المُجراة لهذا الأسلوب إلى أن هذا النهج البسيط والمنظم يُقدم حالة جديدة من الفن على معيار T2V-CompBench، ويُحسن بشكل كبير جميع النماذج المُختبرة. يُذكر المؤلفون في الخاتمة أن نظامهم لا يُحسن من الإخلاص فحسب، بل لا يُعالج (ولا يُقصد معالجته) انجراف الهوية، وهو حاليًا عائق أبحاث الذكاء الاصطناعي التوليدي.

تأتي الورقة الجديدة من أربعة باحثين في المدرسة الفيدرالية السويسرية للتكنولوجيا لاوسان (EPFL) في سويسرا.

الطريقة والبيانات

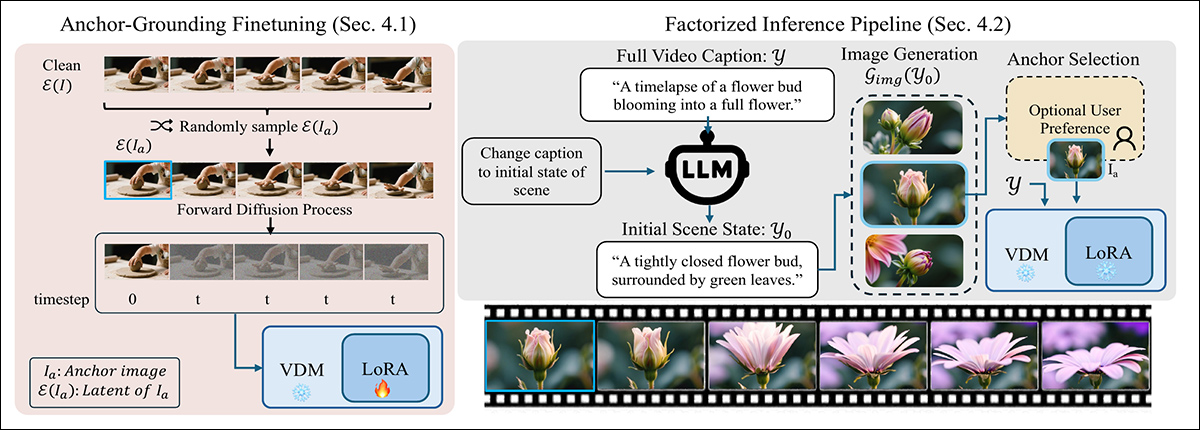

الفرضية المركزية للتقنية الجديدة هي أن نماذج التخفيض النصية-الفيديوية تحتاج إلى “تأطير” إلى إطارات بدء تُطابق حقًا الإشارة النصية.

لضمان احترام النموذج للإطار البدء، تُقاطع العملية التخفيضية الجديدة العملية التخفيضية القياسية عن طريق حقن لاتنت نقي من صورة المرساة في الوقت الصفري، واستبدال أحد المدخلات العادية المُضطربة. هذا المدخل الغريب يُربك النموذج في البداية، لكن مع ضبط دقيق LoRA، يتعلم النموذج معاملة الإطار المُحقون كمرساة بصرية ثابتة بدلاً من جزء من مسار الضوضاء:

طريقة مكونة من مرحلتين لتأطير توليد الفيديو النصي مع مرساة بصرية: اليسار، يتم ضبط النموذج باستخدام LoRA خفيف الوزن لمعالجة لاتنت نقي مُحقون كقيود مشهد ثابتة. اليمين، يتم تقسيم الإشارة إلى كابشن إطار أول، ويُستخدم لإنشاء صورة المرساة التي توجيه الفيديو.

في الاستدلال، يُكتب البرنامج النصي مرة أخرى لوصف فقط الإطار الأول، باستخدام LLM لاستخراج حالة مشهد أولية معقولة مركزة على التخطيط والمظهر.

يُمرر البرنامج النصي المُحسّن إلى مُولّد صورة لإنشاء إطار مرساة مرشح (الذي يمكن تعديله من قبل المستخدم اختياريًا). يُشفر الإطار المُختار إلى لاتنت ويُحقن في عملية التخفيض عن طريق استبدال الخطوة الزمنية الأولى، مما يسمح للنموذج بتوليد باقي الفيديو مع بقاءه مُؤطَرًا إلى المشهد الأول – عملية تعمل بدون الحاجة إلى تعديلات على الهيكل الأساسي.

تم اختبار العملية عن طريق إنشاء LoRAs لـ Wan2.2-14B و Wan2.1-1B و CogVideo1.5-5B. تم إجراء تدريب LoRA في رتبة 256، على 5000 مقطع فيديو مُختار عشوائيًا من مجموعة UltraVideo.

استمر التدريب لمدة 6000 خطوة، وطلب 48 ساعة معالج رسومات† لـ Wan-1B و CogVideo-5B، و 96 ساعة معالج رسومات لـ Wan-14B. يُذكر المؤلفون أن Wan-5B يدعم أصلاً التوليد النصي والصورة-نص (الذي يتم فرضه في هذه الحالة على الإطارات القديمة)، وبالتالي لم يُتطلب أي ضبط دقيق.

الاختبارات

في التجارب المُجراة لهذه العملية، تم تحسين كل إشارة نصية أولية باستخدام Qwen2.5-7B-Instruct، الذي استخدم النتيجة لإنشاء كابشن صورة مفصل يحتوي على وصف للمشهد بأكمله. ثم تم تمريره إلى QwenImage، الذي تم تكليفه بإنشاء “إطار سحري” ليتم وضعها في عملية التخفيض:

<img class=" wp-image-229733" src="https://www.unite.ai/wp-content/uploads/2025/12/table-2.jpg" alt="عبر جميع الفئات السبع للتقييم في T2V-CompBench، أ超过ت طريقة T2V المُحسّنة كلاً من التوليد القياسي والتوليد المُضخّم لجميع النماذج المُختبرة، مع مكاسب تصل إلى 53.25%. كانت المتغيرات ذات الدرجات الأعلى غالبًا ما تُطابق أو تتجاوز معيار PixVerse-V3 المملوك.

بخصوص هذه الجولة الأولى من الاختبارات، يُذكر المؤلفون*:

‘[عبر] جميع النماذج، يُحسن إضافة صورة مرساة بشكل متسق الأداء التركيبي. جميع نماذج Factorized الأصغر (CogVideo 5B و Wan 5B و Wan 1B) تُتفوق على نموذج T2V الأكبر Wan 14B.

‘نموذج Factorized Wan 5B يُتفوق أيضًا على معيار PixVerse-V3 المملوك الذي هو أفضل نموذج مُبلغ عنه على المعيار. هذا يُظهر أن التأطير البصري يُحسن بشكل كبير فهم المشهد والعملية حتى في نماذج ذات سعة أقل.

‘داخل كل عائلة نموذج، يُتفوق الإصدار المُحسّن على النموذج الأصلي. ومن الملاحظات البارزة أن نسخة LoRA المُحسّنة الخفيفة على WAN 14B تُحقق أداءً مُقاربًا لنسخة I2V المُتدربة مسبقًا (0.661 مقابل 0.666)، على الرغم من أنه لا يُتطلب أي إعادة تدريب كامل.’

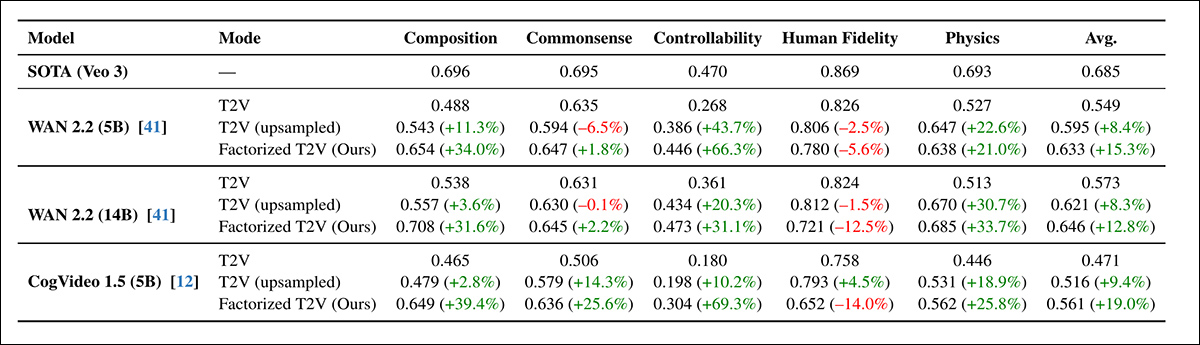

ثم جاءت جولة VBench2.0:

تُحسن طريقة T2V المُحسّنة بشكل متسق أداء VBench 2.0 عبر التكوين والتفكير العادي والتحكم والفيزياء، مع بعض المكاسب التي تتجاوز 60% – على الرغم من أن إخلاص الإنسان ظل أقل من معيار Veo 3 المملوك.

عبر جميع الهياكل، أ cảiط طريقة المُحسّنة درجات في كل فئة VBench باستثناء إخلاص الإنسان، الذي انخفض قليلاً حتى مع تكرار الإشارة. Wan 5B يُتفوق على Wan 14B الأكبر، مما يُؤكد النتائج السابقة لـ T2V-CompBench التي أظهرت أن التأطير البصري ساهم أكثر من الحجم.

على الرغم من أن المكاسب على VBench كانت متسقة، كانت أصغر من تلك المُشاهدة على T2V-CompBench، ويعزى المؤلفون ذلك إلى نظام التقييم الثنائي الصارم لـ VBench.

للاختبارات النوعية، تُزوّد الورقة بالصور الثابتة، لكننا نُشير القارئ إلى الفيديوهات المُركبة في هذا المقال، للحصول على فكرة أوضح، مع الحذر من أن ملفات الفيديو المصدر أكثر تنوعًا وأكثر دقة. العثور عليها هنا. بخصوص النتائج النوعية، تُذكر الورقة:

‘الفيديوهات المُؤطرة تُظهر بشكل متسق تكوين مشهد أكثر دقة، وربط بين الكائنات والسمات أقوى، وتقدم زمني أوضح.’

بقي طريقة المُحسّنة مستقرًا حتى عندما تم تقصير عدد خطوات التخفيض من 50 إلى 15، مع فقدان أداء ضئيل على T2V-CompBench. من ناحية أخرى، انخفضت القواعد النصية والقواعد المُضخمة بشكل حاد في ظل نفس الظروف.

على الرغم من أن تقليل الخطوات يمكن أن يُزيد من السرعة ثلاث مرات نظريًا، أصبح خط أنابيب التوليد الكامل أسرع فقط 2.1 مرة في الممارسة، بسبب التكاليف الثابتة لتوليد صورة المرساة. ومع ذلك، أشارت النتائج إلى أن التأطير لا يُحسن فقط من جودة العينة، بل يساعد أيضًا على استقرار عملية التخفيض، مما يدعم توليد أسرع وأكثر كفاءة دون فقدان الدقة.

يوفر موقع المشروع أمثلة على توليدات الفيديو المُضخمة مقابل طريقة جديدة، منها بعض الأمثلة (بدقة أقل) المُعدلة هنا:

انقر للعب (لا يوجد صوت). مصادر بدء مُضخمة مقابل طريقة المُحسّنة للمؤلفين.

يُختتم المؤلفون:

‘تُشير نتائجنا إلى أن التأطير المُحسّن، بدلاً من زيادة السعة فقط، قد يكون مهمًا بنفس القدر. تعتمد التطورات الحديثة في التخفيض النصي-الفيديوي بشكل كبير على زيادة حجم النموذج وبيانات التدريب، ومع ذلك حتى النماذج الكبيرة غالبًا ما تعاني من استنتاج مشهد أولي متسق من النص وحده.

‘هذا يُعارض التخفيض بالصورة، حيث يكون التوسع مباشرًا؛ في نماذج الفيديو، يجب على كل تحسين هيكلي تشغيل على بعد زمني إضافي، مما يجعل التوسع أكثر استهلاكًا للموارد بشكل كبير.

‘تُشير نتائجنا إلى أن التأطير المُحسّن يمكن أن يُكمل الحجم عن طريق معالجة عائق مختلف: إنشاء المشهد الصحيح قبل بدء التوليد الزمني.

‘من خلال فك توليد الفيديو إلى تكوين مشهد وتوليد زمني، نحن نتغلب على عدة أنماط فشل شائعة دون الحاجة إلى نماذج أكبر بشكل كبير. نحن نعتبر هذا مبدأ تصميم مُكمل يمكن أن يوجه الهياكل المستقبلية نحو توليد فيديو أكثر موثوقية وهيكلة.’

الخاتمة

على الرغم من أن مشاكل التشابك حقيقية، وربما تتطلب حلول مُخصصة (مثل تحسين التكامل والتقويم قبل التدريب)، فقد كان من المُثير مُشاهدة التأطير ‘يفك’ بعض التوليفات المُصابة والمُستقرة إلى مُحاكاة أكثر دقة – مع طبقة مُعتدلة من ضبط LoRA، وتدخل صورة بدء/بذرة مُحسّنة بشكل ملحوظ.

قد لا يكون الفجوة في الموارد بين الاستدلال المحلي للهواة وال حلول التجارية كبيرة كما يُفترض، حيث يبحث معظم المُزودين عن तरشيعة لاستخراج مواردهم الكبيرة من معالجات الرسومات للمستهلكين.

يمكن أن تساعد رؤى من هذا القبيل في إغلاق الفجوة أكثر، في سياق مشهد الإصدار حيث يبدو أن الصينيين حازمون (لا بالضرورة لأسباب خيالية أو مثالية) على ديمقراطية الذكاء الاصطناعي، بينما تفضل المصالح التجارية الغربية أن يُؤدي زيادة حجم النموذج واللوائح في النهاية إلى حصر أي نماذج جيدة حقًا خلف واجهات برمجة التطبيقات، وطبقات متعددة من مرشحات المحتوى.

* تأكيدات المؤلفين، وليس لي.

† لا تُشير الورقة إلى معالج الرسومات المُختار، أو عدد المعالجات المستخدمة.

†† على الرغم من أن طريق LoRA أكثر احتمالًا، من أجل سهولة الاستخدام الاقتصادية، و因为 الأوزان الكاملة، بدلاً من الأوزان المُquantized، لا تُتاح دائمًا.

نُشر لأول مرة يوم الجمعة، 19 ديسمبر 2025